策略梯度玩 cartpole 游戏,强化学习代替PID算法控制平衡杆

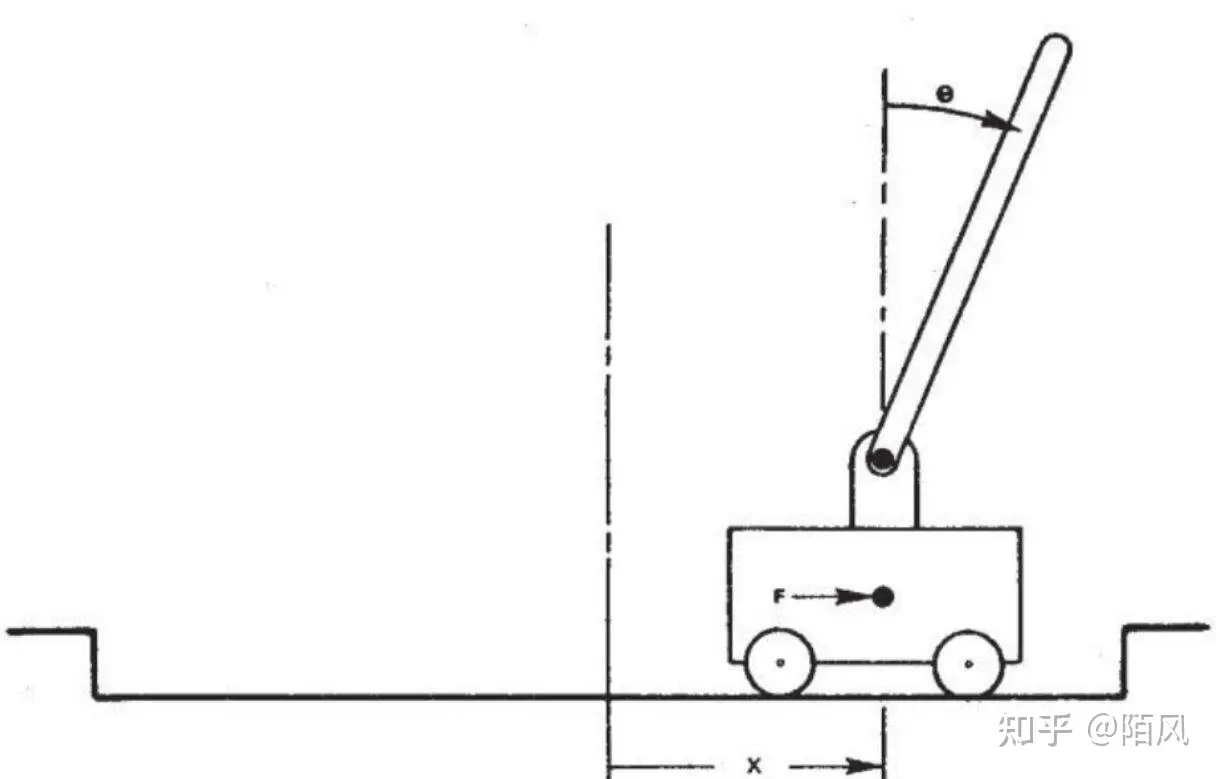

cartpole游戏,车上顶着一个自由摆动的杆子,实现杆子的平衡,杆子每次倒向一端车就开始移动让杆子保持动态直立的状态,策略函数使用一个两层的简单神经网络,输入状态有4个,车位置,车速度,杆角度,杆速度,输出action为左移动或右移动,输入状态发现至少要给3个才能稳定一会儿,给2个完全学不明白,给4个能学到很稳定的policy

策略梯度实现代码,使用torch实现一个简单的神经网络

import gym

import torch

import torch.nn as nn

import torch.optim as optim

import pygame

import sys

from collections import deque

import numpy as np # 策略网络定义

class PolicyNetwork(nn.Module):

def __init__(self):

super(PolicyNetwork, self).__init__()

self.fc = nn.Sequential(

nn.Linear(4, 10), # 4个状态输入,128个隐藏单元

nn.Tanh(),

nn.Linear(10, 2), # 输出2个动作的概率

nn.Softmax(dim=-1)

) def forward(self, x):

# print(x) 车位置 车速度 杆角度 杆速度

selected_values = x[:, [0,1,2,3]] #只使用车位置和杆角度

return self.fc(selected_values) # 训练函数

def train(policy_net, optimizer, trajectories):

policy_net.zero_grad()

loss = 0

print(trajectories[0])

for trajectory in trajectories: # if trajectory["returns"] > 90:

# returns = torch.tensor(trajectory["returns"]).float()

# else:

returns = torch.tensor(trajectory["returns"]).float() - torch.tensor(trajectory["step_mean_reward"]).float()

# print(f"获得奖励{returns}")

log_probs = trajectory["log_prob"]

loss += -(log_probs * returns).sum() # 计算策略梯度损失

loss.backward()

optimizer.step()

return loss.item() # 主函数

def main():

env = gym.make('CartPole-v1')

policy_net = PolicyNetwork()

optimizer = optim.Adam(policy_net.parameters(), lr=0.01) print(env.action_space)

print(env.observation_space)

pygame.init()

screen = pygame.display.set_mode((600, 400))

clock = pygame.time.Clock() rewards_one_episode= []

for episode in range(10000): state = env.reset()

done = False

trajectories = []

state = state[0]

step = 0

torch.save(policy_net, 'policy_net_full.pth')

while not done:

state_tensor = torch.tensor(state).float().unsqueeze(0)

probs = policy_net(state_tensor)

action = torch.distributions.Categorical(probs).sample().item()

log_prob = torch.log(probs.squeeze(0)[action])

next_state, reward, done, _,_ = env.step(action) # print(episode)

trajectories.append({"state": state, "action": action, "reward": reward, "log_prob": log_prob})

state = next_state for event in pygame.event.get():

if event.type == pygame.QUIT:

pygame.quit()

sys.exit()

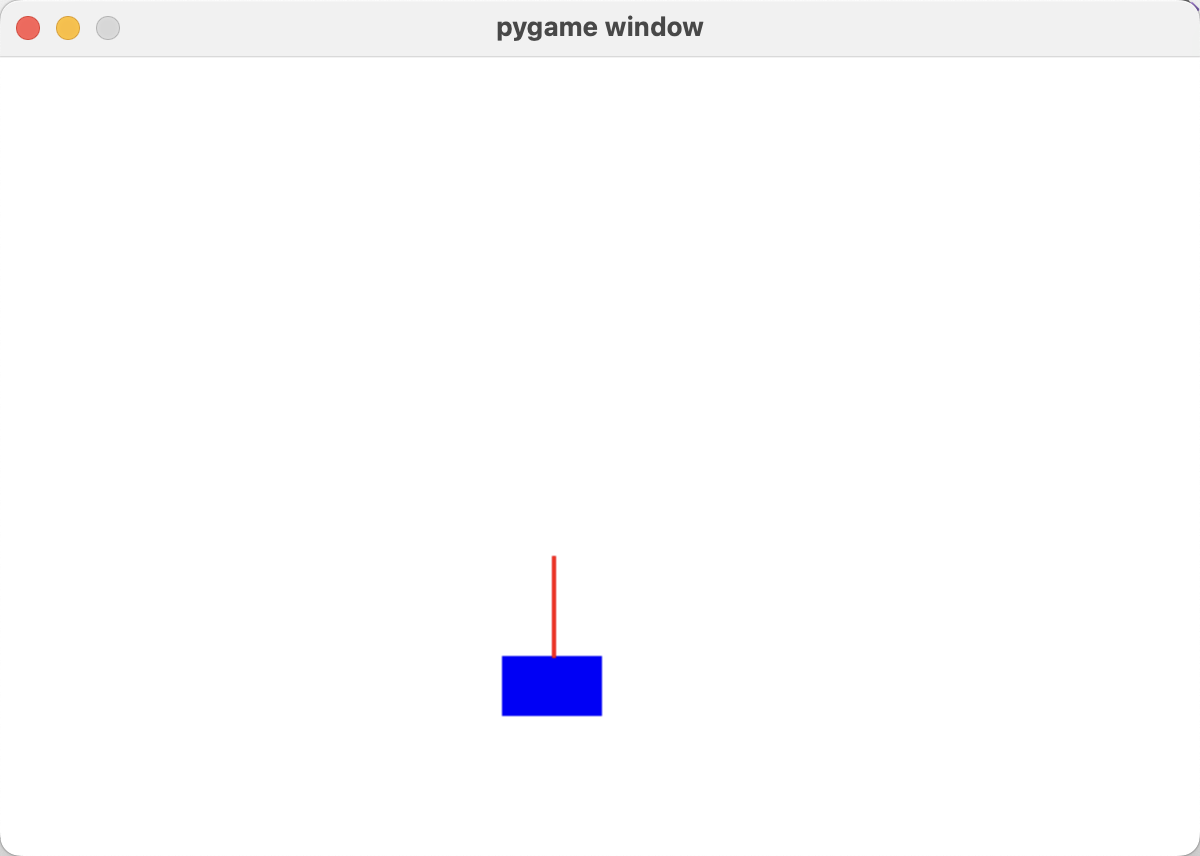

step +=1 # 绘制环境状态

if rewards_one_episode and rewards_one_episode[-1] >99:

screen.fill((255, 255, 255))

cart_x = int(state[0] * 100 + 300)

pygame.draw.rect(screen, (0, 0, 255), (cart_x, 300, 50, 30))

# print(state)

pygame.draw.line(screen, (255, 0, 0), (cart_x + 25, 300), (cart_x + 25 - int(50 * torch.sin(torch.tensor(state[2]))), 300 - int(50 * torch.cos(torch.tensor(state[2])))), 2)

pygame.display.flip()

clock.tick(200) print(f"第{episode}回合",f"运行{step}步后挂了")

# 为策略梯度计算累积回报

returns = 0 for traj in reversed(trajectories):

returns = traj["reward"] + 0.99 * returns

traj["returns"] = returns

if rewards_one_episode:

# print(rewards_one_episode[:10])

traj["step_mean_reward"] = np.mean(rewards_one_episode[-10:])

else:

traj["step_mean_reward"] = 0

rewards_one_episode.append(returns)

# print(rewards_one_episode[:10])

train(policy_net, optimizer, trajectories) def play(): env = gym.make('CartPole-v1')

policy_net = PolicyNetwork()

pygame.init()

screen = pygame.display.set_mode((600, 400))

clock = pygame.time.Clock() state = env.reset()

done = False

trajectories = deque()

state = state[0]

step = 0

policy_net = torch.load('policy_net_full.pth')

while not done:

state_tensor = torch.tensor(state).float().unsqueeze(0)

probs = policy_net(state_tensor)

action = torch.distributions.Categorical(probs).sample().item()

log_prob = torch.log(probs.squeeze(0)[action])

next_state, reward, done, _,_ = env.step(action) # print(episode)

trajectories.append({"state": state, "action": action, "reward": reward, "log_prob": log_prob})

state = next_state for event in pygame.event.get():

if event.type == pygame.QUIT:

pygame.quit()

sys.exit() # 绘制环境状态

screen.fill((255, 255, 255))

cart_x = int(state[0] * 100 + 300)

pygame.draw.rect(screen, (0, 0, 255), (cart_x, 300, 50, 30))

# print(state)

pygame.draw.line(screen, (255, 0, 0), (cart_x + 25, 300), (cart_x + 25 - int(50 * torch.sin(torch.tensor(state[2]))), 300 - int(50 * torch.cos(torch.tensor(state[2])))), 2)

pygame.display.flip()

clock.tick(60)

step +=1 print(f"运行{step}步后挂了") if __name__ == '__main__':

main() #训练

# play() #推理

运行效果,训练过程不是很稳定,有时候学很多轮次也学不明白,有时侯只需要几十次就可以学明白了

策略梯度玩 cartpole 游戏,强化学习代替PID算法控制平衡杆的更多相关文章

- 策略梯度训练cartpole小游戏

我原来已经安装了anaconda,在此基础上进入cmd进行pip install tensorflow和pip install gym就可以了. 在win10的pycharm做的. policy_gr ...

- TensorFlow利用A3C算法训练智能体玩CartPole游戏

本教程讲解如何使用深度强化学习训练一个可以在 CartPole 游戏中获胜的模型.研究人员使用 tf.keras.OpenAI 训练了一个使用「异步优势动作评价」(Asynchronous Advan ...

- DRL 教程 | 如何保持运动小车上的旗杆屹立不倒?TensorFlow利用A3C算法训练智能体玩CartPole游戏

本教程讲解如何使用深度强化学习训练一个可以在 CartPole 游戏中获胜的模型.研究人员使用 tf.keras.OpenAI 训练了一个使用「异步优势动作评价」(Asynchronous Advan ...

- 【强化学习】DQN 算法改进

DQN 算法改进 (一)Dueling DQN Dueling DQN 是一种基于 DQN 的改进算法.主要突破点:利用模型结构将值函数表示成更加细致的形式,这使得模型能够拥有更好的表现.下面给出公式 ...

- 【算法总结】强化学习部分基础算法总结(Q-learning DQN PG AC DDPG TD3)

总结回顾一下近期学习的RL算法,并给部分实现算法整理了流程图.贴了代码. 1. value-based 基于价值的算法 基于价值算法是通过对agent所属的environment的状态或者状态动作对进 ...

- 强化学习(十七) 基于模型的强化学习与Dyna算法框架

在前面我们讨论了基于价值的强化学习(Value Based RL)和基于策略的强化学习模型(Policy Based RL),本篇我们讨论最后一种强化学习流派,基于模型的强化学习(Model Base ...

- 强化学习-时序差分算法(TD)和SARAS法

1. 前言 我们前面介绍了第一个Model Free的模型蒙特卡洛算法.蒙特卡罗法在估计价值时使用了完整序列的长期回报.而且蒙特卡洛法有较大的方差,模型不是很稳定.本节我们介绍时序差分法,时序差分法不 ...

- 强化学习8-时序差分控制离线算法Q-Learning

Q-Learning和Sarsa一样是基于时序差分的控制算法,那两者有什么区别呢? 这里已经必须引入新的概念 时序差分控制算法的分类:在线和离线 在线控制算法:一直使用一个策略选择动作和更新价值函数, ...

- 强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods)

强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods) 学习笔记: Reinforcement Learning: An Introduction, Richa ...

- 基于Keras的OpenAI-gym强化学习的车杆/FlappyBird游戏

强化学习 课程:Q-Learning强化学习(李宏毅).深度强化学习 强化学习是一种允许你创造能从环境中交互学习的AI Agent的机器学习算法,其通过试错来学习.如上图所示,大脑代表AI Agent ...

随机推荐

- MySQL配置和常用命令

目录 数据库配置 常用操作 项目地址:https://github.com/aijisjtu/Bot-Battle graph LR A[配置数据源] --> B[建立连接] B --> ...

- 基于新版宝塔Docker部署在线客服系统过程小记

我在业余时间开发维护了一款免费开源的升讯威在线客服系统,也收获了许多用户.对我来说,只要能获得用户的认可,就是我最大的动力. 客服系统开发过程中,最让我意外的是对 TCP/IP 协议的认识.过去一直认 ...

- C++ 模板和泛型编程详解

C++中的模板和泛型编程是非常重要的概念.模板是一种将数据类型作为参数的通用程序设计方法.它们允许开发人员编写可以处理各种数据类型的代码,而无需为每种数据类型编写不同的代码.下面介绍了一些关于C++中 ...

- SAST-数据流分析方法-理论

引言 众所周知,数据流分析是实现污点分析的一种常用技术 数据流分析分为过程内的数据流分析与过程间的数据流分析.前者是对一个方法体内的数据流分析,主要是基于CFG分析,不涉及方法调用:后者是基于不同方法 ...

- 《深入理解Java虚拟机》读书笔记: 虚拟机类加载的时机和过程

虚拟机类加载的时机和过程 一.类加载的时机 类从被加载到虚拟机内存中开始,到卸载出内存为止,它的整个生命周期包括:加载(Loading).验证(Verification).准备(Preparation ...

- Godot.NET C#IOC重构(2):TileMap 详解

目录 前言 TileMap添加 TileMap绘制 TileMap 连续图块 修改纹理原点 统一设置 自动地形 匹配规则 修改匹配概率 修改概率前 修改概率后 随机图块 Scattering 不连续间 ...

- ython 并不合适职场编程,SPL 才行

职场人员使用 Excel 进行数据处理已经成为家常便饭.不过相信大家一定有过很无助的情况,比如复杂计算.重复计算.自动处理等,再遇上个死机没保存,整个人崩溃掉也不是完全不可能. 如果学会了程序语言,这 ...

- docker 应用篇————dockerfile[十四]

前言 简单介绍一下dockerfile. 正文 dockerfile就是docker image的构建文件. 然后来运行一下. 然后就产生了test:1.0 这个镜像. 然后启动一下你就发现了这个镜像 ...

- Webpack中Loader和Plugin的区别?编写Loader,Plugin的思路?

一.区别 前面两节我们有提到Loader与Plugin对应的概念,先来回顾下 loader 是文件加载器,能够加载资源文件,并对这些文件进行一些处理,诸如编译.压缩等,最终一起打包到指定的文件中 pl ...

- JavaIDEA配置JDBC数据库连接+可视化页面

"感谢您阅读本篇博客!如果您觉得本文对您有所帮助或启发,请不吝点赞和分享给更多的朋友.您的支持是我持续创作的动力,也欢迎留言交流,让我们一起探讨技术,共同成长!谢谢!" 0X01 ...