Hbase1.4.9的安装

HBase介绍

HBase – Hadoop Database,是一个高可靠性、高性能、面向列、可伸缩的分布式存储系统,利用HBase技术可在廉价PC Server上搭建起大规模结构化存储集群。

HBase是Google Bigtable的开源实现,类似Google Bigtable利用GFS作为其文件存储系统,HBase利用Hadoop HDFS作为其文件存储系统;Google运行MapReduce来处理Bigtable中的海量数据,HBase同样利用Hadoop MapReduce来处理HBase中的海量数据。

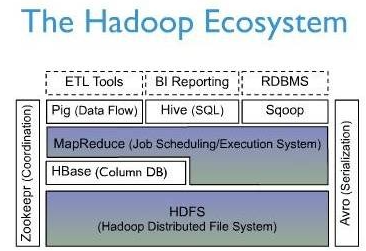

上图描述了Hadoop EcoSystem中的各层系统,其中HBase位于结构化存储层,Hadoop HDFS为HBase提供了高可靠性的底层存储支持,Hadoop MapReduce为HBase提供了高性能的计算能力,Zookeeper为HBase提供了稳定服务和failover机制。

此外,Pig和Hive还为HBase提供了高层语言支持,使得在HBase上进行数据统计处理变的非常简单。 Sqoop则为HBase提供了方便的RDBMS数据导入功能,使得传统数据库数据向HBase中迁移变的非常方便。

安装hbase前,请安装独立的zookeeper-3.4.12 详情请参考本人博客:https://www.cnblogs.com/hello-wei/p/10261517.html

把下载好的包 传到/home/hadoop/hbase 解压后:

[hadoop@master hbase]$ ll

total

drwxr-xr-x. hadoop hadoop Dec : bin

-rw-r--r--. hadoop hadoop Dec : CHANGES.txt

drwxr-xr-x. hadoop hadoop Dec : conf

drwxr-xr-x. hadoop hadoop Dec : docs

drwxr-xr-x. hadoop hadoop Dec : hbase-webapps

-rw-r--r--. hadoop hadoop Dec : LEGAL

drwxrwxr-x. hadoop hadoop Jan : lib

-rw-r--r--. hadoop hadoop Dec : LICENSE.txt

-rw-r--r--. hadoop hadoop Dec : NOTICE.txt

-rw-r--r--. hadoop hadoop Dec : README.txt

设置环境变量

[root@master master]# vi /etc/profile

export HBASE_HOME=/home/hadoop/hbase

export PATH=$PATH:$HBASE_HOME/bin

[root@master master]# source /etc/profile

[hadoop@master ~]$ hbase version

HBase 1.4.9

Source code repository git://apurtell-ltm4.internal.salesforce.com/Users/apurtell/src/hbase revision=d625b212e46d01cb17db9ac2e9e927fdb201afa1

Compiled by apurtell on Wed Dec 5 11:54:10 PST 2018

From source with checksum a7716fc1849b07ea6dd830a08291e754

编辑hbase-env.sh

#注释到下面两行

# Configure PermSize. Only needed in JDK7. You can safely remove it for JDK8+

#export HBASE_MASTER_OPTS="$HBASE_MASTER_OPTS -XX:PermSize=128m -XX:MaxPermSize=128m -XX:ReservedCodeCacheSize=256m"

#export HBASE_REGIONSERVER_OPTS="$HBASE_REGIONSERVER_OPTS -XX:PermSize=128m -XX:MaxPermSize=128m -XX:ReservedCodeCacheSize=256m"

#Java环境

export JAVA_HOME=/usr/local/jdk1.

#通过hadoop的配置文件找到hadoop集群

export HBASE_CLASSPATH=/home/hadoop/hadoop-2.7.3/etc/hadoop

#使用HBASE自带的zookeeper管理集群

export HBASE_MANAGES_ZK=false

编辑hbase-site.xml

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://192.168.1.30:9000/hbase</value> #这里要和hadoop下的配置文件core-site.xml的<name>fs.defaultFS</name>值hdfs://192.168.1.30:9000一致

</property>

<!--启用分布式集群-->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!--默认HMaster HTTP访问端口-->

<property>

<name>hbase.master.info.port</name>

<value>16010</value>

</property>

<!--默认HRegionServer HTTP访问端口-->

<property>

<name>hbase.regionserver.info.port</name>

<value>16030</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>master:2181,saver1:2181,saver2:2181</value>

</property>

<property>

<name>hbase.coprocessor.abortonerror</name>

<value>false</value>

</property>

</configuration>

编辑regionservers

[hadoop@master conf]$ vi regionservers

saver1

saver2

拷贝到其他节点:

scp -r hbase hadoop@192.168.1.40:/home/hadoop

scp -r hbase hadoop@192.168.1.50:/home/hadoop

启动:

start-hbase.sh

[hadoop@master hadoop]$ start-hbase.sh

running master, logging to /home/hadoop/hbase/logs/hbase-hadoop-master-master.out

saver2: running regionserver, logging to /home/hadoop/hbase/bin/../logs/hbase-hadoop-regionserver-saver2.out

saver1: running regionserver, logging to /home/hadoop/hbase/bin/../logs/hbase-hadoop-regionserver-saver1.out

进入HBASE shell

[hadoop@master hadoop]$ hbase shell

2019-01-15 22:31:31,100 WARN [main] util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

SLF4J: Class path contains multiple SLF4J bindings.

SLF4J: Found binding in [jar:file:/home/hadoop/hbase/lib/slf4j-log4j12-1.7.10.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: Found binding in [jar:file:/home/hadoop/hadoop-2.7.3/share/hadoop/common/lib/slf4j-log4j12-1.7.10.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: See http://www.slf4j.org/codes.html#multiple_bindings for an explanation.

SLF4J: Actual binding is of type [org.slf4j.impl.Log4jLoggerFactory]

HBase Shell

Use "help" to get list of supported commands.

Use "exit" to quit this interactive shell.

Version 1.4.9, rd625b212e46d01cb17db9ac2e9e927fdb201afa1, Wed Dec 5 11:54:10 PST 2018 hbase(main):001:0> list

TABLE

0 row(s) in 0.2370 seconds => []

master后台进程:

[hadoop@master hadoop]$ jps

Jps

NodeManager

DataNode

HMaster

SecondaryNameNode

QuorumPeerMain

ResourceManager

NameNode

[hadoop@master hadoop]$

saver1后台进程:

[hadoop@saver2 ~]$ jps

Jps

HRegionServer

QuorumPeerMain

DataNode

NodeManager

[hadoop@saver2 ~]$

完。

Hbase1.4.9的安装的更多相关文章

- 大数据系列之分布式数据库HBase-1.2.4+Zookeeper 安装及增删改查实践

之前介绍过关于HBase 0.9.8版本的部署及使用,本篇介绍下最新版本HBase1.2.4的部署及使用,有部分区别,详见如下: 1. 环境准备: 1.需要在Hadoop[hadoop-2.7.3] ...

- 大数据系列之分布式数据库HBase-0.9.8安装及增删改查实践

若查看HBase-1.2.4版本内容及demo代码详见 大数据系列之分布式数据库HBase-1.2.4+Zookeeper 安装及增删改查实践 1. 环境准备: 1.需要在Hadoop启动正常情况下安 ...

- 1.安装hbase

参考:http://hbase.apache.org/book.html#quickstart 一.下载hbase 去apache下载hbase,然后解压到/usr/local/hbase-1.1.3 ...

- Hadoop集群(三) Hbase搭建

前面已经完成Zookeeper和HDFS的安装,本文会详细介绍Hbase的安装步骤.以及安装过程中遇到问题的汇总. 系列文章: Hadoop集群(一) Zookeeper搭建 Hadoop集群(二 ...

- Oracle GoldenGate 同步数据至Hbase

该方法没试过,先记下再说 1.软件版本说明: Goldengate 12c 12.2.0.1 for Oracle(源端) Goldengate 12c 12.3.0.1 for Bigdata (目 ...

- hbase1.2.4 伪分布式安装

注意:在安装hbase或者hadoop的时候,要注意hadoop和hbase的对应关系.如果版本不对应可能造成系统的不稳定和一些其他的问题.在hbase的lib目录下可以看到hadoop对应jar文件 ...

- hadoop: hbase1.0.1.1 伪分布安装

环境:hadoop 2.6.0 + hbase 1.0.1.1 + mac OS X yosemite 10.10.3 安装步骤: 一.下载解压 到官网 http://hbase.apache.org ...

- hadoop2.6完全分布式安装HBase1.1

本文出自:http://wuyudong.com/archives/119 对于全分布式的HBase安装,需要通过hbase-site.xml文档来配置本机的HBase特性,由于各个HBase之间通过 ...

- Flume1.9.0的安装、部署、简单应用(含分布式、与Hadoop3.1.2、Hbase1.4.9的案例)

目录 目录 前言 什么是Flume? Flume的特点 Flume的可靠性 Flume的可恢复性 Flume的一些核心概念 Flume的官方网站在哪里? Flume在哪里下载以及如何安装? 设置环境变 ...

随机推荐

- Failed to start LSB: start and stop MariaDB

Failed to start LSB: start and stop MariaDB */--> Failed to start LSB: start and stop MariaDB Tab ...

- pandas中的reset_index()

数据清洗时,会将带空值的行删除,此时DataFrame或Series类型的数据不再是连续的索引,可以使用reset_index()重置索引. import pandas as pd import nu ...

- 深入学习重点分析java基础---第一章:深入理解jvm(java虚拟机) 第一节 java内存模型及gc策略

身为一个java程序员如果只会使用而不知原理称其为初级java程序员,知晓原理而升中级.融会贯通则为高级 作为有一个有技术追求的人,应当利用业余时间及零碎时间了解原理 近期在看深入理解java虚拟机 ...

- php获取文件名和后缀名

php获取文件名 1 function retrieve($url) 2 { 3 preg_match('/\/([^\/]+\.[a-z]+)[^\/]*$/',$url,$match); 4 re ...

- go 基础 处理异常

package main import "fmt" func main() { dosomething() } func dosomething(){ defer func() { ...

- Idea Debug多线程不进断点问题处理

Idea也会使我狼狈不堪,Eclipse下约定成俗,却非Idea的默认规则. 比如 DEBUG多个线程时,Idea的默认设定就会遇到断点不能进入的问题. 解决的方法: 点击DEBUF框下的双红点(Vi ...

- dockerfile中配置时区

https://www.cnblogs.com/kevingrace/p/5570597.html #设置时区RUN /bin/cp /usr/share/zoneinfo/Asia/Shanghai ...

- SQLserver本地数据库开发

远程端数据库中生成脚本 注意 远程端的数据库 是中文版的还是英文版的,一般我们装的是英文版的, 如果远程端数据库是中文版的,那么我们本地的是英文版,在生成的脚本那需要修改,同时去除相应的路劲代码. 修 ...

- SparkCore的性能优化

1.广播变量 1.1. Spark提供的Broadcast Variable,是只读的,并且在每个节点上只会有一份副本,而不会为每个task都拷贝一份副本 1.2.它的最大作用,就是减少变量到各个节点 ...

- python-阿里镜像源-pip

将pip源设置为国内 >>>windows 1 地址栏输入%appdata% 2 新建pip文件价 3 文件夹里建pip.ini 内容: [global] timeout = 600 ...