爬虫初体验:Python+Requests+BeautifulSoup抓取广播剧

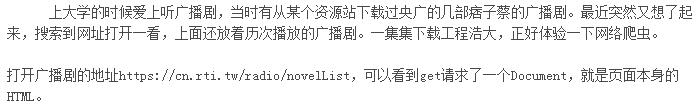

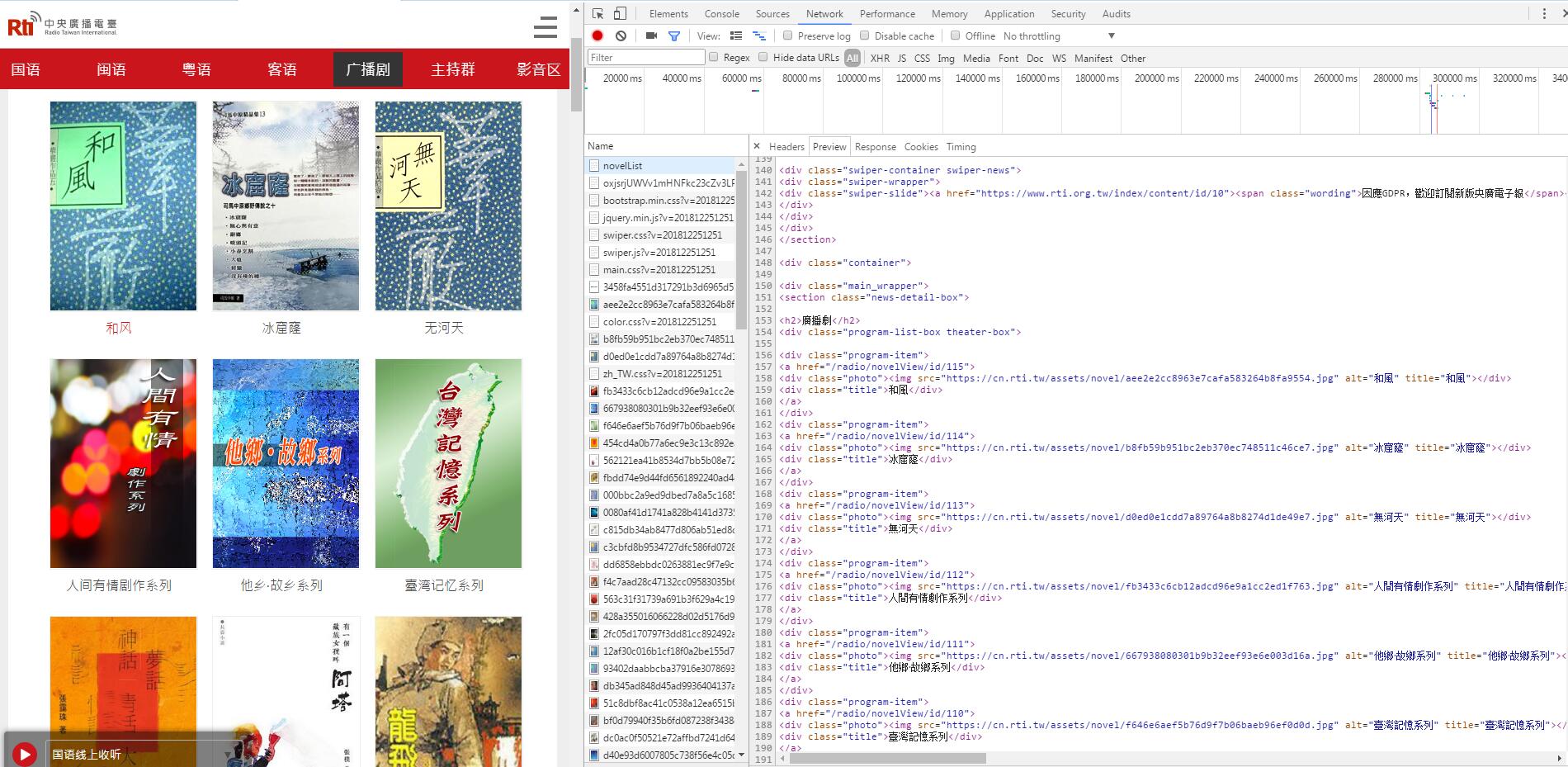

可以看到一个DIV下放一个广播剧的信息,包括名称和地址,第一步我们先收集所有广播剧的收听地址:

# 用requests的get方法访问

novel_list_resp = requests.get("这里放URL的地址")

# 利用上一步访问返回的结果生成一个BeautifulSoup对象

opera_soup = BeautifulSoup(novel_list_resp.text, "lxml")

# 获取所有class="program-item"的div

opera_soup.find_all("div", class_="program-item")

接着我们遍历这些div,获取每个广播剧的链接和名称:

# 找到div中的a标签,获取每个广播剧的链接

opera_link = domain + div.find("a").get('href')

# 获取每个广播剧的名称

title = div.find("div", class_="title").string

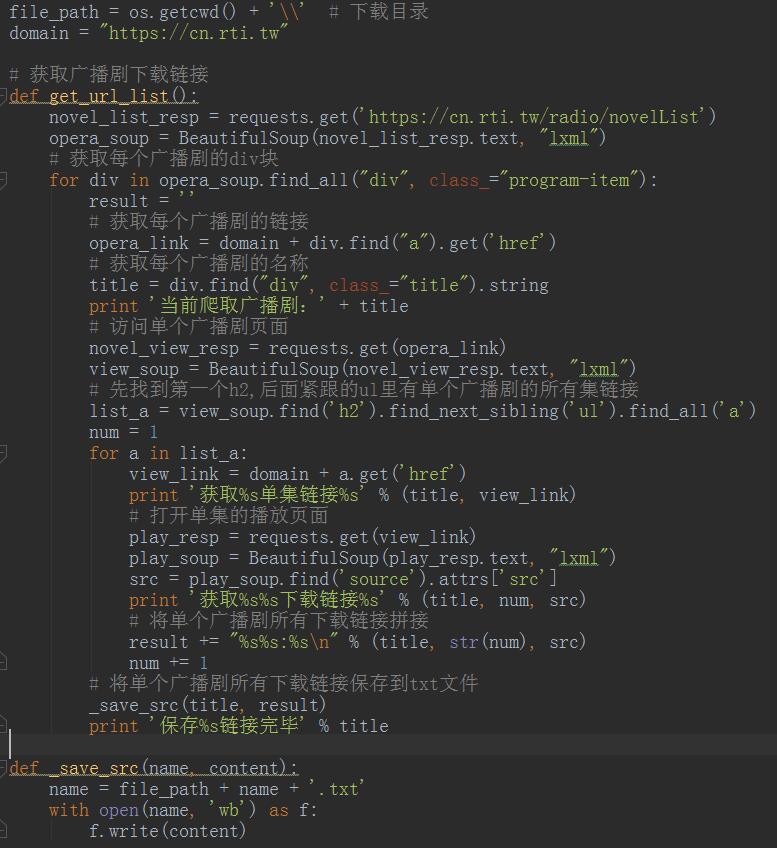

我们点击一个广播剧进去,在HTML中可以看到在ul中,每个li里都有一集的播放链接,并且是按顺序的。

代码中我们继续用之前的方法访问单个广播剧地址,来获取剧集的list:

# 访问单个广播剧页面

novel_view_resp = requests.get(opera_link)

# 利用上一步访问返回的结果生成一个BeautifulSoup对象

view_soup = BeautifulSoup(novel_view_resp.text, "lxml")

# 首先定位h2标签,然后获取h2的下一个ul标签(直接找ul的话会找到其他的ul),然后获取所有a标签

list_a = view_soup.find('h2').find_next_sibling('ul').find_all('a')

# 接着遍历a标签,把每集的地址取出来

view_link = domain + a.get('href')

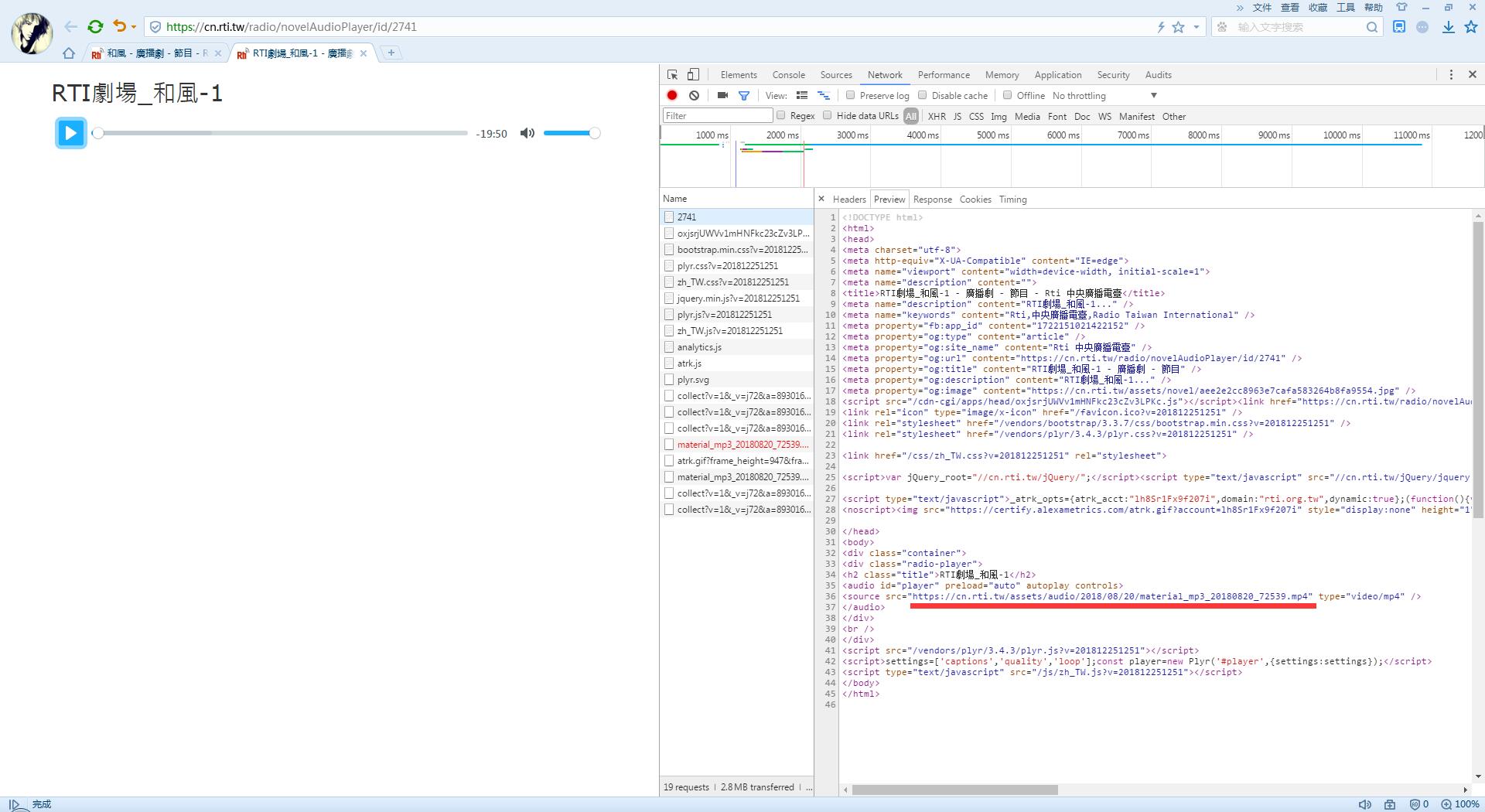

我们继续看一个单集的播放的HTML,source标签里就是最终的资源地址了,一个MP4文件:

# 打开单集的播放页面

play_resp = requests.get(view_link)

play_soup = BeautifulSoup(play_resp.text, "lxml")

# 获取资源下载地址

src = play_soup.find('source').attrs['src']

现在我还不想下载,我希望先试听确认喜欢后再下载,所以我把下载地址存到一个txt里,一个广播剧存一个txt:

name = file_path + name + '.txt'

with open(name, 'wb') as f:

f.write(content)

由于编码问题,在文件最上加上以下代码:

import sys

reload(sys)

sys.setdefaultencoding('utf-8')

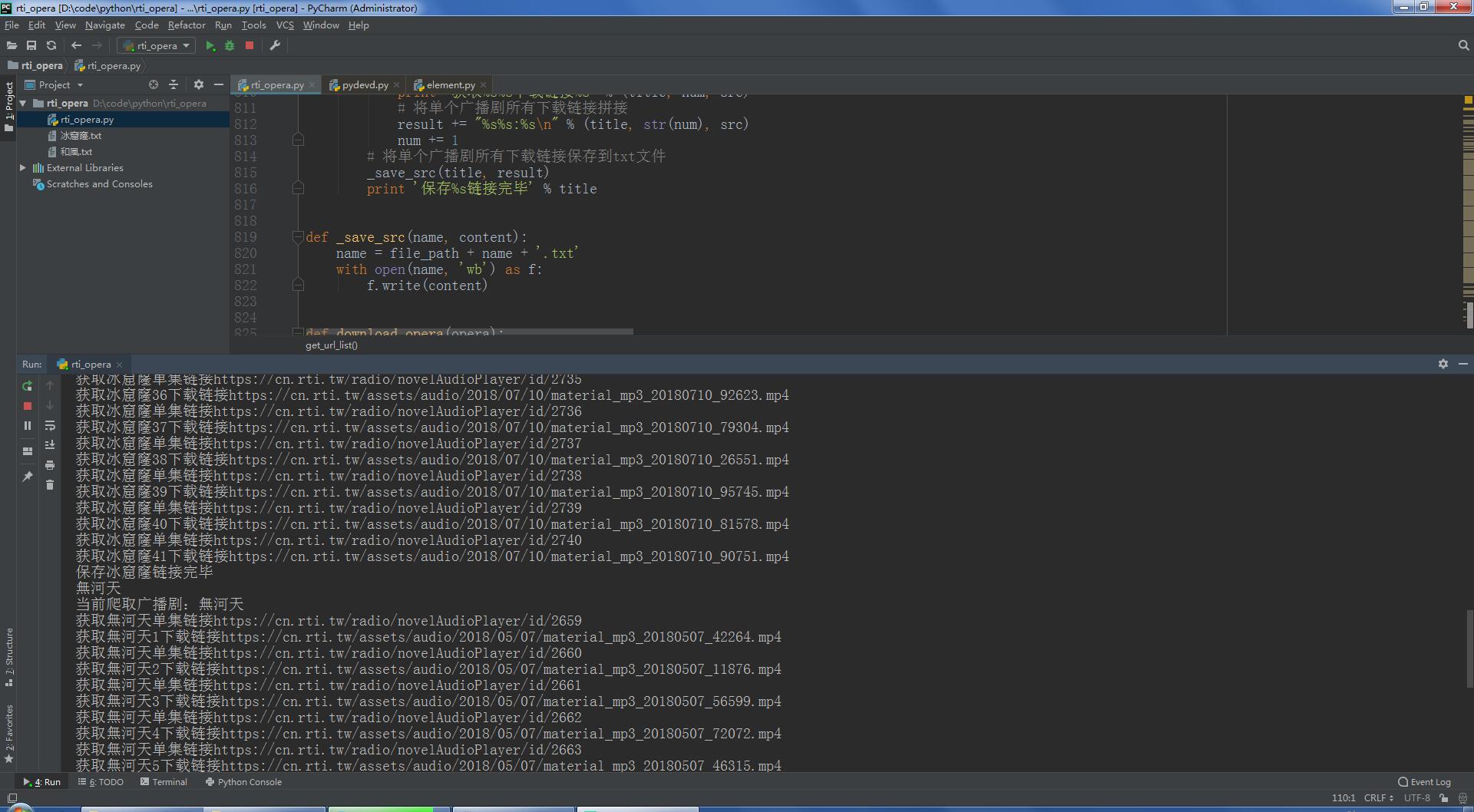

运行效果:

下载的MP4的代码:

# 使用requests的get方法访问下载链接

r = requests.get(url)

# 将访问返回二进制数据内容保存为MP4文件

with open(name, 'wb') as f:

f.write(r.content)

最终的运行结果:

源码地址:https://github.com/songzhenhua/rti_opera/blob/master/rti_opera.py

BeautifulSoup参考地址:

https://www.crummy.com/software/BeautifulSoup/bs4/doc/index.zh.html#attributes

http://www.cnblogs.com/zhaof/p/6930955.html

爬虫初体验:Python+Requests+BeautifulSoup抓取广播剧的更多相关文章

- python 爬虫(一) requests+BeautifulSoup 爬取简单网页代码示例

以前搞偷偷摸摸的事,不对,是搞爬虫都是用urllib,不过真的是很麻烦,下面就使用requests + BeautifulSoup 爬爬简单的网页. 详细介绍都在代码中注释了,大家可以参阅. # -* ...

- Python requests 多线程抓取 出现HTTPConnectionPool Max retires exceeded异常

https://segmentfault.com/q/1010000000517234 -- ::, - oracle - ERROR - data format error:HTTPConnecti ...

- Python爬虫之requests+正则表达式抓取猫眼电影top100以及瓜子二手网二手车信息(四)

requests+正则表达式抓取猫眼电影top100 一.首先我们先分析下网页结构 可以看到第一页的URL和第二页的URL的区别在于offset的值,第一页为0,第二页为10,以此类推. 二.< ...

- Python爬虫实战八之利用Selenium抓取淘宝匿名旺旺

更新 其实本文的初衷是为了获取淘宝的非匿名旺旺,在淘宝详情页的最下方有相关评论,含有非匿名旺旺号,快一年了淘宝都没有修复这个. 可就在今天,淘宝把所有的账号设置成了匿名显示,SO,获取非匿名旺旺号已经 ...

- 用python实现的抓取腾讯视频所有电影的爬虫

1. [代码]用python实现的抓取腾讯视频所有电影的爬虫 # -*- coding: utf-8 -*-# by awakenjoys. my site: www.dianying.atim ...

- python2.7 爬虫初体验爬取新浪国内新闻_20161130

python2.7 爬虫初学习 模块:BeautifulSoup requests 1.获取新浪国内新闻标题 2.获取新闻url 3.还没想好,想法是把第2步的url 获取到下载网页源代码 再去分析源 ...

- Python爬虫工程师必学——App数据抓取实战 ✌✌

Python爬虫工程师必学——App数据抓取实战 (一个人学习或许会很枯燥,但是寻找更多志同道合的朋友一起,学习将会变得更加有意义✌✌) 爬虫分为几大方向,WEB网页数据抓取.APP数据抓取.软件系统 ...

- Python爬虫工程师必学APP数据抓取实战✍✍✍

Python爬虫工程师必学APP数据抓取实战 整个课程都看完了,这个课程的分享可以往下看,下面有链接,之前做java开发也做了一些年头,也分享下自己看这个视频的感受,单论单个知识点课程本身没问题,大 ...

- Python爬虫工程师必学——App数据抓取实战

Python爬虫工程师必学 App数据抓取实战 整个课程都看完了,这个课程的分享可以往下看,下面有链接,之前做java开发也做了一些年头,也分享下自己看这个视频的感受,单论单个知识点课程本身没问题,大 ...

随机推荐

- Linux学习总结(七)-磁盘管理 du df fdisk

一 命令df df,即disk free,可用来查看当前系统的挂载情况,也可以用来查看整体磁盘的使用情况df 不带参数,默认以KB单位显示df -i -----查看inodes 使用情况,要清楚理解i ...

- 十三、IntelliJ IDEA 中的版本控制介绍(下)

我们已经简单了解了 IntelliJ IDEA 的版本控制机制,那么接下来,就让我们一起看看在 IntelliJ IDEA 中进行具体的版本控制操作. 标注1:Checkout from Versio ...

- nginx/apache连接数梳理

统计连接数,使用netstat命令或ss命令都可以1)统计连接数(80端口) [root@wang ~]# netstat -nat|grep -i "|wc -l 或者:netstat - ...

- sql中table用法

for c in (select column_value from table(f_split(V_FileID, ','))) loop --若没有填写资格开始结束时间,则填入 select co ...

- Cornerstone|SVN

SQLite-database disk image is malformed missing from working copy mac下CornerstoneSVN出错 Description _ ...

- 剑指Offer_编程题之从尾到头打印链表

题目描述 输入一个链表,从尾到头打印链表每个节点的值.

- Zabbix——设置模板

前提条件: Zabbix版本为4.0 可以正常使用Server 1. 添加H3C网络交换机的CPU和内存模板,并配置自动发现. 注意,需要添加完成后,重新进行搜索后再此进入才有下列选项. 添加CPU的 ...

- vue 样式渲染,添加删除元素

<template> <div> <ul> <li v-for="(item,index) in cartoon" :key=" ...

- js之广告

涉及到offset等有关获取各种尺寸问题下 <!doctype html> <html lang="en"> <head> <meta c ...

- 原生JS实现移动端的轮播效果

首先 我们想实现的效果是在手指按下拖动的时候图片能够跟随移动(无动画效果)然后松开手指后判断图片移动的位置 和某一个值进行比较 在这里我们默认定为盒子的1/3宽度 当x轴的移动位置大于1/3的时候图片 ...