准确率、精确率、召回率、F-Measure、ROC、AUC

先理解一下正类(Positive)和负类(Negetive),比如现在要预测用户是否点击了某个广告链接,点击了才是我们要的结果,这时,点击了则表示为正类,没点击则表示为负类。

TP(True Positive):被预测成了正类的正类,即正确预测的正类

FP(False Positive):被预测成了正类的负类

TN(True Negetive):被预测成了负类的负类,即正确预测的负类

FN(False Negetive):被预测成了负类的正类

一、准确率(Accuracy)

准确率跟正类负类没多大关系,表示在预测结果中,正确预测的数量 / 样本总数。

二、精确率(Precision)

在预测结果中,正确预测的正类数 / 预测为正类的数量 : TP / (TP+FP)

三、召回率(Recall)

在预测结果中,正确预测的正类数 / 原本即为正类的数量 : TP / (TP+FN)

四、F-Measure

用precision和recall两个指标不直观,索性把他们合并为一个变量——F-measure:Recall * Precision * 2 / (Recall + Precision)(越大越好,1为理想状态,此时precision为1,recall为1)

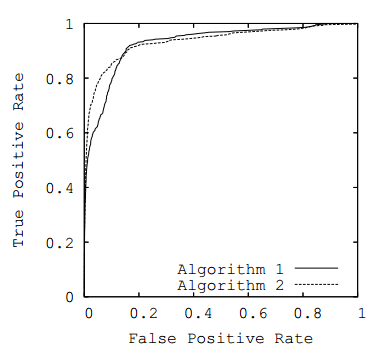

五、ROC

ROC曲线是以 FP Rate 为横轴,TP Rate 为纵轴的曲线。如下图所示

图片来源:https://www.cnblogs.com/haoguoeveryone/p/haoguo_5.html

六、AUC

AUC 即 ROC 曲线对应的面积,面积越大越好。

七、疑问

ROC曲线理想情况下,应该是TP Rate越接近1,FP Rate越接近0更好才对。但对应于AUC,应该是曲线越靠近左上方AUC越大,曲线越靠近右下方AUC越小。这样就显得有点矛盾了,有点搞不清楚,是不是曲线呈现下降趋势才是正确的?希望有大神看到了帮我一下,谢谢!感激不尽!

准确率、精确率、召回率、F-Measure、ROC、AUC的更多相关文章

- 准确率,召回率,F值,ROC,AUC

度量表 1.准确率 (presion) p=TPTP+FP 理解为你预测对的正例数占你预测正例总量的比率,假设实际有90个正例,10个负例,你预测80(75+,5-)个正例,20(15+,5-)个负例 ...

- 机器学习算法中的准确率(Precision)、召回率(Recall)、F值(F-Measure)

摘要: 数据挖掘.机器学习和推荐系统中的评测指标—准确率(Precision).召回率(Recall).F值(F-Measure)简介. 引言: 在机器学习.数据挖掘.推荐系统完成建模之后,需要对模型 ...

- 评估指标:准确率(Precision)、召回率(Recall)以及F值(F-Measure)

为了能够更好的评价IR系统的性能,IR有一套完整的评价体系,通过评价体系可以了解不同信息系统的优劣,不同检索模型的特点,不同因素对信息检索的影响,从而对信息检索进一步优化. 由于IR的目标是在较短时间 ...

- 推荐系统评测指标—准确率(Precision)、召回率(Recall)、F值(F-Measure)

下面简单列举几种常用的推荐系统评测指标: 1.准确率与召回率(Precision & Recall) 准确率和召回率是广泛用于信息检索和统计学分类领域的两个度量值,用来评价结果的质量.其中精度 ...

- 推荐系统评测指标--准确率(Precision)和召回率(Recall)、F值(F-Measure)

转自http://bookshadow.com/weblog/2014/06/10/precision-recall-f-measure/ 1,准确率和召回率是广泛应用于信息检索和统计学分类领域的两个 ...

- 准确率(Precision)、召回率(Recall)以及F值(F-Measure)

转载自:http://blog.csdn.net/yechaodechuntian/article/details/37394967 https://www.zhihu.com/question/19 ...

- 准确率(Accuracy), 精确率(Precision), 召回率(Recall)和F1-Measure

yu Code 15 Comments 机器学习(ML),自然语言处理(NLP),信息检索(IR)等领域,评估(Evaluation)是一个必要的 工作,而其评价指标往往有如下几点:准确率(Accu ...

- 信息检索(IR)的评价指标介绍 - 准确率、召回率、F1、mAP、ROC、AUC

原文地址:http://blog.csdn.net/pkueecser/article/details/8229166 在信息检索.分类体系中,有一系列的指标,搞清楚这些指标对于评价检索和分类性能非常 ...

- [机器学习] 性能评估指标(精确率、召回率、ROC、AUC)

混淆矩阵 介绍这些概念之前先来介绍一个概念:混淆矩阵(confusion matrix).对于 k 元分类,其实它就是一个k x k的表格,用来记录分类器的预测结果.对于常见的二元分类,它的混淆矩阵是 ...

- 一文让你彻底理解准确率,精准率,召回率,真正率,假正率,ROC/AUC

参考资料:https://zhuanlan.zhihu.com/p/46714763 ROC/AUC作为机器学习的评估指标非常重要,也是面试中经常出现的问题(80%都会问到).其实,理解它并不是非常难 ...

随机推荐

- Towards Universal Object Detection by Domain Attention

论文及代码 论文地址:https://arxiv.org/abs/1904.04402 代码:http://www.svcl.ucsd.edu/projects/universal-detection ...

- 2019-10-16,sudo提权漏洞(CVE-2019-14287)实现

sudo是linux系统命令,让普通账号以root身份执行某些命令,比如,安装软件,查看某些配置文件,关机,重启等,如果普通用户需要使用sudo需要修改配置文件,/etc/sudoers,将sudo使 ...

- windows安装Pytorch报错:from torch._C import * ImportError: DLL load failed: 找不到指定的模块”解决方案

问题描述 python环境下安装cpu版本pytorch,安装成功,但是导入出错. 报错如下 解决方法 参考博客,大家解决方法大概有:升级numpy.添加.dll文件到环境变量,均没有成功.本地pyt ...

- Git实战指南----跟着haibiscuit学Git(第一篇)

笔名: haibiscuit 博客园: https://www.cnblogs.com/haibiscuit/ Git地址: https://github.com/haibiscuit?tab=re ...

- Jeewx-Boot 1.1 版本发布,基于SpringBoot的开源微信管家系统

项目介绍 JeewxBoot是一款基于SpringBoot的开源微信管家系统,采用SpringBoot2.1.3 + Mybatis + Velocity 框架技术.支持微信公众号.微信第三方平台(扫 ...

- 简单聊一聊spring cloud stream和kafka的那点事

Spring Cloud Stream is a framework for building highly scalable event-driven microservices connected ...

- 09-kubernetes configMap secret

目录 配置容器化应用配置的方式 命令创建和测试configMap 创建一个Pod 挂在测试 命令行文件类创建方式 创建Pod测试 创建后测试 贴近实际进行测试 创建后测试 secret 举例测试 ge ...

- 英语口语考试资料Food

新东方推荐文章:Food and Health The food we eat seems to have profound effects on our health. Although scien ...

- SpringMVC Mock测试

什么是mock测试? 在测试过程中,对于某些不容易构成或者不容易获取的对象,用一个虚拟的对象来创建以便测试的测试方法,就是Mock测试. Servlet.Request.Response等Servle ...

- luogu P2946 [USACO09MAR]牛飞盘队Cow Frisbee Team

题目背景 老唐最近迷上了飞盘,约翰想和他一起玩,于是打算从他家的N头奶牛中选出一支队伍. 每只奶牛的能力为整数,第i头奶牛的能力为R i .飞盘队的队员数量不能少于 1.大于N.一 支队伍的总能力就是 ...