15.sqoop数据从mysql里面导入到HDFS里面

表数据

在mysql中有一个库userdb中三个表:emp, emp_add和emp_contact

表emp

|

id |

name |

deg |

salary |

dept |

|

1201 |

gopal |

manager |

50,000 |

TP |

|

1202 |

manisha |

Proof reader |

50,000 |

TP |

|

1203 |

khalil |

php dev |

30,000 |

AC |

|

1204 |

prasanth |

php dev |

30,000 |

AC |

|

1205 |

kranthi |

admin |

20,000 |

TP |

表emp_add:

|

id |

hno |

street |

city |

|

1201 |

288A |

vgiri |

jublee |

|

1202 |

108I |

aoc |

sec-bad |

|

1203 |

144Z |

pgutta |

hyd |

|

1204 |

78B |

old city |

sec-bad |

|

1205 |

720X |

hitec |

sec-bad |

表emp_conn:

|

id |

phno |

|

|

1201 |

2356742 |

gopal@tp.com |

|

1202 |

1661663 |

manisha@tp.com |

|

1203 |

8887776 |

khalil@ac.com |

|

1204 |

9988774 |

prasanth@ac.com |

|

1205 |

1231231 |

kranthi@tp.com |

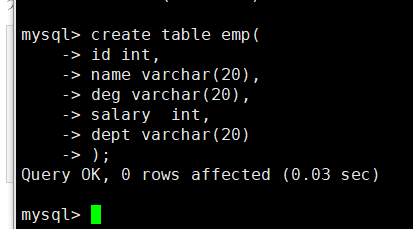

分别创建三个表

create table emp(

id int,

name varchar(),

deg varchar(),

salary int,

dept varchar()

);

导入数据

insert into emp values(,'gopal','manager',,'TP');

insert into emp values(,' manisha ',' Proof reader',,'TP');

insert into emp values(,' khalil','php dev',,'AC');

insert into emp values(,' prasanth',' php dev',,'AC');

insert into emp values(,' kranthi',' admin',,'TP');

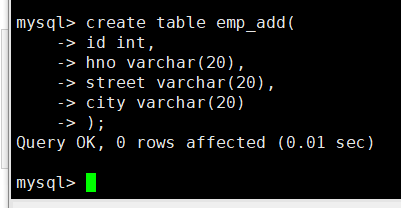

create table emp_add(

id int,

hno varchar(),

street varchar(),

city varchar()

);

导入数据

insert into emp_add values(,'288A','vgiri','jublee');

insert into emp_add values(,'','aoc','sec-bad');

insert into emp_add values(,'144Z','pguttai','hyd');

insert into emp_add values(,'78B','old city','sec-bad');

insert into emp_add values(,'720X','hitec','sec-bad');

create table emp_conn(

id int,

phno int,

email varchar()

);

导入数据

insert into emp_conn values(,'','gopal@tp.com');

insert into emp_conn values(,'','manisha@tp.com');

insert into emp_conn values(,'','khalil@ac.com');

insert into emp_conn values(,'','prasanth@ac.com');

insert into emp_conn values(,'','kranthi@tp.com');

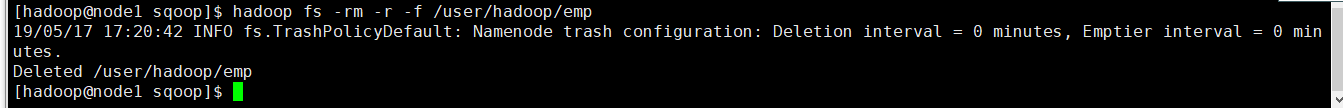

删除HDFS的目录

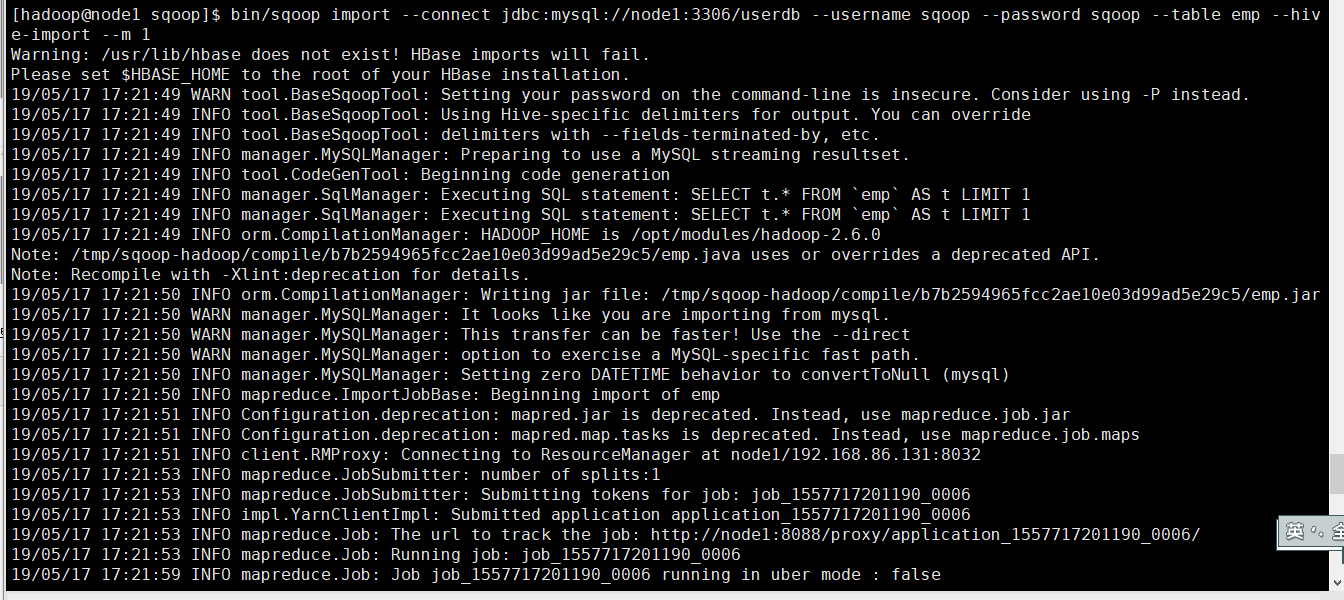

从MySQL数据库服务器中的emp表导入HDFS

bin/sqoop import \

--connect jdbc:mysql://node1:3306/userdb \

--username sqoop \

--password sqoop \

--table emp --m

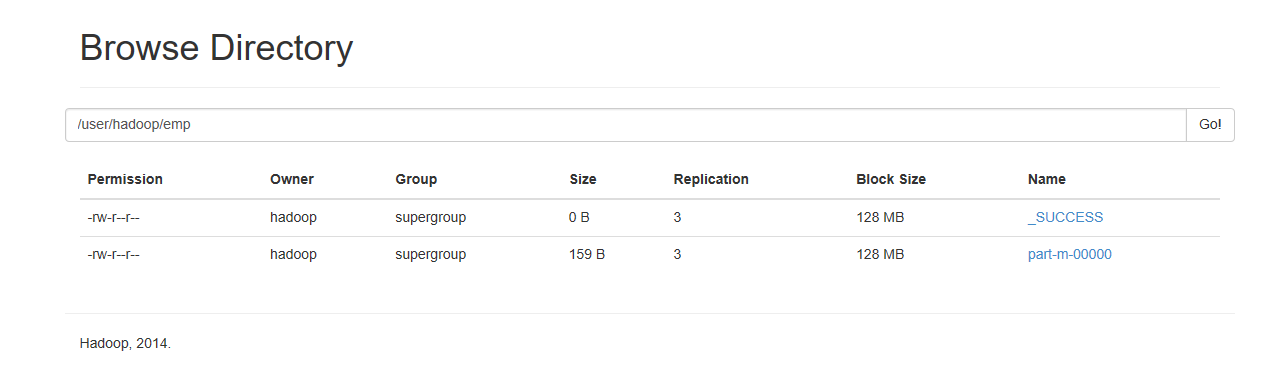

查看HDSF上的内容

接下来把Mysql的数据导入到Hive里面

先启动Hive

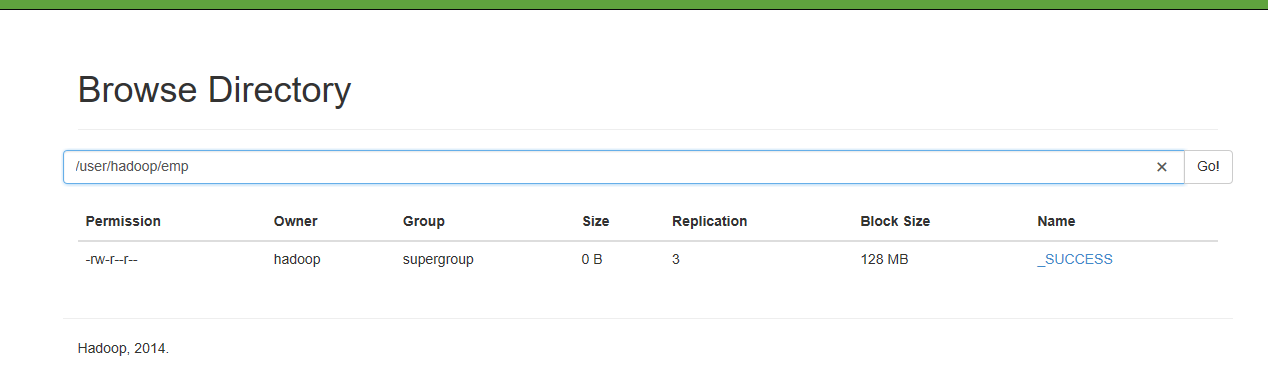

在导入之前先把HDFS的/user/hadoop/emp删除,因为Hive的数据是存放在HDFS上

导入到hive表里面

[hadoop@node1 sqoop]$ bin/sqoop import --connect jdbc:mysql://node1:3306/userdb --username sqoop --password sqoop --table emp --hive-import --m 1

查看HDFS文件

查看hive里面的表

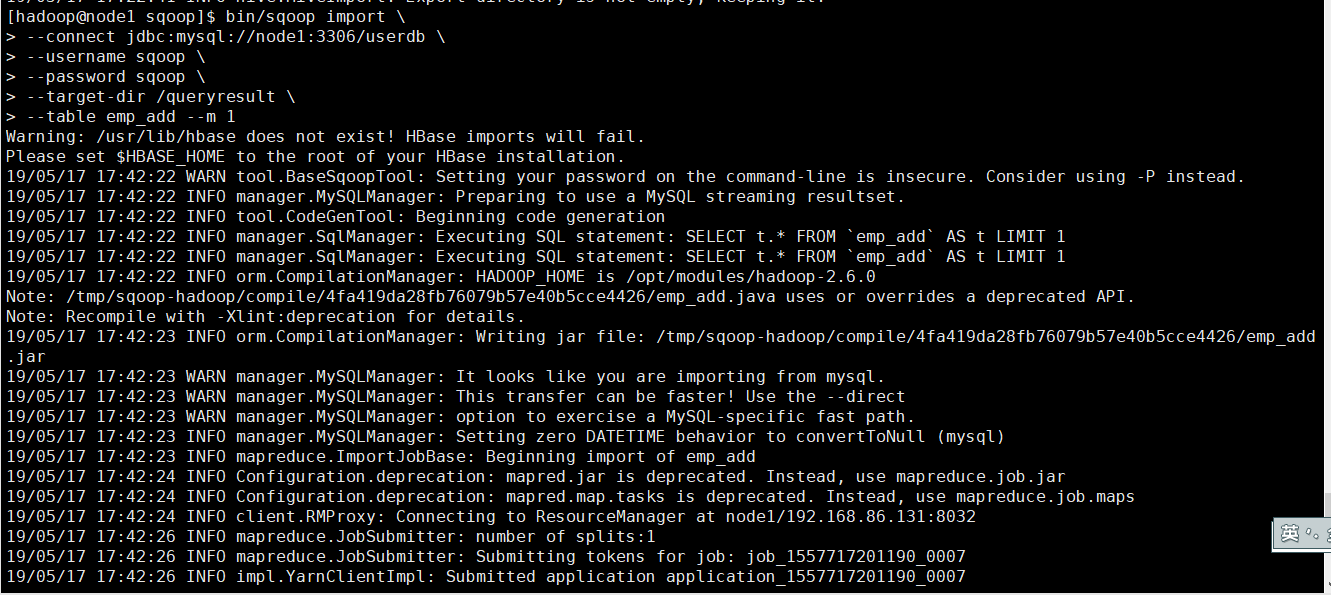

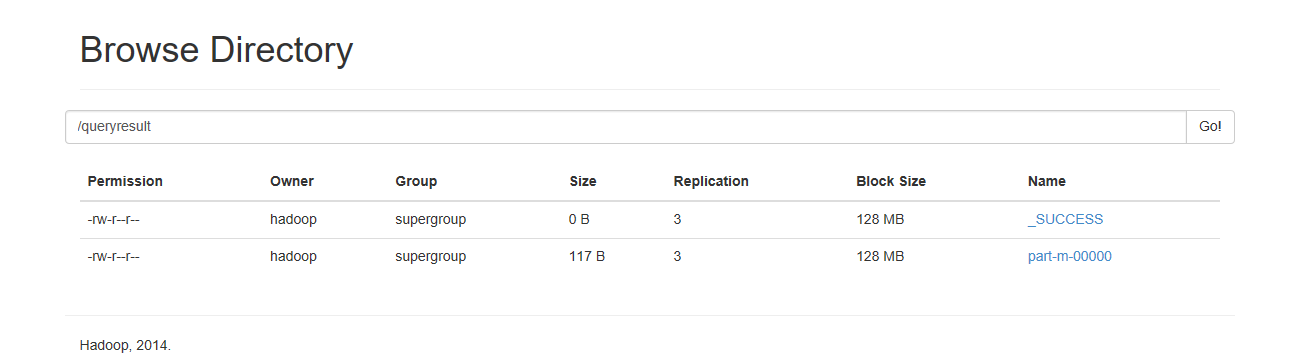

从mysql数据库中导入到HDFS中的指定目录

bin/sqoop import \

--connect jdbc:mysql://node1:3306/userdb \

--username sqoop \

--password sqoop \

--target-dir /queryresult \

--table emp_add --m

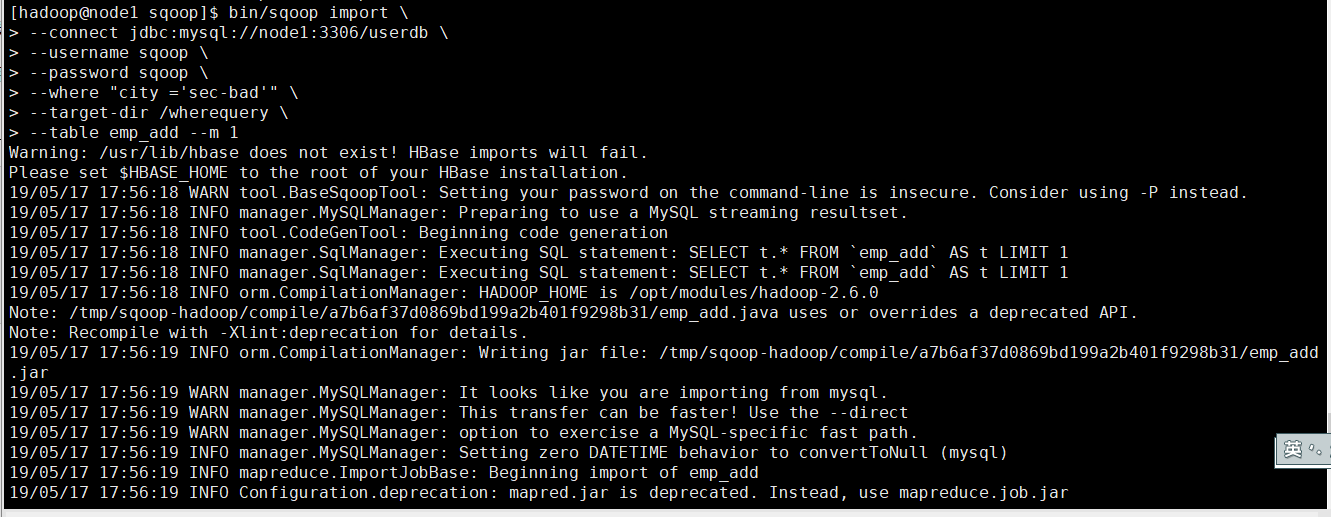

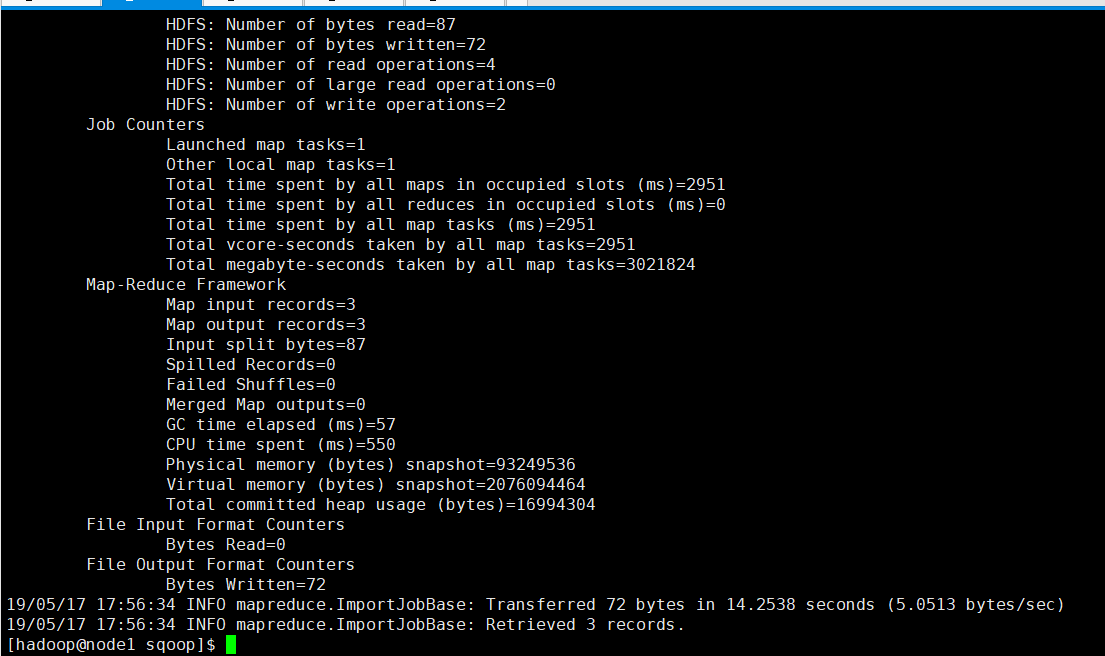

导入表数据子集

我们可以导入表的使用Sqoop导入工具,"where"子句的一个子集。它执行在各自的数据库服务器相应的SQL查询,并将结果存储在HDFS的目标目录。

下面的命令用来导入emp_add表数据的子集。子集查询检索员工ID和地址,居住城市为:Secunderabad

bin/sqoop import \

--connect jdbc:mysql://node1:3306/userdb \

--username sqoop \

--password sqoop \

--where "city ='sec-bad'" \

--target-dir /wherequery \

--table emp_add --m

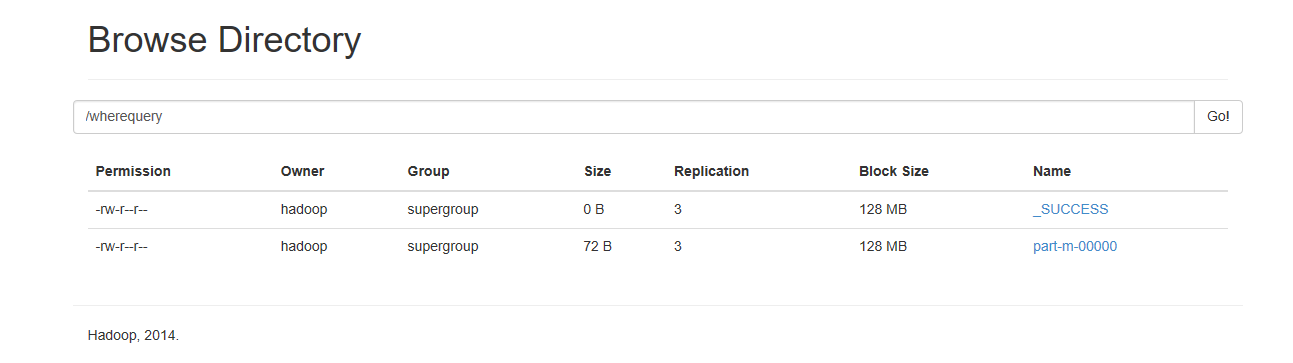

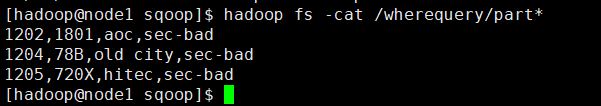

查看HDFS文件内容

15.sqoop数据从mysql里面导入到HDFS里面的更多相关文章

- 大数据之路week07--day07 (Sqoop 从mysql增量导入到HDFS)

我们之前导入的都是全量导入,一次性全部导入,但是实际开发并不是这样,例如web端进行用户注册,mysql就增加了一条数据,但是HDFS中的数据并没有进行更新,但是又再全部导入一次又完全没有必要. 所以 ...

- sqoop的使用之import导入到HDFS

原文链接: https://www.toutiao.com/i6772128429614563843/ 首先我们已经安装好sqoop了,如果没有安装好参考文档<快速搭建CDH-Hadoop-Hi ...

- Sqoop数据迁移工具的使用

文章作者:foochane 原文链接:https://foochane.cn/article/2019063001.html Sqoop数据迁移工具的使用 sqoop简单介绍 sqoop数据到HDF ...

- sqoop用法之mysql与hive数据导入导出

目录 一. Sqoop介绍 二. Mysql 数据导入到 Hive 三. Hive数据导入到Mysql 四. mysql数据增量导入hive 1. 基于递增列Append导入 1). 创建hive表 ...

- mysql数据与Hadoop之间导入导出之Sqoop实例

前面介绍了sqoop1.4.6的 如何将mysql数据导入Hadoop之Sqoop安装,下面就介绍两者间的数据互通的简单使用命令. 显示mysql数据库的信息,一般sqoop安装测试用 sqoop l ...

- sqoop:mysql和Hbase/Hive/Hdfs之间相互导入数据

1.安装sqoop 请参考http://www.cnblogs.com/Richardzhu/p/3322635.html 增加了SQOOP_HOME相关环境变量:source ~/.bashrc ...

- sqoop从hive导入数据到mysql时出现主键冲突

今天在将一个hive数仓表导出到mysql数据库时出现进度条一直维持在95%一段时间后提示失败的情况,搞了好久才解决.使用的环境是HUE中的Oozie的workflow任何调用sqoop命令,该死的o ...

- 利用sqoop将hive数据导入导出数据到mysql

一.导入导出数据库常用命令语句 1)列出mysql数据库中的所有数据库命令 # sqoop list-databases --connect jdbc:mysql://localhost:3306 ...

- 使用 sqoop 将mysql数据导入到hdfs(import)

Sqoop 将mysql 数据导入到hdfs(import) 1.创建mysql表 CREATE TABLE `sqoop_test` ( `id` ) DEFAULT NULL, `name` va ...

随机推荐

- 1、创建MFC应用程序——单个文档

文件——新建——项目——MFC应用程序 运行即可. [菜单栏单击事件] 视图——其他窗口——资源视图,双击Menu中的IDR_MAINFRAM,打开菜单栏.在主菜单栏输入“显示你好”. “显示你好”处 ...

- 编码问题2 utf-8和Unicode的区别

utf-8和Unicode到底有什么区别?是存储方式不同?编码方式不同?它们看起来似乎很相似,但是实际上他们并不是同一个层次的概念 要想先讲清楚他们的区别,首先应该讲讲Unicode的来由. 众所周知 ...

- PHP mysqli_fetch_field() 函数

返回结果集中下一字段(列),然后输出每个字段名称.表格和最大长度: <?php // 假定数据库用户名:root,密码:123456,数据库:RUNOOB $con=mysqli_connect ...

- topcoder13444

CountTables TopCoder - 13444 sol:题意和题解都丢在上面了,自己XJByy了一下 先保证行不同,然后对列容斥,dp[i]表示i列的答案 行不同时i列的答案显然是C(c^i ...

- codeforces555E

Case of Computer Network CodeForces - 555E Andrewid the Android is a galaxy-known detective. Now he ...

- Python实用黑科技——以某个字段进行分组

需求: 当前有个字典实例,你想以某个字段比如”日期”对整个字典里面的元素进行分组. 方法: itertools.groupby()函数是专门用来干这个活的.请看下面这个例子,这里有一个列表构成的字典, ...

- Python3 Address already in use 解决方法

1.查看使用端口号netstat -ntlp 2.根据端口号找到pid 3.杀死程序 kill -9 pid 4.重新启动程序 简单粗暴 我使用python3时编写Socket,linux系统下使用c ...

- input输入框只能输入数字和英文逗号

<input type="text" onkeyup="this.value=this.value.replace(/[^\d\,]/g,'')"> ...

- Nginx之进程间的通信机制(共享内存、原子操作)

1. 概述 Linux 提供了多种进程间传递消息的方式,如共享内存.套接字.管道.消息队列.信号等,而 Nginx 框架使用了 3 种传递消息的传递方式:共享内存.套接字.信号. 在进程间访问共享资源 ...

- CentOS 7服务器下Nginx安装配置

一.安装编译工具及库文件 $ yum -y install make zlib zlib-devel gcc gcc-c++ libtool openssl openssl-devel pcre pc ...