ELK收集日志到mysql数据库

场景需求

在使用ELK对日志进行收集的时候,如果需要对数据进行存档,可以考虑使用数据库的方式。为了便于查询,可以同时写一份数据到Elasticsearch 中。

环境准备

CentOS7系统:

- 192.168.20.60 node1 Kibana ES Logstash Nginx

- 192.168.20.61 node2 ES MariaDB

这里使用收集Nginx日志到数据库和ES中作为示例。

配置数据库

安装好数据库后,配置,并授权:

MariaDB [(none)]> create database elk character set utf8 collate utf8_bin;

Query OK, 1 row affected (0.00 sec)

MariaDB [(none)]> grant all privileges on elk.* to elk@'192.168.20.%' identified by '123456';

Query OK, 0 rows affected (0.00 sec)

MariaDB [(none)]> flush privileges;

Query OK, 0 rows affected (0.00 sec)

在node1上测试数据库的连接:

[root@node1 ~]# yum install mariadb -y

[root@node1 ~]# mysql -uelk -p123456 -h 192.168.20.61在node1上安装Logstash, 可以直接从官方下载rpm包安装,Elasticsearch和Kibana的安装跳过,可参考Kibana使用Nginx代理验证和ELK日志管理平台部署简介的前半部分,这里不再赘述。

[root@node1 ~]# yum install logstash-5.6.5.rpm -y

[root@node1 ~]# systemctl start logstash配置JDBC数据库驱动

按装logstash的数据库驱动需要先安装gem源:

[root@node1 ~]# yum install gem -y

[root@node1 ~]# gem -v

2.0.14.1

[root@node1 ~]# gem sources --add https://gems.ruby-china.org/ --remove https://rubygems.org/

https://gems.ruby-china.org/ added to sources

https://rubygems.org/ removed from sources

[root@node1 ~]# gem source list

*** CURRENT SOURCES ***

https://gems.ruby-china.org/查看当前已经安装的插件:

[root@node1 ~]# /usr/share/logstash/bin/logstash-plugin list安装JDBC驱动:

[root@node1 ~]# /usr/share/logstash/bin/logstash-plugin install logstash-output-jdbc

Validating logstash-output-jdbc

Installing logstash-output-jdbc

Installation successful安装需要等待一段时间,查看是否安装成功:

[root@node1 ~]# /usr/share/logstash/bin/logstash-plugin list|grep jdbc

logstash-input-jdbc

logstash-output-jdbc下载数据库的JDBC驱动:https://dev.mysql.com/downloads/connector/j/ 上传到服务器。驱动的路径必须严格一致,否则连接数据库会报错。

[root@node1 ~]# tar xf mysql-connector-java-5.1.45.tar.gz

[root@node1 ~]# cd mysql-connector-java-5.1.45

[root@node1 mysql-connector-java-5.1.45]# mkdir -p /usr/share/logstash/vendor/jar/jdbc

[root@node1 mysql-connector-java-5.1.45]# cp mysql-connector-java-5.1.45-bin.jar /usr/share/logstash/vendor/jar/jdbc/

[root@node1 ~]# chown -R logstash.logstash /usr/share/logstash/vendor/jar/jdbc/配置Nginx日志格式

要使日志以指定的表中字段的方式存储,需要将Nginx的日志格式改写为json格式,修改nginx.conf问,将日志格式配置部分替换为:

log_format access_log_json '{"host":"$http_x_real_ip","client_ip":"$remote_addr","log_time":"$time_iso8601","request":"$request","status":"$status","body_bytes_sent":"$body_bytes_sent","req_time":"$request_time","AgentVersion":"$http_user_agent"}';

access_log /var/log/nginx/access.log access_log_json;检查语法,并重新加载nginx:

nginx -t

nginx -s reload查看日志中新日志的格式是否是json格式。

创建数据表

我们在数据库中存储数据的时候,没有必要存储日志的所有内容,只需存储我们需要的重要信息即可,可以根据自身的需求进行取舍。

注意:数据表中需要创建time字段,time的默认值设置为CURRENT_TIMESTAMP.

创建数据表语句(只获取部分数据):

MariaDB [elk]> create table nginx_log(host varchar(128),client_ip varchar(128),status int(4),req_time float(8,3),AgentVersion varchar(512), time TIMESTAMP NOT NULL DEFAULT CURRENT_TIMESTAMP) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin;查看表结构:

MariaDB [elk]> desc nginx_log;

+-------------+--------------+------+-----+-------------------+-------+

| Field | Type | Null | Key | Default | Extra |

+-------------+--------------+------+-----+-------------------+-------+

| host | varchar(128) | YES | | NULL | |

| client_ip | varchar(128) | YES | | NULL | |

| status | int(4) | YES | | NULL | |

| req_time | float(8,3) | YES | | NULL | |

| AgentVersion | varchar(512) | YES | | NULL | |

| time | timestamp | NO | | CURRENT_TIMESTAMP | |

+-------------+--------------+------+-----+-------------------+-------+

6 rows in set (0.00 sec)配置Logstash将日志写入数据库

创建Logstash的配置文件:

[root@node1 ~]# vim /etc/logstash/conf.d/nginx_log.conf

[root@node1 ~]# cat /etc/logstash/conf.d/nginx_log.conf

input{

file{

path => "/var/log/nginx/access.log" # 指定文件

start_position => "beginning" # 从开始收集

stat_interval => "2" # 间隔时间为2s

codec => "json" # 使用json格式

}

}

output{

elasticsearch {

hosts => ["192.168.20.60:9200"]

index => "nginx-log-%{+YYYY.MM.dd}"

}

jdbc{

connection_string => "jdbc:mysql://192.168.20.61/elk?user=elk&password=123456&useUnicode=true&characterEncoding=UTF8"

statement => ["insert into nginx_log(host,client_ip,status,req_time,AgentVersion) VALUES(?,?,?,?,?)", "host","client_ip","status","req_time","AgentVersion"]

}

}测试文件,查看是否正确:

[root@node1 ~]# /usr/share/logstash/bin/logstash -f /etc/logstash/conf.d/nginx_log.conf -t

WARNING: Could not find logstash.yml which is typically located in $LS_HOME/config or /etc/logstash. You can specify the path using --path.settings. Continuing using the defaults

Could not find log4j2 configuration at path /usr/share/logstash/config/log4j2.properties. Using default config which logs errors to the console

Configuration OK如果发现配置文件正确,但是日志无法收集,可以使用前台启动的方式,查看日志信息:

[root@node1 ~]# /usr/share/logstash/bin/logstash -f /etc/logstash/conf.d/nginx_log.conf 提示: 如果是使用root操作,使用前台启动的方式也就是以root用户启动,使用系统systemd启动使用的是logstash用户,如果前台启动正常,而后台启动无法收集日志,一般是目录或者文件权限问题。

重启logstash,访问nginx生成日志,并查看Elasticsearch是否已经收集日志:

[root@node1 ~]# systemctl restart logstashES中已经自动创建的数据信息:

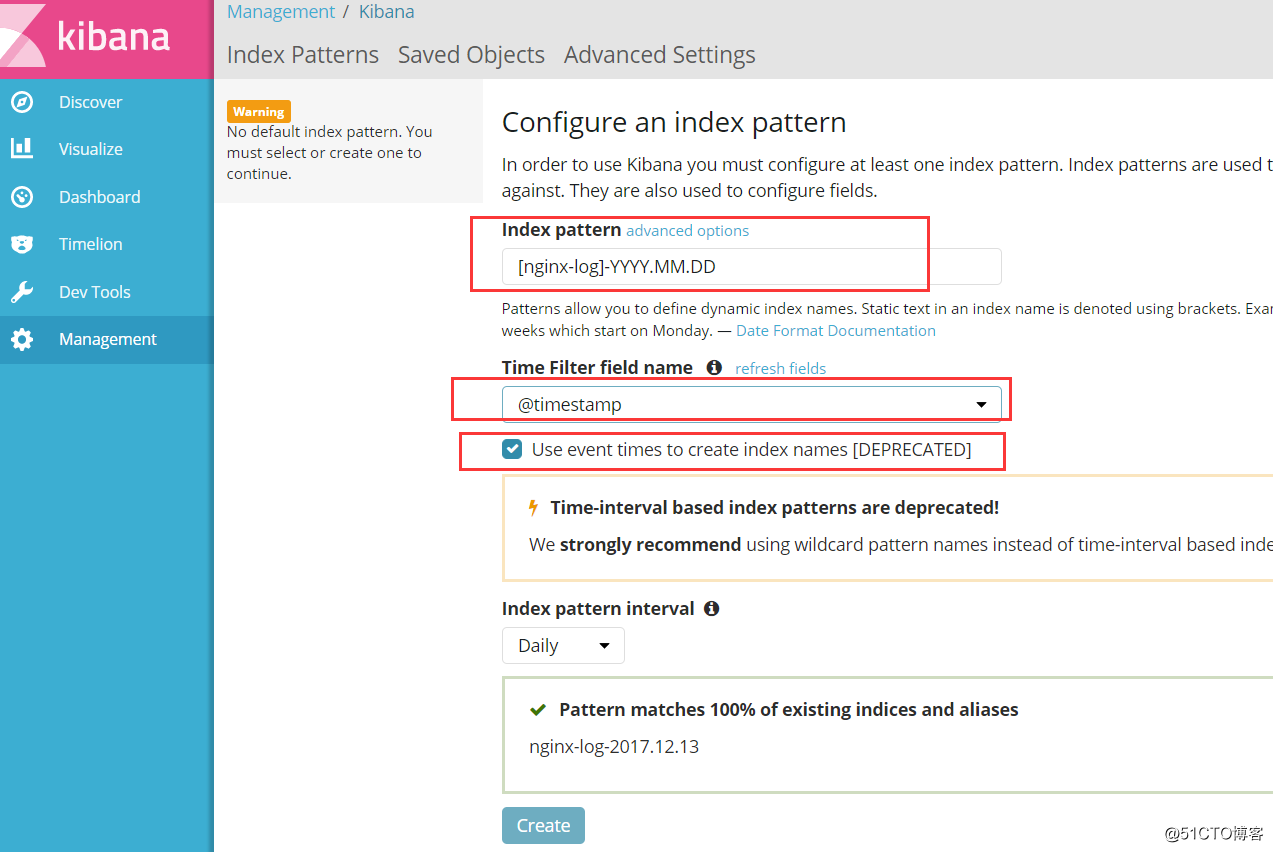

在Kibana中添加日志信息,用于展示,在输入名称之后,选择使用时间戳的方式,会自动检索出对应的信息:

当Kibana上有数据展示后,我们可以查看数据库,发现数据库中已经存储了日志信息:

[root@node2 elasticsearch-head]# mysql -uroot -p123456 -e "select * from elk.nginx_log;"|head -10

host client_ip status req_time AgentVersion time

- 192.168.20.191 304 0.023 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:33:39

- 192.168.20.191 200 0.042 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:33:39

- 192.168.20.191 200 0.030 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:33:39

- 192.168.20.191 200 0.042 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:34:33

- 192.168.20.191 200 0.380 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:34:33

- 192.168.20.191 200 0.195 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:34:37

- 192.168.20.191 200 0.034 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:34:45

- 192.168.20.191 200 0.016 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:34:59

- 192.168.20.191 200 0.570 Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 2017-12-18 11:35:00

将Nginx 日志收集到数据库中就完成了。

如果在收集日志的时候,出现数据库中没有数据,或者有些字段的数据无法获取,故障排除的思路是:

1、查看nginx的日志文件格式是否为json格式,日志输出是否正常。

2、查看es 或者kibana上的日志是否完整,展示是否正常。

3、查看logstash的conf配置文件是否正常,字段标注的个数,名称有无对应上。

4、测试配置文件,刷新日志,如果kibana上展示正常,一般是logstash配置文件没有对应上字段,或者数据库权限问题。

ELK收集日志到mysql数据库的更多相关文章

- ELK之收集日志到mysql数据库

写入数据库的目的是持久化保存重要数据,比如状态码.客户端浏览器版本等,用于后期按月做数据统计等. 环境准备 linux-elk1:10.0.0.22,Kibana ES Logstash Nginx ...

- ELK收集日志到mysql

场景需求 在使用ELK对日志进行收集的时候,如果需要对数据进行存档,可以考虑使用数据库的方式.为了便于查询,可以同时写一份数据到Elasticsearch 中. 环境准备 CentOS7系统: 192 ...

- .net core 中使用Log4net输出日志到Mysql数据库中

.net core 中使用Log4net输出日志到数据库中去 1.使用Nuget安装log4net 和 mysql.data 2.设置log4net 的配置文件 log4net.config 可以设置 ...

- 今天搞log4net插入错误日志去mysql数据库的时候出现了点问题,已解决。记录下解决方案

先上图 配置log4net的时候要填这项,可是这个value我不知道啊.....上图里的value是我用下面的方法获取的 MySqlConnection con = new MySqlConnecti ...

- spring boot使用log4j2将日志写入mysql数据库

log4j2官方例子在spring boot中报错而且还是用的是org.apache.commons.dbcp包 我给改了一下使用org.apache.commons.dbcp2包 1.log4j2. ...

- Mysql数据库之Binlog日志使用总结

binlog二进制日志对于mysql数据库的重要性有多大,在此就不多说了.下面根据本人的日常操作经历,并结合网上参考资料,对binlog日志使用做一梳理: 一.binlog日志介绍1)什么是binlo ...

- ELK收集Nginx自定义日志格式输出

1.ELK收集日志的有两种常用的方式: 1.1:不修改源日志格式,简单的说就是在logstash中转通过 grok方式进行过滤处理,将原始无规则的日志转换为规则日志(Logstash自定义日志格式) ...

- (转)Mysql数据库之Binlog日志使用总结

使用mysqlbinlog提取二进制日志 原文:http://blog.csdn.net/leshami/article/details/41962243 MySQL binlog日志记录了MySQL ...

- 烂泥:通过binlog恢复mysql数据库

本文由秀依林枫提供友情赞助,首发于烂泥行天下. 在上一篇文章,我们讲解了有关mysql的binlog日志的基础知识.这篇文章,我们来讲解如何通过mysql的binlog日志来恢复数据库. 在使用bin ...

随机推荐

- Jenkins中管道案例脚本(生命式语法)

pipeline { agent any parameters { choice( choices: 'feature\nmaster\npercent10', description: '选择要发布 ...

- Vulnhub DC-7靶机渗透

信息搜集 nmap -sP 192.168.146.0/24 #主机发现 nmap -A 192.168.146.144 #端口扫描 查看robots.txt,看看admin,403,其他没有什么可利 ...

- 2017蓝桥杯算式900(C++C组)

题目:算式900 小明的作业本上有道思考题: 看下面的算式: (□□□□-□□□□)*□□=900 其中的小方块代表0~9的数字,这10个方块刚好包含了0~9中的所有数字. 注意:0不能作为某 ...

- 第一章 AT&T

1.一个公司(企业)越庞大,就越危险:越复杂,就越濒临坍塌:快速发展的同时,也埋下了隐患. 2.再庞大的企业也不可能永久站立,下个十年谁也说不准谁会在浪潮之巅. 3.一个人能走多远,往往取决于他能看多 ...

- C#使用HTML文件中的file文件上传,用C#代码接收上传文件

单独做图片上传很简单,如果要客户端要上传头像保存到服务器就要稍微麻烦一点点了. 不多说了,直接上源码: private void Upload() { string jsonInfo = string ...

- 【Selenium01篇】python+selenium实现Web自动化:搭建环境,Selenium原理,定位元素以及浏览器常规操作!

一.前言 最近问我自动化的人确实有点多,个人突发奇想:想从0开始讲解python+selenium实现Web自动化测试,请关注博客持续更新! 二.话不多说,直接开干,开始搭建自动化测试环境 这里以前在 ...

- 【高并发】高并发环境下如何优化Tomcat配置?看完我懂了!

写在前面 Tomcat作为最常用的Java Web服务器,随着并发量越来越高,Tomcat的性能会急剧下降,那有没有什么方法来优化Tomcat在高并发环境下的性能呢? Tomcat运行模式 Tomca ...

- Tomcat启动过程原理详解 -- 非常的报错:涉及了2个web.xml等文件的加载流程

Tomcat启动过程原理详解 发表于: Tomcat, Web Server, 旧文存档 | 作者: 谋万世全局者 标签: Tomcat,原理,启动过程,详解 基于Java的Web 应用程序是 ser ...

- 数据结构和算法(Golang实现)(26)查找算法-哈希表

哈希表:散列查找 一.线性查找 我们要通过一个键key来查找相应的值value.有一种最简单的方式,就是将键值对存放在链表里,然后遍历链表来查找是否存在key,存在则更新键对应的值,不存在则将键值对链 ...

- linux基础知识点扫描

1.tty:查看自己的虚拟终端 2.echo "你的服务器已经被我控制,请立刻打钱给我,账号12312312312314123421,否则后果自负!!!" > /dev/ ...