sklearn参数优化

学习器模型中一般有两个参数:一类参数可以从数据中学习估计得到,还有一类参数无法从数据中估计,只能靠人的经验进行指定,后一类参数就叫超参数

比如,支持向量机里的C,Kernel,gama,朴素贝叶斯里的alpha等,在学习其模型的设计中,我们要搜索超参数空间为学习器模型找到最合理的超参数,可以通过以下方法获得学习器模型的参数列表和当前取值:estimator.get_params()

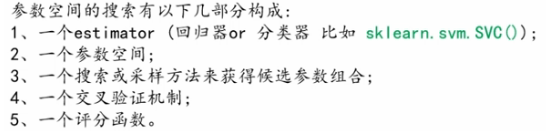

sklearn 提供了两种通用的参数优化方法:网络搜索和随机采样,

- 网格搜索交叉验证(GridSearchCV):以穷举的方式遍历所有可能的参数组合

- 随机采样交叉验证(RandomizedSearchCV):依据某种分布对参数空间采样,随机的得到一些候选参数组合方案

sklearn.model_selection:GridSearchCV,RandomizedSearchCV,ParameterGrid,ParameterSampler,fit_grid_point

①GridSearchCV:

该方法提供了在参数网格上穷举候选参数组合的方法。参数网格由参数param_grid来指定,比如,下面展示了设置网格参数param_grid的一个例子:

param_grid=[

{'C':[1,10,100,1000],'kernel':['linear']},

{'C':[1,10,100,1000],'gamma':[0.001,0.0001],'kernel':['rbf']}

]

上面的参数指定了要搜索的两个网格(每个网格就是一个字典):第一个里面有4个参数组合节点,第二个里面有4*2=8个参数组合节点

GridSearchCV的实例实现了通用的estimator API:当在数据集上训练的时候,所有可能的参数组合将会被评估,训练完成后选组最优的参数组合对应的estimator。

from sklearn import svm,datasets

from sklearn.model_selection import GridSearchCV iris=datasets.load_iris()

parameters={'kernel':('rbf','linear'),'C':[1,5,10]}

svr=svm.SVC()

clf=GridSearchCV(svr,parameters)

clf.fit(iris.data,iris.target)

print(clf.best_estimator_)

最终结果:

SVC(C=1, cache_size=200, class_weight=None, coef0=0.0,

decision_function_shape=None, degree=3, gamma='auto', kernel='linear',

max_iter=-1, probability=False, random_state=None, shrinking=True,

tol=0.001, verbose=False)

②RandomizedSearchCV

RandomizedSearchCV类实现了在参数空间上进行随机搜索的机制,其中参数的取值是从某种概率分布中抽取的,这个概率分布描述了对应的参数的所有取值情况的可能性,这种随机采样机制与网格穷举搜索相比,有两大优点:

- 相比于整体参数空间,可以选择相对较少的参数组合数量

- 添加参数节点不影响性能,不会降低效率

指定参数的采样范围和分布可以用一个字典开完成,跟网格搜索很像,另外,计算预算(总共要采样多少参数组合或者迭代做多少次)可以用参数n_iter来指定,针对每一个参数,既可以使用可能取值范围内的概率分布,也可以指定一个离散的取值列表(离散的列表将被均匀采样)

{'C':scpiy.stats.expon(scale=100),'gamma':scipy.stats.expon(scale=.1),'kernel':['rbf'],'class_weight':['balanced':None]}

上边的例子中:C服从指数分布,gamma服从指数分布,这个例子使用了scipy.stats模块,其中包含了很多有用的分布用来产生参数采样点,像expon,gamma,uniform or randint,原则上,任何函数都可以传递进去,只要他提供一个rvs(random variate sample)方法来返回采样值,rvs函数的连续调用应该能够保证产生独立同分布的样本值。

import numpy as np

from time import time

from scipy.stats import randint as sp_randint

from sklearn.model_selection import RandomizedSearchCV

from sklearn.datasets import load_digits

from sklearn.ensemble import RandomForestClassifier def report(results,n_top=3):

for i in range(1,n_top+1):

candidates=np.flatnonzero(results['rank_test_score']==i)

for candidate in candidates:

print("Model with rank:{0}".format(i))

print("Mean validation score:{0:.3f}(std:{1:.3f})".format(

results['mean_test_score'][candidate],

results['std_test_score'][candidate]))

print("Parameters:{0}".format(results['params'][candidate]))

print("") digis=load_digits()

X,y=digis.data,digis.target clf=RandomForestClassifier(n_estimators=20)

#设置想要优化的超参数以及他们的取值分布

param_dist={"max_depth":[3,None],

"max_features":sp_randint(1,11),

"min_samples_split":sp_randint(2,11),

"min_samples_leaf":sp_randint(1,11),

"bootstrap":[True,False],

"criterion":['gini','entropy']

}

#开启超参数空间的随机搜索

n_iter_search=20

random_search=RandomizedSearchCV(clf,param_distributions=param_dist,n_iter=n_iter_search)

start=time()

random_search.fit(X,y)

print("RandomizedSearchCV took %.3f seconds for %d candidates"

"parameter settings."%((time()-start),n_iter_search))

report(random_search.cv_results_)

最终结果:

RandomizedSearchCV took 3.652 seconds for 20 candidatesparameter settings.

Model with rank:1

Mean validation score:0.930(std:0.019)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'entropy', 'max_features': 8, 'bootstrap': False, 'min_samples_split': 10} Model with rank:2

Mean validation score:0.928(std:0.009)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'gini', 'max_features': 4, 'bootstrap': False, 'min_samples_split': 10} Model with rank:3

Mean validation score:0.924(std:0.009)

Parameters:{'max_depth': None, 'min_samples_leaf': 1, 'criterion': 'gini', 'max_features': 9, 'bootstrap': True, 'min_samples_split': 5}

③超参数优化中的随机搜索和网格搜索对比试验以随机森林分类器为优化对象。所有影响分类器学习的参数都被搜索了,除了树的数量之外,随机搜索和网格优化都在同一个超参数空间上对随机森林分类器进行优化,虽然得到的超参数设置组合比较相似,但是随机搜索的运行时间却比网络搜索显著的少,随机搜索得到的超参数组合的性能稍微差一点,但这很大程度上由噪声引起的,在实践中,我们只能挑几个比较重要的参数组合来进行优化。

import numpy as np

from time import time

from scipy.stats import randint as sp_randint

from sklearn.model_selection import RandomizedSearchCV

from sklearn.model_selection import GridSearchCV

from sklearn.datasets import load_digits

from sklearn.ensemble import RandomForestClassifier def report(results,n_top=3):

for i in range(1,n_top+1):

candidates=np.flatnonzero(results['rank_test_score']==i)

for candidate in candidates:

print("Model with rank:{0}".format(i))

print("Mean validation score:{0:.3f}(std:{1:.3f})".format(

results['mean_test_score'][candidate],

results['std_test_score'][candidate]))

print("Parameters:{0}".format(results['params'][candidate]))

print("") digis=load_digits()

X,y=digis.data,digis.target clf=RandomForestClassifier(n_estimators=20) print("==========下面是RandomizedSearchCV的测试结果===============")

#设置想要优化的超参数以及他们的取值分布

param_dist={"max_depth":[3,None],

"max_features":sp_randint(1,11),

"min_samples_split":sp_randint(2,11),

"min_samples_leaf":sp_randint(1,11),

"bootstrap":[True,False],

"criterion":['gini','entropy']

}

#开启超参数空间的随机搜索

n_iter_search=20

random_search=RandomizedSearchCV(clf,param_distributions=param_dist,n_iter=n_iter_search)

start=time()

random_search.fit(X,y)

print("RandomizedSearchCV took %.3f seconds for %d candidates"

"parameter settings."%((time()-start),n_iter_search))

report(random_search.cv_results_) print("==========下面是GridSearchCV的测试结果===============")

#在所有参数上搜索,找遍所有网络节点

param_grid={"max_depth":[3,None],

"max_features":[1,3,10],

"min_samples_split":[2,3,10],

"min_samples_leaf":[1,3,10],

"bootstrap":[True,False],

"criterion":['gini','entropy']

}

#开启超参数空间的网格搜索

grid_search=GridSearchCV(clf,param_grid=param_grid)

start=time()

grid_search.fit(X,y)

print("GridSearchCV took %.2f seconds for %d candidates parameter settings."

%(time()-start,len(grid_search.cv_results_['params'])))

report(random_search.cv_results_)

最终结果:

==========下面是RandomizedSearchCV的测试结果===============

RandomizedSearchCV took 3.874 seconds for 20 candidatesparameter settings.

Model with rank:1

Mean validation score:0.928(std:0.010)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'entropy', 'max_features': 10, 'bootstrap': False, 'min_samples_split': 2} Model with rank:2

Mean validation score:0.920(std:0.007)

Parameters:{'max_depth': None, 'min_samples_leaf': 4, 'criterion': 'gini', 'max_features': 6, 'bootstrap': False, 'min_samples_split': 2} Model with rank:2

Mean validation score:0.920(std:0.009)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'entropy', 'max_features': 7, 'bootstrap': True, 'min_samples_split': 10} ==========下面是GridSearchCV的测试结果===============

GridSearchCV took 37.64 seconds for 216 candidates parameter settings.

Model with rank:1

Mean validation score:0.928(std:0.010)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'entropy', 'max_features': 10, 'bootstrap': False, 'min_samples_split': 2} Model with rank:2

Mean validation score:0.920(std:0.007)

Parameters:{'max_depth': None, 'min_samples_leaf': 4, 'criterion': 'gini', 'max_features': 6, 'bootstrap': False, 'min_samples_split': 2} Model with rank:2

Mean validation score:0.920(std:0.009)

Parameters:{'max_depth': None, 'min_samples_leaf': 2, 'criterion': 'entropy', 'max_features': 7, 'bootstrap': True, 'min_samples_split': 10}

超参数空间的搜索技巧

- 技巧一,指定一个合适的目标测度对模型进行估计

默认情况下,参数搜索使用estimator的score函数来评估模型在某种参数配置下的性能:

分类器对应于 sklearn.metrics.accuracy_score

回归器对应于sklearn.metrics.r2_score

但是在某些应用中,其他的评分函数获取更加的合适。(比如在非平衡的分类问题中,准确率sccuracy_score通常不管用。这时,可以通过参数scoring来指定GridSearchCV类或者RandomizedSearchCV类内 部用我们自定义的评分函数)

- 技巧二、使用SKlearn的PipeLine将estimators和他们的参数空间组合起来

- 技巧三、合理划分数据集:开发集(用于GridSearchCV)+测试集(Test)使用model_selection.train_test_split()函数来搞定!

- 技巧四、并行化:(GridSearchCV)和(RandomizedSearchCV)在参数节点的计算上可以做到并行计算,这个通过参数”n_jobs“来指定。

- 技巧五、提高在某些参数节点上发生错误时的鲁棒性:在出错节点上只是提示警告。可以通过设置参数error_score=0(or=np.NaN)来搞定!

sklearn参数优化的更多相关文章

- 《转》sklearn参数优化方法

sklearn参数优化方法 http://www.cnblogs.com/nolonely/p/7007961.html 学习器模型中一般有两个参数:一类参数可以从数据中学习估计得到,还有一类参 ...

- sklearn参数优化方法

学习器模型中一般有两个参数:一类参数可以从数据中学习估计得到,还有一类参数无法从数据中估计,只能靠人的经验进行指定,后一类参数就叫超参数 比如,支持向量机里的C,Kernel,gama,朴素贝叶斯里的 ...

- 参数优化-API

网格搜索 对给定参数进行组合,用某标准进行评价,只适合小数据集 class sklearn.model_selection.GridSearchCV(estimator, param_grid, sc ...

- 吴裕雄 python 机器学习——模型选择参数优化暴力搜索寻优GridSearchCV模型

import scipy from sklearn.datasets import load_digits from sklearn.metrics import classification_rep ...

- 吴裕雄 python 机器学习——模型选择参数优化随机搜索寻优RandomizedSearchCV模型

import scipy from sklearn.datasets import load_digits from sklearn.metrics import classification_rep ...

- linux下TCP/IP及内核参数优化调优(转)

Linux下TCP/IP及内核参数优化有多种方式,参数配置得当可以大大提高系统的性能,也可以根据特定场景进行专门的优化,如TIME_WAIT过高,DDOS攻击等等. 如下配置是写在sysctl.con ...

- Windows下tcp参数优化

Windows系统下的TCP参数优化2013-04-25 0 个评论 作者:最初的幸福ever收藏 我要投稿Windows系统下的TCP参数优化 TCP连接的状态与关闭方 ...

- paper 62:高斯混合模型(GMM)参数优化及实现

高斯混合模型(GMM)参数优化及实现 (< xmlnamespace prefix ="st1" ns ="urn:schemas-microsoft-com:of ...

- MySQL配置文件my.cnf参数优化和中文详解

Mysql参数优化对于新手来讲,是比较难懂的东西,其实这个参数优化,是个很复杂的东西,对于不同的网站,及其在线量,访问量,帖子数量,网络情况,以及机器硬件配置都有关系,优化不可能一次性完成,需要不断的 ...

随机推荐

- 关于提BUG的一点思考以及工作中总结的规范

在测试的工作中,提BUG是日常工作. 以前自己为了省事,省时,仅仅是截图,在图片上注明一下问题,就放到BUG库中了. 现在发现这样会造成开发的时间的浪费,增加了沟通成本. 对于BUG,当发现了异常时, ...

- PHP简单读取XML

DOM document object model,文档对象模型,就是树形结构 节点的分类 元素节点 属性节点 值节点 注释节点 根节点(document才是根节点) 生成XML文档 xml的根节点为 ...

- CodeForces1249E-By Elevator or Stairs?-好理解自己想不出来的dp

Input The first line of the input contains two integers nn and cc (2≤n≤2⋅105,1≤c≤10002≤n≤2⋅105,1≤c≤1 ...

- PHP对象在内存中的分配(转载)

http://www.cnblogs.com/hongfei/archive/2012/06/12/2547120.html 对像在PHP 里面和整型.浮点型一样,也是一种数据类,都是存储不同类型数据 ...

- 百度编译器ueditor目录创建失败问题解决

修改ueditor编辑器的文件Uploader.class.php 例如: vim protected/widget/ueditor/php/Uploader.class.php :283 if( ...

- leetcode.字符串.696计数二进制子串-java

1. 具体题目 给定一个字符串 s,计算具有相同数量0和1的非空(连续)子字符串的数量,并且这些子字符串中的所有0和所有1都是组合在一起的.重复出现的子串要计算它们出现的次数. 示例 1 : 输入: ...

- 使用ProxyBroker构建代理池

import asyncio from proxybroker import Broker async def show(proxies): while True: proxy = await pro ...

- 用redis实现悲观锁(后端语言以php为例)

1479 锁机制 通常使用的锁分为乐观锁,悲观锁这两种,简单介绍下这两种锁,作为本文的背景知识,对这类知识已经有足够了解的同学可以跳过这部分. 乐观锁 先来看下百度百科上的解释:大多是基于数据版本( ...

- Linux 网络 tcp C/S通信模型

C/S模型就是server 与 client 的模型 TCP服务器模型流程图 ...

- 笔记51 Mybatis快速入门(二)

Mybatis的CRUD 1.修改配置文件Category.xml,提供CRUD对应的sql语句. <?xml version="1.0" encoding="UT ...