【图文教程】Centos 7下安装Hadoop

环境说明:

系统:Centos7 在VM中安装的

hadoop版本:2.7.7

JDK:1.8

注意:Hadoop需要Java环境的。记得安装Java环境

PS:Centos JDK安装

mkdir /data

1:上传jdk的tar.解压

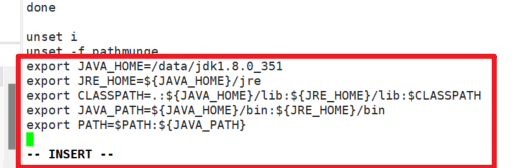

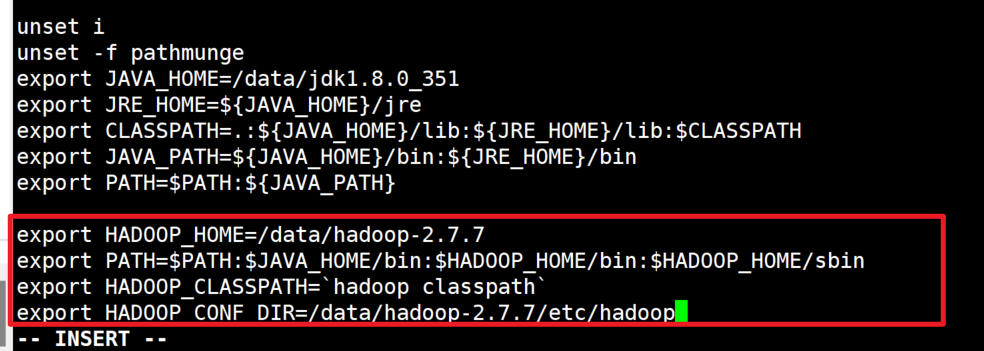

2:修改/etc/proflie,把Javahome环境变量配置上:

记住:在修改前,先备份

在文件最后添加:

export JAVA_HOME=/data/jdk1.8.0_351

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib:$CLASSPATH

export JAVA_PATH=${JAVA_HOME}/bin:${JRE_HOME}/bin

export PATH=$PATH:${JAVA_PATH}

说明:/data/jdk1.8.0_351 修改成你自己的

如下图:

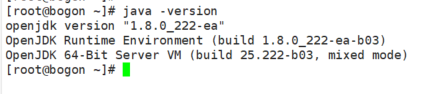

添加完成后,使用 source /etc/profile 使其生效。

查看Java版本:

开始安装:

一:下载安装包:

1.1: 安装包下载地址 https://repo.huaweicloud.com/apache/hadoop/common/hadoop-2.7.7/hadoop-2.7.7.tar.gz

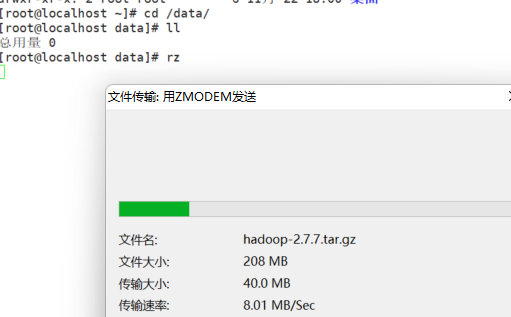

1.2:上传并解压

mkdir /data

在Xshell中可以使用rz命令进行上传

解压:

cd /data

tar -zxvf hadoop-2.7.7.tar.gz

二:hadoop配置

声明:下文中踢掉的,hadoop的安装目录:

比如凯哥的安装目录,就是第一步上传到/data后解压的。所以hadoop安装目录就是:/data/hadoop-2.7.7 这个别搞错了

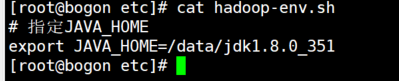

2.1:修改hadoop安装目录 /etc/hadoop 下的 hadoop-env.sh的内容

cd /data/hadoop-2.7.7/etc/hadoop/

注意:是hadoop的安装目录:

比如凯哥的安装目录,就是第一步上传到/data后解压的。所以hadoop安装目录就是:/data/hadoop-2.7.7 这个别搞错了

vi hadoop-env.sh

输入Javahome的配置

# 指定JAVA_HOME

export JAVA_HOME=/data/jdk1.8.0_351

2.2:修改hadoop安装目录 /etc/hadoop 下的

vi core-site.xml

输入下面:

主要:<configuration> 这个标签。后面第3步和第4步,同样需要注意。

<configuration>

<!-- 指定HDFS老大(namenode)的通信地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.50.135:9002</value>

</property>

<!-- 指定hadoop运行时产生文件的存储路径 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/data/hadoop/tmp</value>

</property>

</configuration>

需要主要,将hdfs的ip修改成你自己物理机的ip.

我们发现,在配置hadoop运行时候文件存储路径为/data/hadoop 如果没有这个目录,需要创建

注:这里fs.defaultFS的value最好是写本机的静态IP。当然写本机主机名,再配置hosts是最好的,如果用localhost,然后在windows用java操作hdfs的时候,会连接不上主机。

2.3:修改 hadoop安装目录/etc/hadoop下的hdf-site.xml的内容

vi hdfs-site.xml

输入:

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>/data/hadoop/hadoop/hdfs/nn</value>

</property>

<property>

<name>fs.checkpoint.dir</name>

<value>/data/hadoop/hdfs/snn</value>

</property>

<property>

<name>fs.checkpoint.edits.dir</name>

<value>/data/hadoop/hdfs/snn</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/data/hadoop/hdfs/dn</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>/data/hadoop/name</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>/data/hadoop/node</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.http.address</name>

<value>192.168.50.135:9000</value>

</property>

<property>

<name>ipc.maximum.data.length</name>

<value>134217728</value>

</property>

</configuration>

同样需要注意的是将ip修改成自己服务器的真实ip

2.4:修改 hadoop安装目录下的/etc/hadoop 下的yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.application.classpath</name>

<value>

/data/hadoop-2.7.7/etc/*,

/data/hadoop-2.7.7/etc/hadoop/*,

/data/hadoop-2.7.7/lib/*,

/data/hadoop-2.7.7/share/hadoop/common/*,

/data/hadoop-2.7.7/share/hadoop/common/lib/*,

/data/hadoop-2.7.7/share/hadoop/mapreduce/*,

/data/hadoop-2.7.7/share/hadoop/mapreduce/lib/*,

/data/hadoop-2.7.7/share/hadoop/hdfs/*,

/data/hadoop-2.7.7/share/hadoop/hdfs/lib/*,

/data/hadoop-2.7.7/share/hadoop/yarn/*,

/data/hadoop-2.7.7/share/hadoop/yarn/lib/*

</value>

</property>

</configuration>

三:将Hadoop配置到环境变量中:

在 /etc/profile中配置

export HADOOP_HOME=/data/hadoop-2.7.7

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

export HADOOP_CLASSPATH=`hadoop classpath`

export HADOOP_CONF_DIR=/data/hadoop-2.7.7/etc/hadoop

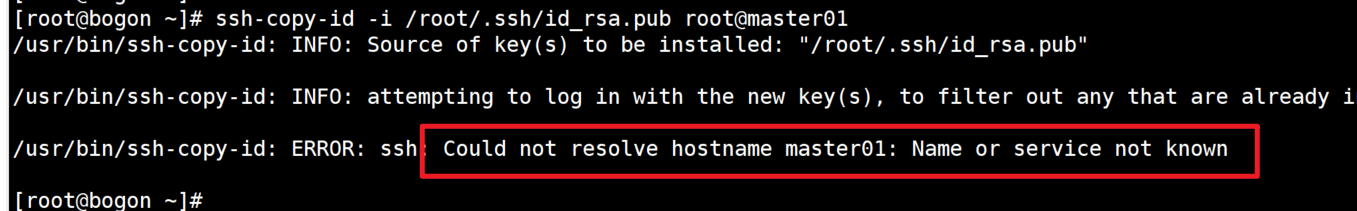

4:配置hosts

可能会用到。如下错误时候修改:

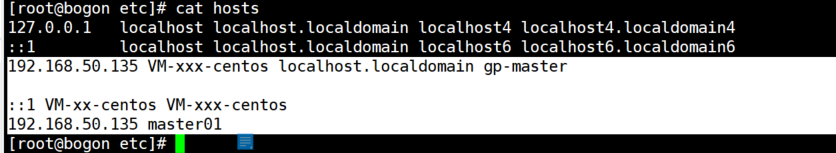

修改hosts:

在/etc/hosts。同样需要注意,修改前,记得备份下。

192.168.50.135 VM-xxx-centos localhost.localdomain gp-master

::1 VM-xx-centos VM-xxx-centos

192.168.50.135 master01

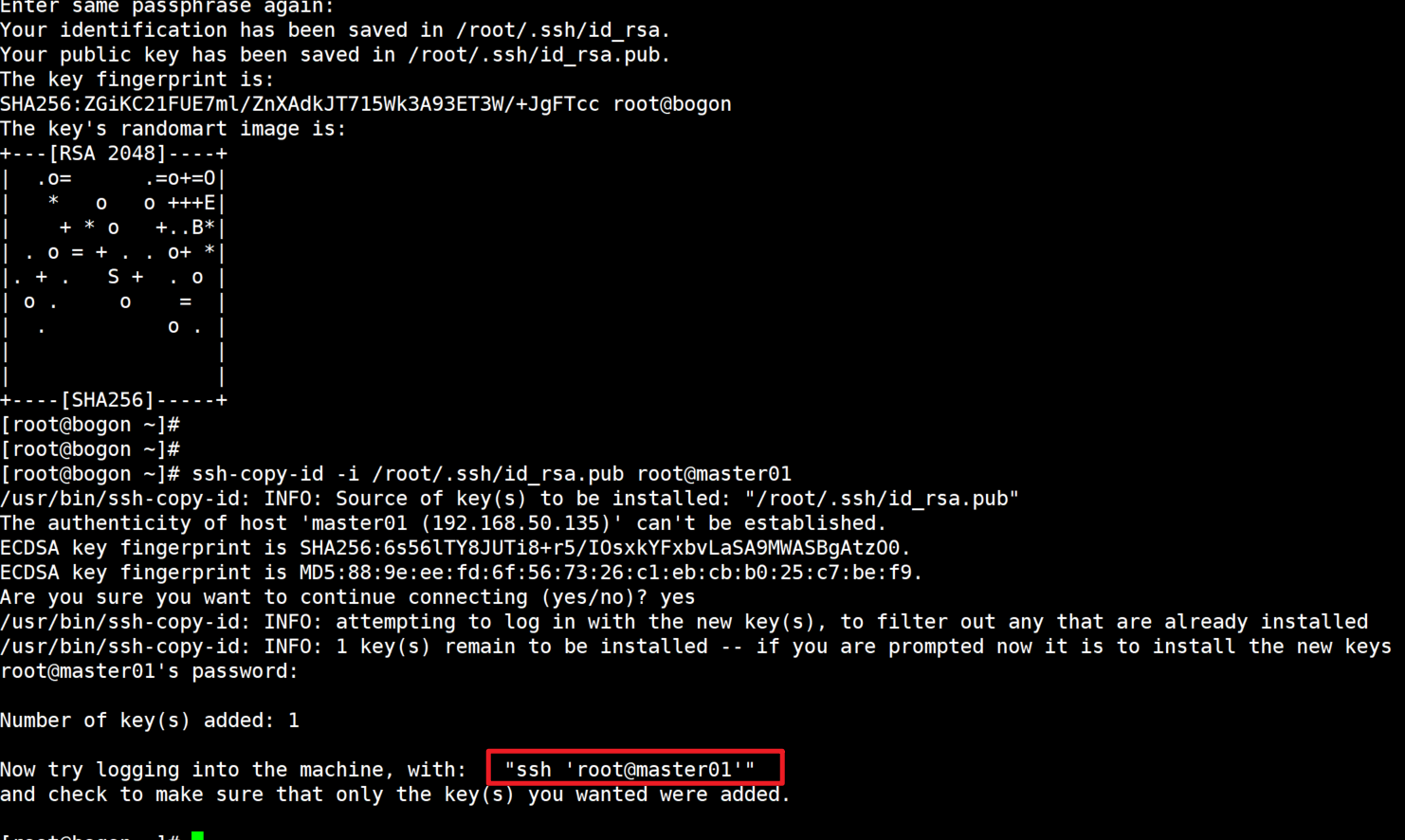

5:制作证书,免登陆配置

切换到root下

cd /root

接着:

#执行生成密钥命令:

ssh-keygen -t rsa

#然后三个回车

继续:

ssh-copy-id -i /root/.ssh/id_rsa.pub root@master01

选择yes

输入登录第一台节点的密码(操作完成该节点公钥复制到第一台节点中)

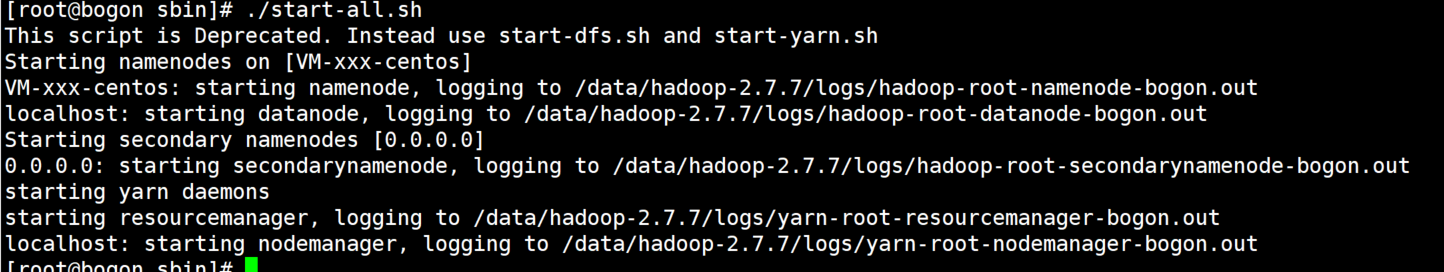

6:启动

进入到hadoop安装目录/sbin下,执行start-all.sh命令

./start-all.sh

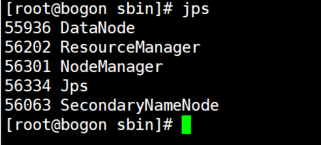

使用jps命令验证是否已经启动成功(这些都启动了才算成功:ResourceManager、DataNode、SecondaryNameNode、NodeManager、TaskManagerRunner、YarnTaskExecutorRunner、NameNode):

jps

【图文教程】Centos 7下安装Hadoop的更多相关文章

- CentOS下安装hadoop

CentOS下安装hadoop 用户配置 添加用户 adduser hadoop passwd hadoop 权限配置 chmod u+w /etc/sudoers vi /etc/sudoers 在 ...

- CentOS 7 下安装 LEMP 服务(nginx、MariaDB/MySQL 和 php)

原文 CentOS 7 下安装 LEMP 服务(nginx.MariaDB/MySQL 和 php) LEMP 组合包是一款日益流行的网站服务组合软件包,在许多生产环境中的核心网站服务上起着强有力的作 ...

- CentOS linux下安装和配置Apache+SVN(用浏览器http方式访问SVN目录)

在CentOS linux下安装SVN,我们可以进行以下步骤: 第一步:安装CentOS Linux操作系统,并在CentOS安装进行的同时,自定义安装这一步,一定要勾选Subversion(在“开发 ...

- CentOS 6 下安装Python 3

可以下载各个版本的python:https://www.python.org/ftp/python/ 配置安装 下载最新的安装包(截止2013/11/05),还是3.3.2版本. #wget http ...

- [Android Studio 权威教程]Windows下安装Android Studio

从AS 0.5版本号開始使用.也是AS的推行者,在ApkBus公布的第一篇Android Studio Perview 2 获得了50K的浏览,1800多条回复下载. 在我的[Android Stud ...

- Linux(CentOS)系统下安装好apache(httpd)服务后,其他电脑无法访问的原因

原文:Linux(CentOS)系统下安装好apache(httpd)服务后,其他电脑无法访问的原因 今天试了下在虚拟机上利用CentOS系统的yum命令安装好了httpd(apache2.4.6), ...

- CentOS 7下安装vertica记录

CentOS 7下安装vertica记录 1. 安装好centeros 并更新 Centeros安装就不说了,安装完之后联网环境下 yum update.更新下,使得那些包都是新的.(要想用中文 ...

- CentOS系统下安装python3+Django

转载:CentOS系统下安装python3+Django 1.首先用yum安装下vim,因为CentOS 7可能根本没自带完整vim,经常出现输入乱码:yum -y install vim 2.安装开 ...

- CentOS 7下安装Python3.6

CentOS 7下安装Python3.6.4 CentOS 7下安装Python3.5 •安装python3.6可能使用的依赖 yum install openssl-devel bzip2-de ...

- CentOS 7下安装Python3.6.4

CentOS 7下安装Python3.5 •安装python3.6可能使用的依赖 yum install openssl-devel bzip2-devel expat-devel gdbm-deve ...

随机推荐

- 动手学深度学习——CNN应用demo

CNN应用demo CNN实现简单的手写数字识别 import torch import torch.nn.functional as F from torchvision import datase ...

- 《从零开始学习Python爬虫:顶点小说全网爬取实战》

顶点小说 装xpath helper GitHub - mic1on/xpath-helper-plus: 这是一个xpath开发者的工具,可以帮助开发者快速的定位网页元素. Question:加载完 ...

- 2. C++的编译/链接模型

C++的编译/链接模型 简单的加工模型 问题:无法处理大型程序 加工耗时较长 即使少量修改,也需要重新加工 解决方案:分块处理 好处 编译消耗资源,但一次处理输入较少 链接程序较多,但处理速度较快 便 ...

- 产品探秘:智影AI——你的创意视频制作神器!

只需3步,把小说变成视频.免费试用,首次注册赠送600积分. https://icomicai.com/ 在这个快节奏的时代,创意与效率并重成为了我们追求的新风尚.今天,就让我带你一起揭秘一款颠覆传统 ...

- PositiveSmallIntegerField、SmallIntegerField和IntegerField

当您在Django中定义模型时,有几种不同的整数字段类型可供选择,包括PositiveSmallIntegerField.SmallIntegerField和IntegerField.以下是这三种整数 ...

- Raid0创建

实验步骤 步骤1: 确认硬盘 确认你的硬盘设备名. [root@servera ~]# lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT sda 8:0 0 ...

- oeasy教您玩转vim - 48 - # ed由来

范围控制 回忆上节课内容 我们这次研究了mark的定义和使用 mb定义 'b跳转 可以对marks,查询删除 三种marks 小写 本文件内 大写 跨文件 数字 配置文件中 甚至可以在行编辑中,使 ...

- 深入浅出分析最近火热的Mem0个性化AI记忆层

最近Mem0横空出世,官方称之为PA的记忆层,The memory layer for Personalized AI,有好事者还称这个是RAG的替代者,Mem0究竟为何物,背后的原理是什么,我们今天 ...

- css3实现背景三角形样式

话不多说上效果图: css: font-family: PingFang-SC-Heavy, PingFang-SC; font-weight: 800; color: #2160AD; border ...

- freemarker+minio实现页面静态化

什么是页面静态化? 将原本动态生成的网页内容通过某种形式转化为html并存储在服务器上,当用户请求这些页面时就不需要执行逻辑运算和数据库读 优点: 性能:提高页面加载速度和响应速度,还可以减轻数据库. ...