SparkSQL学习进度9-SQL实战案例

Spark SQL 基本操作

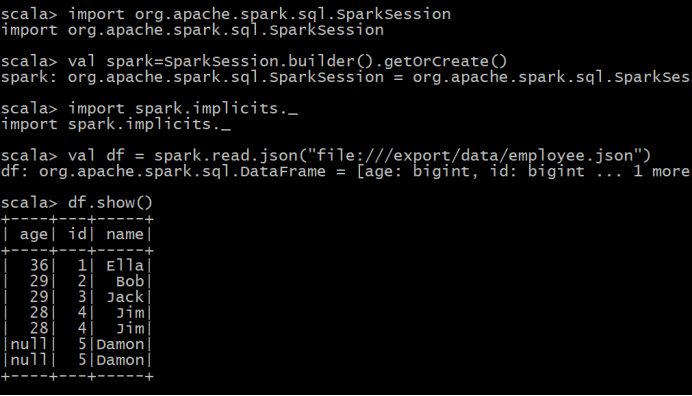

将下列 JSON 格式数据复制到 Linux 系统中,并保存命名为 employee.json。

{ "id":1 , "name":" Ella" , "age":36 }

{ "id":2, "name":"Bob","age":29 }

{ "id":3 , "name":"Jack","age":29 }

{ "id":4 , "name":"Jim","age":28 }

{ "id":4 , "name":"Jim","age":28 }

{ "id":5 , "name":"Damon" }

{ "id":5 , "name":"Damon" }

为 employee.json 创建 DataFrame,并写出 Scala 语句完成下列操作:

(1) 查询所有数据;

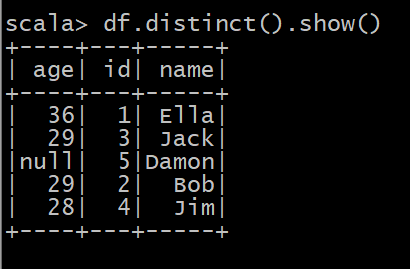

(2) 查询所有数据,并去除重复的数据;

(3) 查询所有数据,打印时去除 id 字段;

(4) 筛选出 age>30 的记录;

(5) 将数据按 age 分组;

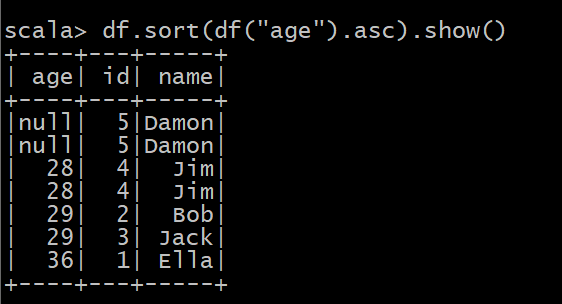

(6) 将数据按 name 升序排列;

(7) 取出前 3 行数据;

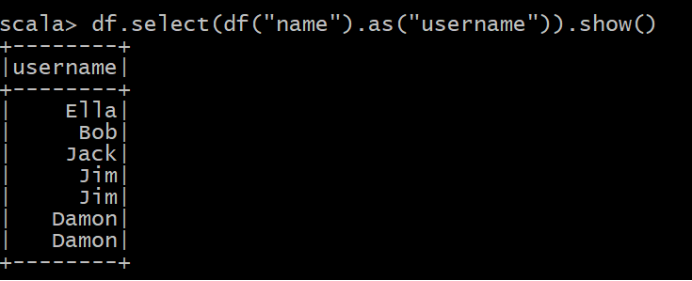

(8) 查询所有记录的 name 列,并为其取别名为 username;

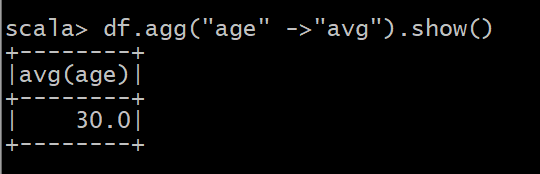

(9) 查询年龄 age 的平均值;

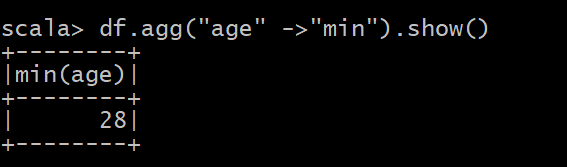

(10) 查询年龄 age 的最小值。

编程实现将 RDD 转换为 DataFrame

源文件内容如下(包含 id,name,age):

1,Ella,36

2,Bob,29

3,Jack,29

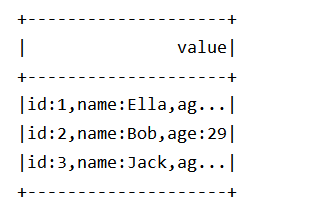

请将数据复制保存到 Linux 系统中,命名为 employee.txt,实现从 RDD 转换得到DataFrame,并按“id:1,name:Ella,age:36”的格式打印出 DataFrame 的所有数据。请写出程序代码。

package cn.itcast.spark.mook import org.apache.spark.sql.SparkSession

import org.junit.Test class RDDtoDataFrame { @Test

def test(): Unit ={

val spark=SparkSession.builder()

.appName("datafreame1")

.master("local[6]")

.getOrCreate() import spark.implicits._

val df=spark.sparkContext.textFile("dataset/employee.txt").map(_.split(","))

.map(item => Employee(item(0).trim.toInt,item(1),item(2).trim.toInt))

.toDF()

df.createOrReplaceTempView("employee")

val dfRDD=spark.sql("select * from employee")

dfRDD.map(it => "id:"+it(0) +",name:"+it(1)+",age:"+it(2) )

.show()

}

}

case class Employee(id:Int,name:String,age:Long)

编程实现利用 DataFrame 读写 MySQL 的数据

(1)在 MySQL 数据库中新建数据库 sparktest,再创建表 employee,包含如表 6-2 所示的两行数据。

表 6-2 employee 表原有数据

id name gender Age

1 Alice F 22

2 John M 25

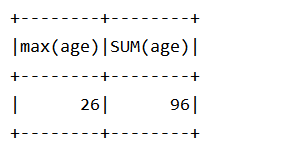

(2)配置 Spark 通过 JDBC 连接数据库 MySQL,编程实现利用 DataFrame 插入如表 6-3 所示的两行数据到 MySQL 中,最后打印出 age 的最大值和 age 的总和。

表 6-3 employee 表新增数据

id name gender age

3 Mary F 26

4 Tom M 23

package cn.itcast.spark.mook

import org.apache.spark.sql.{SaveMode, SparkSession}

import org.apache.spark.sql.types.{FloatType, IntegerType, StringType, StructField, StructType}

object MysqlOp {

def main(args: Array[String]): Unit = {

val spark = SparkSession

.builder()

.appName("mysql example")

.master("local[6]")

.getOrCreate()

val schema = StructType(

List(

StructField("id", IntegerType),

StructField("name", StringType),

StructField("gender", StringType),

StructField("age", IntegerType)

)

)

val studentDF = spark.read

//分隔符:制表符

.option("delimiter", ",")

.schema(schema)

.csv("dataset/stu")

studentDF.write

.format("jdbc")

.mode(SaveMode.Append)

.option("url", "jdbc:mysql://hadoop101:3306/spark02")

.option("dbtable", "employee")

.option("user", "spark")

.option("password", "fengge666")

.save()

spark.read

.format("jdbc")

.option("url", "jdbc:mysql://hadoop101:3306/spark02")

.option("dbtable","(select max(age),SUM(age) from employee) as emp")

.option("user", "spark")

.option("password", "fengge666")

.load()

.show()

}

}

SparkSQL学习进度9-SQL实战案例的更多相关文章

- Salesforce学习之路-developer篇(五)一文读懂Aura原理及实战案例分析

1. 什么是Lightning Component框架? Lightning Component框架是一个UI框架,用于为移动和台式设备开发Web应用程序.这是一个单页面Web应用框架,用于为Ligh ...

- 大数据学习day20-----spark03-----RDD编程实战案例(1 计算订单分类成交金额,2 将订单信息关联分类信息,并将这些数据存入Hbase中,3 使用Spark读取日志文件,根据Ip地址,查询地址对应的位置信息

1 RDD编程实战案例一 数据样例 字段说明: 其中cid中1代表手机,2代表家具,3代表服装 1.1 计算订单分类成交金额 需求:在给定的订单数据,根据订单的分类ID进行聚合,然后管理订单分类名称, ...

- 【大数据】SparkSql学习笔记

第1章 Spark SQL概述 1.1 什么是Spark SQL Spark SQL是Spark用来处理结构化数据的一个模块,它提供了2个编程抽象:DataFrame和 DataSet,并且作为分布式 ...

- 基于SpringCloud的Microservices架构实战案例-架构拆解

自第一篇< 基于SpringCloud的Microservices架构实战案例-序篇>发表出来后,差不多有半年时间了,一直也没有接着拆分完,有如读本书一样,也是需要契机的,还是要把未完成的 ...

- 【Redis3.0.x】实战案例

Redis3.0.x 实战案例 简介 <Redis实战>的学习笔记和总结. 书籍链接 初识 Redis Redis 简介 Redis 是一个速度非常快的键值对存储数据库,它可以存储键和五种 ...

- Shell高级编程视频教程-跟着老男孩一步步学习Shell高级编程实战视频教程

Shell高级编程视频教程-跟着老男孩一步步学习Shell高级编程实战视频教程 教程简介: 本教程共71节,主要介绍了shell的相关知识教程,如shell编程需要的基础知识储备.shell脚本概念介 ...

- 跟着老男孩一步步学习Shell高级编程实战

原创作品,允许转载,转载时请务必以超链接形式标明文章 原始出处 .作者信息和本声明.否则将追究法律责任.http://oldboy.blog.51cto.com/2561410/1264627 本sh ...

- SQL反模式学习笔记21 SQL注入

目标:编写SQL动态查询,防止SQL注入 通常所说的“SQL动态查询”是指将程序中的变量和基本SQL语句拼接成一个完整的查询语句. 反模式:将未经验证的输入作为代码执行 当向SQL查询的字符串中插入别 ...

- SQL注入(SQL Injection)案例和防御方案

sql注入(SQL Injection):就是通过把SQL命令插入到Web表单递交或输入域名或页面请求的查询字符串,最终达到欺骗服务器执行恶意的SQL命令. SQL注入攻击的主要危害包括:非法读取.篡 ...

随机推荐

- mysql聚簇索引和非聚簇索引

聚簇索引 InnoDB使用的是聚簇索引 将数据与主键索引放在了一起,索引的叶子节点保存了行数据,找到了主键索引,即找到了行数据. 辅助索引记录了主键的位置,所以查询where name= xxx 时, ...

- C++笔试题续

第一部分:C++与C语言的差异(1-18)1.C 和 C++ 中 struct 有什么区别? Protection行为 能否定义函数C 无 否,但可以有函数指针C++ 有 可以,默认是public2. ...

- tengine下载和安装

tengine简介: Tengine所基于开发的Nginx的意思是Engine-X,Tengine在淘宝开发,所以我们把Engine-X中的X替换成Taobao.Tengine即Taobao-Engi ...

- SpringBoot快速入门(实战篇一)

SpringBoot快速入门(一) 一SpringBoot简介 1.spring开发经历的阶段 Spring 诞生时是 Java 企业版(Java Enterprise Edition,JEE,也称 ...

- JavaSE09-(练手)简易学生管理系统

1.学生管理系统实现步骤 案例需求 系统主要功能如下: 添加学生:通过键盘录入学生信息,添加到集合中 删除学生:通过键盘录入要删除学生的学号,将该学生对象从集合中删除 修改学生:通过键盘录入要修改学生 ...

- 2020-2021-1 20209307《Linux内核原理与分析》第三周作业

一.计算机的三大法宝 存储程序计算机.函数调用堆栈机制.中断机制 二.堆栈 堆栈的作用:记录函数调用框架.传递函数参数.保存返回值的地址.提供局部变量存储空间 堆栈操作:push栈顶地址减少四个字节. ...

- MySQL-常见小疑惑

1. DISTINCT 多列去重 1.1 select DISTINCT a,b 实际含义是? 正确:排除 (a列重复且b列重复)的记录 错误:排除 a b两列 值合并后 重复的记录. 举例1: 去 ...

- 一位弱校选手的oi经历

锦瑟无端五十弦,一弦一柱思华年. 这只是一位不知道什么时候就要退役的oier在一节晚自习的时候写的无聊东西 曾经也想好好写一写自己的oi历程,也许会有人看,不过因为自己懒加上文笔差也一直没写,直到昨天 ...

- matplotlib的学习9-bar柱状图

import matplotlib.pyplot as plt import numpy as np ''' 向上向下分别生成12个数据,X为 0 到 11 的整数 ,Y是相应的均匀分布的随机数据. ...

- ssms导入excel数据提示未安装插件的解决方法

今天用ssms导入excel的时候,提示 然后去找了一下解决方案,安装了相对应的插件.但是还是会提示这个问题. 又去找了一下原因,找到一个原因是sqlserver启动的时候是32位的,但是导入需要64 ...