python大作业二

一、存入csv

上次爬取到了所需要的内容,但是没有存入到csv中,这次存入了csv文件中,代码如下:

import requests

from bs4 import BeautifulSoup

import csv

import io

import sys

sys.stdout=io.TextIOWrapper(sys.stdout.buffer,encoding='gb18030') def get_url():#得到A-Z所有网站

urls=[]

for i in range(1,27):

i = chr(i+96)

urls.append('http://www.thinkbabynames.com/start/0/%s'%i)

return urls

pass def get_text(url):#得到所有名字以及连接,爬取所需内容

headers = {'Cookie':"User-Agent:Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Mobile Safari/537.36"}

docx=requests.get(url)

soup=BeautifulSoup(docx.content,'html.parser')

c_txt1=soup.find('section',{'id':'index'}).findAll('b')

for x in c_txt1:

s=[]

if x.find('a'):

name=x.find('a')['href'].split("/")[-1]#使用正则表达式获得所有名字

#url.append('http://www.thinkbabynames.com/meaning/0/%s'%i)#获得所有名字详情页链接

if name:

r=requests.get('http://www.thinkbabynames.com/meaning/0/%s'%name)

result=r.text

bs=BeautifulSoup(result,'html.parser')

li=bs.find('div',class_='content').find('h1')

Enname=li.text[8::1]#使用切片语法获得详情页名字(s[x:y:z]x为起始,y为终止,z为步长)

Gender=li.text[1:8:1]#使用切片语法获得详情页名字性别

li1=bs.find('section',id='meaning').find('p')

Description=li1.text

#保存名字,性别,简介到s中

s.append(Enname)

s.append(Gender)

s.append(Description)

save_text(s)

return s

pass def save_text(s):#保存到csv中

with open('text.csv','a',encoding='utf_8_sig',newline='')as f:

writer = csv.writer(f)

writer.writerow(s) if __name__ == '__main__':

urls=get_url();

for url in urls:

get_text(url)

如上把得到的名字,性别,以及简介存入s中,再把s存到csv中。

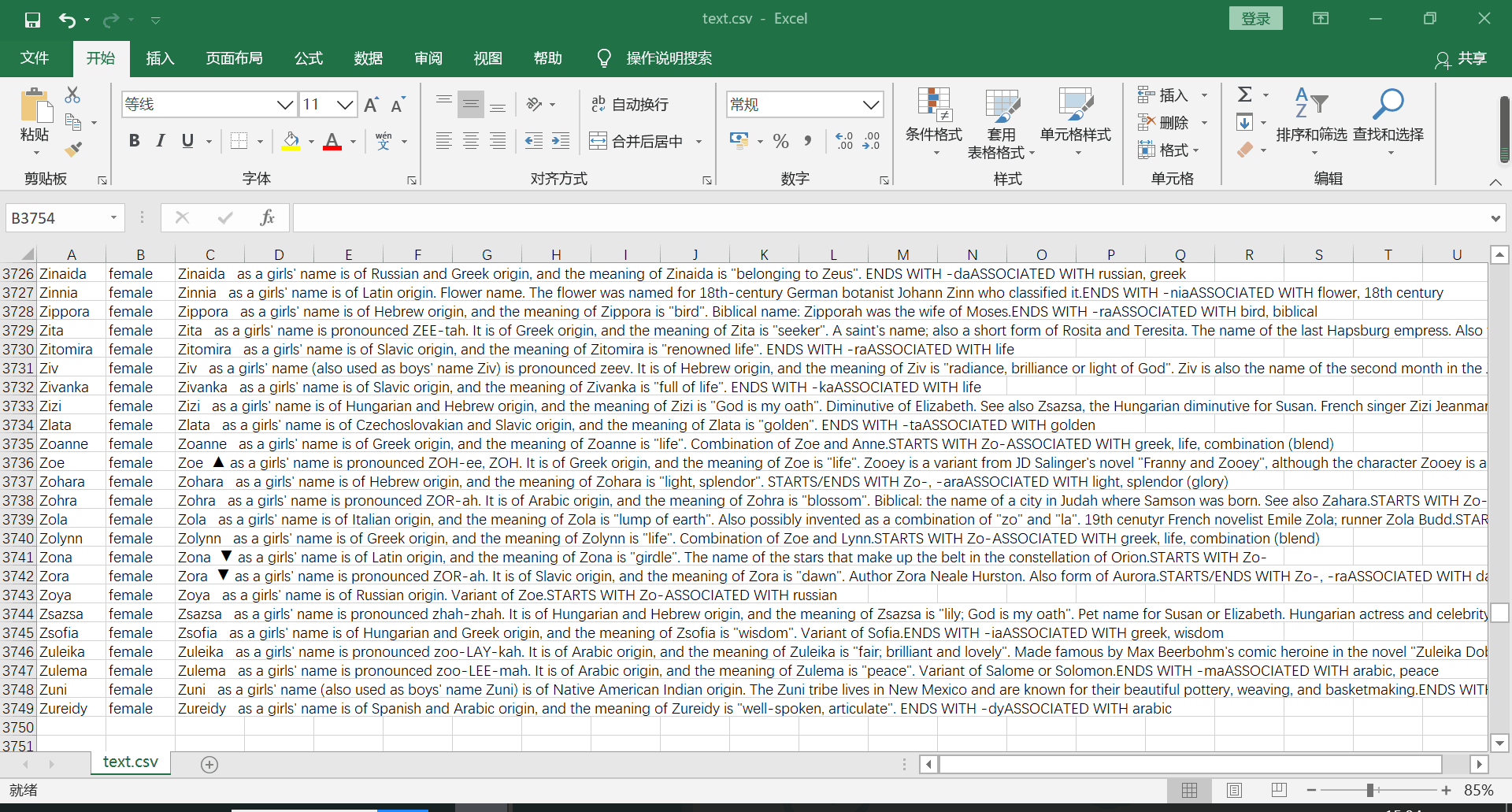

二、csv文件截图

三、遇到的问题及解决方案

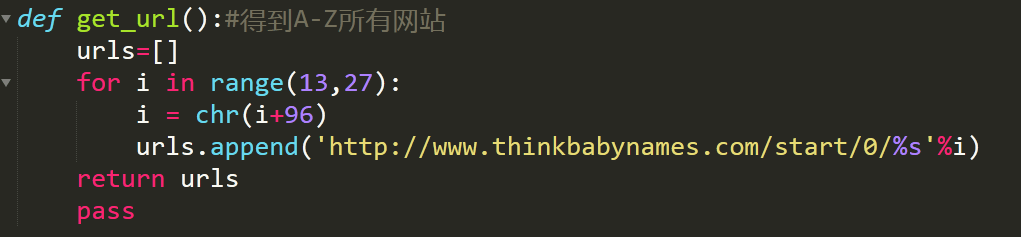

(1)爬取到所有名字时不能获得文本内容

解决方案:选择合适的正则表达式

docx=requests.get(url)

soup=BeautifulSoup(docx.content,'html.parser')

c_txt1=soup.find('section',{'id':'index'}).findAll('b')

for x in c_txt1:

s=[]

if x.find('a'):

name=x.find('a')['href'].split("/")[-1]#使用正则表达式获得所有名字

(2)获取名字详情页内容时,名字和性别在一起。

解决方案:使用切片语法分别获得名字和姓名分开存取

li=bs.find('div',class_='content').find('h1')

Enname=li.text[8::1]#使用切片语法获得详情页名字(s[x:y:z]x为起始,y为终止,z为步长)

Gender=li.text[1:8:1]#使用切片语法获得详情页名字性别

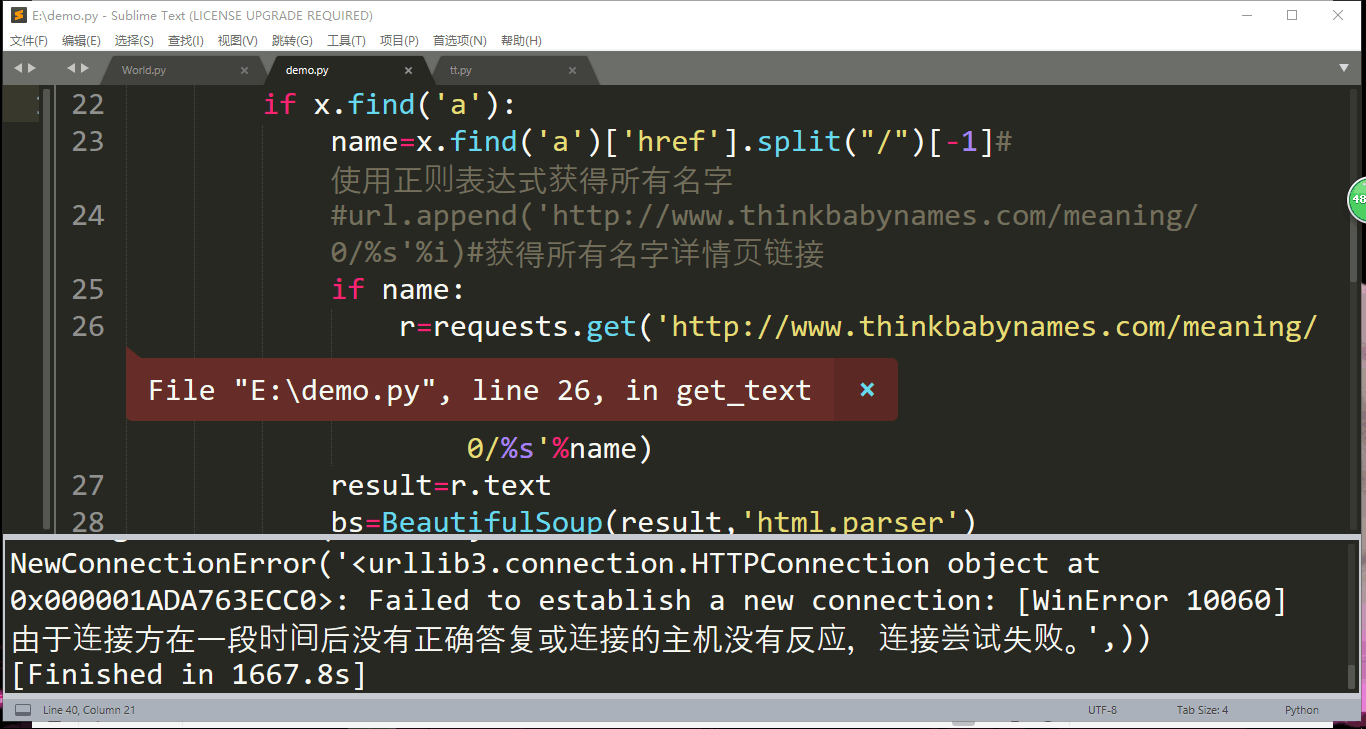

(3)在笔记本上运行时,访问量大

解决方案:分开来爬

如上图,改变range()函数中的数字来选择爬取部分网站以减少访问量。

这样既能够满足爬取要求,也不会被网站禁止爬取。

python大作业二的更多相关文章

- python大作业

爬取西刺代理 生成请求头 #encoding = utf-8; __all__ = ("Header"); import random; class Header(object): ...

- python大作业-图书管理系统

#缺少循环执行和错误处理 #add()函数 添加了循环执行 #错误处理:regist()函数 登录和退出选择的时候添加了错误处理 import sys import importlib importl ...

- 数据库大作业--由python+flask

这个是项目一来是数据库大作业,另一方面也算是再对falsk和python熟悉下,好久不用会忘很快. 界面相比上一个项目好看很多,不过因为时间紧加上只有我一个人写,所以有很多地方逻辑写的比较繁琐,如果是 ...

- Python学习之编写三级菜单(Day1,作业二)

作业二:多级菜单 三级菜单 可依次进入各子菜单 在各级菜单中输入B返回上一级Q退出程序 知识点:字典的操作,while循环,for循环,if判断 思路: 1.开始,打印一级菜单让用户进行选择(可以输入 ...

- c++小学期大作业攻略(二)整体思路+主界面

写在前面:如果我曾经说过要在第一周之内写完大作业,那……肯定是你听错了.不过如果我在写的时候有攻略看的话应该可以轻松地在4~5天内做完,然后觉得写攻略的人是个小天使吧(疯狂暗示).出于给大家自由发挥的 ...

- 【大数据应用技术】作业十二|Hadoop综合大作业

本次作业的要求来自:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3339 前言 本次作业是在<爬虫大作业>的基础上进行的 ...

- 爬虫综合大作业——网易云音乐爬虫 & 数据可视化分析

作业要求来自于https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3075 爬虫综合大作业 选择一个热点或者你感兴趣的主题. 选择爬取的对象 ...

- 程设大作业xjb写——魔方复原

鸽了那么久总算期中过[爆]去[炸]了...该是时候写写大作业了 [总不能丢给他们不会写的来做吧 一.三阶魔方的几个基本定义 ↑就像这样,可以定义面的称呼:上U下D左L右R前F后B UD之间的叫E,LR ...

- Python 数据分析(二 本实验将学习利用 Python 数据聚合与分组运算,时间序列,金融与经济数据应用等相关知识

Python 数据分析(二) 本实验将学习利用 Python 数据聚合与分组运算,时间序列,金融与经济数据应用等相关知识 第1节 groupby 技术 第2节 数据聚合 第3节 分组级运算和转换 第4 ...

随机推荐

- redis(4)--redis集群之主从复制

集群 先来简单了解下redis中提供的集群策略, 虽然redis有持久化功能能够保障redis服务器宕机也能恢复并且只有少量的数据损失,但是由于所有数据在一台服务器上,如果这台服务器出现硬盘故障,那就 ...

- SecureCRT安装包和破解脚本

第一步下载 SecureCRT安装包和破解脚本 下载 http://pan.baidu.com/s/1c1D5Ala 破解脚本 securecrt_mac_crack.pl安装包scrt-7.3.7- ...

- HDFS的架构和设计要点

HDFS的架构和设计要点 转 大数据之路 发布于 2012/10/11 23:00 字数 4487 阅读 495 收藏 1 点赞 0 评论 0 撸了今年阿里.头条和美团的面试,我有一个重要发现.... ...

- webpack学习3.1由浅入深-打包JS

打包JS Step1:在新建的文件夹下新建一个sum.js文件,一个app.js文件 sum.js //es module export default function(a,b){ return a ...

- 《Java数据结构》链表结构(单向链表,双向链表)

单向链表(单链表)是链表的一种,其特点是链表的链接方向是单向的,对链表的访问要通过顺序读取从头部开始:链表是使用指针进行构造的列表:又称为结点列表,因为链表是由一个个结点组装起来的:其中每个结点都有指 ...

- Android Studio 安装教程

前言 前段时间周围有很多认识的人学习Android,看蛮多人在装Android Studio,然而看他们装的过程不是那么顺利?然后也有高中同学来问我,于是乎就自己也试着去装了下,也方便日后学习Andr ...

- c++-类与类的关系

类与类的关系 #define _CRT_SECURE_NO_WARNINGS #include <iostream> using namespace std; class A { publ ...

- 墨者 - X-FORWARDED-FOR注入漏洞实战

X-FORWARDED-FOR 首先,X-Forwarded-For 是一个 HTTP 扩展头部.HTTP/1.1(RFC 2616)协议并没有对它的定义,它最开始是由 Squid 这个缓存代理软件引 ...

- Elasticsearch(GEO)数据写入和空间检索

Elasticsearch简介 什么是 Elasticsearch? Elasticsearch 是一个开源的分布式 RESTful搜索和分析引擎,能够解决越来越多不同的应用场景. 本文内容 本文主要 ...

- Dynamics 365 Portal 修改注册页面及Profile页面

一,Profile页面 客户要求在Portal Profile页面上添加性别字段,通过查看源代码发现,中间的联系人信息部分是引用的CRM中Contact实体的Portal Web Form表单,直接把 ...