使用jsoup爬取所有成语

前几天看到有人在博问上求所有成语,想到刚好看了jsoup,就动手实践了一下,提问者给出了网站,一看很简单,就两种页面,一种是包含某个字的成语链接页面,一个是具体的包含某个字的成语的页面

下面是我的代码,用到了jsoup的jar包

package cnblogs.spider; import java.io.BufferedWriter;

import java.io.File;

import java.io.FileOutputStream;

import java.io.IOException;

import java.io.OutputStreamWriter;

import java.net.URL;

import java.util.ArrayList;

import java.util.List; import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements; public class IdiomScratch

{ public static void main(String[] args)

{

final String url = "http://www.hydcd.com/cy/chengyu/cy.htm";

final String urlSub = "http://www.hydcd.com/cy/chengyu/";

BufferedWriter writer = null;

try

{

Document doc = Jsoup.parse(new URL(url).openStream(), "gb18030", "http://www.hydcd.com");

Element cyTable = doc.getElementById("table1");

Elements aElements = cyTable.getElementsByTag("a");

List<String> aHrefs = new ArrayList<String>(); if(null != aElements && aElements.size() > 0)

{

for(int i = 0, size = aElements.size(); i < size; i++)

{

aHrefs.add(urlSub + aElements.get(i).attr("href"));

} File cytxt = new File("c://cengyu.txt");

if(!cytxt.exists())

{

cytxt.createNewFile();

} writer = new BufferedWriter(new OutputStreamWriter(new FileOutputStream(cytxt)));

String cy = null; for(int i = 0, size = aHrefs.size(); i < size; i++)

{

doc = Jsoup.parse(new URL(aHrefs.get(i)).openStream(), "gb18030", "http://www.hydcd.com");

cyTable = doc.getElementById("table1");

aElements = cyTable.getElementsByTag("a"); if(null != aElements && aElements.size() > 0)

{

int b = 0;

for(int j = 0, size2 = aElements.size(); j < size2; j++)

{

cy = aElements.get(j).text(); writer.write(cy + " ");

b++;

if(b == 8)

{

b = 0;

writer.write("\r\n");

}

} writer.write("\r\n");

if(b != 0)

{

writer.write("\r\n");

}

writer.flush();

}

}

}

}

catch(IOException e)

{

e.printStackTrace();

}

finally

{

if(null != writer)

{

try

{

writer.close();

}

catch(IOException e)

{

e.printStackTrace();

}

}

}

} }

说一下碰到的坑,一开始没有注意编码问题,得到的txt结果中总有一些乱码,后来看网页源码显示编码是gb2312,就换成了gb2312,但还是不对,一想gb2312是简体字的,肯定不能包含所有的成语中的汉字啊,所有就查了一下汉字的编码,发现有gb18030,就用这个试了一下,果然没有乱码了

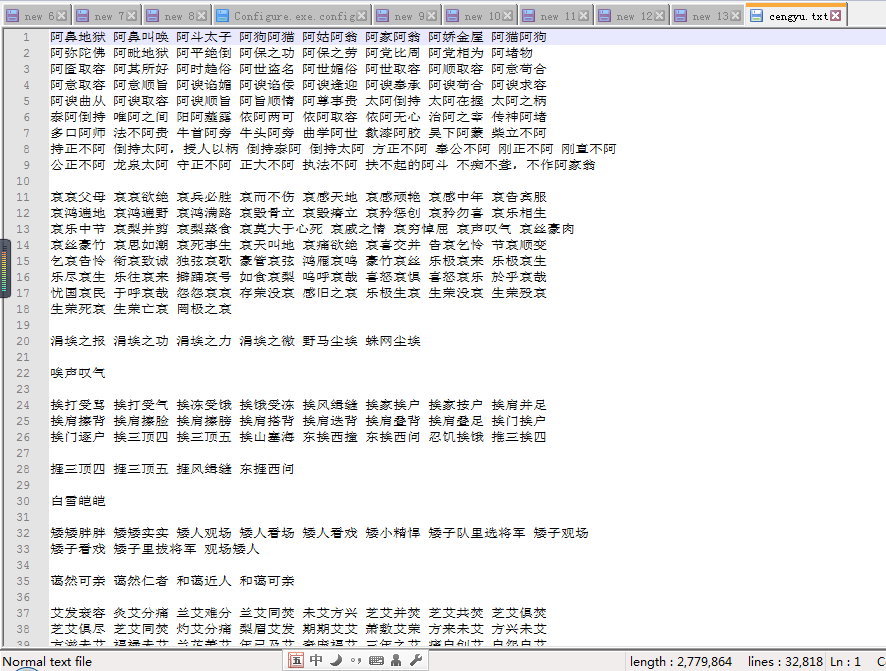

结果如下:

下面是所有成语的txt文件和代码:

使用jsoup爬取所有成语的更多相关文章

- Jsoup爬取带登录验证码的网站

今天学完爬虫之后想的爬一下我们学校的教务系统,可是发现登录的时候有验证码.因此研究了Jsoup爬取带验证码的网站: 大体的思路是:(需要注意的是__VIEWSTATE一直变化,所以我们每个页面都需要重 ...

- jsoup爬取某网站安全数据

jsoup爬取某网站安全数据 package com.vfsd.net; import java.io.IOException; import java.sql.SQLException; impor ...

- 使用Jsoup 爬取网易首页所有的图片

package com.enation.newtest; import java.io.File; import java.io.FileNotFoundException; import java. ...

- java爬虫入门--用jsoup爬取汽车之家的新闻

概述 使用jsoup来进行网页数据爬取.jsoup 是一款Java 的HTML解析器,可直接解析某个URL地址.HTML文本内容.它提供了一套非常省力的API,可通过DOM,CSS以及类似于jQuer ...

- 使用Jsoup爬取网站图片

package com.test.pic.crawler; import java.io.File; import java.io.FileOutputStream; import java.io.I ...

- 如何使用Jsoup爬取网页内容

前言: 这是一篇迟到很久的文章了,人真的是越来越懒,前一阵用jsoup实现了一个功能,个人觉得和selenium的webdriver原理类似,所以今天正好有时间,就又来更新分享了. 实现场景: 爬取博 ...

- 利用Jsoup爬取新冠疫情数据并存至数据库

需要用到的jar包(用来爬取的jsoup,htmlunit-2.37.0-bin以及连接数据库中的mysql.jar) 链接:https://pan.baidu.com/s/1VlylWmlhjd8K ...

- 利用jsoup爬取百度网盘资源分享连接(多线程)

突然有一天就想说能不能用某种方法把百度网盘上分享的资源连接抓取下来,于是就动手了.知乎上有人说过最好的方法就是http://pan.baidu.com/wap抓取,一看果然链接后面的uk值是一串数字, ...

- jsoup爬取网站图片

package com.ij34.JsoupTest; import java.io.File; import java.io.FileOutputStream; import java.io.Inp ...

随机推荐

- UTC时间和普通时间的区别

UTC时间 [root@openstack01 ~]# timedatectl Local time: Sat 2018-08-18 23:04:24 CST Universal ti ...

- linux中文件名有英文括号的问题

文件名包含“()”的文件,输入“(“后按TAB键无法补全,手动输入文件全名也删除不了:提示bash: syntax error near unexpected token `('错误. 在linux中 ...

- android websocket

https://github.com/TakahikoKawasaki/nv-websocket-client

- Servlet基础学习

Servlet学习 Servlet是Server与Applet的缩写,是服务端小程序的意思.使用Java语言编写的服务器端程序,可以像生成动态的WEB页,Servlet主要运行在服务器端,并由服务器调 ...

- 第7章 网络层协议(2)_ICMP协议

2. ICMP协议 2.1 ICMP报文(Internet Control Message Protocol)的类型 报文类型 类型值 代码 描述 请求报文 8 0 请求回显报文 响应报文 0 0 回 ...

- 过滤器Filter的四种拦截方式

过滤器有四种拦截方式!分别是:REQUEST.FORWARD.INCLUDE.ERROR. REQUEST: 直接访问目标资源时执行过滤器.包括:在地址栏中直接访问.表单提交.超链接.重定向,只要在地 ...

- python爬虫之登录

#-*-coding:utf--*- import cookielib, urllib, urllib2 import json import threading,time class Order(o ...

- js控制高度自适应,做到响应式

//9宫格布局 var prints=window.innerHeight-($('.header').height()+40);//屏幕去掉(头部高度+头部padding) $('.weui-gri ...

- vue项目,npm install后,npm run dev报错问题

报错: ERR! code ELIFECYCLE npm ERR! errno 1 npm ERR! metools@1.0.0 dev: `node build/dev-server.js` npm ...

- spring揭密学习笔记(1) --spring的由来

1.spring起源于在EJB暴露出各种严重问题的情况应运而生. Spring是于2003年兴起的一个轻量级的Java开发框架, Spring倡导一切从实际出发,以实用的态度来选择适合当前开发场景的解 ...