spark和scala的搭建

Scala--部署安装步骤

(1)上传并解压安装scala安装包

例:tar -zxvf scala--** -C 指定位置

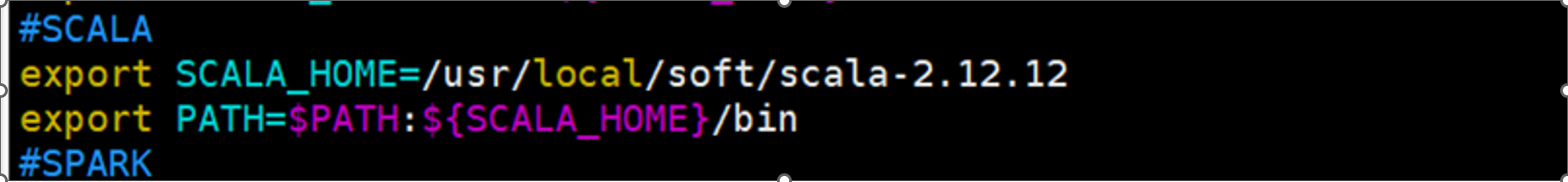

(2)设置环境变量

vim /etc/profile

export SCALA_HOME=spark软件包位置

export PATH=$PATH:${SCALA_HOME}/bin

source /etc/profile使环境变量生效

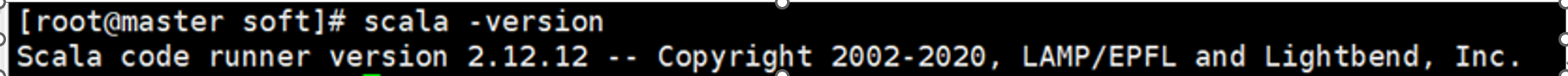

(3)验证scala 启动成功

spark--部署与安装

(1)上传并解压安装spark安装包

tar -zxvf / export/ software/ spark-** -C 指定位置

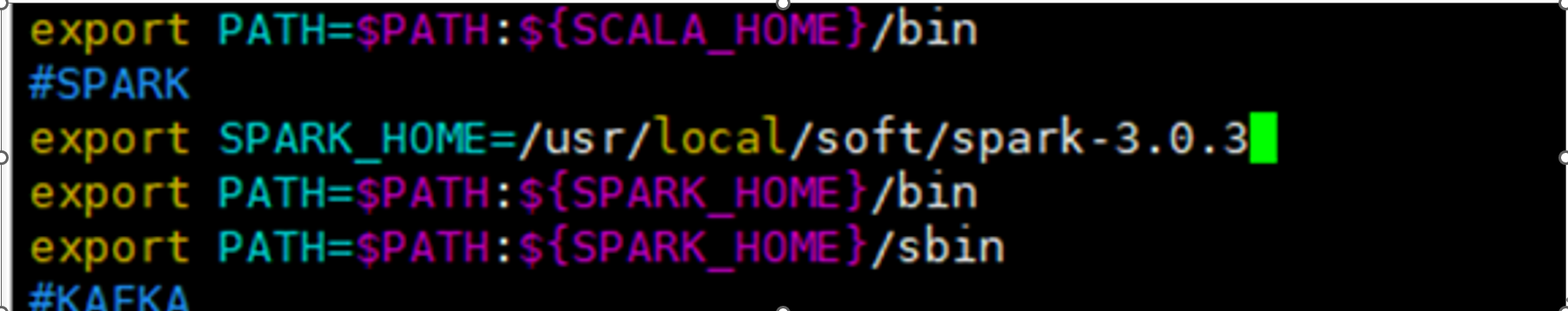

(2)设置环境变量

vim /etc/profile

export SPARK_HOME=spark软件包位置

export PATH=$PATH:${SPARK_HOME}/bin

export PATH=$PATH:${SPARK_HOME}/sbin

(3)修改配置文件

A.先备份文件cp spark env.sh.template spark-env.sh

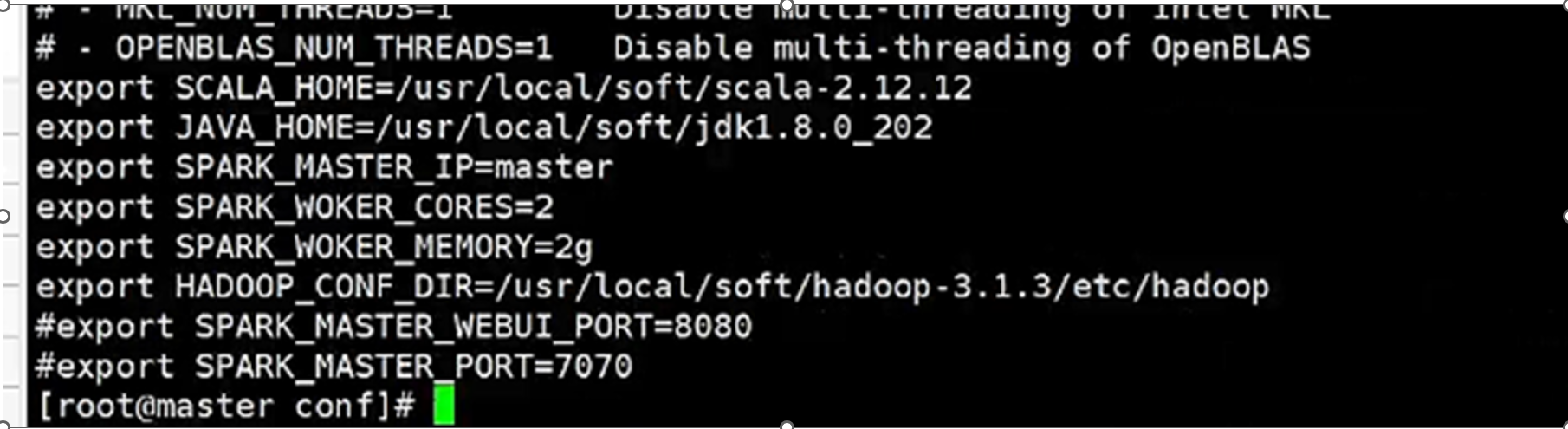

B.修改配置文件-spark-env.sh

添加一下内容:

export SCALA_HOME=spark软件包位置

export JAVA_HOME=java软件包位置

export SPARK_MASTER_IP=master

export SPARK_WOKER_CORES=2

export SPARK_WOKER_MEMORY=2g

export HADOOP_CONF_DIR=hadoop软件包位置

(#)export SPARK_MASTER_WEBUI_PORT=8080

(#)export SPARK_MASTER_PORT=7070

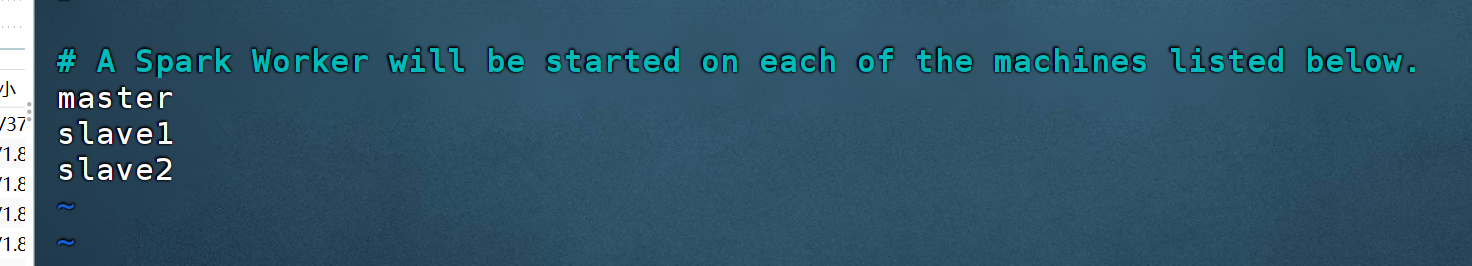

(3.1)在conf/创建slaves文件,指定master,slave1,slave2

(4)分发文件 --分别通过scp命令将软件包拷贝到节点(slave1,slave2)

scp -r spark slave1:目的地

scp -r spark slave1:目的地

(5)分别在slave1 slave2上设置环境变量

vim /etc/profile

export SPARK_HOME=spark软件包位置

export PATH=$PATH:${SPARK_HOME}/bin

export PATH=$PATH:${SPARK_HOME}/sbin

(6)启动集群:spark/sbin目录下:./start-all.sh

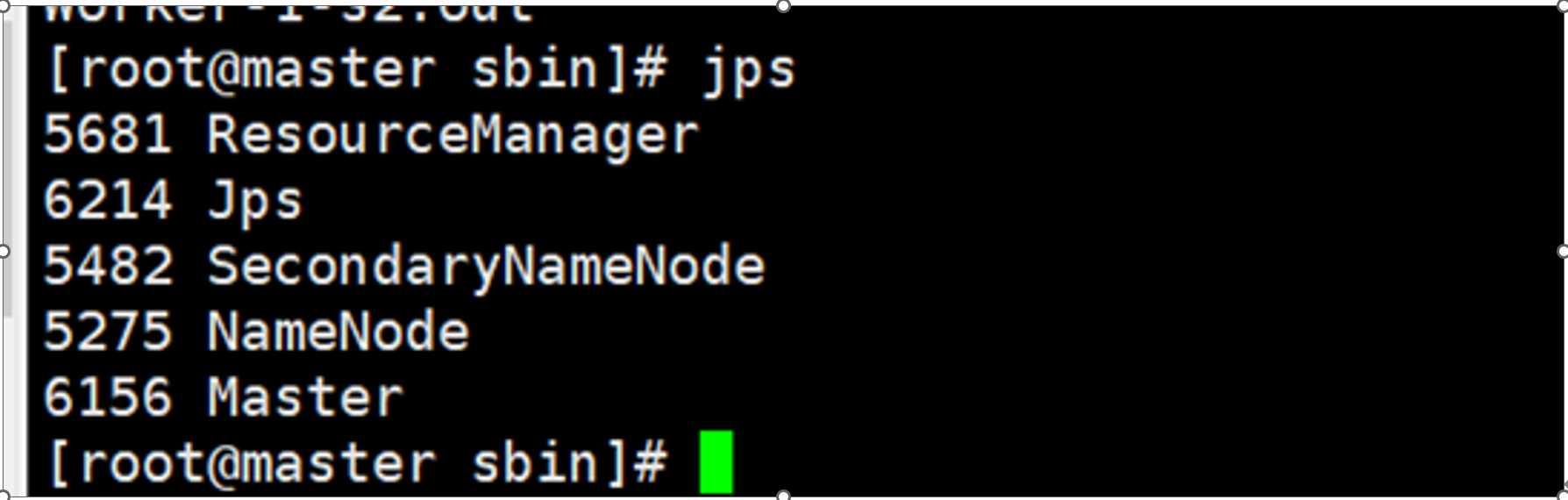

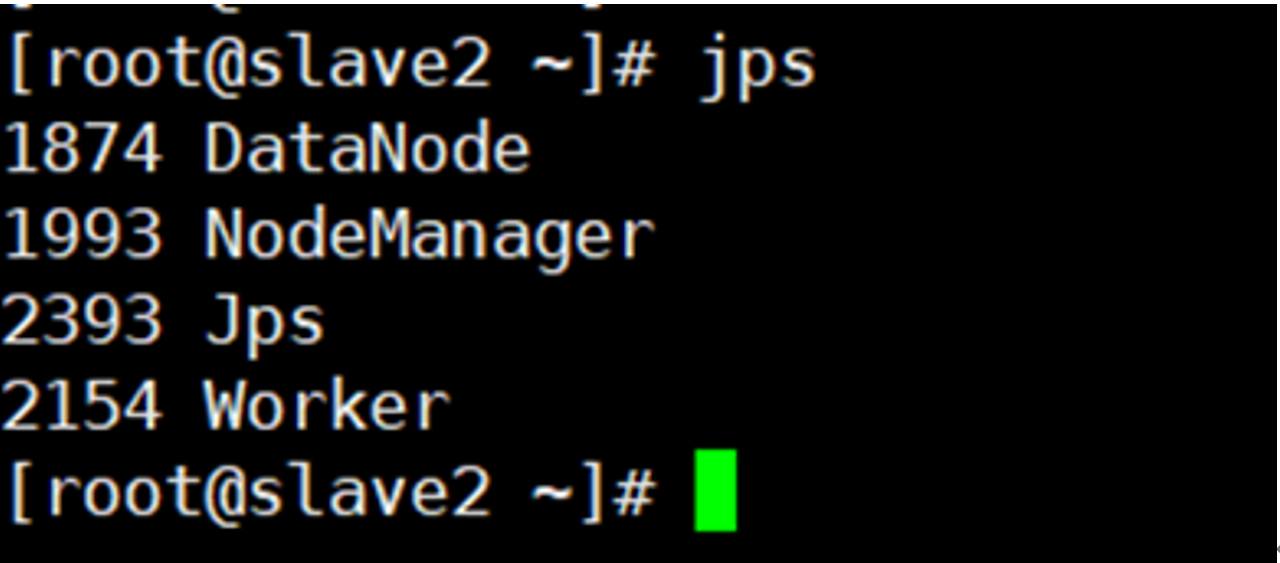

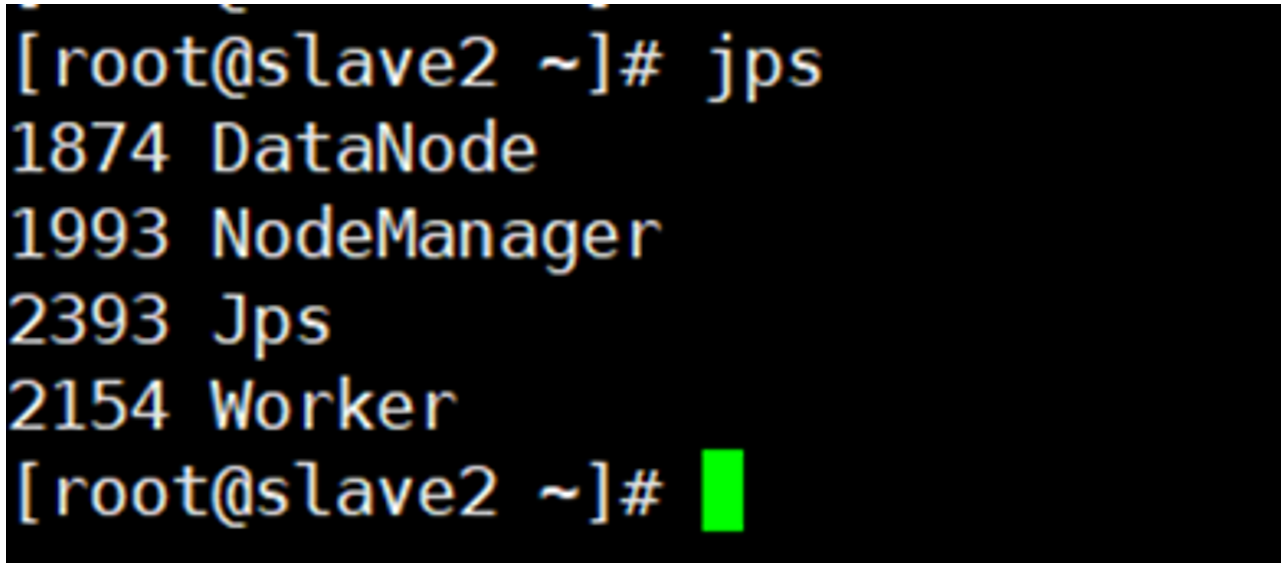

查看节点:

maser:

slave1:

slave2:

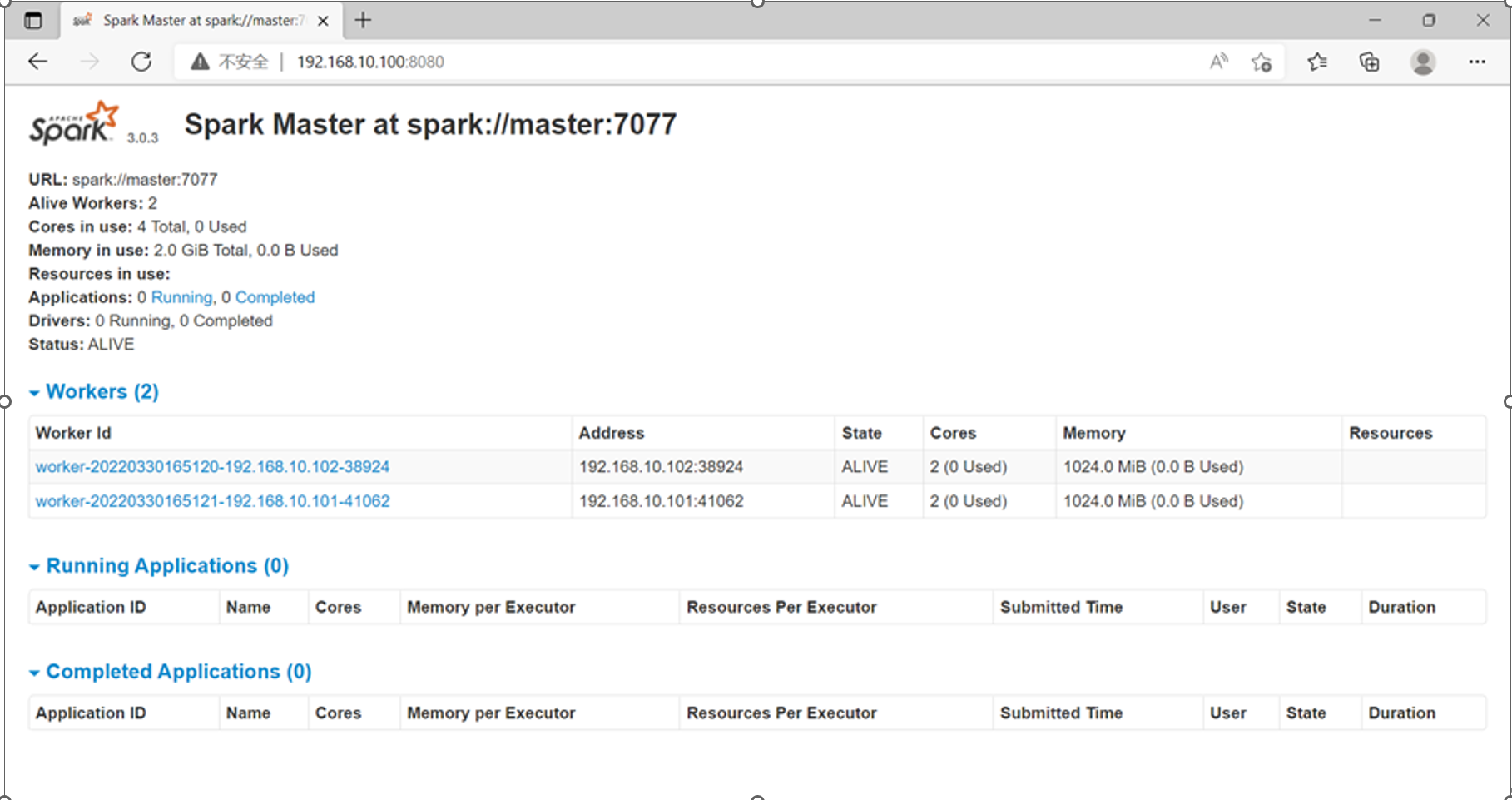

spark验证 ---浏览器输入ip:8080

单机伪分布式spark搭建

1.上传并解压安装scala安装包

2.复制模板文件

注:在目录中进入/conf,复制spark-env.sh.template文件为spark-env.sh

3.修改配置文件spark-env.sh

export JAVA_HOME=/root/123/jdk

export HADOOP_HOME=/root/123/hadoop

export HADOOP_CONF_DIR=/root/123/hadoop/etc/hadoop

export SPART_MASTER_IP=master

export SPART_LOCAL_IP=master

4.进入目录下的/sbin启动soark集群

命令: ./start-all.sh

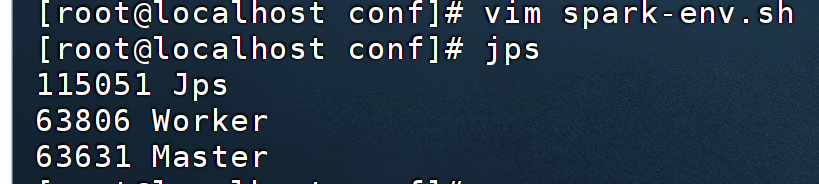

5.jps查看

spark和scala的搭建的更多相关文章

- Spark集群搭建【Spark+Hadoop+Scala+Zookeeper】

1.安装Linux 需要:3台CentOS7虚拟机 IP:192.168.245.130,192.168.245.131,192.168.245.132(类似,尽量保持连续,方便记忆) 注意: 3台虚 ...

- eclipse创建maven管理Spark的scala

说明,由于spark是用scala写的.因此,不管是在看源码还是在写spark有关的代码的时候,都最好是用scala.那么作为一个程序员首先是必须要把手中的宝剑给磨砺了.那就是创建好编写scala的代 ...

- Spark之集群搭建

注意,这种安装方式是集群方式:然后有常用两种运行模式: standalone , on yarn 区别就是在编写 standalone 与 onyarn 的程序时的配置不一样,具体请参照spar2中的 ...

- Hadoop+Spark:集群环境搭建

环境准备: 在虚拟机下,大家三台Linux ubuntu 14.04 server x64 系统(下载地址:http://releases.ubuntu.com/14.04.2/ubuntu-14.0 ...

- Hadoop、Spark 集群环境搭建

1.基础环境搭建 1.1运行环境说明 1.1.1硬软件环境 主机操作系统:Windows 64位,四核8线程,主频3.2G,8G内存 虚拟软件:VMware Workstation Pro 虚拟机操作 ...

- Spark+IDEA单机版环境搭建+IDEA快捷键

1. IDEA中配置Spark运行环境 请参考博文:http://www.cnblogs.com/jackchen-Net/p/6867838.html 3.1.Project Struct查看项目的 ...

- 一文读懂spark yarn集群搭建

文是超简单的spark yarn配置教程: yarn是hadoop的一个子项目,目的是用于管理分布式计算资源,在yarn上面搭建spark集群需要配置好hadoop和spark.我在搭建集群的时候有3 ...

- Spark 集群环境搭建

思路: ①先在主机s0上安装Scala和Spark,然后复制到其它两台主机s1.s2 ②分别配置三台主机环境变量,并使用source命令使之立即生效 主机映射信息如下: 192.168.32.100 ...

- Spark—local模式环境搭建

Spark--local模式环境搭建 一.Spark运行模式介绍 1.本地模式(loca模式):spark单机运行,一般用户测试和开发使用 2.Standalone模式:构建一个主从结构(Master ...

- Spark集群环境搭建——Hadoop集群环境搭建

Spark其实是Hadoop生态圈的一部分,需要用到Hadoop的HDFS.YARN等组件. 为了方便我们的使用,Spark官方已经为我们将Hadoop与scala组件集成到spark里的安装包,解压 ...

随机推荐

- 讲师招募 | Apache DolphinScheduler Meetup诚邀您共建开源!

随着Apache DolphinScheduler在全球范围内的快速发展,我们的用户群体和社区活动也在不断扩大. 为了进一步丰富我们的社区内容,分享更多有价值的知识和经验,我们诚挚地邀请您加入我们,成 ...

- vue3:setup语法糖使用教程

setup语法糖简介 直接在script标签中添加setup属性就可以直接使用setup语法糖了. 使用setup语法糖后,不用写setup函数:组件只需要引入不需要注册:属性和方法也不需要再返回,可 ...

- avdmanager 返回了非零退出代码: 1。

最近做了一次系统还原,很多功能都出现了异常 重装了 Visual Studio 之后创建安卓仿真器的时候遇到问题,说"avdmanager 返回了非零退出代码: 1." 解决思路 ...

- Linux命令lsscsi详解

@ 目录 一.什么是scsi 二.常见硬盘接口 1. IDE接口的硬盘 2. SCSI接口硬盘 3. SATA接口类型 三. lsscsi命令 1. lsscsi 命令安装 2. lsscsi命令英文 ...

- element-ui 表格控制列显隐简单方案

核心是使用v-if控制列的显隐 <template> <div> <div v-for="(item, index) in tables" :key= ...

- java_类属性&对象属性

访问类属性方式有两种: 对象.类属性 类.类属性 但是理解上第一种方法存在小小小问题, 逻辑没问题 2022年7月31日18:44:29

- SQL limit字句

limit用法介绍 limit子句可以返回检索查询行的某一连续的部分 用法介绍: SELECT column_list FROM table1 ORDER BY column_list LIMIT r ...

- 第41天:WEB攻防-ASP应用&HTTP.SYS&短文件&文件解析&Access注入&数据库泄漏

#ASP-中间件-CVE&短文件&解析&写权限 -HTTP.SYS(CVE-2015-1635) 1.漏洞描述 远程执行代码漏洞存在于 HTTP 协议堆栈 (HTTP.sys) ...

- Windows安装winget

打开GitHub链接地址:https://github.com/microsoft/winget-cli/releases 选择最新版本,点进去后 找到名为后缀名为 ".msixbundle ...

- SD卡的基本知识与选购指南

1.SD卡与TF卡 SD 卡:又叫标准 SD 卡,其尺寸大小为 32 x 24 x 2.1 mm ,一般用于数码相机.声卡和采集卡等设备. TF 卡:又叫 micro SD 卡,其尺寸大小为 15 x ...