python网络爬虫(12)去哪网酒店信息爬取

目的意义

爬取某地的酒店价格信息,示例使用selenium在Firefox中的使用。

来源

少部分来源于书。python爬虫开发与项目实战

构造

本次使用简易的方案,模拟浏览器访问,然后输入字段,查找,然后抓取网页中的信息。存储csv中。然后再转换为Excel,并对其中的数据进行二次处理。

代码

整个过程相当于获取网页,下载,然后粗糙的存储过程,最终完成。

不能理解的是,这样是使用了Phantomjs么。

from selenium import webdriver

from selenium.webdriver.support.wait import WebDriverWait

from selenium.webdriver.common.by import By

from selenium.webdriver.support import expected_conditions as EC

import re

import csv

import time class goWhere():

def __init__(self):

self.toCity=u'焦作'

self.driver=webdriver.Firefox()

self.driver.get("https://hotel.qunar.com/")

self.get_element()

for i in range(30):

self.get_response()

self.parser_store()

self.get_next_page() def get_element(self):

self.elem_toCity=self.driver.find_element_by_name(u"toCity")

self.elem_fromDate=self.driver.find_element_by_name(u"fromDate")

self.elem_toDate=self.driver.find_element_by_name(u"toDate")

self.elem_search=self.driver.find_element_by_class_name('search-btn')

self.elem_toCity.clear()

self.elem_toCity.send_keys(self.toCity)

self.elem_search.click() def get_response(self):

for i in range(5):

try:

WebDriverWait(self.driver,30).until(EC.presence_of_element_located((

By.CLASS_NAME,"item_price")))

break

except Exception as e:

self.driver.refresh()

print(e)

if(i==10):

self.driver.close()

exit()

js="window.scrollTo(0,document.body.scrollHeight);"

self.driver.execute_script(js)

time.sleep(5)

self.all=self.driver.find_elements_by_class_name("b_result_bd")

if(len(self.all)<16 or self.all[0].text==''):

self.driver.refresh()

self.get_response() def parser_store(self):

pattern=re.compile('(.*\s?)')

for each in self.all:

each_text=re.findall(pattern, each.text)

print(each_text)

with open('text.csv','a',encoding='gb18030',newline='') as f:

f_csv=csv.writer(f,)

if len(each_text)==8:

each_text.pop(5)

if len(each_text)==6:

each_text.insert(2,'None')

f_csv.writerow(each_text)

print('finished') def get_next_page(self):

self.nextBtn=self.driver.find_element_by_class_name('next')

self.nextBtn.click() if __name__=='__main__':

goWhere()

print('task finish')

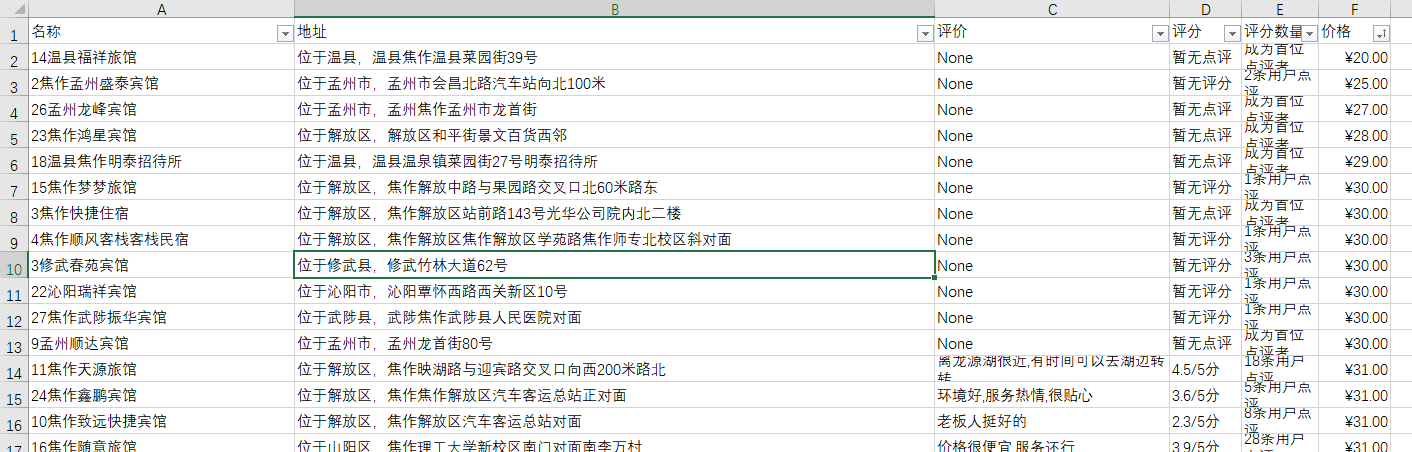

效果举例

二次处理的过程包括处理价格中的??,处理查看地图,处理礼品卡等字段,然后去掉起字,设定价格单元格为人民币格式。

后续

在实际操作过程中,有时网页不容易加载完成,有时加载正常。本次爬取的界面为26个左右共计780余数据。并没有完成数据爬取过程。

python网络爬虫(12)去哪网酒店信息爬取的更多相关文章

- Python开发爬虫之BeautifulSoup解析网页篇:爬取安居客网站上北京二手房数据

目标:爬取安居客网站上前10页北京二手房的数据,包括二手房源的名称.价格.几室几厅.大小.建造年份.联系人.地址.标签等. 网址为:https://beijing.anjuke.com/sale/ B ...

- Python 爬虫练手项目—酒店信息爬取

from bs4 import BeautifulSoup import requests import time import re url = 'http://search.qyer.com/ho ...

- [Python3网络爬虫开发实战] 7-动态渲染页面爬取

在前一章中,我们了解了Ajax的分析和抓取方式,这其实也是JavaScript动态渲染的页面的一种情形,通过直接分析Ajax,我们仍然可以借助requests或urllib来实现数据爬取. 不过Jav ...

- Python网络爬虫笔记(一):网页抓取方式和LXML示例

(一) 三种网页抓取方法 1. 正则表达式: 模块使用C语言编写,速度快,但是很脆弱,可能网页更新后就不能用了. 2. Beautiful Soup 模块使用Python编写,速度慢. ...

- 《精通Python网络爬虫》|百度网盘免费下载|Python爬虫实战

<精通Python网络爬虫>|百度网盘免费下载|Python爬虫实战 提取码:7wr5 内容简介 为什么写这本书 网络爬虫其实很早就出现了,最开始网络爬虫主要应用在各种搜索引擎中.在搜索引 ...

- Python网络爬虫入门篇

1. 预备知识 学习者需要预先掌握Python的数字类型.字符串类型.分支.循环.函数.列表类型.字典类型.文件和第三方库使用等概念和编程方法. 2. Python爬虫基本流程 a. 发送请求 使用 ...

- 学习推荐《精通Python网络爬虫:核心技术、框架与项目实战》中文PDF+源代码

随着大数据时代的到来,我们经常需要在海量数据的互联网环境中搜集一些特定的数据并对其进行分析,我们可以使用网络爬虫对这些特定的数据进行爬取,并对一些无关的数据进行过滤,将目标数据筛选出来.对特定的数据进 ...

- 【学习笔记】PYTHON网络爬虫与信息提取(北理工 嵩天)

学习目的:掌握定向网络数据爬取和网页解析的基本能力the Website is the API- 1 python ide 文本ide:IDLE,Sublime Text集成ide:Pychar ...

- Python网络爬虫:空姐网、糗百、xxx结果图与源码

如前面所述,我们上手写了空姐网爬虫,糗百爬虫,先放一下传送门: Python网络爬虫requests.bs4爬取空姐网图片Python爬虫框架Scrapy之爬取糗事百科大量段子数据Python爬虫框架 ...

随机推荐

- Android学习_内容提示器

内容提供器 1. 创建自己的内容提供器 1) 继承ContentProvider类,重写6个方法:onCreate().query().insert().update().delete ...

- Linux 解压小全

.gz 解压1:gunzip FileName.gz 解压2:gzip -d FileName.gz 压缩:gzip FileName .zip 解压:unzip FileName.zip 压缩:zi ...

- centos7 - mysql修改密码

set password for 'root'@'localhost'=password('MyNewPass4!'); mysql5.7默认安装了密码安全检查插件(validate_password ...

- Linux版本

1.内核:Linux内核Kernel目前最新稳定版 3.4 http://www.kernel.org/ 2.发行版本:是一些厂商将Linux系统内核与应用软件和文档包装起来,并提供一些安装界面和系 ...

- Hadoop完全分布式安装配置完整过程

一. 硬件.软件准备 1. 硬件设备 为了方便学习Hadoop,我采用了云服务器来配置Hadoop集群.集群使用三个节点,一个阿里云节点.一个腾讯云节点.一个华为云节点,其中阿里云和腾讯云都是通过使用 ...

- "UICollectionView实现带头视图和组的头视图同时存在"实现

实现效果如下: 以前做这效果的界面,总是实现的是section的头视图,因为我一直觉得collectionView是不像UITableView那样有tableHeaderView的,所以每次实现只能是 ...

- MySQL乱码的原因和设置UTF8数据格式

https://segmentfault.com/a/1190000018662023 MySQL使用时,有一件很痛苦的事情肯定是结果乱码.将编码格式都设置为UTF8可以解决这个问题,我们今天来说下为 ...

- 【JVM学习笔记】双亲委托机制存在的意义

1.可以确保Java核心库的类型安全:所有的Java应用都至少会引用java.lang.Object类,也就是说在运行期,java.lang.Object这个类会被加载到Java虚拟机:如果用户自定义 ...

- 安卓渗透测试工具——Drozer(安装和使用)

移动端渗透测试工具相比丰富的web端真的是少之又少,最近在做app的安全测试,用到了drozer,drozer的安装过程真的是太心酸了,中间报错了有6次才成功安装.. 一.环境准备 首先准备以下环境: ...

- python-Web-django-图形验证

import random def get_random_color(): return (random.randint(0, 255), random.randint(0, 255), random ...