通过mapreduce把mysql的数据读取到hdfs

前面讲过了怎么通过mapreduce把mysql的一张表的数据放到另外一张表中,这次讲的是把mysql的数据读取到hdfs里面去

具体怎么搭建环境我这里就不多说了。参考

通过mapreduce把mysql的一张表的数据导到另外一张表中

也在eclipse里面创建一个mapreduce工程

具体的实现代码

package com.gong.mrmysql; import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

import java.sql.PreparedStatement;

import java.sql.ResultSet;

import java.sql.SQLException;

import java.util.Iterator; import org.apache.hadoop.filecache.DistributedCache;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.Writable;

import org.apache.hadoop.mapred.FileOutputFormat;

import org.apache.hadoop.mapred.JobClient;

import org.apache.hadoop.mapred.JobConf;

import org.apache.hadoop.mapred.MapReduceBase;

import org.apache.hadoop.mapred.Mapper;

import org.apache.hadoop.mapred.OutputCollector;

import org.apache.hadoop.mapred.Reducer;

import org.apache.hadoop.mapred.Reporter;

import org.apache.hadoop.mapred.lib.IdentityReducer;

import org.apache.hadoop.mapred.lib.db.DBConfiguration;

import org.apache.hadoop.mapred.lib.db.DBInputFormat;

import org.apache.hadoop.mapred.lib.db.DBOutputFormat;

import org.apache.hadoop.mapred.lib.db.DBWritable; /**

* Function: 测试 mr 与 mysql 的数据交互,此测试用例将一个表中的数据复制到另一张表中

* 实际当中,可能只需要从 mysql 读,或者写到 mysql 中。

* date: 2013-7-29 上午2:34:04 <br/>

* @author june

*/

public class Mysql2Mr {

// DROP TABLE IF EXISTS `hadoop`.`studentinfo`;

// CREATE TABLE studentinfo (

// id INTEGER NOT NULL PRIMARY KEY,

// name VARCHAR(32) NOT NULL); public static class StudentinfoRecord implements Writable, DBWritable {

int id;

String name; //构造方法

public StudentinfoRecord() { } //Writable接口是对数据流进行操作的,所以输入是DataInput类对象

public void readFields(DataInput in) throws IOException {

this.id = in.readInt(); //输入流中的读取下一个整数,并返回

this.name = Text.readString(in);

} public String toString() {

return new String(this.id + " " + this.name);

} //DBWritable负责对数据库进行操作,所以输出格式是PreparedStatement

//PreparedStatement接口继承并扩展了Statement接口,用来执行动态的SQL语句,即包含参数的SQL语句

@Override

public void write(PreparedStatement stmt) throws SQLException {

stmt.setInt(, this.id);

stmt.setString(, this.name);

} //DBWritable负责对数据库进行操作,输入格式是ResultSet

// ResultSet接口类似于一张数据表,用来暂时存放从数据库查询操作所获得的结果集

@Override

public void readFields(ResultSet result) throws SQLException {

this.id = result.getInt();

this.name = result.getString();

} //Writable接口是对数据流进行操作的,所以输出是DataOutput类对象

@Override

public void write(DataOutput out) throws IOException {

out.writeInt(this.id);

Text.writeString(out, this.name);

}

} // 记住此处是静态内部类,要不然你自己实现无参构造器,或者等着抛异常:

// Caused by: java.lang.NoSuchMethodException: DBInputMapper.<init>()

// http://stackoverflow.com/questions/7154125/custom-mapreduce-input-format-cant-find-constructor

// 网上脑残式的转帖,没见到一个写对的。。。

public static class DBInputMapper extends MapReduceBase implements

Mapper<LongWritable, StudentinfoRecord, LongWritable, Text> {

public void map(LongWritable key, StudentinfoRecord value,

OutputCollector<LongWritable, Text> collector, Reporter reporter) throws IOException {

collector.collect(new LongWritable(value.id), new Text(value.toString()));

}

} public static class MyReducer extends MapReduceBase implements

Reducer<LongWritable, Text, StudentinfoRecord, Text> {

@Override

public void reduce(LongWritable key, Iterator<Text> values,

OutputCollector<StudentinfoRecord, Text> output, Reporter reporter) throws IOException {

String[] splits = values.next().toString().split(" ");

StudentinfoRecord r = new StudentinfoRecord();

r.id = Integer.parseInt(splits[]);

r.name = splits[];

output.collect(r, new Text(r.name));

}

} public static void main(String[] args) throws IOException {

JobConf conf = new JobConf(Mysql2Mr.class);

DistributedCache.addFileToClassPath(new Path("hdfs://192.168.241.13:9000/mysqlconnector/mysql-connector-java-5.1.38-bin.jar"), conf); conf.setMapOutputKeyClass(LongWritable.class);

conf.setMapOutputValueClass(Text.class);

conf.setOutputKeyClass(LongWritable.class);

conf.setOutputValueClass(Text.class); // conf.setOutputFormat(DBOutputFormat.class);

conf.setInputFormat(DBInputFormat.class); // mysql to hdfs

conf.set("fs.defaultFS", "hdfs://192.168.241.13:9000");//在配置文件conf中指定所用的文件系统---HDFS

conf.setReducerClass(IdentityReducer.class);

Path outPath = new Path("hdfs://192.168.241.13:9000/student/out1");

FileSystem.get(conf).delete(outPath, true);

FileOutputFormat.setOutputPath(conf, outPath); DBConfiguration.configureDB(conf, "com.mysql.jdbc.Driver", "jdbc:mysql://192.168.241.13:3306/mrtest",

"root", "");

String[] fields = { "id", "name" };

// 从 t 表读数据

DBInputFormat.setInput(conf, StudentinfoRecord.class, "t", null, "id", fields); // mapreduce 将数据输出到 t2 表

//DBOutputFormat.setOutput(conf, "t2", "id", "name"); // FileOutputFormat.setOutputPath(conf, new Path("hdfs://192.168.241.13:9000/student/out1")); conf.setMapperClass(org.apache.hadoop.mapred.lib.IdentityMapper.class);

conf.setMapperClass(DBInputMapper.class);

// conf.setReducerClass(MyReducer.class); JobClient.runJob(conf);

}

}

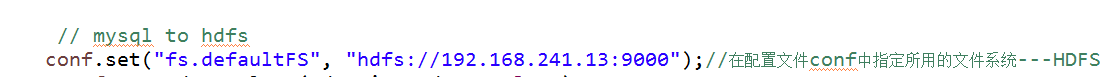

特别要主要的是在主函数里面添加这么一句话

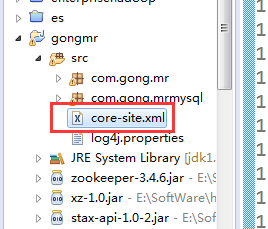

如果不添加这句话的话就不能识别你的hdfs路径了,除了这个方法之外还,不想添加这句话的话还可以把集群的core-site.xml文件直接拷贝一份放到工程的src目录下

这样也是可以的

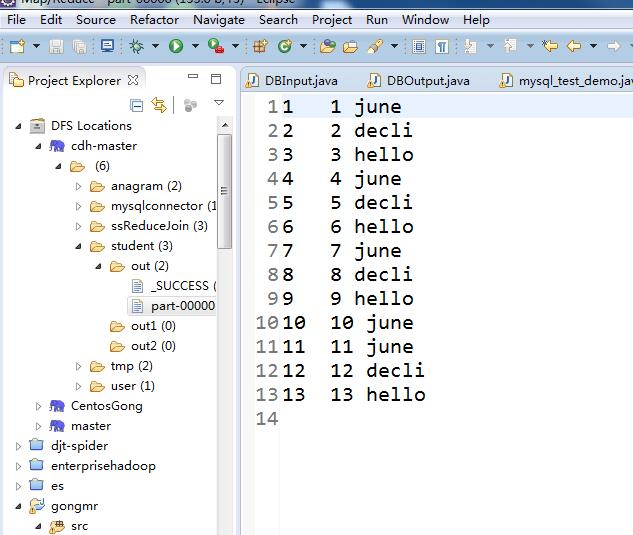

运行程序

可以看到hdfs的文件上面已经有mysql数据库表的内容了

通过mapreduce把mysql的数据读取到hdfs的更多相关文章

- Mysql遍历大表(Mysql大量数据读取内存溢出的解决方法)

mysql jdbc默认把select的所有结果全部取回,放到内存中,如果是要遍历很大的表,则可能把内存撑爆. 一种办法是:用limit,offset,但这样你会发现取数据的越来越慢,原因是设置了of ...

- MySQL的数据读取过程

本文来自:http://blog.chinaunix.net/uid-20785090-id-4759476.html 对于build-in的innodb的架构,每次当发布IO请求时,究竟是mysql ...

- MYSQL 的数据读取方式

例子: create table T(X bit(8)); insert into T (X) values(b'11111111'); select X from T; 这个时候会发现这个X 是乱码 ...

- Hadoop 中利用 mapreduce 读写 mysql 数据

Hadoop 中利用 mapreduce 读写 mysql 数据 有时候我们在项目中会遇到输入结果集很大,但是输出结果很小,比如一些 pv.uv 数据,然后为了实时查询的需求,或者一些 OLAP ...

- 使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟

使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟 Sqoop 大数据 Hive HBase ETL 使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟 基础环境 ...

- 五.hadoop 从mysql中读取数据写到hdfs

目录: 目录见文章1 本文是基于windows下来操作,linux下,mysql-connector-java-5.1.46.jar包的放置有讲究. mr程序 import java.io.DataI ...

- pandas读取MySql/SqlServer数据 (转)

在 Anacondas环境中,conda install pymssql ,一直报包冲突,所以采用先在 https://www.lfd.uci.edu/~gohlke/pythonlibs/#nump ...

- 通过mapreduce把mysql的一张表的数据导到另外一张表中

怎么安装hadoop集群我在这里就不多说了,我这里安装的是三节点的集群 先在主节点安装mysql 启动mysql 登录mysql 创建数据库,创建表格,先把数据加载到表格 t ,表格t2是空的 mys ...

- 如何实现MySQL表数据随机读取?从mysql表中读取随机数据

文章转自 http://blog.efbase.org/2006/10/16/244/如何实现MySQL表数据随机读取?从mysql表中读取随机数据?以前在群里讨论过这个问题,比较的有意思.mysql ...

随机推荐

- Eclipse之父、《设计模式》作者、Junit作者之Erich Gamma

Erich Gamma拥有多重权威身份.他是Jazz项目的主要领导人:是Eclipse的项目管理委员会成员,被业界称为“Eclipse之父”: 是经典书<设计模式>的作者四人帮之一,199 ...

- ssh证书免认证登录

思路: 客户端私钥存放于客户端,/root/.ssh/id_rsa 将客户端公钥存放于要远程控制服务器上:将客户在公钥id_rsa.pub内容追加到 /root/.ssh/authorized_key ...

- virtualBox 虚拟机下nginx设置不缓存静态文件不起作用解决办法

最近开发的时候,调整js时会一直使用缓存文件,无法显示改动!nginx配置静态文件add_header Cache-Control no-cache;也不起作用,很苦恼! nginx配置代码:even ...

- Golang 操作mysql使用举例---连接本地数据库

连接数据库的方式有两种:TCP和Unix域socket. 本文使用Unix domain sockets连接数据库.关于TCP连接数据库可以参考Go 操作mysql使用举例 下面例子中,演示了使用sh ...

- Linux VMware安装CentOS

VMware安装CentOS 1 检查BIOS虚拟化支持 2 新建虚拟机 3 新建虚拟机向导 4 创建虚拟空白光盘 ...

- spring4与mongodb的集成

新项目的辅助系统,需要用到mongo系统,今天再次将其使用环境进行了操作搭建.还是遇到一些问题,毕竟之前使用的场景和现在的不同.版本也不一样了. 本次使用的环境: mongo:3.4.4版本 OS: ...

- newifi mini将led指示灯引出当gpio使用

之前买了个newifi mini的路由器,CPU是mt7620a的,有7个led指示灯.现在想要把控制led灯的gpio引出来,方便其他驱动或应用的开发. 一.硬件部分 1.联想路由 现在想要把USB ...

- Video Processing subsystem例程分析

Video Processing subsystem例程分析 1.memory_ss模块 slave端口: S00: 连接设备: microblaze_ss----M_AXI_DC 时钟来源: S01 ...

- 分析Ajax请求并抓取今日头条街拍美图

项目说明 本项目以今日头条为例,通过分析Ajax请求来抓取网页数据. 有些网页请求得到的HTML代码里面并没有我们在浏览器中看到的内容.这是因为这些信息是通过Ajax加载并且通过JavaScript渲 ...

- 快速了解Python的定制类

多重继承 class Student(man,oldman): pass 可以继承多个父类,拥有他们的方法,如果有父类有相同的方法,哪个在前用哪个 定制类 看到类似__slots__这种形如 __xx ...