爬虫之爬取斗鱼官网LOL部分主播的状态

一个爬虫小程序 爬取主播的排名及观看人数

import re

import requests

import request

class Spider():

url = 'https://www.douyu.com/g_lol'

root_pattern = '<p>([\s\S]*?)</p>'

name_pattern = '<span class="dy-name ellipsis fl">([\s\S]*?)</span>'

number_pattern = '<span class="dy-num fr" >([\s\S]*?)</span>' def __fetch_content(self):

r = requests.get(Spider.url)

htmls = r.text

return htmls def __analysis(self, htmls):

root_htmls = re.findall(Spider.root_pattern, htmls)

anchors = []

for html in root_htmls:

name = re.findall(Spider.name_pattern, html)

number = re.findall(Spider.number_pattern, html)

anchor = {'name': name, 'number': number}

anchors.append(anchor)

return anchors def __refine(self, anchors):

l = lambda anchor: {

'name': anchor['name'][0],

'number': anchor['number'][0]

}

return map(l, anchors) def __sort(self, anchors):

anchors = sorted(anchors, key=self.__sort_seed, reverse=True)

return anchors def __sort_seed(self, anchor):

r = re.findall('\d*', anchor['number'])

number = float(r[0])

if '万' in anchor['number']:

number *= 10000

return number def __show(self, anchors):

for rank in range(0, len(anchors)):

print(

'人数排名' + str(rank + 1)

+ ' : ' + anchors[rank]['name']

+ '~~~~~~' + anchors[rank]['number']

) def go(self):

htmls = self.__fetch_content()

anchors = self.__analysis(htmls)

anchors = list(self.__refine(anchors))

anchors = self.__sort(anchors)

self.__show(anchors) spider = Spider()

spider.go()

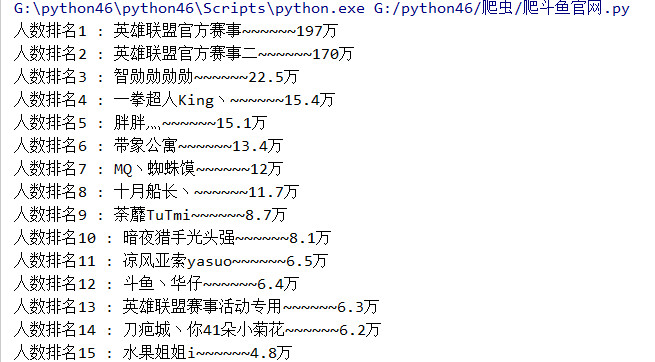

运行结果:

喜欢的朋友们可以去看主播的排名啦

爬虫之爬取斗鱼官网LOL部分主播的状态的更多相关文章

- 初识python 之 爬虫:爬取中国天气网数据

用到模块: 获取网页并解析:import requests,html5lib from bs4 import BeautifulSoup 使用pyecharts的Bar可视化工具"绘制图表& ...

- 爬虫实例——爬取煎蛋网OOXX频道(反反爬虫——伪装成浏览器)

煎蛋网在反爬虫方面做了不少工作,无法通过正常的方式爬取,比如用下面这段代码爬取无法得到我们想要的源代码. import requests url = 'http://jandan.net/ooxx' ...

- python爬虫:爬取易迅网价格信息,并写入Mysql数据库

本程序涉及以下方面知识: 1.python链接mysql数据库:http://www.cnblogs.com/miranda-tang/p/5523431.html 2.爬取中文网站以及各种乱码处 ...

- 用python爬虫简单爬取 笔趣网:类“起点网”的小说

首先:文章用到的解析库介绍 BeautifulSoup: Beautiful Soup提供一些简单的.python式的函数用来处理导航.搜索.修改分析树等功能. 它是一个工具箱,通过解析文档为用户提供 ...

- scrapy实验1 爬取中国人寿官网新闻,保存为xml

一.scrapy 实验 爬中国人寿新闻,保存为xml 如需转发,请注明出处:小婷儿的python https://www.cnblogs.com/xxtalhr/p/10517297.html 链 ...

- 实战爬取Plati官网游戏实时最低价格-Python

需要修改url中的id_r="这个",这个id需要从Battlefield V (plati.ru)中获取,其实也是这个链接中的#s24235. 配合了e-mail推送,其实这个e ...

- python爬取虎牙直播颜值区美女主播照片

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,如有问题请及时联系我们以作处理. PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取 python免费学习资 ...

- Python爬虫之爬取慕课网课程评分

BS是什么? BeautifulSoup是一个基于标签的文本解析工具.可以根据标签提取想要的内容,很适合处理html和xml这类语言文本.如果你希望了解更多关于BS的介绍和用法,请看Beautiful ...

- 网络爬虫之定向爬虫:爬取当当网2015年图书销售排行榜信息(Crawler)

做了个爬虫,爬取当当网--2015年图书销售排行榜 TOP500 爬取的基本思想是:通过浏览网页,列出你所想要获取的信息,然后通过浏览网页的源码和检查(这里用的是chrome)来获相关信息的节点,最后 ...

随机推荐

- git 无法忽略Android Studio 生成的 .idea目录解决办法

在Android Studio中导入了别的人Gradle项目,产生了 .idea文件夹, 然后git 发现了这个变动,修改了 .gitignore不起作用,仍然不能忽略这个文件夹 在项目目录里面 右键 ...

- 使用mysql5.7新特性解决前通配符查询性能问题

众所周知,在mysql里的后通配符可以使用索引查找,前通配查询却无法使用到索引,即使是使用到了索引,也是使用了索引全扫描,效率依然不高,再MySQL5.7之前,一直都没有好的办法解决,但是到了MySQ ...

- 路由 vue-router

vue-router官方文档 1.router跳转页面 编程式的导航 this.$router.push('/index'); 2.mode Router构造配置 const router = new ...

- 【Hibernate那点事儿】—— Hibernate知识总结

前言: 上一篇简单的讲解了下Hibernate的基础知识.这里对Hibernate比较重要的一些知识点,进行总结和归纳. 手码不易,转载请注明!——xingoo 总结的知识点: 1 关于hiberna ...

- Android开发最佳学习路线图(转)

Android开发总体路线图: 基础学习——JavaSE: 很多朋友一上手就开始学习Android,似乎太着急了一些. Android应用程序开发是以Java语言为基础的,所以没有扎实 ...

- 【转】Java类加载原理解析

原链接 1 基本信息 每个java开发人员对java.lang.ClassNotFoundExcetpion这个异常肯定都不陌生,这背后就涉及到了java技术体系中的类加载. Java的类加载机制是j ...

- Html5简单描述(优点与缺点)

什么是HTML5 HTML5指的是包括HTML.CSS和JavaScript在内的一套技术组合.它希望能够减少网页浏览器对于需要插件的丰富性网络应用服务(Plug-in-Based Rich Inte ...

- 【luogu P1262 间谍网络】 题解

题目链接:https://www.luogu.org/problemnew/show/P1262 注意: 1.缩点时计算出入度是在缩完点的图上用color计算.不要在原来的点上计算. 2.枚举出入度时 ...

- T4模板之文本模板

网址:https://docs.microsoft.com/en-us/visualstudio/modeling/design-time-code-generation-by-using-t4-te ...

- Long数组转String数组

public static String[] longToString(Long longArray[]) { if (longArray == null || longArray.length &l ...