log4j2发送消息至Kafka

title: 自定义log4j2发送日志到Kafka

tags: log4j2,kafka

为了给公司的大数据平台提供各项目组的日志,而又使各项目组在改动上无感知。做了一番调研后才发现log4j2默认有支持将日志发送到kafka的功能,惊喜之下赶紧看了下log4j对其的实现源码!发现默认的实现是同步阻塞的,如果kafka服务一旦挂掉会阻塞正常服务的日志打印,为此本人在参考源码的基础上做了一些修改。

log4j日志工作流程

log4j2对于log4j在性能上有着显著的提升,这点官方上已经有了明确的说明和测试,所以不多赘述。在为了更熟练的使用,还是有必要了解其内部的工作流程。这是官网log4j的一张类图

Applications using the Log4j 2 API will request a Logger with a specific name from the LogManager. The LogManager will locate the appropriate LoggerContext and then obtain the Logger from it. If the Logger must be created it will be associated with the LoggerConfig that contains either a) the same name as the Logger, b) the name of a parent package, or c) the root LoggerConfig. LoggerConfig objects are created from Logger declarations in the configuration. The LoggerConfig is associated with the Appenders that actually deliver the LogEvents.

官网已经解释他们之间的关系了,这里不再对每个类的功能和作用做具体介绍,今天的重点是Appender类,因为他将决定将日志输出至何方。

- Appender

The ability to selectively enable or disable logging requests based on their logger is only part of the picture. Log4j allows logging requests to print to multiple destinations. In log4j speak, an output destination is called an Appender. Currently, appenders exist for the console, files, remote socket servers, Apache Flume, JMS, remote UNIX Syslog daemons, and various database APIs. See the section on Appenders for more details on the various types available. More than one Appender can be attached to a Logger.

核心配置

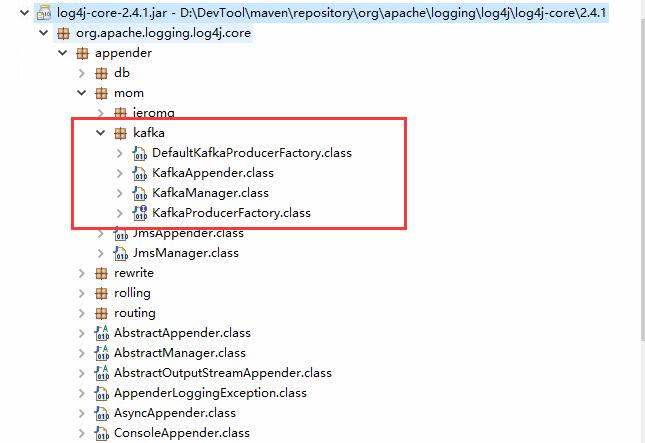

上图是log4j2发送日志到kafka的核心类,其实最主要的KafkaAppender,其他的几个类是连接kafka服务的。

- KafkaAppender核心配置

@Plugin(name = "Kafka", category = "Core", elementType = "appender", printObject = true)

public final class KafkaAppender extends AbstractAppender {

/**

*

*/

private static final long serialVersionUID = 1L;

@PluginFactory

public static KafkaAppender createAppender(

@PluginElement("Layout") final Layout<? extends Serializable> layout,

@PluginElement("Filter") final Filter filter,

@Required(message = "No name provided for KafkaAppender") @PluginAttribute("name") final String name,

@PluginAttribute(value = "ignoreExceptions", defaultBoolean = true) final boolean ignoreExceptions,

@Required(message = "No topic provided for KafkaAppender") @PluginAttribute("topic") final String topic,

@PluginElement("Properties") final Property[] properties) {

final KafkaManager kafkaManager = new KafkaManager(name, topic, properties);

return new KafkaAppender(name, layout, filter, ignoreExceptions, kafkaManager);

}

private final KafkaManager manager;

private KafkaAppender(final String name, final Layout<? extends Serializable> layout, final Filter filter, final boolean ignoreExceptions, final KafkaManager manager) {

super(name, filter, layout, ignoreExceptions);

this.manager = manager;

}

@Override

public void append(final LogEvent event) {

if (event.getLoggerName().startsWith("org.apache.kafka")) {

LOGGER.warn("Recursive logging from [{}] for appender [{}].", event.getLoggerName(), getName());

} else {

try {

if (getLayout() != null) {

manager.send(getLayout().toByteArray(event));

} else {

manager.send(event.getMessage().getFormattedMessage().getBytes(StandardCharsets.UTF_8));

}

} catch (final Exception e) {

LOGGER.error("Unable to write to Kafka [{}] for appender [{}].", manager.getName(), getName(), e);

throw new AppenderLoggingException("Unable to write to Kafka in appender: " + e.getMessage(), e);

}

}

}

@Override

public void start() {

super.start();

manager.startup();

}

@Override

public void stop() {

super.stop();

manager.release();

}

- log4j2.xml简单配置

<?xml version="1.0" encoding="UTF-8"?>

...

<Appenders>

<Kafka name="Kafka" topic="log-test">

<PatternLayout pattern="%date %message"/>

<Property name="bootstrap.servers">localhost:9092</Property>

</Kafka>

</Appenders>

<Loggers>

<Root level="DEBUG">

<AppenderRef ref="Kafka"/>

</Root>

<Logger name="org.apache.kafka" level="INFO" /> <!-- avoid recursive logging -->

</Loggers>其中

@Plugin的name属性对应的xml配置文件里面Kafka标签,当然这个也可以自定义。与此同时,也需要将@Plugin的name属性改为MyKafka。如下配置:

<MyKafka name="Kafka" topic="log-test">自定义配置

有时候我们会用到的属性由于默认的KafkaAppender不一定支持,所以需要一定程度的改写。但是改写也比较方便,只需要从构造器的Properties kafkaProps属性中取值即可。为了满足项目要求,我这边定义了platform和serviceName两个属性。

通过KafkaAppender的源码可知,他发送消息采取的是同步阻塞的方式。经过测试,一旦kafka服务挂掉,那么将会影响项目服务正常的日志输出,而这不是我希望看到的,所以我对他做了一定的程度的修改。

feature::

kafka服务一直正常

这种情况属于最理想的情况,消息将源源不断的发送至kafka broker

kafka服务挂掉,过一段时间后恢复正常

当kafka服务在挂掉的那一刻,后续所有的消息将会输出至

ConcurrentLinkedQueue队列里面去。同时该队列的消息也会不断的被消费,输出至本地文件。当心跳检测到kafka broker恢复正常了,本地文件的内容将会被读取,然后发送至kafka broker。需要注意的时候,此时会有大量消息被实例化为ProducerRecord对象,堆内存的占用率非常高,所以我用线程阻塞了一下!- kafka服务一直挂

所有的消息都会被输出至本地文件。

源码点我

log4j2发送消息至Kafka的更多相关文章

- Golang之发送消息至kafka

windows下安装zookeeper 1.安装JAVA-JDK,从oracle下载最新的SDK安装(我用的是1.8的) 2.安装zookeeper3.3.6,下载地址:http://apache.f ...

- Canal Server发送binlog消息到Kafka消息队列中

Canal Server发送binlog消息到Kafka消息队列中 一.背景 二.需要修改的地方 1.canal.properties 配置文件修改 1.修改canal.serverMode的值 2. ...

- Kafka发送消息失败原因

Kafka发送消息方法如下: Properties properties = new Properties(); properties.put("zookeeper.connect" ...

- Kafka生产者发送消息的三种方式

Kafka是一种分布式的基于发布/订阅的消息系统,它的高吞吐量.灵活的offset是其它消息系统所没有的. Kafka发送消息主要有三种方式: 1.发送并忘记 2.同步发送 3.异步发送+回调函数 下 ...

- kafka producer batch 发送消息

1. 使用 KafkaProducer 发送消息,是按 batch 发送的,producer 首先把消息放入 ProducerBatch 中: org.apache.kafka.clients.pro ...

- kafka producer 发送消息简介

kafka 的 topic 由 partition 组成,producer 会根据 key,选择一个 partition 发送消息,而 partition 有多个副本,副本有 leader 和 fol ...

- 物联网架构成长之路(8)-EMQ-Hook了解、连接Kafka发送消息

1. 前言 按照我自己设计的物联网框架,对于MQTT集群中的所有消息,是要持久化到磁盘的,这里采用一个消息队列中间件Kafka作为数据缓冲,缓冲结果存到数据仓库中,以供后续作为数据分析.由于MQTT集 ...

- SPRING 集成 KAFKA 发送消息

准备工作 1.安装kafka+zookeeper环境 2.利用命令创建好topic,创建一个topic my-topic 集成步骤 1.配置生产者 <?xml version="1.0 ...

- Kafka学习笔记(6)----Kafka使用Producer发送消息

1. Kafka的Producer 不论将kafka作为什么样的用途,都少不了的向Broker发送数据或接受数据,Producer就是用于向Kafka发送数据.如下: 2. 添加依赖 pom.xml文 ...

随机推荐

- 一起学Hadoop——Hadoop的前世今生

Hadoop是什么? Hadoop是一个处理海量数据的开源框架.2002年Nutch项目面世,这是一个爬取网页工具和搜索引擎系统,和其他众多的工具一样,都遇到了在处理海量数据时效率低下,无法存储爬取网 ...

- Visio制图之垮职能流程图

Visio制图中常用的一种就是带有不同职能,不同阶段的流程关系图. 下面是根据实际生产情况制作的一张“软件生产流程关系图”,供参考.

- Docker docker-compose安装

一.在服务器上敲下面命令即可,将需要的版本号修改一下即可 sudo curl -L "https://github.com/docker/compose/releases/download/ ...

- html5的audio实现高仿微信语音播放效果

效果图 前台大体呈现效果图如下: 点击就可以播放mp3格式的录音.点击另外一个录音,当前录音停止! 思路 关于播放动画,这个很简单,我们可以用css3的逐帧动画来实现.关于逐帧动画,我之前的文章也写过 ...

- day20 模块-sys,time,collection

所有常用模块的用法: http://www.cnblogs.com/Eva-J/articles/7228075.html 前情回顾: # 常用模块 # 常用模块 —— 东西多 # 异常处理 # 什 ...

- fastAdmin进阶

基本知识流程一栏链接 bootstrapTable fastadmin系统配置(符内置规则): fastadmin默认的controller已实现的方法 一张图解析fastadmin的表格: fast ...

- Python3.4+Django1.9+Bootstrap3

实现和原理 Python集成Django开发框架后,可以通过在cmd命令提示符下建立工程,工程名为learn_models 1 django-admin.py startproject learn_m ...

- Decision Trees:机器学习根据大量数据,已知年龄、收入、是否上海人、私家车价格的人,预测Ta是否有真实购买上海黄浦区楼房的能力—Jason niu

from sklearn.feature_extraction import DictVectorizer import csv from sklearn import tree from sklea ...

- win10下正确使用Sublime Text搭建python调试环境

pycharmt等IDE虽然用着爽,但毕竟在速度.资源上还是比较让人不爽的. 使用IDE无非是图个方便省事,特别是像我这种有些记性差的来说. IDE说起来方便于的几个地方就是: 1.语法颜色高亮 ...

- POJ 3281 Dining (拆点)【最大流】

<题目链接> 题目大意: 有N头牛,F种食物,D种饮料,每一头牛都有自己喜欢的食物和饮料,且每一种食物和饮料都只有一份,让你分配这些食物和饮料,问最多能使多少头牛同时获得自己喜欢的食物和饮 ...