Kafka设计解析(十九)Kafka consumer group位移重设

转载自 huxihx,原文链接 Kafka consumer group位移重设

本文阐述如何使用Kafka自带的kafka-consumer-groups.sh脚本随意设置消费者组(consumer group)的位移。需要特别强调的是, 这是0.11.0.0版本提供的新功能且只适用于新版本consumer。

在新版本之前,如果要为已有的consumer group调整位移必须要手动编写Java程序调用KafkaConsumer#seek方法,费时费力不说还容易出错。0.11.0.0版本丰富了kafka-consumer-groups脚本的功能,用户可以直接使用该脚本很方便地为已有的consumer group重新设置位移,但前提是:consumer group状态必须是inactive的,即不能是处于正在工作中的状态。

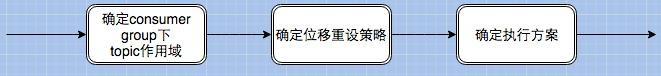

先务虚一下。总体来说,重设位移的流程由3步组成,如下图所示:

- 确定topic作用域——当前有3种作用域指定方式:--all-topics(为consumer group下所有topic的所有分区调整位移),--topic t1 --topic t2(为指定的若干个topic的所有分区调整位移),--topic t1:0,1,2(为指定的topic分区调整位移)

- 确定位移重设策略——当前支持8种设置规则:

- --to-earliest:把位移调整到分区当前最小位移

- --to-latest:把位移调整到分区当前最新位移

- --to-current:把位移调整到分区当前位移

- --to-offset <offset>: 把位移调整到指定位移处

- --shift-by N: 把位移调整到当前位移 + N处,注意N可以是负数,表示向前移动

- --to-datetime <datetime>:把位移调整到大于给定时间的最早位移处,datetime格式是yyyy-MM-ddTHH:mm:ss.xxx,比如2017-08-04T00:00:00.000

- --by-duration <duration>:把位移调整到距离当前时间指定间隔的位移处,duration格式是PnDTnHnMnS,比如PT0H5M0S

- --from-file <file>:从CSV文件中读取调整策略

- 确定执行方案——当前支持3种方案:

- 什么参数都不加:只是打印出位移调整方案,不具体执行

- --execute:执行真正的位移调整

- --export:把位移调整方案按照CSV格式打印,方便用户成csv文件,供后续直接使用

针对上面的8种策略,本文重点演示前面7种策略。

首先,我们创建一个测试topic,5个分区,并发送5,000,000条测试消息:

> bin/kafka-topics.sh --zookeeper localhost: --create --partitions --replication-factor --topic test Created topic "test". > bin/kafka-producer-perf-test.sh --topic test --num-records --throughput - --record-size --producer-props bootstrap.servers=localhost: acks=- records sent, 287760.5 records/sec (27.44 MB/sec), 75.7 ms avg latency, 317.0 max latency.

records sent, 308163.0 records/sec (29.39 MB/sec), 136.4 ms avg latency, 480.0 max latency.

records sent, 375529.9 records/sec (35.81 MB/sec), 58.2 ms avg latency, 600.0 max latency.

records sent, 319529.652352 records/sec (30.47 MB/sec), 86.33 ms avg latency, 600.00 ms max latency, ms 50th, ms 95th, ms 99th, ms .9th.

然后,启动一个console consumer程序,组名设置为test-group:

bin/kafka-console-consumer.sh --bootstrap-server localhost: --topic test --from-beginning --consumer-property group.id=test-group ..............

待运行一段时间后关闭consumer程序将group设置为inactive。现在运行kafka-consumer-groups.sh脚本首先确定当前group的消费进度:

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --describe

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION CURRENT-OFFSET LOG-END-OFFSET LAG CONSUMER-ID HOST CLIENT-ID

test consumer--8688633a-2f88-4c41-89ca-fd0cd6d19ec7 /127.0.0.1 consumer-

test consumer--8688633a-2f88-4c41-89ca-fd0cd6d19ec7 /127.0.0.1 consumer-

test consumer--8688633a-2f88-4c41-89ca-fd0cd6d19ec7 /127.0.0.1 consumer-

test consumer--8688633a-2f88-4c41-89ca-fd0cd6d19ec7 /127.0.0.1 consumer-

test consumer--8688633a-2f88-4c41-89ca-fd0cd6d19ec7 /127.0.0.1 consumer-

由上面输出可知,当前5个分区LAG列的值都是0,表示全部消费完毕。现在我们演示下如何重设位移。

1. --to-earliest

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --to-earliest --execute

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

上面输出表明,所有分区的位移都已经被重设为0

2. --to-latest

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --to-latest --execute

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

上面输出表明,所有分区的位移都已经被重设为最新位移,即1,000,000

3. --to-offset <offset>

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --to-offset --execute

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

上面输出表明,所有分区的位移都已经调整为给定的500000

4. --to-current

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --to-current --execute

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

输出表明所有分区的位移都已经被移动到当前位移(这个有点傻,因为位移距上一步没有变动)

5. --shift-by N

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --shift-by - --execute

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

输出表明所有分区的位移被移动到(500000 - 100000) = 400000处

6. --to-datetime

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --to-datetime --04T14::00.000

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

将所有分区的位移调整为2017年8月4日14:30之后的最早位移

7. --by-duration

bogon:kafka_0. huxi$ bin/kafka-consumer-groups.sh --bootstrap-server localhost: --group test-group --reset-offsets --all-topics --by-duration PT0H30M0S

Note: This will only show information about consumers that use the Java consumer API (non-ZooKeeper-based consumers). TOPIC PARTITION NEW-OFFSET

test

test

test

test

test

将所有分区位移调整为30分钟之前的最早位移。

Kafka设计解析(十九)Kafka consumer group位移重设的更多相关文章

- Kafka consumer group位移重设

本文阐述如何使用Kafka自带的kafka-consumer-groups.sh脚本随意设置消费者组(consumer group)的位移.需要特别强调的是, 这是0.11.0.0版本提供的新功能且只 ...

- Kafka设计解析(九)为何去掉replica.lag.max.messages参数

转载自 huxihx,原文链接 Kafka副本管理—— 为何去掉replica.lag.max.messages参数 在Kafka设计解析(二)Kafka High Availability (上)文 ...

- Kafka consumer group位移0ffset重设

本文阐述如何使用Kafka自带的kafka-consumer-groups.sh脚本随意设置消费者组(consumer group)的位移.需要特别强调的是, 这是0.11.0.0版本提供的新功能且只 ...

- Kafka设计解析(十三)Kafka消费组(consumer group)

转载自 huxihx,原文链接 Kafka消费组(consumer group) 一直以来都想写一点关于kafka consumer的东西,特别是关于新版consumer的中文资料很少.最近Kafka ...

- Kafka设计解析(四)Kafka Consumer设计解析

转载自 技术世界,原文链接 Kafka设计解析(四)- Kafka Consumer设计解析 目录 一.High Level Consumer 1. Consumer Group 2. High Le ...

- Kafka设计解析(十二)Kafka 如何读取offset topic内容 (__consumer_offsets)

转载自 huxihx,原文链接 Kafka 如何读取offset topic内容 (__consumer_offsets) 众所周知,由于Zookeeper并不适合大批量的频繁写入操作,新版Kafka ...

- Kafka设计解析(五)- Kafka性能测试方法及Benchmark报告

本文转发自Jason’s Blog,原文链接 http://www.jasongj.com/2015/12/31/KafkaColumn5_kafka_benchmark 摘要 本文主要介绍了如何利用 ...

- 揭秘Kafka高性能架构之道 - Kafka设计解析(六)

原创文章,同步首发自作者个人博客.转载请务必在文章开头处以超链接形式注明出处http://www.jasongj.com/kafka/high_throughput/ 摘要 上一篇文章<Kafk ...

- 流式处理的新贵 Kafka Stream - Kafka设计解析(七)

原创文章,转载请务必将下面这段话置于文章开头处. 本文转发自技术世界,原文链接 http://www.jasongj.com/kafka/kafka_stream/ Kafka Stream背景 Ka ...

随机推荐

- mongodb命令(持续更新)

$lt $lte $gt $gte< . <= . > . >= 1.分组求和db.collection.aggregate([{$group : {_id : null, s ...

- 通过ssh实现远程登陆服务器!

通过ssh实现远程登陆前提是服务器已经开启ssh服务,至于怎么开启,可以参看上一篇“Linux服务器开启ssh服务,实现ssh远程登陆!”! 使用ssh登陆时,输入主机(linux的ip地址),账号, ...

- AJAX的一些基础和AJAX的状态

大佬们,我又回来了,最近好几天都没写博客了,别问我干啥去了,我只是去围观奶茶妹变成抹茶妹而已 前几天我们一起封装了一个AJAX,那今天我们来说说AJAX的一些基础和AJAX的状态码 首先,啥是AJAX ...

- 【代码笔记】iOS-自定义loading

一,效果图. 二,工程图. 三, 代码. ViewController.h #import <UIKit/UIKit.h> //loading #import "GPLoadin ...

- windows下安装composer方法

composer是一个新崛起的PHP的依赖管理工具.官方安装方法见: 此处假定: (1)php安装目录为C:/php5.4 (2)php 安装目录已经加入PATH环境变量(这样就可以在命令行直接输入“ ...

- PHP-隐藏手机号中间四位

substr_replace('手机号', '****', 3, 4);

- css 单行/多行文字垂直居中问题

例子可以直接看这里http://www.zhangxinxu.com/study/200911/line-height-text-v-center.html 这篇文章中有一点点解释http://blo ...

- Oracle中Database Link的创建和Synonyms

在工作中我遇到过这样的一个问题,就是当我需要将远程主机上Oracle数据中某个表的数据copy到本地Oracle时,有多种方法可以实现.1.将所需要的数据导出到csv或其他格式的文档,复制到本地进行直 ...

- flutter tab切换页面防止重置

问题描述:TabBar 配合TabBarView切换页面,然后每个页面是一个listview加载数据,但是切换页面后listview的数据会被重置, 重新被加载了,解决办法使用 with Automa ...

- Maven入门详情

Maven的作用 在开发中,为了保证编译通过,我们会到处去寻找jar包,当编译通过了,运行的时候,却发现"ClassNotFoundException",我们想到的是,难道还差ja ...