scrapy框架学习(六)日志设置和数据存储

日志设置

CRITICAL : 严重错误

ERROR : 一般错误

WARNING : 警告

INFO : 一般的信息

DEBUG : 调试信息

默认的显示级别是DEBUG

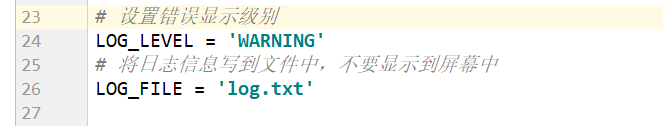

# 设置错误显示级别

LOG_LEVEL = 'DEBUG'

# 将日志信息写到文件中,不要显示到屏幕中

LOG_FILE = 'log.txt'

数据存储

在pipelines.py文件中创建3个函数

def open_spider(self,spider) 爬虫启动时会调用此方法

def close_spider(self,spider) 爬虫结束时会调用此方法

def download(self,item) 自己构建的下载文件的方法

# Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://docs.scrapy.org/en/latest/topics/item-pipeline.html # useful for handling different item types with a single interface

from itemadapter import ItemAdapter import json

import os

import urllib.request class MyfirstScrapydemoPipeline: #爬虫启动时会调用此方法

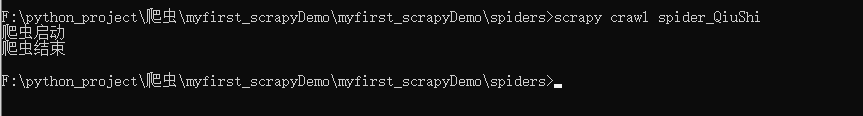

def open_spider(self,spider):

print('爬虫启动')

self.fp= open('qiushibaike.txt','w',encoding='utf8') def process_item(self, item, spider):

#下载头像图片

self.download(item)

#将数据转化为字典

obj= dict(item)

#将字典数据装换为json格式

string= json.dumps(obj,ensure_ascii=False)

#将数据写入文件

self.fp.write(string+'\n')

#不注释return item时只会下载第一页的头像

#return item def download(self,item):

#定义头像图片存放路径

dirpath= r'F:\python_project\爬虫\myfirst_scrapyDemo\myfirst_scrapyDemo\spiders\头像'

#获取每一张图片的名称

name= item['name']+'.jpg'

#拼接每一张头像图片的存储路径

filepath=os.path.join(dirpath,name)

#下载头像图片

urllib.request.urlretrieve(item['face_src'],filepath) # 爬虫结束时会调用此方法

def close_spider(self,spider):

print('爬虫结束')

self.fp.close()

scrapy框架学习(六)日志设置和数据存储的更多相关文章

- 自己的Scrapy框架学习之路

开始自己的Scrapy 框架学习之路. 一.Scrapy安装介绍 参考网上资料,先进行安装 使用pip来安装Scrapy 在开始菜单打开cmd命令行窗口执行如下命令即可 pip install Scr ...

- 爬虫入门(四)——Scrapy框架入门:使用Scrapy框架爬取全书网小说数据

为了入门scrapy框架,昨天写了一个爬取静态小说网站的小程序 下面我们尝试爬取全书网中网游动漫类小说的书籍信息. 一.准备阶段 明确一下爬虫页面分析的思路: 对于书籍列表页:我们需要知道打开单本书籍 ...

- scrapy框架学习之路

一.基础学习 - scrapy框架 介绍:大而全的爬虫组件. 安装: - Win: 下载:http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted pip3 ...

- Scrapy框架学习笔记

1.Scrapy简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网 ...

- scrapy框架学习

一.初窥Scrapy Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 可以应用在包括数据挖掘,信息处理或存储历史数据等一系列的程序中. 其最初是为了 页面抓取 (更确切来说, 网 ...

- Scrapy框架学习参考资料

00.Python网络爬虫第三弹<爬取get请求的页面数据> 01.jupyter环境安装 02.Python网络爬虫第二弹<http和https协议> 03.Python网络 ...

- Python3 Scrapy 框架学习

1.安装scrapy 框架 windows 打开cmd输入 pip install Scrapy 2.新建一个项目: 比如这里我新建的项目名为first scrapy startproject fir ...

- Scrapy框架学习 - 使用内置的ImagesPipeline下载图片

需求分析需求:爬取斗鱼主播图片,并下载到本地 思路: 使用Fiddler抓包工具,抓取斗鱼手机APP中的接口使用Scrapy框架的ImagesPipeline实现图片下载ImagesPipeline实 ...

- Scrapy框架学习(一)Scrapy框架介绍

Scrapy框架的架构图如上. Scrapy中的数据流由引擎控制,数据流的过程如下: 1.Engine打开一个网站,找到处理该网站的Spider,并向该Spider请求第一个要爬取得URL. 2.En ...

- Scrapy 框架 安装 五大核心组件 settings 配置 管道存储

scrapy 框架的使用 博客: https://www.cnblogs.com/bobo-zhang/p/10561617.html 安装: pip install wheel 下载 Twisted ...

随机推荐

- 系统提权之:Unix 提权

郑重声明: 本笔记编写目的只用于安全知识提升,并与更多人共享安全知识,切勿使用笔记中的技术进行违法活动,利用笔记中的技术造成的后果与作者本人无关.倡导维护网络安全人人有责,共同维护网络文明和谐. 系统 ...

- H5与原生APP调了交互方式

APP中不支持position:fixed; 改成 position:absolute; 触发H5按钮跳转APP原生页,进入调取APP的名传自己的方法 <a href="javascr ...

- Bouncy Castle密码算法库

Bouncy Castle密码算法库 一.开发背景 Bouncy Castle 是一种用于 Java 平台的开放源码的轻量级密码术包.它支持大量的密码术算法,并提供 JCE 1.2.1 的实现.因为 ...

- windows 10 更新代理

安装 Windows 更新 Windows 更新扫描.下载.安装,每一部分都采用独立的服务. Windows 更新客户端利用 Windows HTTP 服务(WinHTTP)扫描可用更新: Backg ...

- elasticsearch-8.6.1集群安装部署

elk官方下载地址:https://www.elastic.co/cn/downloads/ 1.创建普通用户及用户组 groupadd elasticsearch useradd elasticse ...

- tp-link路由器后台_硬解

title: 脚本_tp-link路由器后台_硬解 author: 杨晓东 permalink: 脚本 date: 2021-10-02 11:27:04 categories: - 投篮 tags: ...

- mybatis动态标签——trim

<?xml version="1.0" encoding="UTF-8" ?> <!DOCTYPE mapper PUBLIC "- ...

- Chisel项目中,添加了一个文件,新增了一个模块,但是却编译不出来相应的.v文件,什么原因?

回答:最可能的原因是你新增的模块是 DPI-C 模块,在 setInLine 那里指定的 .v 文件名指定错了 记得要修改指定的 .v 文件名,还要修改 verilog 模块的模块名

- Tensorflow1.0版本与以前函数不同之处

大部分是Api版本问题: AttributeError: 'module' object has no attribute 'SummaryWriter' tf.train.SummaryWriter ...

- Cisco ASA防火墙恢复密码和基本配置

Cisco ASA密码恢复 一.思路 Cisco ASA防火墙密码恢复,与路由器相似 修改寄存器的值,绕过startup-config配置文件 重新修改密码 恢复修改寄存器的值,保存配置 二.操作步骤 ...