php 爬虫采集

概述

现在爬虫技术算是一个普遍的技术了,各个语言的爬虫百家争鸣,但是根据笔者自己的感觉还是python是主流。爬虫涉及到太多的东西,笔者并不是专业的爬虫工程师,只不过个人兴趣分享一下。由于笔者是php工作,所以就使用php来进行简单爬虫。不过我的方法应该是很通用的,我相信java,C#等肯定有类似的函数,然后做法其实都一样了。

技术准备

看懂这段代码你需要对php的正则表达式函数以及正则表达式有一定的理解。

代码 注意实际代码就这么多

<?php

//这个是你网页正则匹配出来的字符串

$str = '<div class="title">

<h3><span>[小组] </span> <a href="链接内容1" target="_blank">标签内容1</a></h3>

<div class="info">

237059 成员

</div>

</div>

<div class="title">

<h3><span>[小组] </span> <a href="链接内容2" target="_blank">标签内容2</a></h3>

<div class="info">

237059 成员

</div>

</div>';

//这个是正则的输出结果

preg_match_all('/<div class="title">[\s\S]*?<h3>[\s\S]*?<a href="(.*?)"[\s\S]*?>(.*?)<\/a>/',$str,$match);

print_r($match);//根据打印的结果很明白了吧

//这个方法就是抓取网页内容的方法了可以吧需要抓取的页面传进去,然后正则匹配内容哦

function getUrlContent($url){//通过url获取html内容

$ch = curl_init();

curl_setopt($ch,CURLOPT_URL,$url);

curl_setopt($ch,CURLOPT_USERAGENT,"Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 6.1 )");

curl_setopt($ch,CURLOPT_HEADER,1);

curl_setopt($ch,CURLOPT_RETURNTRANSFER,1);

$output = curl_exec($ch);

curl_close($ch);

return $output;

}

?>

到这里就可以匹配你想要的数据了,如果还是不懂,就继续往下瞅瞅

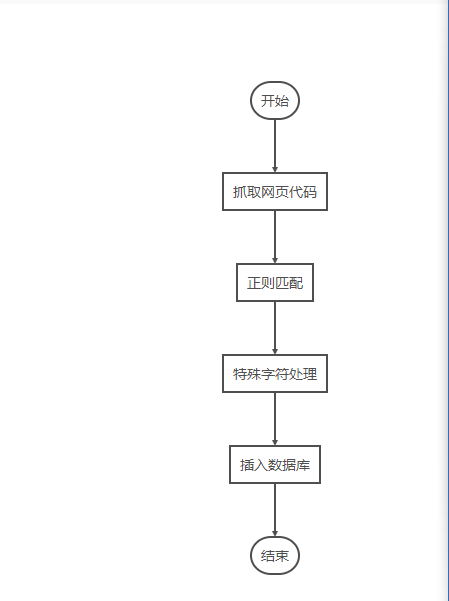

流程图

简单的爬虫,特殊字符处理就不进行了,保证插入数据库不出错就行了

思路

首先getUrlContent($url)函数,只需要穿一个url地址就行了,当然了因为各个网站都有反扒机制,不过笔者的这个函数并不是万能的,但是在豆瓣测试过,其他网站大家自行测试了。

任何网站都可以理解为一个很长的字符串,如果对html有研究无非就是:

<html>

<head>XXX</head>

<body>XXX</body>

</html>

我们需要的只是将body标签里的东西拿出来,笔者模拟了一段body里的代码

<html>

<head>XXX</head>

<body>

<div class="title">

<h3><span>[小组] </span> <a href="链接内容1" target="_blank">标签内容1</a></h3>

<div class="info">

237059 成员

</div>

</div>

<div class="title">

<h3><span>[小组] </span> <a href="链接内容2" target="_blank">标签内容2</a></h3>

<div class="info">

237059 成员

</div>

</div>

</body>

</html>

对于这段代码,可以理解为一个很长的字符串

$str = '<html>

<head>XXX</head>

<body>

<div class="title">

<h3><span>[小组] </span> <a href="链接内容1" target="_blank">标签内容1</a></h3>

<div class="info">

237059 成员

</div>

</div>

<div class="title">

<h3><span>[小组] </span> <a href="链接内容2" target="_blank">标签内容2</a></h3>

<div class="info">

237059 成员

</div>

</div>

</body>

</html>';

对这段字符串,只需要进行正则匹配拿出你想要的,假如需要a标签里的href与内容

preg_match_all('/<div class="title">[\s\S]*?<h3>[\s\S]*?<a href="(.*?)"[\s\S]*?>(.*?)<\/a>/',

$str,$match);

然后如果你不认识这段正则表达式还有preg_match_all函数,这里笔者就简单说下了,[\s\S]*?代表懒惰匹配任意字符,因为标签之间会用空格符换行符,这里又出现新问题什么叫懒惰匹配,简单来说就是匹配最少的内容。(.*?)代表非空字符,加括号的原因简单来说就是括号里的内容是你想要的,前面的[\s\S]*?匹配到的是一堆特殊符号,并没有什么作用,你不用把特殊符号记录下来,所以不加括号。

最后打印结果,也就是$match数组。

Array

(

[0] => Array

(

[0] => <div class="title">

<h3><span>[小组] </span> <a href="链接内容1" target="_blank">标签内容1</a>

[1] => <div class="title">

<h3><span>[小组] </span> <a href="链接内容2" target="_blank">标签内容2</a>

)

[1] => Array

(

[0] => 链接内容1

[1] => 链接内容2

)

[2] => Array

(

[0] => 标签内容1

[1] => 标签内容2

)

)

根据这个数组,需要什么自己遍历数组,然后拼装sql语句,插入到自己的数据库中即可。但是插入过程中可能会有一些单引号双引号捣乱,所以你用str_replace()把他们替换掉,或者加转义符号。

总结

只是针对php进行的简单爬虫,不过爬虫的思路我相信很多种语言都用得到。不过很多网站的内容是通过js返回的,或者需要登陆才能获取到数据,这些比较高级的部分,有兴趣的推荐自学python爬虫。

本文转载自https://blog.csdn.net/qq_35370923/article/details/82901220

php 爬虫采集的更多相关文章

- python爬虫采集

python爬虫采集 最近有个项目需要采集一些网站网页,以前都是用php来做,但现在十分流行用python做采集,研究了一些做一下记录. 采集数据的根本是要获取一个网页的内容,再根据内容筛选出需要的数 ...

- 利用Python网络爬虫采集天气网的实时信息—BeautifulSoup选择器

相信小伙伴们都知道今冬以来范围最广.持续时间最长.影响最重的一场低温雨雪冰冻天气过程正在进行中.预计,今天安徽.江苏.浙江.湖北.湖南等地有暴雪,局地大暴雪,新增积雪深度4-8厘米,局地可达10-20 ...

- 基于Python爬虫采集天气网实时信息

相信小伙伴们都知道今冬以来范围最广.持续时间最长.影响最重的一场低温雨雪冰冻天气过程正在进行中.预计,今天安徽.江苏.浙江.湖北.湖南等地有暴雪,局地大暴雪,新增积雪深度4-8厘米,局地可达10- ...

- 抖音爬虫教程,python爬虫采集反爬策略

一.爬虫与反爬简介 爬虫就是我们利用某种程序代替人工批量读取.获取网站上的资料信息.而反爬则是跟爬虫的对立面,是竭尽全力阻止非人为的采集网站信息,二者相生相克,水火不容,到目前为止大部分的网站都还是可 ...

- 去除爬虫采集到的\xa0、\u3000等字符

\xa0表示不间断空白符,爬虫中遇到它的概率不可谓不小,而经常和它一同出现的还有\u3000.\u2800.\t等Unicode字符串.单从对\xa0.\t.\u3000等含空白字符的处理来说,有以下 ...

- python爬虫采集网站数据

1.准备工作: 1.1安装requests: cmd >> pip install requests 1.2 安装lxml: cmd >> pip install lxml ...

- python爬虫-采集英语翻译

http://fanyi.baidu.com/?aldtype=85#en/zh/drughttp://fanyi.baidu.com/?aldtype=85#en/zh/cathttp://fa ...

- 编写python爬虫采集彩票网站数据,将数据写入mongodb数据库

1.准备工作: 1.1安装requests: cmd >> pip install requests 1.2 安装lxml: cmd >> pip install lxml ...

- Python爬虫——城市公交、地铁站点和线路数据采集

本篇博文为博主原创,转载请注明. 城市公交.地铁数据反映了城市的公共交通,研究该数据可以挖掘城市的交通结构.路网规划.公交选址等.但是,这类数据往往掌握在特定部门中,很难获取.互联网地图上有大量的信息 ...

随机推荐

- 搭建Samba服务器、多部门共享,互不干扰,超实用

案例二 实现不同的用户访问同一个共享目录具有不同的权限,便于管理和维护.基本上能满足一些企业用户的需求. 一. 需求 1. 某公司有3个大部门,分别为:人事行政部(HR).财务部(FM).技术支持部( ...

- 【转载】Linux进程间通信(六):共享内存 shmget()、shmat()、shmdt()、shmctl()

来源:https://www.cnblogs.com/52php/p/5861372.html 下面将讲解进程间通信的另一种方式,使用共享内存. 一.什么是共享内存 顾名思义,共享内存就是允许两个不相 ...

- 珠峰-6-http和http-server原理

???? websock改天研究下然后用node去搞. websock的实现原理. ##### 第9天的笔记内容. ## Header 规范 ## Http 状态码 - 101 webscoket 双 ...

- 关于responseType的值

http请求有个responseType, 用来设置返回值,默认是'',等同于text,数据格式的转换是浏览器处理的 我们还会用到json,buffer,blob json:是我们经常遇到后端返回的数 ...

- Solr系列4-SolrJ开发应用

1: Solr导入 1.1导入POM # Base Code Java org.apache.solr solr-solrj 8.4.0 # spring boot org.springframewo ...

- 皮皮家园干活~万元web前端系统班在线课程点击免费领取

点击添加群聊 今天在整理百度云盘里的资源,这几年累计了不少软件和教程. 在这特殊的时期里,先给大家分享一波.图片里的文件夹就是目录, 加入群聊免费领取 好资源就是要大家一起共享, 你们也不用到处在网上 ...

- 加速github访问速度

打开https://www.ipaddress.com/ 查询以下三个链接的DNS解析地址 github.com assets-cdn.github.com github.global.ssl.fas ...

- 使用Ajax时[object%20object] 报错的解决方案

踩坑经过 最近初学Ajax,当我想把Ajax应用到自己项目中的时候,没有达到理想的效果,还报了如下错误: 点击图中报错,产生报错页面如下: 当时写的Ajax如下: // 提交修改密码表单 $(&quo ...

- 牛客网剑指offer第13题——调整数组顺序使得奇数位于偶数前面

题目来源:剑指offer 题目: 输入一个整数数组,实现一个函数来调整该数组中数字的顺序,使得所有的奇数位于数组的前半部分,所有的偶数位于数组的后半部分,并保证奇数和奇数,偶数和偶数之间的相对位置不变 ...

- C#通过文件路径获取文件名

string fullPath = @"\WebSite1\Default.aspx"; string filename = System.IO.Path.GetFileName( ...