爬虫实战2_有道翻译sign破解

目标url 有道翻译

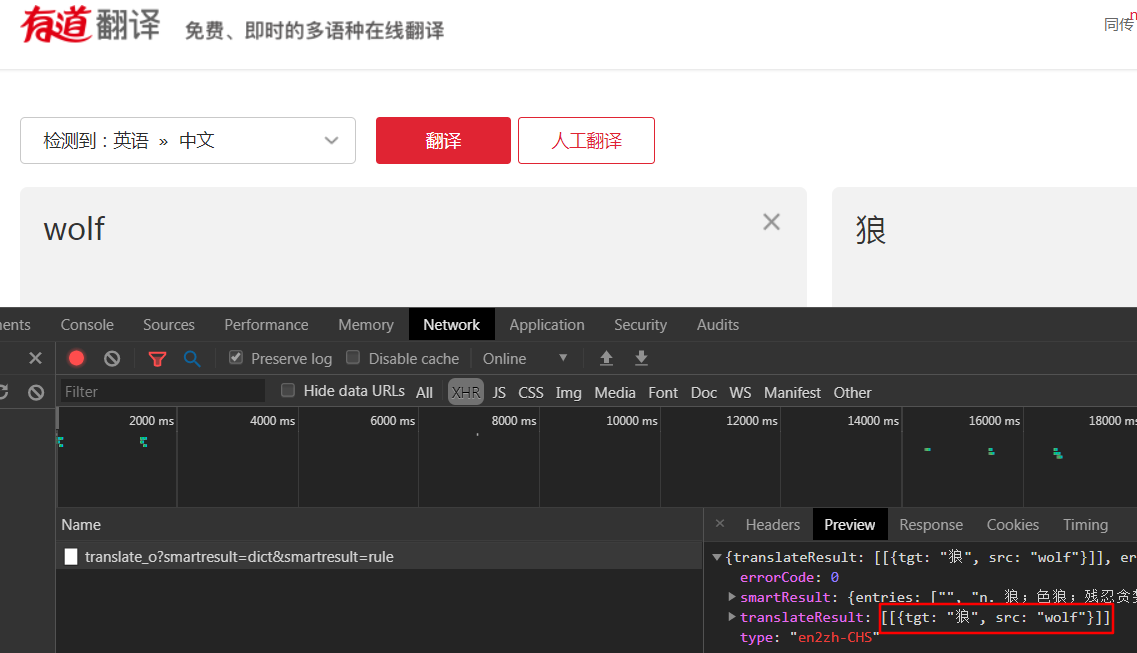

- 打开网站输入要翻译的内容,一一查找network发现数据返回json格式,红框就是我们的翻译结果

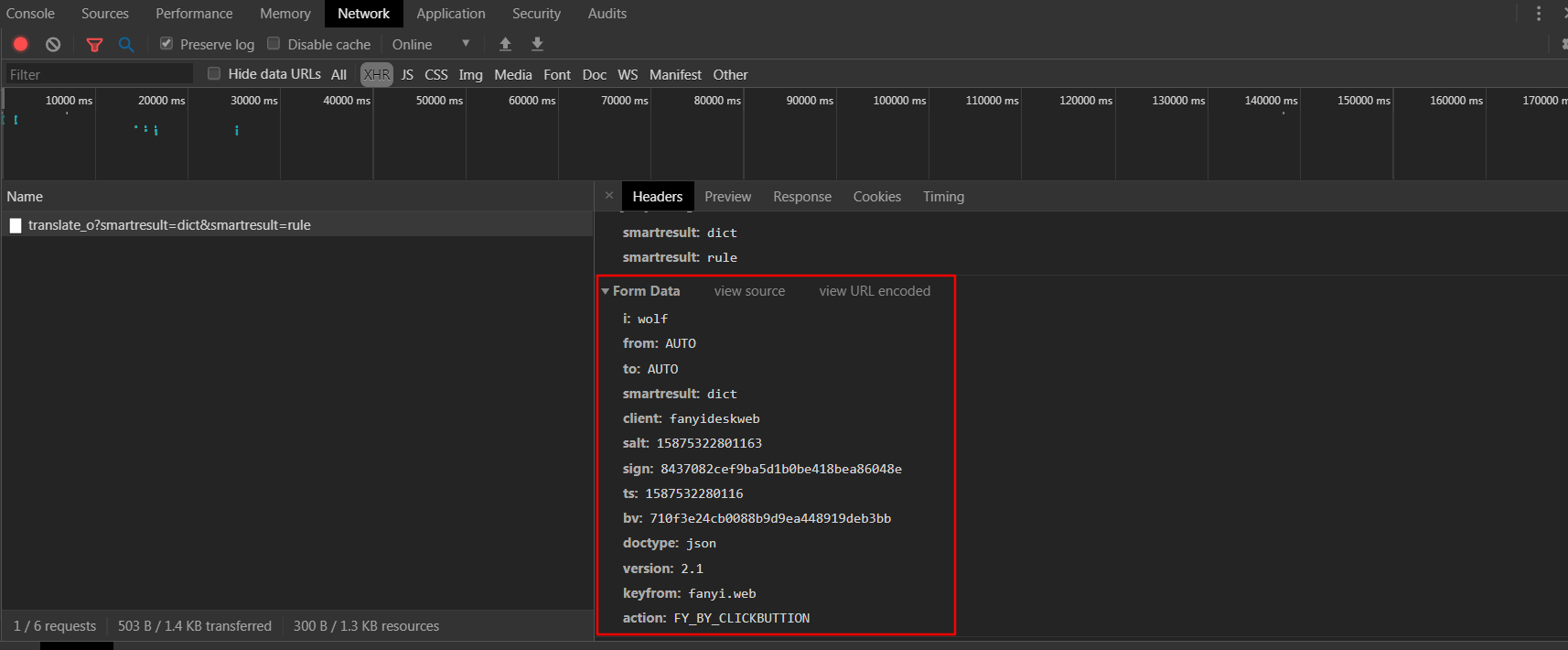

- 查看headers,发现返回结果的请求是post请求,且携带一大堆form_data,一一理下一表单数据

- i:要翻译的数据

- from、to:from to 表示从哪国语言翻译到哪国语言

- smartresult、doctype:返回结果的形式以字典形式

- client、keyfrom、action:区分客户端类型

- salt、sign、ts、bv:看起来不太友善,好像是反爬虫参数

- 观察ts参数为13整数字符串,大概率是当前时间戳取整

- salt比ts多出一位

- sign和bv都为32位字符串,可以推断为经过MD5加密的字符串

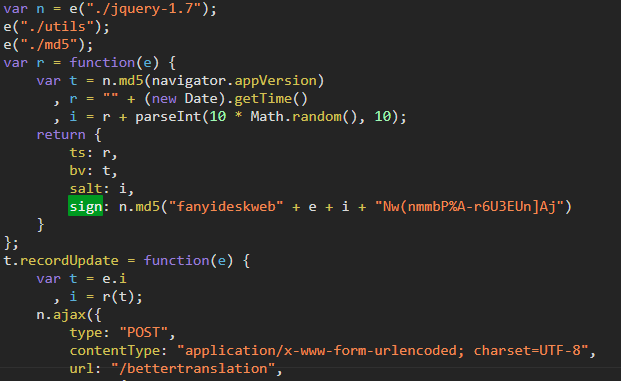

- 使用浏览器的search功能,发现sign藏在一个js文件中,搜索找到并点击

- 经过一番查找,发现这四位老铁是不是挺眼熟,没错,这个函数就是这四个参数的生成算法(js加密参数一般都是用客户端比如.py的参数参数生成算法和服务器端的参数生成算法比较,不是用参数直接比较,这点要注意)

既然已经找到,那我们就用python改写一个这段生成加密参数的js代码,我们把js代码复制到本地以方便改写Python代码

define("newweb/common/service", ["./utils", "./md5", "./jquery-1.7"], function(e, t) {

var n = e("./jquery-1.7");

e("./utils");

e("./md5");

var r = function(e) {

var t = n.md5(navigator.appVersion) # navigator.appVersion就是浏览器版本信息,User-Agent

, r = "" + (new Date).getTime() # 获取当前日期的整数字符串

, i = r + parseInt(10 * Math.random(), 10);

return {

ts: r,

bv: t,

salt: i,

sign: n.md5("fanyideskweb" + e + i + "Nw(nmmbP%A-r6U3EUn]Aj") # 这边的最后一个子串看起来像随机生成的(容易误导),可以在js代码里面打断点多试几遍发现是常量

}

};

def get_sign(self, key_word):

user_agent = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36'

# ts 为当前时间戳

ts = str(round(time()))

# salt 为ts拼接1-9之间的一个随机整数

salt = ts + str(randint(1 ,9))

# bv browser version 就是User-Agent进过md5加密的数据

bv = hashlib.md5(bytes(user_agent, encoding='utf-8')).hexdigest()

# sign 由四部分组成,起始和结尾的数据都是固定的,中间两个参数分别对应要翻译的对象和 salt

sign = hashlib.md5(bytes('fanyideskweb' + key_word + salt + 'Nw(nmmbP%A-r6U3EUn]Aj', encoding='utf-8')).hexdigest()

self.post_data['salt'] = salt

self.post_data['sign'] = sign

self.post_data['ts'] = ts

self.post_data['bv'] = bv

return self.post_data

- 接下来完事具备,我们就把我们的蜘蛛完善一下

#!/usr/bin/env python

# !@software: PyCharm

# !@coding:

# !@time: 2020/4/22 11:52

# !@author: xiaoma

import requests

from random import randint,sample

from time import time

import hashlib

class FanyiSpider(object):

def __init__(self, key_word):

self.key_word = key_word

self.base_url = 'http://fanyi.youdao.com/'

self.post_data = {

'i': self.key_word,

'from': 'AUTO',

'to': 'AUTO',

'smartresult': 'dict',

'client': 'fanyideskweb',

'salt': '',

'sign': '',

'ts': '',

'bv': '',

'doctype': 'json',

'version': '2.1',

'keyfrom': 'fanyi.web',

'action': 'FY_BY_CLICKBUTTION'

}

self.headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36',

'Referer': 'http://fanyi.youdao.com/'

}

self.session = requests.session()

def get_sign(self, key_word):

user_agent = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36'

# ts 为当前时间戳

ts = str(round(time()))

# salt 为ts拼接1-9之间的一个随机整数

salt = ts + str(randint(1 ,9))

# bv browser version 就是User-Agent进过md5加密的数据

bv = hashlib.md5(bytes(user_agent, encoding='utf-8')).hexdigest()

# sign 由四部分组成,起始和结尾的数据都是固定的,中间两个参数分别对应要翻译的对象和 salt

sign = hashlib.md5(bytes('fanyideskweb' + key_word + salt + 'Nw(nmmbP%A-r6U3EUn]Aj', encoding='utf-8')).hexdigest()

self.post_data['salt'] = salt

self.post_data['sign'] = sign

self.post_data['ts'] = ts

self.post_data['bv'] = bv

return self.post_data

def run(self): # 主要实现逻辑

# 1. 发送get请求

get_res = self.session.get(self.base_url, headers=self.headers)

# 2. 获取加密参数

post_data = self.get_sign(self.key_word)

# print(post_data)

# 3. 发送post,获取响应

post_res = self.session.post(self.base_url+'translate_o', headers=self.headers, data=post_data) # 注意:翻译的base_url和get请求的base_url有不一样的地方,记得拼接

# 4. 解析数据

print(post_res.json().get('translateResult')[0][0]['tgt'])

if __name__ == '__main__':

key_word = input("请输入想要翻译的内容>>>").strip()

youdao = FanyiSpider(key_word)

youdao.run()

爬虫实战2_有道翻译sign破解的更多相关文章

- 爬虫破解js加密(一) 有道词典js加密参数 sign破解

在爬虫过程中,经常给服务器造成压力(比如耗尽CPU,内存,带宽等),为了减少不必要的访问(比如爬虫),网页开发者就发明了反爬虫技术. 常见的反爬虫技术有封ip,user_agent,字体库,js加密, ...

- python爬虫-有道翻译-js加密破解

有道翻译-js加密破解 这是本地爬取的网址:http://fanyi.youdao.com/ 一.分析请求 我们在页面中输入:水果,翻译后的英文就是:fruit.请求携带的参数有很多,先将参数数据保存 ...

- 爬虫新手学习2-爬虫进阶(urllib和urllib2 的区别、url转码、爬虫GET提交实例、批量爬取贴吧数据、fidder软件安装、有道翻译POST实例、豆瓣ajax数据获取)

1.urllib和urllib2区别实例 urllib和urllib2都是接受URL请求相关模块,但是提供了不同的功能,两个最显著的不同如下: urllib可以接受URL,不能创建设置headers的 ...

- python3爬虫:利用urllib与有道翻译获得翻译结果

在实现这一功能时遇到了一些困难,由于按照<零基础入门python>中的代码无法实现翻译,会爆出“您的请求来源非法,商业用途使用请关注有道翻译API官方网站“有道智云”: http://ai ...

- java实现有道翻译爬虫

我的博文地址 https://www.cnblogs.com/lingdurebing/p/11618902.html 使用的库 1.commons-codec 主要是为了加密,可以直接用java原生 ...

- (未完成...)Python3网络爬虫(2):利用urllib.urlopen向有道翻译发送数据并获得翻译结果

环境: 火狐浏览器 pycharm2017.3.3 python3.5 1.url不仅可以是一个字符串,例如:http://www.baidu.com.url也可以是一个Request对象,这就需要我 ...

- 免费翻译API破解(简易翻译工具)

思路:选取有道翻译,用fiddler抓取接口请求信息,提取相关请求参数,破解加密部分. 主要请求数据: i :翻译文本 ts:时间戳 salt:ts +随机数 sign:加密信息,经过抓取信息,发现 ...

- tornado框架学习及借用有道翻译api做自动翻译页面

趁着这几天有时间,就简单的学了一下tornado框架,简单做了个自动翻译的页面 仅为自己学习参考,不作其他用途 文件夹目录结构如下: . ├── server.py ├── static │ └─ ...

- Python制作有道翻译小工具

该工具主要是利用了爬虫,爬取web有道翻译的内容. 然后利用简易GUI来可视化结果. 首先我们进入有道词典的首页,并点击翻译结果的审查元素 之后request响应网页,并分析网页,定位到翻译结果. 使 ...

随机推荐

- 死磕Lambda表达式(五):Comparator复合

给岁月以文明,而不是给文明以岁月.--<三体> 在上一篇文章(传送门)中介绍了JDK为我们提供的常用函数式接口,JDK不仅提供的这些函数式接口,其中一些接口还为我们提供了实用的默认方法,这 ...

- mysql两表合并,对一列数据进行处理

加班一时爽,一直加班~一直爽~ 欢迎收看http://www.996.icu/ 今天弄了下MySQL中两表合并的并且要处理一列数据,这列数据原来都是小写字母,处理时将这列数据改成驼峰命名的~~ 基本 ...

- python3读取excel实战

'''参数化'''import xlrd,xlwt,jsonfrom api实现.读取参数化接口说明 import TestApiclass ReadFileData: def __init__(se ...

- [HDU2072]单词数<字符串>

链接:http://acm.hdu.edu.cn/showproblem.php?pid=2072 Problem Description lily的好朋友xiaoou333最近很空,他想了一件没有什 ...

- JS 剑指Offer(五) 二叉树的重建

题目:输入某二叉树的前序遍历和中序遍历的结果,请重建该二叉树.假设输入的前序遍历和中序遍历的结果中都不含重复的数字. 题目分析:已知二叉树的前序和中序遍历,根据前序遍历和中序遍历的规则,前序遍历的第一 ...

- spring-cloud-gateway降级

前言 本文主要研究一下 spring cloud gateway 如何集成 hystrix. 当下游接口负载很大,或者接口不通等其他原因导致超时,如果接口不熔断的话将会影响到下游接口得不到喘息,网关也 ...

- CodeForces 6C(贪心 + 模拟)

题目链接 思路如下 贪心的思想,⚠️女士优先的策略,当它们吃掉之前的物品所用的时间相同的时候,此时女士先开始 继续吃 题解如下 #include<iostream> using names ...

- 在非主线程里面使用NSTimer创建和取消定时任务

为什么要在非主线程创建NSTimer 将 timer 添加到主线程的Runloop里面本身会增加线程负荷 如果主线程因为某些原因阻塞卡顿了,timer 定时任务触发的时间精度肯定也会受到影响 有些定时 ...

- 百度在PWA中阐述的弹性布局-[CSS]

原文链接 响应式布局 自从进入移动互联网时代,响应式布局这个词经常出现在 Web 设计和开发领域,它让 Web 页面在不同尺寸的设备上都具有良好的浏览体验. 开始之前 在讲解响应式布局之前,需要先了解 ...

- vue中使用阿里图标库iconfont和在旧有的iconfont中添加新的图标

第一步 下载样式http://www.iconfont.cn/选择图表,点击加入购物车 第二步 解压下载文件 第三步 修改文件名称 与 iconfont.css 名路径 第四步 将@font-face ...