sparkStream---1

1.本地scala版

import org.apache.spark._

import org.apache.spark.streaming._

import org.apache.spark.streaming.StreamingContext._ object SparkStreamingDemo {

def main(args: Array[String]): Unit = {

//local[n] n > 1

val conf = new SparkConf().setMaster("local[2]").setAppName("NetworkWordCount")

//创建Spark流上下文,批次时长是1s

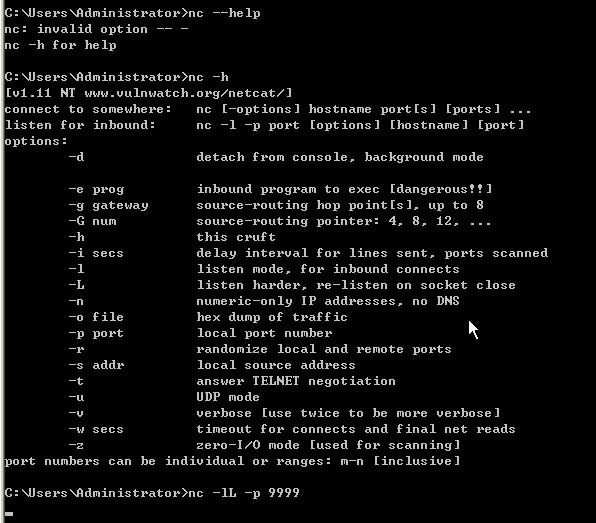

val ssc = new StreamingContext(conf, Seconds()) //创建socket文本流

val lines = ssc.socketTextStream("localhost", )

//压扁

val words = lines.flatMap(_.split(" "))

//变换成对偶

val pairs = words.map((_,)); val count = pairs.reduceByKey(_+_) ;

count.print() //启动

ssc.start() //等待结束

ssc.awaitTermination()

}

}

2.java版的,本地

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.Optional;

import org.apache.spark.api.java.function.FlatMapFunction;

import org.apache.spark.api.java.function.Function2;

import org.apache.spark.api.java.function.PairFunction;

import org.apache.spark.streaming.Seconds;

import org.apache.spark.streaming.api.java.JavaDStream;

import org.apache.spark.streaming.api.java.JavaPairDStream;

import org.apache.spark.streaming.api.java.JavaReceiverInputDStream;

import org.apache.spark.streaming.api.java.JavaStreamingContext;

import scala.Some;

import scala.Tuple2; import java.util.ArrayList;

import java.util.Iterator;

import java.util.List; /**

* Created by Administrator on 2017/4/3.

*/

public class JavaSparkStreamingWordCountApp {

public static void main(String[] args) throws Exception {

SparkConf conf = new SparkConf();

conf.setAppName("wc");

conf.setMaster("local[4]");

//创建Spark流应用上下文

JavaStreamingContext jsc = new JavaStreamingContext(conf, Seconds.apply()); jsc.checkpoint("file:///d:/scala/check");

//创建socket离散流

JavaReceiverInputDStream sock = jsc.socketTextStream("localhost",);

//压扁

JavaDStream<String> wordsDS = sock.flatMap(new FlatMapFunction<String,String>() {

public Iterator call(String str) throws Exception {

List<String> list = new ArrayList<String>() ;

String[] arr = str.split(" ");

for(String s : arr){

list.add(s);

}

return list.iterator();

}

}); //映射成元组

JavaPairDStream<String,Integer> pairDS = wordsDS.mapToPair(new PairFunction<String, String, Integer>() {

public Tuple2<String, Integer> call(String s) throws Exception {

return new Tuple2<String,Integer>(s,);

}

}) ; JavaPairDStream<String,Integer> jps = pairDS.updateStateByKey(new Function2<List<Integer>, Optional<Integer>, Optional<Integer>>() {

public Optional<Integer> call(List<Integer> v1, Optional<Integer> v2) throws Exception {

Integer newCount = v2.isPresent() ? v2.get() : ; System.out.println("old value : " + newCount);

for(Integer i : v1){

System.out.println("new value : " + i);

newCount = newCount + i;

}

return Optional.of(newCount);

}

}); //聚合

JavaPairDStream<String,Integer> countDS = jps.reduceByKey(new Function2<Integer, Integer, Integer>() {

public Integer call(Integer v1, Integer v2) throws Exception {

return v1 + v2;

}

}); //打印

countDS.print(); jsc.start(); jsc.awaitTermination(); jsc.stop();

}

}

3.集群跑。

将文件打成jar包,放到远程机器中

spark-submit --name wcstreaming

--class com.spark.java.JavaSparkStreamingWordCountApp

//上面是包名加类名

--master spark://s201:7077

SparkDemo1-1.0-SNAPSHOT.jar

sparkStream---1的更多相关文章

- SparkStream:4)foreachRDD详解

转载自:http://blog.csdn.net/jiangpeng59/article/details/53318761 foreachRDD通常用来把SparkStream运行得到的结果保存到外部 ...

- 064 SparkStream与kafka的集成,主要是编程

这里面包含了如何在kafka+sparkStreaming集成后的开发,也包含了一部分的优化. 一:说明 1.官网 指导网址:http://spark.apache.org/docs/1.6.1/st ...

- 060 SparkStream 的wordcount示例

1.SparkStream 入口:StreamingContext 抽象:DStream 2.SparkStreaming内部原理 当一个批次到达的时候,会产生一个rdd,这个rdd的数据就是这个批次 ...

- 059 SparkStream介绍

离线计算框架:MR,hive-->对时间要求不严格 实时计算框架:SparkCore-->要求job执行时间比较快 交互式计算框架:SparkSQL,Hive,-->提供SQL操作的 ...

- 九、sparkStream的scala示例

简介 sparkStream官网:http://spark.apache.org/docs/latest/streaming-programming-guide.html#overview spark ...

- Flume+kakfa+sparkStream实时处理数据测试

flume:从数据源拉取数据 kafka:主要起到缓冲从flume拉取多了的数据 sparkStream:对数据进行处理 一.flume拉取数据 1.源数据文件读取配置 在flume目录的 ...

- 记录下sparkStream的做法(scala)

一直用storm做实时流的开发,之前系统学过spark但是一直没做个模版出来用,国庆节有时间准备做个sparkStream的模板用来防止以后公司要用.(功能模拟华为日常需求,db入库hadoop环境) ...

- 【Spark篇】---SparkStream初始与应用

一.前述 SparkStreaming是流式处理框架,是Spark API的扩展,支持可扩展.高吞吐量.容错的实时数据流处理,实时数据的来源可以是:Kafka, Flume, Twitter, Zer ...

- 063 SparkStream数据接收方式

1.两种方式 2.Basic Source 由StreamingContext可以提供的API 上面做的wordcount中的方式就算是第一种方式. 3.Advanced Source 使用数据接收器 ...

- 062 SparkStream内部原理

1.DStream 内部是一系列的RDD组成的,每个RDD与RDD的产生时间形成一个pair保存在内存中(下面有) RDD包含了对应时间段的所有block数据. 2.DStream下的方法 /** T ...

随机推荐

- Web服务器主动推送技术

HTTP协议遵循经典的客户端-服务器模型,客户端发送一个请求,然后等待服务器端的响应,服务器端只能在接收到客户端的请求之后进行响应,不能主动的发送数据到客户端. 客户端想要在不刷新页面的情况下实时获取 ...

- 转: Javascript收藏

搜集的一些javascript小技巧! 事件源对象 event.srcElement.tagName event.srcElement.type 捕获释放 event.srcElement.set ...

- 极光推送出现 超时问题:Connect timeout. Please retry later. Error:7

检查之后均没有什么太大的问题, 最后发现出现77这种错误码,有一种可能就是系统的ca包没有更新 包名为 ca-certificates 使用命令 yum install ca-certificates ...

- windwos服务器 无法与本地电脑进行复制粘贴解决办法

之前复制粘贴功能可以使用 现在突然间不能使用了 1.打开任务管理器,查看进程,如果有 rdpclip.exe 进程,先关闭该进程2.开始->运行->rdpclip.exe,重新运行此程序 ...

- Unknown initial character set index '255' received from server. Initial client character 解决方法

Unknown initial character set index '255' received from server. Initial client character set can be ...

- Java8-Annotations

import java.lang.annotation.ElementType; import java.lang.annotation.Repeatable; import java.lang.an ...

- 函数对话框confirm()

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- HDU 6156 - Palindrome Function [ 数位DP ] | 2017 中国大学生程序设计竞赛 - 网络选拔赛

普通的数位DP计算回文串个数 /* HDU 6156 - Palindrome Function [ 数位DP ] | 2017 中国大学生程序设计竞赛 - 网络选拔赛 2-36进制下回文串个数 */ ...

- luogu 2272

Tarjan 缩点 拓扑排序 套路题

- [Luogu] 借教室

https://www.luogu.org/problemnew/show/P1083 二分第i天不满足 前缀和 + 差分判断 #include <iostream> #include & ...