吴恩达Machine Learning学习笔记(一)

机器学习的定义

A computer program is said to learn from experience E with respect to some class of tasks T and performance measure P, if its performance at tasks in T, as measured by P, improves with experience E.

某类任务T(task)具有性能度量P(performance),计算机程序可以从任务T的经验E(experience)中学习,提高性能P。

机器学习的种类

主要分为监督学习和无监督学习两大类

监督学习--Supervised Learning

特点:已有输入特征向量x,并已知正确的输出(有标签)y (x,y)称为一个训练样本

目标:学习到从输入到输出的映射

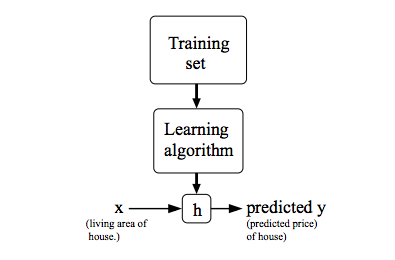

过程:给定训练集,学习函数(又称假设)h:X->Y,使得h(x)是y的一个好的预测

算法模型

分类--输出为离散值

回归--输出为连续值

解决问题的过程

问题的模型表示->损失函数->最小化损失函数->更新参数

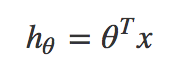

以线性回归为例,模型为

损失函数

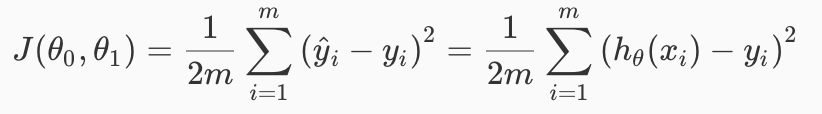

通过损失函数来衡量假设的准确率accuracy

常用损失函数:均方误差

梯度下降算法

梯度的反方向是函数下降最快的方向

学习速率

参数需要同步更新,不能异步更新

可能会收敛于局部值

迭代方法:batch gradient descent--每次迭代都使用所有样本进行计算

stochastic gradient descent(SGD)--每次只训练一个样本去更新参数。加快收敛速度,解决大数据量无法一次性塞入内存(显存)的问题

mini-batch gradient descent--每次使用batch_size个样本进行计算,是以上两种方法的折中

无监督学习--Unsupervised Learning

特点:输出的结果未知(无标签)

适用问题:聚类

吴恩达Machine Learning学习笔记(一)的更多相关文章

- 吴恩达Machine Learning学习笔记(二)--多变量线性回归

回归任务 多变量线性回归 公式 h为假设,theta为模型参数(代表了特征的权重),x为特征的值 参数更新 梯度下降算法 影响梯度下降算法的因素 (1)加速梯度下降:通过让每一个输入值大致在相同的范围 ...

- 吴恩达Machine Learning学习笔记(四)--BP神经网络

解决复杂非线性问题 BP神经网络 模型表示 theta->weights sigmoid->activation function input_layer->hidden_layer ...

- 吴恩达Machine Learning学习笔记(三)--逻辑回归+正则化

分类任务 原始方法:通过将线性回归的输出映射到0-1,设定阈值来实现分类任务 改进方法:原始方法的效果在实际应用中表现不好,因为分类任务通常不是线性函数,因此提出了逻辑回归 逻辑回归 假设表示--引入 ...

- 吴恩达Machine Learning 第一周课堂笔记

1.Introduction 1.1 Example - Database mining Large datasets from growth of automation/ ...

- 吴恩达课后作业学习1-week4-homework-two-hidden-layer -1

参考:https://blog.csdn.net/u013733326/article/details/79767169 希望大家直接到上面的网址去查看代码,下面是本人的笔记 两层神经网络,和吴恩达课 ...

- 吴恩达课后作业学习1-week4-homework-multi-hidden-layer -2

参考:https://blog.csdn.net/u013733326/article/details/79767169 希望大家直接到上面的网址去查看代码,下面是本人的笔记 实现多层神经网络 1.准 ...

- 吴恩达课后作业学习2-week1-1 初始化

参考:https://blog.csdn.net/u013733326/article/details/79847918 希望大家直接到上面的网址去查看代码,下面是本人的笔记 初始化.正则化.梯度校验 ...

- 吴恩达课后作业学习2-week1-2正则化

参考:https://blog.csdn.net/u013733326/article/details/79847918 希望大家直接到上面的网址去查看代码,下面是本人的笔记 4.正则化 1)加载数据 ...

- [Machine Learning]学习笔记-Logistic Regression

[Machine Learning]学习笔记-Logistic Regression 模型-二分类任务 Logistic regression,亦称logtic regression,翻译为" ...

随机推荐

- pandas参数设置小技巧

在日常使用pandas的过程中,由于我们所分析的数据表规模.格式上的差异,使得同样的函数或方法作用在不同数据上的效果存在差异. 而pandas有着自己的一套参数设置系统,可以帮助我们在遇到不同的数据时 ...

- 如何加速github下载速度

第一步 魔法 第二步 git config --global http.proxy http://127.0.0.1:1080 git config --global https.proxy http ...

- 结对项目:四则运算(C语言)

github地址:https://github.com/nilonger/arithmetic 结对伙伴:杨锐龙+黄海钊 一.项目要求 1.1 题目:实现一个自动生成小学四则运算题目的命令行程序(也可 ...

- Python1--简介及基础语法

0. 简介 Python易于学习的编程语言,有很多现成的第三方库可以调用,不用重复造轮子,老话说:"人生苦短,我用 Python" 1. 安装Python Mac:brew ins ...

- Java中的判断实例

.getClass().getName() 这是最常见的一种判断类型的方法 instanceof 用于判断 对象 是否为某个类的实例 Boolean值 各种is方法 isAnnotationPrese ...

- Windows Server 2012 数据库定时备份

为了数据的安全,我们在服务器上设置了每周备份一次,下面是具体步骤: 一.在文件客户端服务器创建db_backup.cmd的Windows命令脚本.输入以下内容(直接复制可能出错,请手动输入): @ec ...

- Alink漫谈(二十) :卡方检验源码解析

Alink漫谈(二十) :卡方检验源码解析 目录 Alink漫谈(二十) :卡方检验源码解析 0x00 摘要 0x01 背景概念 1.1 假设检验 1.2 H0和H1是什么? 1.3 P值 (P-va ...

- 【Android】Android开发初学者实现拨打电话的功能,拨打电话app小demo实现

作者:程序员小冰,GitHub主页:https://github.com/QQ986945193 新浪微博:http://weibo.com/mcxiaobing 首先先给大家看一下最终实现的效果: ...

- Oracle 11G R2安装说明 -九五小庞

教程版本Oracle 11.2.0.1.0

- ICARUS主题美化

Icarus用户指南 - 主题美化 Icarus的主题样式编码文件为themes/icarus/layout/layout.jsx. 此文件定义了站点全局的样式设置.本文详细介绍了本主题针对文章分类的 ...