获取kafka最新offset-java

之前笔者曾经写过通过scala的方式获取kafka最新的offset

但是大多数的情况我们需要使用java的方式进行获取最新offset

scala的方式可以参考: http://www.cnblogs.com/weishao-lsv/p/8159396.html

以下是通过java代码获取kafka最新offset

GetOffsetShellWrap

public class GetOffsetShellWrap {

private static Logger log = LoggerFactory.getLogger(GetOffsetShellWrap.class);

private String topic;

private int port;

private String host;

private int time;

public GetOffsetShellWrap(String topic,int port,String host,int time) {

this.topic = topic;

this.port = port;

this.host = host;

this.time = time;

}

public Map<String, String> getEveryPartitionMaxOffset() {

//1.获取topic所有分区 以及每个分区的元数据 => 返回 Map<分区id,分区元数据>

TreeMap<Integer, PartitionMetadata> partitionIdAndMeta = findTopicEveryPartition();

Map<String, String> map = new HashMap<String, String>();

for (Entry<Integer, PartitionMetadata> entry : partitionIdAndMeta.entrySet()) {

int leaderPartitionId = entry.getKey();

//2.根据每个分区的元数据信息 ==> 获取leader分区的主机

String leadBroker = entry.getValue().leader().host();

String clientName = "Client_" + topic + "_" + leaderPartitionId;

SimpleConsumer consumer = new SimpleConsumer(leadBroker, port,100000, 64 * 1024, clientName);

//3.从leader主机获取分区的offset

long readOffset = getLastOffset(consumer, topic, leaderPartitionId, clientName);

map.put(String.valueOf(leaderPartitionId), String.valueOf(readOffset));

if (consumer != null)

consumer.close();

}

return map;

}

private TreeMap<Integer, PartitionMetadata> findTopicEveryPartition(){

TreeMap<Integer, PartitionMetadata> map = new TreeMap<Integer, PartitionMetadata>();

SimpleConsumer consumer = null;

try {

consumer = new SimpleConsumer(host, port, 100000, 64 * 1024,"leaderLookup" + new Date().getTime());

List<String> topics = Collections.singletonList(topic);

TopicMetadataRequest req = new TopicMetadataRequest(topics);

kafka.javaapi.TopicMetadataResponse resp = consumer.send(req);

List<TopicMetadata> metaData = resp.topicsMetadata();

if(metaData!=null && !metaData.isEmpty()){

TopicMetadata item = metaData.get(0);

for (PartitionMetadata part : item.partitionsMetadata()) {

map.put(part.partitionId(), part);

}

}

} catch (Exception e) {

e.printStackTrace();

} finally {

if (consumer != null)

consumer.close();

}

return map;

}

private long getLastOffset(SimpleConsumer consumer, String topic,int leaderPartitionId, String clientName) {

TopicAndPartition topicAndPartition = new TopicAndPartition(topic,leaderPartitionId);

Map<TopicAndPartition, PartitionOffsetRequestInfo> requestInfo = new HashMap<TopicAndPartition, PartitionOffsetRequestInfo>();

requestInfo.put(topicAndPartition, new PartitionOffsetRequestInfo(time, 1));

kafka.javaapi.OffsetRequest request = new kafka.javaapi.OffsetRequest(requestInfo, kafka.api.OffsetRequest.CurrentVersion(),clientName);

OffsetResponse response = consumer.getOffsetsBefore(request);

if (response.hasError()) {

log.error("Error fetching data Offset Data the Broker. Reason: "+ response.errorCode(topic, leaderPartitionId));

return 0;

}

long[] offsets = response.offsets(topic, leaderPartitionId);

return offsets[0];

}

}

GetOffsetShellWrapJavaTest

public class GetOffsetShellWrapJavaTest {

public static void main(String[] args) {

int port = 9092;

String topic = "2017-11-6-test";

int time = -1;

GetOffsetShellWrap offsetSearch = new GetOffsetShellWrap(topic,port,"hadoop-01",time);

Map<String, String> map = offsetSearch.getEveryPartitionMaxOffset();

for (String key : map.keySet()) {

System.out.println(key+"---"+map.get(key));

}

}

}

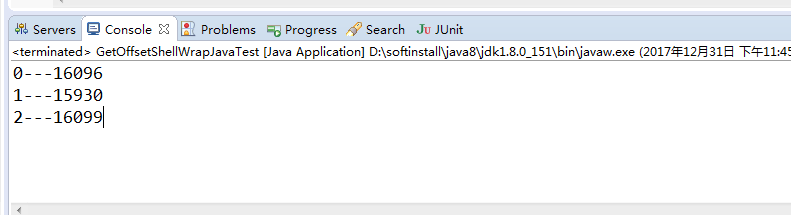

结果输出:

0---16096 1---15930 2---16099

获取kafka最新offset-java的更多相关文章

- 获取kafka最新offset-scala

无论是在spark streaming消费kafka,或是监控kafka的数据时,我们经常会需要知道offset最新情况 kafka数据的topic基于分区,并且通过每个partition的主分区可以 ...

- sparkStreaming获取kafka数据(java版本)

环境 spark-2.2.0 kafka_2.11-0.10.0.1 jdk1.8 配置好jdk,创建项目并将kafka和spark的jar包添加到项目中,除此之外还需要添加spark-streami ...

- 工具篇-Spark-Streaming获取kafka数据的两种方式(转载)

转载自:https://blog.csdn.net/weixin_41615494/article/details/7952173 一.基于Receiver的方式 原理 Receiver从Kafka中 ...

- Spark-Streaming获取kafka数据的两种方式:Receiver与Direct的方式

简单理解为:Receiver方式是通过zookeeper来连接kafka队列,Direct方式是直接连接到kafka的节点上获取数据 Receiver 使用Kafka的高层次Consumer API来 ...

- SparkStreaming获取kafka数据的两种方式:Receiver与Direct

简介: Spark-Streaming获取kafka数据的两种方式-Receiver与Direct的方式,可以简单理解成: Receiver方式是通过zookeeper来连接kafka队列, Dire ...

- spark-streaming获取kafka数据的两种方式

简单理解为:Receiver方式是通过zookeeper来连接kafka队列,Direct方式是直接连接到kafka的节点上获取数据 一.Receiver方式: 使用kafka的高层次Consumer ...

- 获取Kafka每个分区最新Offset的几种方法

目录 脚本方法 Java 程序 参考资料 脚本方法 ./bin/kafka-run-class.sh kafka.tools.GetOffsetShell --broker-list localhos ...

- 关于怎么获取kafka指定位置offset消息(转)

1.在kafka中如果不设置消费的信息的话,一个消息只能被一个group.id消费一次,而新加如的group.id则会被“消费管理”记录,并指定从当前记录的消息位置开始向后消费.如果有段时间消费者关闭 ...

- 如何获取流式应用程序中checkpoint的最新offset

对于流式应用程序,保证应用7*24小时的稳定运行,是非常必要的.因此对于计算引擎,要求必须能够适应与应用程序逻辑本身无关的问题(比如driver应用失败重启.网络问题.服务器问题.JVM崩溃等),具有 ...

随机推荐

- C++ std::vector 总结笔记

Initialization #include<iostream> #include<vector> using namespace std; int main() { vec ...

- java 实现 图片与byte 数组互相转换

package webgate; import java.awt.image.BufferedImage; import java.io.ByteArrayInputStream; import ja ...

- StyleBundle打包问题—— /* 未能缩小。正在返回未缩小的内容。

问题--查看打包发布的结果,类似下面的这样的 /* 未能缩小.正在返回未缩小的内容. (1567,65): run-time error CSS1054: JavaScript error in ex ...

- 1.关于python 的hmac加密

import base64 import hmac import urllib from hashlib import sha1 expires = b" # 过期时间戳 uuid = 'a ...

- 20180804 excel规划求解。。。

把一个已经变量更出数据去求解

- ThoughtWorks.QRCode 生成二维码名片(实现二维码内容换行)

最近在写一个很简单的功能,按照Vcard的格式,生成二维码名片.本来以为分分钟完事的事情,替换数据,直接调用dll去生成二维码. 测试时,发现生成的二维码使用微信扫描得到的名片信息为空,反向解析发现, ...

- DevExpress.XtraGrid.Views.Grid.GridView

private void SetView() { GridView gridView = (GridView)this.DefaultView; if (gridView != null) { gri ...

- 2018百度之星B轮 degree

degree Accepts: 1581 Submissions: 3494 Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 131072/1 ...

- 我的docker笔记

下面的链接全部是我在CSDN的关于docker的博文,我认为已经很是详细了,没有再次总结的必要性,特给出链接地址 docker容器技术基础 https://blog.csdn.net/zisefeiz ...

- Spring Cloud Stream教程(四)消费群体

虽然发布订阅模型可以轻松地通过共享主题连接应用程序,但通过创建给定应用程序的多个实例来扩展的能力同样重要.当这样做时,应用程序的不同实例被放置在竞争的消费者关系中,其中只有一个实例预期处理给定消息. ...