Spark入门之环境搭建

本教程是虚拟机搭建Spark环境和用idea编写脚本

一、前提准备

需要已经有搭建好的虚拟机环境,具体见教程大数据学习之路又之从小白到用sqoop导出数据 - 我试试这个昵称好使不 - 博客园 (cnblogs.com)

需要已经安装了idea或着eclipse(教程以idea为例)

二、环境搭建

1、下载Spark安装包(我下载的 spark-3.0.1-bin-hadoop2.7.tgz)

下载地址Scala 2.12.8 | The Scala Programming Language (scala-lang.org)

2、上传到虚拟机并解压(没备注就是主节点运行)

tar -zxvf spark-3.0.1-bin-hadoop2.7.tgz

3、修改权限

chown -R hadoop /export/server/spark-3.0.1-bin-hadoop2.7 chgrp -R hadoop /export/server/spark-3.0.1-bin-hadoop2.7

4、创建软连接

ln -s /export/server/spark-3.0.1-bin-hadoop2.7 /export/server/spark

5、启动spark交互式窗口

/export/server/spark/bin/spark-shell

还是很炫酷的哈哈哈,出现这个说明spark环境就搭建好了吗?漏!!!

6、配置Spark集群

cd /export/server/spark/conf mv slaves.template slaves vim slaves

添加

node02 node03 node04

7.配置master

cd /export/server/spark/conf mv spark-env.sh.template spark-env.sh vim spark-env.sh

增加如下内容:

## 设置JAVA安装目录

JAVA_HOME=/linmob/install/jdk1.8.0_141 ## HADOOP软件配置文件目录,读取HDFS上文件和运行Spark在YARN集群时需

要,先提前配上

HADOOP_CONF_DIR=/linmob/install/hadoop-3.1.4/etc/hadoop

YARN_CONF_DIR=/linmob/install/hadoop-3.1.4/etc/hadoop ## 指定spark老大Master的IP和提交任务的通信端口

#SPARK_MASTER_HOST=node01

SPARK_MASTER_PORT=7077 SPARK_MASTER_WEBUI_PORT=8080 SPARK_WORKER_CORES=1

SPARK_WORKER_MEMORY=1g SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=node01:2181,node02:2181,node03:2181,node04:2181 -Dspark.deploy.zookeeper.dir=/spark-ha" ## 配置spark历史日志存储地址

SPARK_HISTORY_OPTS="-Dspark.history.fs.logDirectory=hdfs://node01:8020/sparklog/ -Dspark.history.fs.cleaner.enabled=true"

8、将配置好的将 Spark 安装包分发给集群中其它机器,命令如下:

cd /export/server/ scp -r spark-3.0.1-bin-hadoop2.7 hadoop@node02:$PWD scp -r spark-3.0.1-bin-hadoop2.7 hadoop@node03:$PWD scp -r spark-3.0.1-bin-hadoop2.7 hadoop@node04:$PWD

9、创建软连接(每个节点都运行一遍)

ln -s /export/server/spark-3.0.1-bin-hadoop2.7 /export/server/spark

10、配置Yarn历史服务器并关闭资源检查

vim /export/server/hadoop/etc/hadoop/yarn-site.xml

少的部分补上

<configuration>

<!-- 配置yarn主节点的位置 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>node01</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 设置yarn集群的内存分配方案 -->

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>20480</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

<!-- 开启日志聚合功能 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 设置聚合日志在hdfs上的保存时间 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

<!-- 设置yarn历史服务器地址 -->

<property>

<name>yarn.log.server.url</name>

<value>http://node1:19888/jobhistory/logs</value>

</property>

<!-- 关闭yarn内存检查 -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

</configuration>

注意:如果之前没有配置,现在配置了需要分发并重启yarn(重启需要每个节点都运行)

cd /export/server/hadoop/etc/hadoop scp -r yarn-site.xml hadoop@node02:$PWD scp -r yarn-site.xml hadoop@node03:$PWD

scp -r yarn-site.xml hadoop@node04:$PWD /export/server/hadoop/sbin/stop-yarn.sh /export/server/hadoop/sbin/start-yarn.sh

11、配置Spark的历史服务器和Yarn的整合

cd /export/server/spark/conf mv spark-defaults.conf.template spark-defaults.conf vim spark-defaults.conf

添加

spark.eventLog.enabled true

spark.eventLog.dir hdfs://node01:8020/sparklog/

spark.eventLog.compress true

spark.yarn.historyServer.address node01:18080

手动创建

hadoop fs -mkdir -p /sparklog

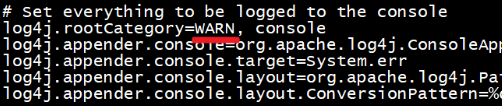

12、修改日志级别

cd /export/server/spark/conf mv log4j.properties.template log4j.properties vim log4j.properties

修改

分发-可选,如果只在node1上提交spark任务到yarn,那么不需要分发

cd /export/server/spark/conf scp -r spark-env.sh hadoop@node02:$PWD scp -r spark-env.sh hadoop@node03:$PWD scp -r spark-env.sh hadoop@node04:$PWD scp -r spark-defaults.conf hadoop@node02:$PWD scp -r spark-defaults.conf hadoop@node03:$PWD scp -r spark-defaults.conf hadoop@node04:$PWD scp -r log4j.properties hadoop@node02:$PWD scp -r log4j.properties hadoop@node03:$PWD scp -r log4j.properties hadoop@node04:$PWD

13、配置依赖的Spark的jar包

hadoop fs -mkdir -p /spark/jars/ hadoop fs -put /export/server/spark/jars/* /spark/jars/ vim /export/server/spark/conf/spark-defaults.conf

添加内容

spark.yarn.jars hdfs://node1:8020/spark/jars/*

分发同步-可选

cd /export/server/spark/conf scp -r spark-defaults.conf hadoop@node02:$PWD scp -r spark-defaults.conf hadoop@node03:$PWD scp -r spark-defaults.conf hadoop@node04:$PWD

14、启动服务

- 启动HDFS和YARN服务,在主节点上启动spark集群

/export/server/spark/sbin/start-all.sh

-启动MRHistoryServer服务,在node01执行命令

mr-jobhistory-daemon.sh start historyserver

- 启动Spark HistoryServer服务,,在node01执行命令

/export/server/spark/sbin/start-history-server.sh

15、测试

看下个博客Spark入门之idea编写Scala脚本 - 我试试这个昵称好使不 - 博客园 (cnblogs.com)

三、总结:

在主节点上启动spark集群 /export/server/spark/sbin/start-all.sh 在主节点上停止spark集群 /export/server/spark/sbin/stop-all.sh

spark: 4040 任务运行web-ui界面端口

spark: 8080 spark集群web-ui界面端口

spark: 7077 spark提交任务时的通信端口

hadoop: 50070集群web-ui界面端口

hadoop:8020/9000(老版本) 文件上传下载通信端口

Spark入门之环境搭建的更多相关文章

- Hadoop+Spark:集群环境搭建

环境准备: 在虚拟机下,大家三台Linux ubuntu 14.04 server x64 系统(下载地址:http://releases.ubuntu.com/14.04.2/ubuntu-14.0 ...

- 【个人笔记】003-PHP基础-01-PHP快速入门-03-PHP环境搭建

003-PHP基础-01-PHP快速入门 03-PHP环境搭建 1.客户端(浏览器) IE FireFox CHROME Opera Safari 2.服务器 是运行网站的基本 是放置程序代码的地方 ...

- Android入门之环境搭建

欢迎访问我的新博客:http://www.milkcu.com/blog/ 原文地址:http://www.milkcu.com/blog/archives/1376935560.html 原创:An ...

- spark JAVA 开发环境搭建及远程调试

spark JAVA 开发环境搭建及远程调试 以后要在项目中使用Spark 用户昵称文本做一下聚类分析,找出一些违规的昵称信息.以前折腾过Hadoop,于是看了下Spark官网的文档以及 github ...

- scala 入门Eclipse环境搭建

scala 入门Eclipse环境搭建及第一个入门经典程序HelloWorld IDE选择并下载: scala for eclipse 下载: http://scala-ide.org/downloa ...

- Spark+IDEA单机版环境搭建+IDEA快捷键

1. IDEA中配置Spark运行环境 请参考博文:http://www.cnblogs.com/jackchen-Net/p/6867838.html 3.1.Project Struct查看项目的 ...

- 新手嘛,先学习下 Vue2.0 新手入门 — 从环境搭建到发布

Vue2.0 新手入门 — 从环境搭建到发布 转自:http://www.runoob.com/w3cnote/vue2-start-coding.html 具体文章详细就不搬了,步骤可过去看,我这就 ...

- Spark 集群环境搭建

思路: ①先在主机s0上安装Scala和Spark,然后复制到其它两台主机s1.s2 ②分别配置三台主机环境变量,并使用source命令使之立即生效 主机映射信息如下: 192.168.32.100 ...

- scala 入门Eclipse环境搭建及第一个入门经典程序HelloWorld

scala 入门Eclipse环境搭建及第一个入门经典程序HelloWorld 学习了: http://blog.csdn.net/wangmuming/article/details/3407911 ...

随机推荐

- LeetCode-040-组合总和 II

组合总和 II 题目描述:给定一个数组 candidates 和一个目标数 target ,找出 candidates 中所有可以使数字和为 target 的组合. candidates 中的每个数字 ...

- Python:pyglet学习(2)图形的旋转&batch

这次讲讲图形的旋转和批量渲染(rotate.batch) 1:图形旋转 先看看上次的代码中的一段: glRotatef(rot_y, 0, 1, 0) glRotatef(rot_z,0,0,1) g ...

- CSRF、DDos避免方式

XSS(Cross-Site Scripting,跨站脚本攻击)是一种代码注入攻击.攻击者在目标网站上注入恶意代码,当被攻击者登陆网站时就会执行这些恶意代码,这些脚本可以读取 cookie,sessi ...

- 20192204李龙威 2019-2020-2 《Python程序设计》实验一报告

20192204 2019-2020-2 <Python程序设计>实验一报告 课程:<Python程序设计> 班级: 1922 姓名: 李龙威 学号:20192204 实验教师 ...

- Linux环境下安装Maven

最近在搞虚拟机,记录下虚拟机内Maven环境的搭建流程 一.选择合适的版本(由于Maven运行需要依赖于JDK,所以安装之前需要保证当前虚拟机下已经安装并配置好JDK环境,安装流程参见) https: ...

- .NET Core剪裁器Zack.DotNetTrimmer升级瘦身引擎,并支持剪裁计划的录制和回放

上周,我发布了对.NET Core程序进行瘦身的开源软件Zack.DotNetTrimmer,与.NET Core内置的剪裁器相比,Zack.DotNetTrimmer不仅对程序的剪裁效果更好,而且还 ...

- Tomcat乱码问题解决

修改idea编码:setting->Editor->File Encodings: Global Encoding:UTF-8 Project Encoding:UTF-8 Default ...

- Serialzers 序列化组件

Serialzers 序列化组件 前言 当做前后端分离的项目时,JSON是一个轻量级的数据交互格式.所有我们给前端数据的时候都要转成json格式,那就需要对我们从数据库拿到数据进行序列化 Django ...

- [SPDK/NVMe存储技术分析]008 - RDMA概述

毫无疑问地,用来取代iSCSI/iSER(iSCSI Extensions for RDMA)技术的NVMe over Fabrics着实让RDMA又火了一把.在介绍NVMe over Fabrics ...

- python练习册 每天一个小程序 第0000题

PIL库学习链接:http://blog.csdn.net/column/details/pythonpil.html?&page=1 1 #-*-coding:utf-8-*- 2 __au ...