java实现有道翻译爬虫

我的博文地址

https://www.cnblogs.com/lingdurebing/p/11618902.html

使用的库

1.commons-codec

主要是为了加密,可以直接用java原生的,这里偷懒了,有点大才小用的感觉。

2.requests-5.0.7

大佬写的java 类似python的requests库

github地址:https://github.com/zhangjingpu/requests

和python的requests用法差不多。

3.fastjson

主要为了解析json字符串,没有要求。

4.实现

实现在上面博文里说的很详细,有道翻译的加密基本没改,唯一修改的就是字符串D: n%A-rKaT5fb[Gy?;N5@Tj

这里主要贴java代码

先引入需要的依赖。

<dependency>

<groupId>net.dongliu</groupId>

<artifactId>requests</artifactId>

<version>5.0.7</version>

</dependency>

<!-- https://mvnrepository.com/artifact/commons-codec/commons-codec -->

<dependency>

<groupId>commons-codec</groupId>

<artifactId>commons-codec</artifactId>

<version>1.13</version>

</dependency>

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.47</version>

</dependency>

然后是主要的实现类

import java.io.IOException;

package com.yang.easySpider; import java.io.IOException;

import java.io.InputStream;

import java.util.HashMap;

import java.util.Map;

import java.util.Properties; import org.apache.commons.codec.digest.DigestUtils;

import net.dongliu.requests.Requests; public class Fanyi {

private String msg;

private String url="http://fanyi.youdao.com/translate_o?smartresult=dict&smartresult=rule";

private String D="n%A-rKaT5fb[Gy?;N5@Tj";

private String bv;

private String salt;

private String sign;

private String ts;

private Map<String,Object> header;

private Map<String,Object> params;

public Fanyi()

{

params=new HashMap<String,Object>();

header=new HashMap<String,Object>();

}

private Map<String,Object> getParams(String msg)

{

params.put("i", setMsg(msg));//设置msg同时更新ts,salt,sign;

params.put("from","AUTO");

params.put("to","AUTO");

params.put("smartresult","dict");

params.put("client","fanyideskweb");

params.put("sign",this.sign);

params.put("bv",this.bv);

params.put("ts",this.ts);

params.put("salt",this.salt);

params.put("doctype","json");

params.put("version", "2.1");

params.put("keyfrom", "fanyi.web");

params.put("action", "FY_BY_REALTlME");

return params;

}

public String getResult(String msg)

{

return Requests.post(url).headers(getHeaders()).body(getParams(msg)).send().readToText();

//得到json格式的文本

}

public void setHeaders(Map<String,Object> header)

{

this.header=header;

}

public Map<String,Object> getHeaders()

{

if(this.header.get("Referer")==null)

{

this.header.put("Referer", "http://fanyi.youdao.com/");

}

return this.header;

}

public void setUserAgent(String UA)

{

this.header.put("User-Agent", UA);

//设置UserAgent

String cookie=Requests.get("http://fanyi.youdao.com").headers(this.header).send().getHeader("Set-Cookie").split(";")[0]+";";

//得到Cookie //设置Cookie

this.header.put("Cookie", cookie);

this.bv=getBv(UA);//设置UA的同时要更新bv,因为bv是通过加密UA得到的。

}

private String getSalt()

{

this.salt=String.valueOf(this.ts)+String.valueOf(((int)Math.random()*10));

return this.salt; }

private String getSign()

{

return getMd5("fanyideskweb"+this.msg+this.salt+this.D);

}

private String getTs()

{

return String.valueOf(System.currentTimeMillis());

}

private String getBv(String UserAgent)

{

return getMd5(UserAgent);

}

private String getMd5(String val)

{

return DigestUtils.md5Hex(val);

}

public String setMsg(String msg)

{ this.msg=msg;

//设置需要翻译的内容

this.ts=getTs();//更新ts

this.salt=getSalt();//更新salt

//设置翻译内容的同时更新ts,salt

this.sign=getSign();

//有了翻译内容,salt才能得到sign,网易主要靠此判断

return this.msg;

}

}

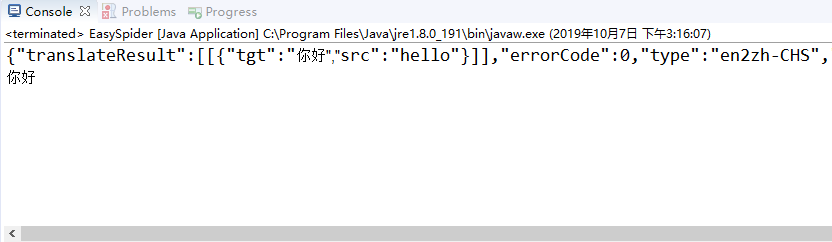

测试一下

public static void main( String[] args )

{

Fanyi fanyi=new Fanyi();

fanyi.setUserAgent("Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/76.0.3809.132 Safari/537.36");

String st=fanyi.getResult("hello");

System.out.print(st);

JSONObject json=JSONObject.parseObject(st);

JSONArray ja=(JSONArray) ((JSONArray) json.get("translateResult")).get(0);

JSONObject js=(JSONObject) ja.get(0);

System.out.print(js.get("tgt")); }

Ok, 没有问题,完成。

参考博文连接地址:https://blog.csdn.net/suixinlun/article/details/93976400

java实现有道翻译爬虫的更多相关文章

- Selenium+PhantomJS实现简易有道翻译爬虫

Selenium一款自动化测试工具,当然用来写爬虫也是没有问题的.它支持Chrome.Safari.Firefox等主流界面式浏览器,另外它也支持多种语言开发,比如 Java,C,Ruby,Pytho ...

- python学习笔记(6)--有道翻译爬虫

说明: 1. 导入三个模块,urllib.request.urlopen用来打开url链接,urllib.parse的urlencode方法将浏览器network里的data对象转为urlopen的第 ...

- Python 有道翻译 爬虫 有道翻译API 突破有道翻译反爬虫机制

py2.7 #coding: utf-8 import time import random import hashlib import requests while(1): url = 'http: ...

- 爬虫新手学习2-爬虫进阶(urllib和urllib2 的区别、url转码、爬虫GET提交实例、批量爬取贴吧数据、fidder软件安装、有道翻译POST实例、豆瓣ajax数据获取)

1.urllib和urllib2区别实例 urllib和urllib2都是接受URL请求相关模块,但是提供了不同的功能,两个最显著的不同如下: urllib可以接受URL,不能创建设置headers的 ...

- Java接口测试之使用有道翻译API

写接口测试框架,找了有道翻译API来当测试数据 package com.httpGetTest; import java.beans.Encoder; import java.net.URLEncod ...

- python3爬虫:利用urllib与有道翻译获得翻译结果

在实现这一功能时遇到了一些困难,由于按照<零基础入门python>中的代码无法实现翻译,会爆出“您的请求来源非法,商业用途使用请关注有道翻译API官方网站“有道智云”: http://ai ...

- 爬虫实战2_有道翻译sign破解

目标url 有道翻译 打开网站输入要翻译的内容,一一查找network发现数据返回json格式,红框就是我们的翻译结果 查看headers,发现返回结果的请求是post请求,且携带一大堆form_da ...

- (未完成...)Python3网络爬虫(2):利用urllib.urlopen向有道翻译发送数据并获得翻译结果

环境: 火狐浏览器 pycharm2017.3.3 python3.5 1.url不仅可以是一个字符串,例如:http://www.baidu.com.url也可以是一个Request对象,这就需要我 ...

- python爬虫-有道翻译-js加密破解

有道翻译-js加密破解 这是本地爬取的网址:http://fanyi.youdao.com/ 一.分析请求 我们在页面中输入:水果,翻译后的英文就是:fruit.请求携带的参数有很多,先将参数数据保存 ...

随机推荐

- node.js常用的全局成员和对象

一般可以直接调用的对象,我们称之为全局对象: 一下对象都加了console.log(),以在运行环境中的显示效果为标准 //包含文件名称的全路径: console.log(_filename); ...

- 第8章 浏览器对象模型BOM 8.1 window对象

ECMAScript是javascript的核心,但如果要在web中使用javascript,那么BOM(浏览器对象模型)则无疑是真正的核心.BOM提供了很多对象,用于访问浏览器的功能,在浏览器之间共 ...

- NLP(四) 正则表达式

* + ? * :0个或多个 + :1个或多个 ? :0个或1个 re.search()函数,将str和re匹配,匹配正确返回True import re # 匹配函数,输入:文本,匹配模式(即re) ...

- CF988D Points and Powers of Two 数学结论题 规律 第十题

Points and Powers of Two time limit per test 4 seconds memory limit per test 256 megabytes input sta ...

- 洛谷P1661 & yzoj 1650 扩散 题解

题意 先讲一下一种容易陷入误区错误思路 要使时间最小,就去找相对于每个点的最短曼哈顿距离,然后取最大值,时间就是(maxn+1)/2. 代码 #include<cstring> #incl ...

- Elasticsearch之联想词示例

public class LianXiangWord { private static RestClient client; static { client=RestClient.builder(ne ...

- Java IO写文件效率

写入方法: /** *1 按字节写入 FileOutputStream * * @param count 写入循环次数 * @param str 写入字符串 */ public void output ...

- (转)Idea使用教程以及各种问题解决

1.可以先去查看这篇博客: https://www.cnblogs.com/yjd_hycf_space/p/7483921.html 2.如果到配置tomcat时遇到了问题,找不到tomcat se ...

- 树莓派4B 安装CentOS

刚入手了一个树莓派4B替换掉旧的3B搭Nas.吐槽下3B的网卡和USB速度真的太慢. 虽然官方推荐的是Debina,由于习惯了CentOS不想增加学习成本,我还是决定用CentOS. 镜像下载地址:h ...

- 解决安装flask库不成功

Python中使用python -m pip install --upgrade pip升级pip时老是不成功 场景 在使用python -m pip install --upgrade pip进 ...