pycharm爬取网页数据

1 python环境的配置

1.1 安装python文件包,放到可以找到的位置

1.2 右键计算机->属性->高级环境设置->系统变量->Path->编辑->复制python路径位置

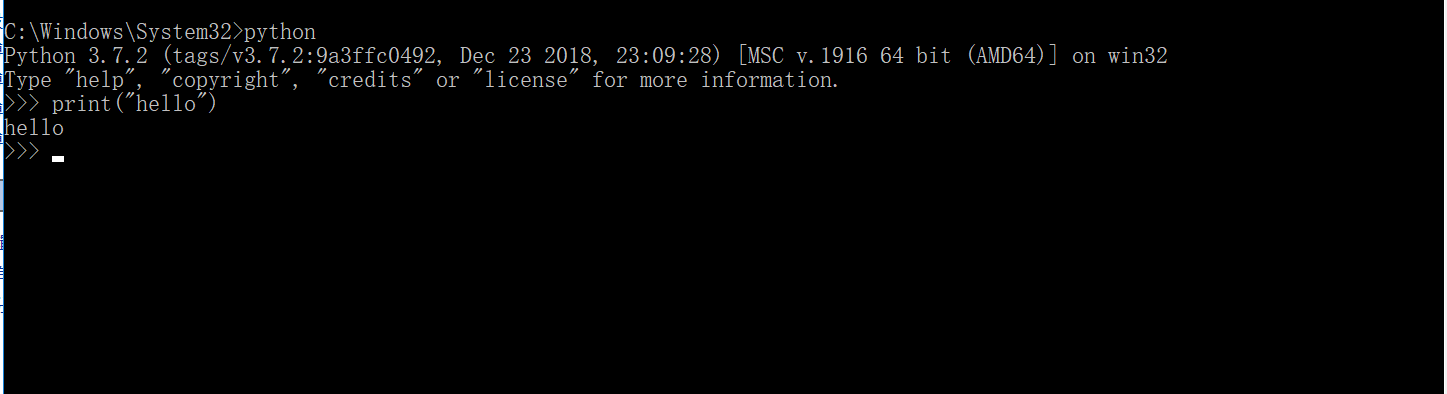

1.3 管理员身份打开cmd,输入python,测试环境是否安装成功

2 安装pycharm

2.1 安装pycharm文件包,放到可以找到的位置

2.2 新建文件夹,需要设置环境

2.3 File->Setting->project ...->add->找到python.exe

2.4 爬虫需要的安装包

2.4.1 打开cmd(管理员身份)

2.4.2 python -m pip install requests

2.4.3 python -m pip install lxml

2.4.4 python -m pip install bs4

2.5爬取数据

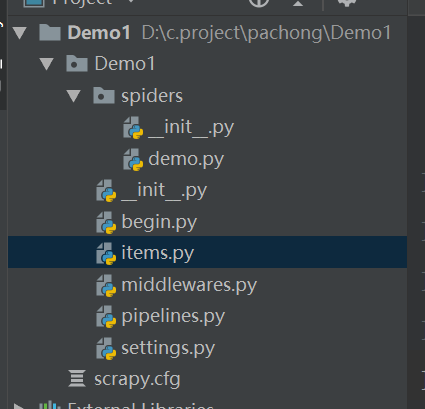

2.5.1 打开cmd 输入scrapy startproject Demo(可以先进入存放文件的目录)

2.5.2 打开pycharm打开文件Demo,新建python文件

2.5.3 新建python文件begin.py输入以下命令,运行begin可以实现爬取数据

from scrapy import cmdline

cmdline.execute("scrapy crawl uestc".split())

2.5.4 打开settings.py设置输出文件格式和文件位置以及User_agent

FEED_URI = u'file:///C:/scrapy/test.csv'//输出目录

FEED_FORMAT='CSV'

FEED_EXPORT_ENCODING="gb18030"

3 以下为部分图片

pycharm爬取网页数据的更多相关文章

- 使用webdriver+urllib爬取网页数据(模拟登陆,过验证码)

urilib是python的标准库,当我们使用Python爬取网页数据时,往往用的是urllib模块,通过调用urllib模块的urlopen(url)方法返回网页对象,并使用read()方法获得ur ...

- python之爬取网页数据总结(一)

今天尝试使用python,爬取网页数据.因为python是新安装好的,所以要正常运行爬取数据的代码需要提前安装插件.分别为requests Beautifulsoup4 lxml 三个插件 ...

- python爬虫——爬取网页数据和解析数据

1.网络爬虫的基本概念 网络爬虫(又称网络蜘蛛,机器人),就是模拟客户端发送网络请求,接收请求响应,一种按照一定的规则,自动地抓取互联网信息的程序.只要浏览器能够做的事情,原则上,爬虫都能够做到. 2 ...

- 使用XPath爬取网页数据

我们以我的博客为例,来爬取我所有写过的博客的标题. 首先,打开我的博客页面,右键“检查”开始进行网页分析.我们选中博客标题,再次右键“检查”即可找到标题相应的位置,我们继续点击右键,选择Copy,再点 ...

- 使用 Python 爬取网页数据

1. 使用 urllib.request 获取网页 urllib 是 Python 內建的 HTTP 库, 使用 urllib 可以只需要很简单的步骤就能高效采集数据; 配合 Beautiful 等 ...

- 03:requests与BeautifulSoup结合爬取网页数据应用

1.1 爬虫相关模块命令回顾 1.requests模块 1. pip install requests 2. response = requests.get('http://www.baidu.com ...

- Selenium+Tesseract-OCR智能识别验证码爬取网页数据

1.项目需求描述 通过订单号获取某系统内订单的详细数据,不需要账号密码的登录验证,但有图片验证码的动态识别,将获取到的数据存到数据库. 2.整体思路 1.通过Selenium技术,无窗口模式打开浏览器 ...

- 使用puppeteer爬取网页数据实践小结

简单介绍Puppeteer Puppeteer是一个Node库,它通过DevTools协议提供高级API来控制Chrome或Chromium.Puppeteer默认以无头方式运行,但可以配置为有头方式 ...

- 【推荐】oc解析HTML数据的类库(爬取网页数据)

TFhpple是一个用于解析html数据的第三方库,本人感觉功能还算可以,只不过在使用前必须配置项目. 配置 1.导入libxml2.tbd 2.设置编译路径 使用 这里使用一个例子来说明 http: ...

随机推荐

- C/C++中double类型的比较

由于double浮点数的精度问题,所以在比较大小的时候,不能像int整数型那样,直接if(a==b),if(a<b),if(a>b) 要使用一个精度EPS: ; //一般这样子就够,但有时 ...

- MongoDB 4.2 的主要亮点(转载)

在6月份召开的MongoDB全球用户大会上, MongoDB官宣了MongoDB Server 4.2,在经过100,000多个运行实例的测试后,MongoDB 4.2表现强劲.现在4.2版本正式上线 ...

- Zuul超时配置

在实际运用过程中,发现有时候zuul的第一次请求经常会超时.不知道你们怎样,我经常在重启zuul后,第一次访问经常会出现超时现象,但是第二次访问就不会了. 第一次经常超时 这是因为zuul采用了懒加载 ...

- 无法定位程序输入点到xxx.dll

Q:安装pytorch时报错无法定位程序输入点到Anaconda3\Library\bin\libssl-1_1-x64.dll A:下载libssl-1_1-x64.dll覆盖bin下的文件 下载地 ...

- 理解Web路由(浅谈前后端路由与前后端渲染)

1.什么是路由? 在Web开发过程中,经常会遇到『路由』的概念.那么,到底什么是路由?简单来说,路由就是URL到函数的映射. 路由的概念最开始是由后端提出来的,在以前用模板引擎开发页面的时候,是使用路 ...

- Jmeter(四十一)_图片爬虫

今天教大家用元件组合,做一个网页图片爬虫. 需要用到的元件:循环控制器+计数器+xpath提前器+函数嵌套+beanshell代码 首先我们确定一下要爬取的图片网站:https://dp.pconli ...

- tomcat启动慢的解决办法

SessionIdGeneratorBase.createSecureRandom Creation of SecureRandom instance for session ID generatio ...

- Deep Reinforcement Learning with Iterative Shift for Visual Tracking

Deep Reinforcement Learning with Iterative Shift for Visual Tracking 2019-07-30 14:55:31 Paper: http ...

- linux升级openssl和php_openssl模块

一.OpenSSL源码升级 2014年4月8日,XP宣布正式停止服务的日子,也是OpenSSL爆出大漏洞的日子. OpenSSL主要是负责在一些敏感的数据提交上面被广泛使用,不乏大家经常访问的一些网站 ...

- odoo开发笔记 -- 异常处理in resolve_deps field = model

场景描述: 更新代码,重启服务服务后,odoo后台报错,提示关键字:in resolve_deps field = model._fields[fname] KeyError: 'entry_id' ...