pca算法实现

pca基础知识不了解的可以先看下一这篇博客:https://www.cnblogs.com/lliuye/p/9156763.html

具体算法实现如下:

import numpy as np

import matplotlib.pyplot as plt

# 载入数据

data = np.genfromtxt("data.csv", delimiter=",")

x_data = data[:,]

y_data = data[:,]

plt.scatter(x_data,y_data)

plt.show()

print(x_data.shape)

# 数据中心化

def zeroMean(dataMat):

# 按列求平均,即各个特征的平均

meanVal = np.mean(dataMat, axis=)

newData = dataMat - meanVal

return newData, meanVal

newData,meanVal=zeroMean(data)

print(newData.shape)

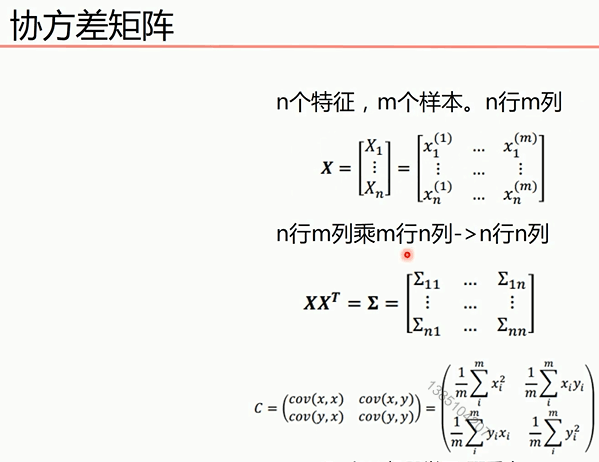

# np.cov用于求协方差矩阵,参数rowvar=0说明数据一行代表一个样本,若非0,说明传入的数据一列代表一个样本。

covMat = np.cov(newData, rowvar=)#因为是行作为样本,所以列作为特征,得到的协方差是2*

# 协方差矩阵

print(covMat)

# np.linalg.eig求矩阵的特征值和特征向量

eigVals, eigVects = np.linalg.eig(np.mat(covMat))

# 特征值

print(eigVals)

# 特征向量

print(eigVects.shape)

# 对特征值从小到大排序

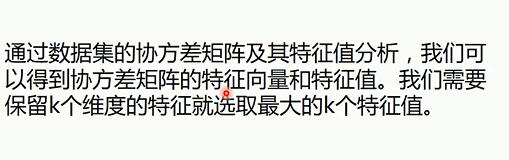

eigValIndice = np.argsort(eigVals)

eigValIndice

top =

# 最大的n个特征值的下标

n_eigValIndice = eigValIndice[-:-(top+):-]

print(n_eigValIndice)

# 最大的n个特征值对应的特征向量

n_eigVect = eigVects[:,n_eigValIndice]

print(n_eigVect.shape)

# 低维特征空间的数据

lowDDataMat = newData*n_eigVect#原始数据投射到选取的特征向量上

print(lowDDataMat.shape)#低纬数据

# 利用低纬度数据来重构数据

reconMat = (lowDDataMat*n_eigVect.T) + meanVal#降维的逆操作

reconMat

# 载入数据

data = np.genfromtxt("data.csv", delimiter=",")

x_data = data[:,]

y_data = data[:,]

plt.scatter(x_data,y_data) # 重构的数据

x_data = np.array(reconMat)[:,]

y_data = np.array(reconMat)[:,]

plt.scatter(x_data,y_data,c='r')

plt.show() plt.show()

关于np.cov的用法详细如下:

np.cov(x)12

np.cov(x)*3 #output:512

np.cov(x)12

其中对角线元素是每个维度的方差,非对角线上的元素则是不同维度间的协方差。

x=X[0:2]

y=X[2:4]

print(np.cov(X))

print(np.cov(x,y))12345

可以看出两者的输出是相同的。因此所谓的np.cov(X)其实就是把np.cov(x,y)中两个变量所有的维度纵向拼接在一起作为X参与运算。

pca算法实现的更多相关文章

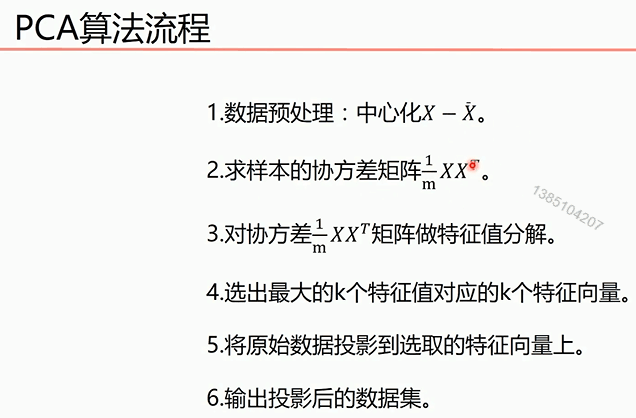

- PCA算法是怎么跟协方差矩阵/特征值/特征向量勾搭起来的?

PCA, Principle Component Analysis, 主成份分析, 是使用最广泛的降维算法. ...... (关于PCA的算法步骤和应用场景随便一搜就能找到了, 所以这里就不说了. ) ...

- 模式识别(1)——PCA算法

作者:桂. 时间:2017-02-26 19:54:26 链接:http://www.cnblogs.com/xingshansi/articles/6445625.html 声明:转载请注明出处, ...

- 三种方法实现PCA算法(Python)

主成分分析,即Principal Component Analysis(PCA),是多元统计中的重要内容,也广泛应用于机器学习和其它领域.它的主要作用是对高维数据进行降维.PCA把原先的n个特征用数目 ...

- 降维之pca算法

pca算法: 算法原理: pca利用的两个维度之间的关系和协方差成正比,协方差为0时,表示这两个维度无关,如果协方差越大这表明两个维度之间相关性越大,因而降维的时候, 都是找协方差最大的. 将XX中的 ...

- PCA算法学习(Matlab实现)

PCA(主成分分析)算法,主要用于数据降维,保留了数据集中对方差贡献最大的若干个特征来达到简化数据集的目的. 实现数据降维的步骤: 1.将原始数据中的每一个样本用向量表示,把所有样本组合起来构成一个矩 ...

- OpenCV学习(35) OpenCV中的PCA算法

PCA算法的基本原理可以参考:http://www.cnblogs.com/mikewolf2002/p/3429711.html 对一副宽p.高q的二维灰度图,要完整表示该图像,需要m = ...

- 我所认识的PCA算法的princomp函数与经历 (基于matlab)

我接触princomp函数,主要是因为实验室的项目需要,所以我一接触的时候就希望快点学会怎么用. 项目中需要利用PCA算法对大量数据进行降维. 简介:主成分分析 ( Principal Compone ...

- PCA算法的最小平方误差解释

PCA算法另外一种理解角度是:最小化点到投影后点的距离平方和. 假设我们有m个样本点,且都位于n维空间 中,而我们要把原n维空间中的样本点投影到k维子空间W中去(k<n),并使得这m个点到投影点 ...

- PCA算法理解及代码实现

github:PCA代码实现.PCA应用 本文算法均使用python3实现 1. 数据降维 在实际生产生活中,我们所获得的数据集在特征上往往具有很高的维度,对高维度的数据进行处理时消耗的时间很大, ...

- Python使用三种方法实现PCA算法[转]

主成分分析(PCA) vs 多元判别式分析(MDA) PCA和MDA都是线性变换的方法,二者关系密切.在PCA中,我们寻找数据集中最大化方差的成分,在MDA中,我们对类间最大散布的方向更感兴趣. 一句 ...

随机推荐

- 2019-3-15-在-Windows-Defender-设置文件夹白名单提升-VisualStudio-编译速度

title author date CreateTime categories 在 Windows Defender 设置文件夹白名单提升 VisualStudio 编译速度 lindexi 2019 ...

- Centos下yum安装 apache+php环境 以及redis扩赞

一 : 安装apache 1.首先保证yum源没问题 在此不再阐述 2.安装apache yum -y install httpd 3.设置开机启动apache chkconfig --levels ...

- 使用dd生成文件

使用dd命令快速生成大文件或者小文件的方法 转载自:http://blog.csdn.net/cywosp/article/details/9674757 在程序的测试中有些场景需要大 ...

- Linux常用命令大全(很全面)

最近都在和Linux打交道,感觉还不错.我觉得Linux相比windows比较麻烦的就是很多东西都要用命令来控制,当然,这也是很多人喜欢linux的原因,比较短小但却功能强大.我将我了解到的命令列举一 ...

- Python Faker的使用 及 常用函数的查询

安装faker pip install faker faker的使用 引用:from faker import Faker 初始化:f=Faker(locale='zh_CN') # 默认是en_U ...

- selenium 操作键盘事件

一.key包提供按键方法 使用必须先引用key包:from selenium.webdriver.common.keys import Keys 键盘事件,在现实操作中我们习惯性的按tab见切换到写一 ...

- 深入浅出的Object.defineProperty()

vue的原理 观察者模式和订阅-发布者模式. Vue实例被创建时,会遍历data属性,并通过Object.defineProperty将 这些属性转化为getter/setter,并进行追踪依赖.每当 ...

- 常用Jquery前端操作

input只能输入正整数 onkeyup="this.value=this.value.replace(/\D/g,'')" if(!confirm("删除后无法恢复,确 ...

- Linux环境上的图形化界面SVN客户端软件“RabbitVCS”

RabbitVCS基本支持所有的Linux发行版本包括ubuntu.Debian.Fedora.Arch Linux.Gentoo.Mandriva.OpenSUSE.RHEL.CentOS 5等.其 ...

- Centos6.5安装mysql5.7.19

一.安装前准备 安装采用二进制包方式,软件包5.7.19版本下载地址:https://dev.mysql.com/downloads/mysql/ 选择MYSQL Community Server版本 ...