spark学习5(hbase集群搭建)

第一步:Hbase安装

hadoop,zookeeper前面都安装好了

将hbase-1.1.3-bin.tar.gz上传到/usr/HBase目录下

[root@spark1 HBase]# chmod u+x hbase-1.1.3-bin.tar.gz

[root@spark1 HBase]# tar -zxvf hbase-1.1.3-bin.tar.gz

[root@spark1 HBase]# mv hbase-1.1.3 hbase-1.1

[root@spark1 ~]# vi/etc/profile #配置环境变量

export HBASE_HOME=/usr/HBase/hbase-1.1

export PATH=$PATH:$HBASE_HOME/bin

[root@spark1 ~]# source /etc/profile #使其生效

第二步:修改配置文件

编辑 hbase-env.xml

[root@spark1 conf]# vi hbase-env.sh

# The java implementation to use. Java 1.7+ required.

export JAVA_HOME=/usr/java/jdk

# Extra Java CLASSPATH elements. Optional.

export HBASE_CLASSPATH=/usr/HBase/hbase-1.1/conf

# Tell HBase whether it should manage it's own instance of Zookeeper or not.

export HBASE_MANAGES_ZK=false 使用HBASE自带的zookeeper管理集群用true,自己安装的用false

编辑 hbase-site.xml

[root@spark1 hbase-1.1]# mkdir tmp

[root@spark1 hbase-1.1]# cd conf

[root@spark1 conf]# vi hbase-site.xml

<property>

<name>hbase.tmp.dir</name>

<value>/usr/HBase/hbase-1.1/tmp</value>

</property>

<!-- 指定hbase在HDFS上存储的路径 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://spark1:9000/hbase</value>

</property>

<!-- 打开 hbase 分布模式 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zk的地址,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>spark1,spark2,spark3</value>

</property>

编辑 regionservers

[root@spark1 conf]# vi regionservers #添加从节点

spark2

spark3

第三步:搭建hbase集群

[root@spark1 usr]# scp -r HBase root@spark2:/usr/

[root@spark1 usr]# scp -r HBase root@spark3:/usr/

[root@spark1 ~]# scp -r /etc/profile root@spark2:/etc/

[root@spark1 ~]# scp -r /etc/profile root@spark3:/etc/

[root@spark2 ~]# source /etc/profile

[root@spark3 ~]# source /etc/profile

第四步:启动 / 关闭 Hbase 数据库集群

启动前我先把hadoop启动和zookeeper启动

[root@spark1 ~]# zkServer.sh start #三个节点都要启动

[root@spark1 ~]# zkServer.sh status #查看是否启动成功

[root@spark1 ~]# start-all.sh #启动hadoop

[root@spark1 ~]# start-hbase.sh

[root@spark1 ~]# stop-hbase.sh

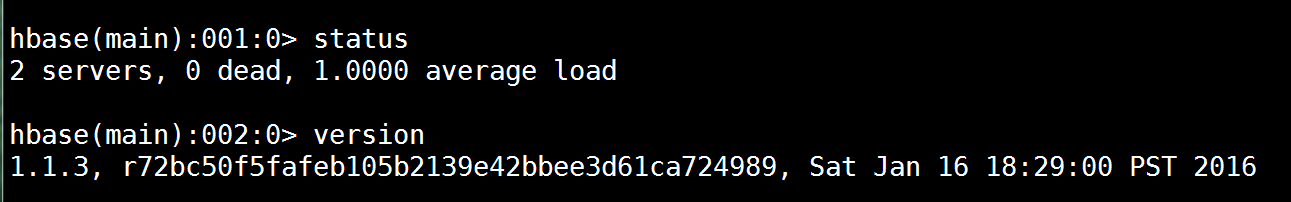

第五步:验证启动

查看jps和hbase shell

[root@spark1 ~]# jps

[root@spark1 ~]# hbase shell

status #查看状态

version #查看版本

spark学习5(hbase集群搭建)的更多相关文章

- 高可用Hadoop平台-HBase集群搭建

1.概述 今天补充一篇HBase集群的搭建,这个是高可用系列遗漏的一篇博客,今天抽时间补上,今天给大家介绍的主要内容目录如下所示: 基础软件的准备 HBase介绍 HBase集群搭建 单点问题验证 截 ...

- HBase集群搭建

HBase集群搭建 搭建环境:假设我们的linux环境已经准备好,包括网络.JDK.防火墙.主机名.免密登录等都没有问题,而且一定要有zookeeper.下面我们用3台linux虚拟机来搭建Hbase ...

- Hadoop+HBase 集群搭建

Hadoop+HBase 集群搭建 1. 环境准备 说明:本次集群搭建使用系统版本Centos 7.5 ,软件版本 V3.1.1. 1.1 配置说明 本次集群搭建共三台机器,具体说明下: 主机名 IP ...

- 【原创 Hadoop&Spark 动手实践 5】Spark 基础入门,集群搭建以及Spark Shell

Spark 基础入门,集群搭建以及Spark Shell 主要借助Spark基础的PPT,再加上实际的动手操作来加强概念的理解和实践. Spark 安装部署 理论已经了解的差不多了,接下来是实际动手实 ...

- Spark学习之在集群上运行Spark(6)

Spark学习之在集群上运行Spark(6) 1. Spark的一个优点在于可以通过增加机器数量并使用集群模式运行,来扩展程序的计算能力. 2. Spark既能适用于专用集群,也可以适用于共享的云计算 ...

- Hbase集群搭建及所有配置调优参数整理及API代码运行

最近为了方便开发,在自己的虚拟机上搭建了三节点的Hadoop集群与Hbase集群,hadoop集群的搭建与zookeeper集群这里就不再详细说明,原来的笔记中记录过.这里将hbase配置参数进行相应 ...

- hbase集群搭建参考资料

hadoop分布式集群搭建 http://www.ityouknow.com/hadoop/2017/07/24/hadoop-cluster-setup.html hbase分布式集群搭建: htt ...

- 基于centos6.5 hbase 集群搭建

注意本章内容是在上一篇文章“基于centos6.5 hadoop 集群搭建”基础上创建的 1.上传hbase安装包 hbase-0.96.2-hadoop2 我的目录存放在/usr/hadoop/hb ...

- 大数据中HBase集群搭建与配置

hbase是分布式列式存储数据库,前提条件是需要搭建hadoop集群,需要Zookeeper集群提供znode锁机制,hadoop集群已经搭建,参考 Hadoop集群搭建 ,该文主要介绍Zookeep ...

随机推荐

- TP ajax

①Ajax使用: 注意传值的所有过程用的是小写,及时数据库列的名称中有大写字母 控制器部分: AjaxController.class.php <?php namespace Home\Co ...

- 在Visual Studio 2015的Cordova项目中使用Gulp

之前一直是在vs 2013中使用Cordova来开发移动app(目前有iPad版/iPhone版/安卓版),准备到下一个milestone的时候升级到2015,这两天在尝试各种东西. 2015中的co ...

- 巨蟒python全栈开发linux之centos3

1.作业讲解 (1)递归创建文件夹/tmp/oldboy/python/{alex,wusir,nvshen,xiaofeng} 下面中的路径没有必要换,在哪里创建都行,根目录下或者tmp目录下或者其 ...

- Dev GridControl 小结3

Dev GridControl 小结 时间 2014-03-26 19:24:01 CSDN博客 原文 http://blog.csdn.net/jiankunking/article/detai ...

- GDI+的应用

在VS中创建窗体 (1)CDI+清除绘画面 在窗体中写入代码: protected override void OnPaint(PaintEventArgs e){ Graphics g=e.Grap ...

- badboy脚本参数化和检查点

一.badboy脚本参数化 文本参数化 方式一:直接在Variablesl ist添加参数化变量和值,然后在Script里面找到对应需要参数化的内容-属性,进行替换,参数化名需要用${XX}引用: 方 ...

- Python3.6全栈开发实例[012]

12.输出商品列表,用户输入序号,显示用户选中的商品(升级题) 商品列表: goods = [{"name": "电脑", "price": ...

- 运行scrapy保存图片,报错ValueError: Missing scheme in request url: h

查阅相关资料,了解到使用ImagesPipeline传入的url地址必须是一个list,而我写的是一个字符串,所以报错,所以需要修改一下传入的url格式就行了 def parse_detail(sel ...

- vue增删改查

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- spring mvc 关键接口 HandlerMapping HandlerAdapter

HandlerMapping Spring mvc 使用HandlerMapping来找到并保存url请求和处理函数间的mapping关系. 以DefaultAnnotationHandlerMa ...