python爬虫,从hao123爬取网址信息

最近研究python的爬虫,小小程序,拿下来分享,本人使用python3.7,纯粹兴趣爱好,希望能帮助大家激发兴趣。

从hao123,爬取各种网址信息,代码如下。 import urllib.request

import urllib

import re #获取网站首页全部内容

url = "http://www.hao123.com"

user_agent = 'Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US; rv:1.9.1.6) Gecko/20091201 Firefox/3.5.6'

req = urllib.request.Request(url, headers={'User-Agent': user_agent})

response = urllib.request.urlopen(req)

content = response.read().decode('utf-8')

#print(content) #初级筛选

pattern = re.compile('<a.*?href="http://.*?".*?>.*?</a>')

items = re.findall(pattern, content)

for item in items:

pattern_one = re.compile('href=".*?"')

pattern_two = re.compile('.*?</a>')

http = re.findall(pattern_one, item)

name = re.findall(pattern_two, item)

name = name.__str__().replace('</a>', '')

#print(name)

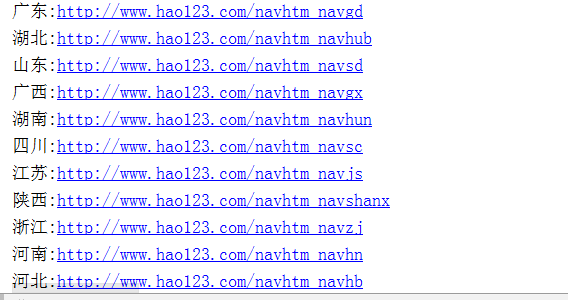

aa = name.rindex('">')

print(name[aa+1:len(name)].replace('\']','').replace('</span>','').replace('>','') + ':' + http.__str__().replace('href=','').replace('"','').replace('\'','').replace('[','').replace(']','')) 结果:

直升机大战:http://xyx.hao123.com/game/600523.html

魔方跳跃:http://xyx.hao123.com/game/599918.html

旋转消消乐:http://xyx.hao123.com/game/597970.html

画线篮球2:http://xyx.hao123.com/game/598991.html

自由任意球:http://xyx.hao123.com/game/599342.html

冰娃与火娃:http://xyx.hao123.com/game/600062.html

足球对抗赛:http://xyx.hao123.com/game/233871.html

足球锦标赛:http://xyx.hao123.com/game/192712.html

荣耀之剑:http://xyx.hao123.com/game/600035.html

复仇者联盟:http://xyx.hao123.com/game/599138.html

火柴人跑酷:http://xyx.hao123.com/game/595991.html

熊出没冒险:http://xyx.hao123.com/game/557537.html

大头吃橙子:http://xyx.hao123.com/game/596718.html

结果有很多不全部列举

python爬虫,从hao123爬取网址信息的更多相关文章

- 一个简单python爬虫的实现——爬取电影信息

最近在学习网络爬虫,完成了一个比较简单的python网络爬虫.首先为什么要用爬虫爬取信息呢,当然是因为要比人去收集更高效. 网络爬虫,可以理解为自动帮你在网络上收集数据的机器人. 网络爬虫简单可以大致 ...

- Python爬虫实例:爬取B站《工作细胞》短评——异步加载信息的爬取

很多网页的信息都是通过异步加载的,本文就举例讨论下此类网页的抓取. <工作细胞>最近比较火,bilibili 上目前的短评已经有17000多条. 先看分析下页面 右边 li 标签中的就是短 ...

- 【转载】教你分分钟学会用python爬虫框架Scrapy爬取心目中的女神

原文:教你分分钟学会用python爬虫框架Scrapy爬取心目中的女神 本博文将带领你从入门到精通爬虫框架Scrapy,最终具备爬取任何网页的数据的能力.本文以校花网为例进行爬取,校花网:http:/ ...

- python爬虫-基础入门-爬取整个网站《2》

python爬虫-基础入门-爬取整个网站<2> 描述: 开场白已在<python爬虫-基础入门-爬取整个网站<1>>中描述过了,这里不在描述,只附上 python3 ...

- Python爬虫实战之爬取百度贴吧帖子

大家好,上次我们实验了爬取了糗事百科的段子,那么这次我们来尝试一下爬取百度贴吧的帖子.与上一篇不同的是,这次我们需要用到文件的相关操作. 本篇目标 对百度贴吧的任意帖子进行抓取 指定是否只抓取楼主发帖 ...

- Python爬虫实例:爬取猫眼电影——破解字体反爬

字体反爬 字体反爬也就是自定义字体反爬,通过调用自定义的字体文件来渲染网页中的文字,而网页中的文字不再是文字,而是相应的字体编码,通过复制或者简单的采集是无法采集到编码后的文字内容的. 现在貌似不少网 ...

- Python爬虫实例:爬取豆瓣Top250

入门第一个爬虫一般都是爬这个,实在是太简单.用了 requests 和 bs4 库. 1.检查网页元素,提取所需要的信息并保存.这个用 bs4 就可以,前面的文章中已经有详细的用法阐述. 2.找到下一 ...

- Python爬虫教程-17-ajax爬取实例(豆瓣电影)

Python爬虫教程-17-ajax爬取实例(豆瓣电影) ajax: 简单的说,就是一段js代码,通过这段代码,可以让页面发送异步的请求,或者向服务器发送一个东西,即和服务器进行交互 对于ajax: ...

- python爬虫-基础入门-爬取整个网站《3》

python爬虫-基础入门-爬取整个网站<3> 描述: 前两章粗略的讲述了python2.python3爬取整个网站,这章节简单的记录一下python2.python3的区别 python ...

随机推荐

- redis批量删除脚本

服务器上安装了redis客户端,通过客户端利用脚本对数据批量删除,脚本内容如下: #!/bin/bash name="$1" echo $name ./redis-cli -h r ...

- 【HDOJ5510】Bazinga(KMP)

题意:给定n个由小写字母组成的字符串,第i个字符串为a[i],求最大的j满足存在1<=i<j,a[i]不是a[j]的子串,无解输出-1 T<=50,n<=500,len[i]& ...

- [CODEVS1205]单词反转

给出一个英语句子,希望你把句子里的单词顺序都翻转过来 这个题算是第二次做了……第二次用的C++然而还是写不出来 思路1:用一个数组把读过去的单词存起来,再逆序输出即可 思路2:读入句子后,先在句子开头 ...

- EnableViewState 属性

原文发布时间为:2009-10-25 -- 来源于本人的百度文章 [由搬家工具导入] 指示是否在页请求之间保持视图状态。如果要保持视图状态,则为 true;否则为 false。默认值为 true。 自 ...

- C++中的explicit关键字(转)

按默认规定,只用传一个参数的构造函数也定义了一个隐式转换.举个例子: #pragma once class CExample { public: CExample(void); CExample(); ...

- docker下使用DB2

1.查询可安装的db2镜像 benjamin@docker:~$ docker images |grep -i db2 ibmcom/db2express-c latest 7aa154d9b73c ...

- hdu 2739(尺取法)

Sum of Consecutive Prime Numbers Time Limit: 1000MS Memory Limit: 65536K Total Submissions: 22876 ...

- hdu 1576(逆元)

A/B Time Limit: 1000/1000 MS (Java/Others) Memory Limit: 32768/32768 K (Java/Others)Total Submiss ...

- Android Studio中删除所有的断点

直接上图,我相信你们能看的懂,骚年们. 第1个图:Run–>>View Breakpoints.. 第2个图:现在可以看到所有的断点了,在左侧栏全选,然后点"-",就全 ...

- MVC 二级联动 可以试试

后台代码,获取数据如下: /// <summary> 2 /// 获取省份 3 /// </summary> 4 public JsonResult GetProvinceli ...