Python爬虫教程-17-ajax爬取实例(豆瓣电影)

Python爬虫教程-17-ajax爬取实例(豆瓣电影)

ajax: 简单的说,就是一段js代码,通过这段代码,可以让页面发送异步的请求,或者向服务器发送一个东西,即和服务器进行交互

对于ajax:

- 1.一定会有 url,请求方法(get, post),可能有数据

- 2.一般使用 json 格式

爬取豆瓣电影

- 网站分析:

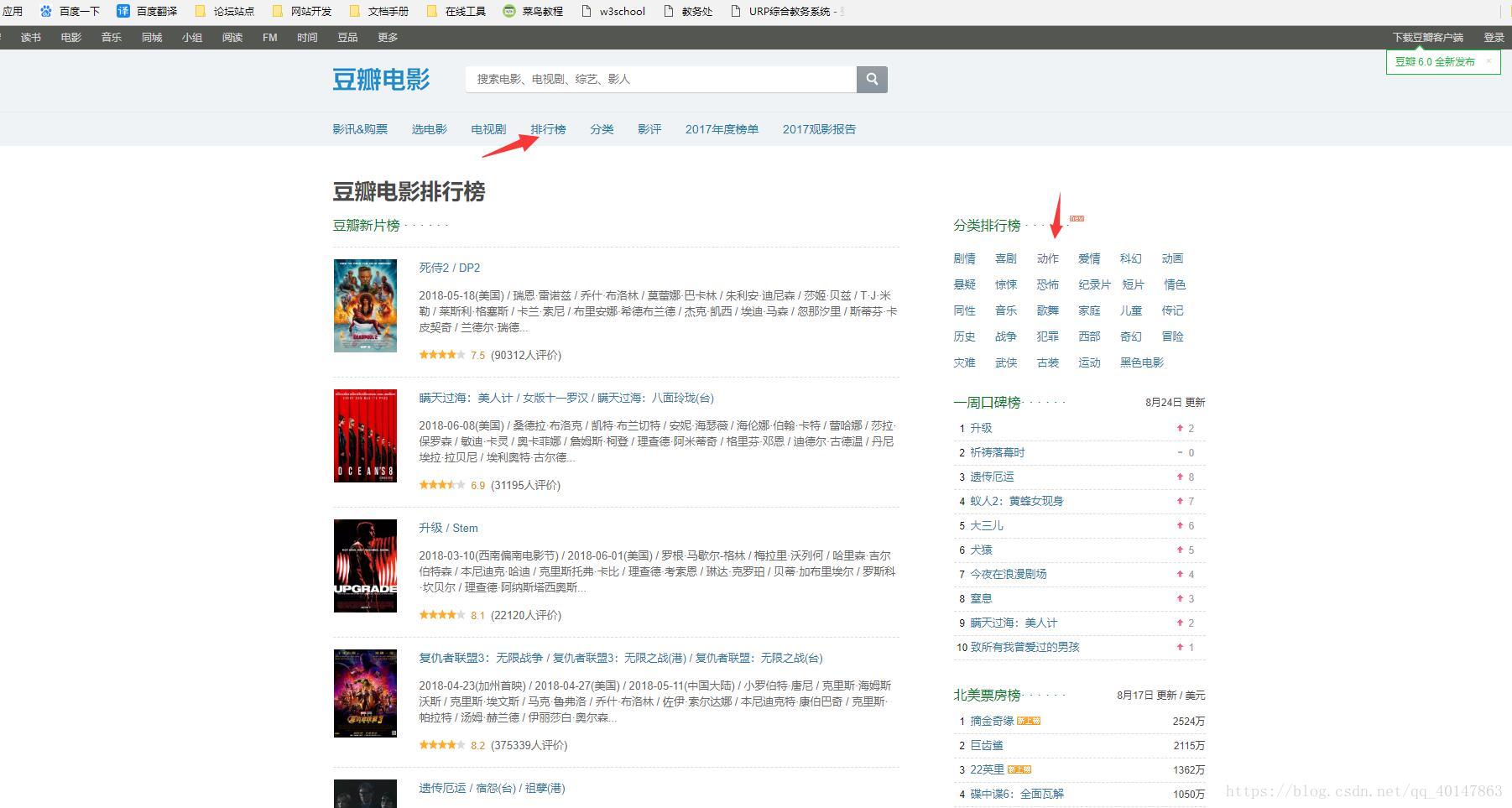

- 打开豆瓣电影网站:https://movie.douban.com/,选择【排行榜】,点击【动作】分类

- 一直往下滑,可以看到这样的效果:快到低的时候又有了新的内容,也就是往下没完

- 基本可以判定使用了 ajax 请求,进行异步的加载

- 然后进去检查请求的信息:

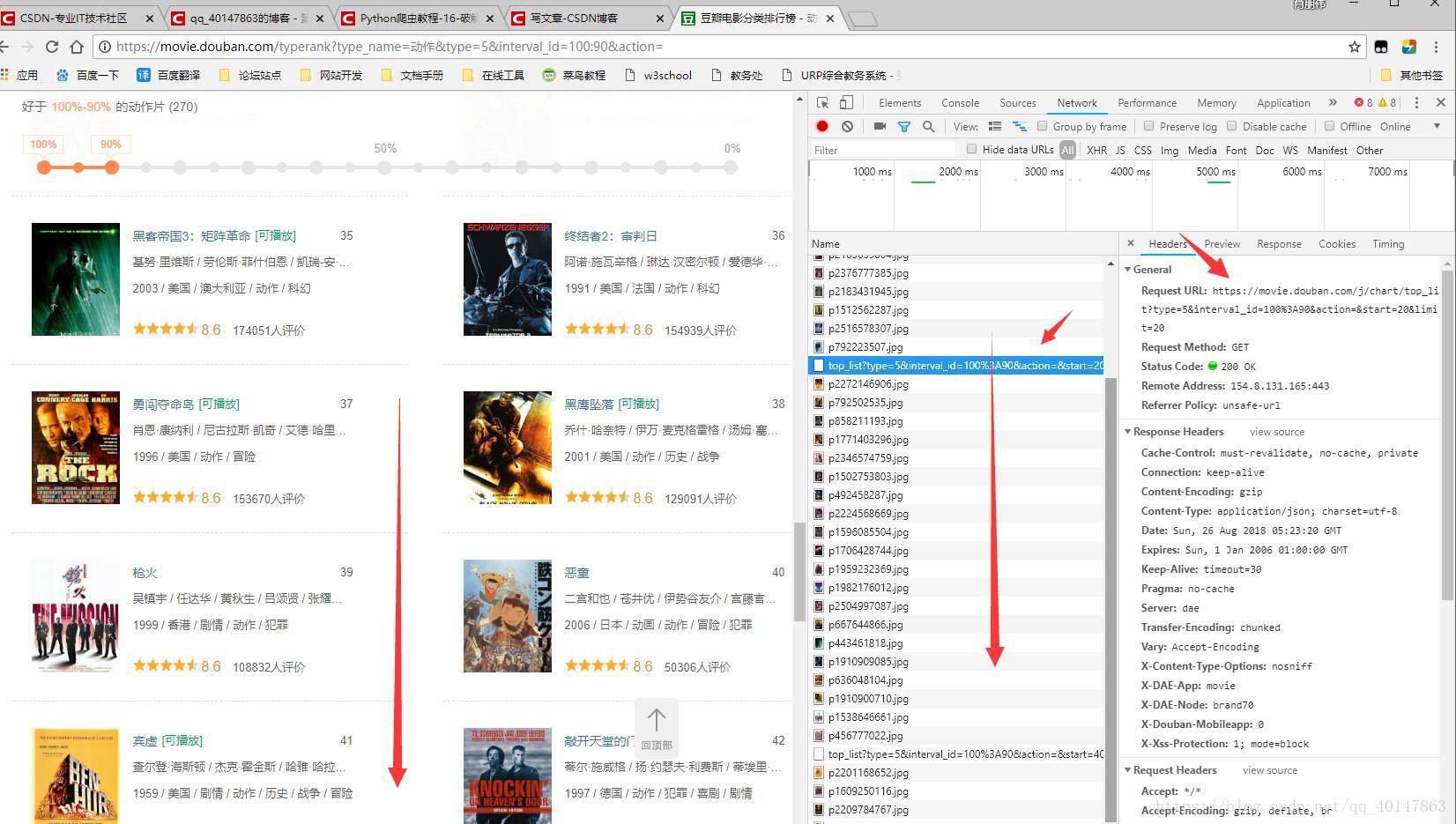

- 1.右键【检查】>【Network】

- 2.向下滚动页面

- 3.可以看到请求在不断不更新,点击一个请求,就可以看到请求的信息

- 代码文件:https://xpwi.github.io/py/py爬虫/py19db.py

# 爬取豆瓣电影数据

# 了解ajax的爬取方式

# https://movie.douban.com/

from urllib import request

import json

# url信息:interval_id表示排名段(可自行修改),limit限制20个

url = "https://movie.douban.com/j/chart/top_list?type=5&interval_id=100%3A90&action=&start=20&limit=20"

rsp = request.urlopen(url)

data = rsp.read().decode()

data = json.loads(data)

print(data)

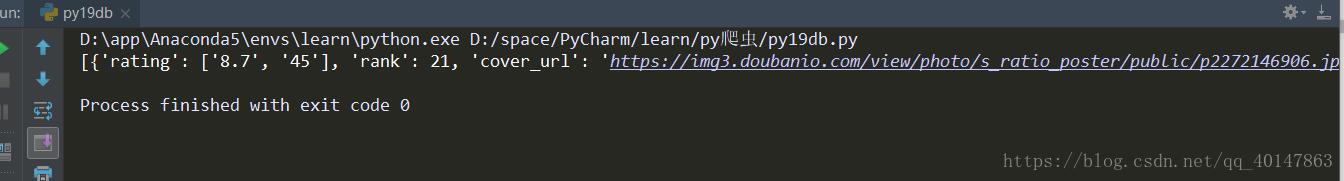

运行结果

可以看到结果在一行显示

修改输出格式

- 对于返回的json数据,我们选择想要的内容,想要的格式输出

- 代码文件:https://xpwi.github.io/py/py爬虫/py19db2.py

# 爬取豆瓣电影数据

# 了解ajax的爬取方式

# https://movie.douban.com/

from urllib import request

import json

# url信息:interval_id表示排名段(可自行修改),limit限制20个

url = "https://movie.douban.com/j/chart/top_list?type=5&interval_id=100%3A90&action=&start=20&limit=20"

rsp = request.urlopen(url)

data = rsp.read().decode()

data = json.loads(data)

# 遍历输出每个'k'和'v'的值

for item in data:

print("排名:", item['rank'], "\n",

"名称:", item['title'], "\n",

"类型:", item['types'], "\n",

"主演:", item['actors'], "\n",

"分数:", item['score'],"\n-------------",)

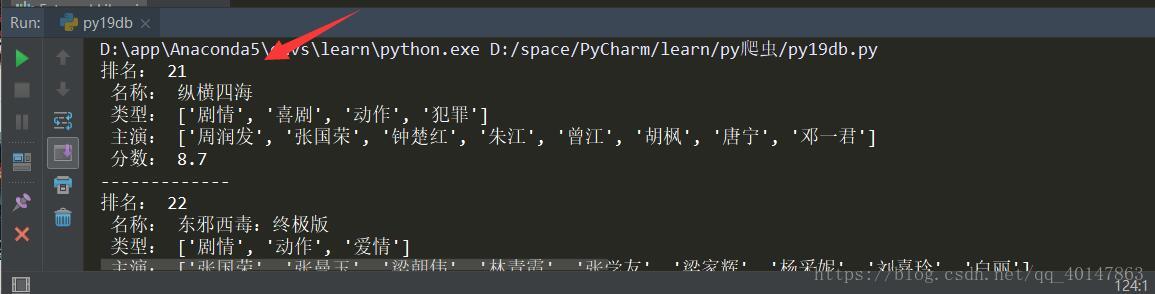

运行结果

这里结果就比较顺眼了,如果需要更改排名段,因为是get请求,修改需要在url参数即可

更多文章链接:Python 爬虫随笔

- 本笔记不允许任何个人和组织转载

Python爬虫教程-17-ajax爬取实例(豆瓣电影)的更多相关文章

- Python爬虫实战二之爬取百度贴吧帖子

大家好,上次我们实验了爬取了糗事百科的段子,那么这次我们来尝试一下爬取百度贴吧的帖子.与上一篇不同的是,这次我们需要用到文件的相关操作. 前言 亲爱的们,教程比较旧了,百度贴吧页面可能改版,可能代码不 ...

- Python爬虫教程-16-破解js加密实例(有道在线翻译)

python爬虫教程-16-破解js加密实例(有道在线翻译) 在爬虫爬取网站的时候,经常遇到一些反爬虫技术,比如: 加cookie,身份验证UserAgent 图形验证,还有很难破解的滑动验证 js签 ...

- Python爬虫实战一之爬取糗事百科段子

大家好,前面入门已经说了那么多基础知识了,下面我们做几个实战项目来挑战一下吧.那么这次为大家带来,Python爬取糗事百科的小段子的例子. 首先,糗事百科大家都听说过吧?糗友们发的搞笑的段子一抓一大把 ...

- Python爬虫:为什么你爬取不到网页数据

前言: 之前小编写了一篇关于爬虫为什么爬取不到数据文章(文章链接为:Python爬虫经常爬不到数据,或许你可以看一下小编的这篇文章), 但是当时小编也是胡乱编写的,其实里面有很多问题的,现在小编重新发 ...

- 转 Python爬虫实战二之爬取百度贴吧帖子

静觅 » Python爬虫实战二之爬取百度贴吧帖子 大家好,上次我们实验了爬取了糗事百科的段子,那么这次我们来尝试一下爬取百度贴吧的帖子.与上一篇不同的是,这次我们需要用到文件的相关操作. 本篇目标 ...

- 转 Python爬虫实战一之爬取糗事百科段子

静觅 » Python爬虫实战一之爬取糗事百科段子 首先,糗事百科大家都听说过吧?糗友们发的搞笑的段子一抓一大把,这次我们尝试一下用爬虫把他们抓取下来. 友情提示 糗事百科在前一段时间进行了改版,导致 ...

- python爬虫学习01--电子书爬取

python爬虫学习01--电子书爬取 1.获取网页信息 import requests #导入requests库 ''' 获取网页信息 ''' if __name__ == '__main__': ...

- python爬虫:了解JS加密爬取网易云音乐

python爬虫:了解JS加密爬取网易云音乐 前言 大家好,我是"持之以恒_liu",之所以起这个名字,就是希望我自己无论做什么事,只要一开始选择了,那么就要坚持到底,不管结果如何 ...

- 简单的python爬虫教程:批量爬取图片

python编程语言,可以说是新型语言,也是这两年来发展比较快的一种语言,而且不管是少儿还是成年人都可以学习这个新型编程语言,今天南京小码王python培训机构变为大家分享了一个python爬虫教程. ...

- Python爬虫使用lxml模块爬取豆瓣读书排行榜并分析

上次使用了BeautifulSoup库爬取电影排行榜,爬取相对来说有点麻烦,爬取的速度也较慢.本次使用的lxml库,我个人是最喜欢的,爬取的语法很简单,爬取速度也快. 本次爬取的豆瓣书籍排行榜的首页地 ...

随机推荐

- Python3.0版本 从听说python可以做爬虫到自己第一成功做出爬虫的经历

前言 我自己是个python小白,工作也不是软件行业,但是日常没事时喜欢捣鼓一些小玩意,自身有点C语言基础. 听说python很火,可以做出爬虫去爬一些数据图片视频之类的东东,我的兴趣一下子就来了.然 ...

- linux如何安装yum

yum全称Yellow dog Updater Modified,yum的主要用途是对rpm包进行管理,包括安装.卸载.升级等.linux安装yum也较为简单,具体如下: 工具/原料 1.电脑: 2. ...

- 【车联网系统】基于Python实现的现网全自动化测试方案

前面写了几篇基于CANoe实现的仿真测试台架,属于半自动化测试方案.现出一个Python实现的车联网系统全自动化测试方案. 目录结构 1.-----------------------车联网系统组成 ...

- Webpack的详细配置,[Webpack中各种loader的安装配置]

在使用webpack的时候,你是不是被以下这种报错所困扰: 注意看 黄色框中标注的 You may need an appropriate loader to handle this file typ ...

- Android deeplink和AppLink原理

APP开发中经常会有这种需求:在浏览器或者短信中唤起APP,如果安装了就唤起,否则引导下载.对于Android而言,这里主要牵扯的技术就是deeplink,也可以简单看成scheme,Android一 ...

- Robot Framework(Collections 库)

Collections 库 Collections 库同样为Robot Framework 标准类库,它所提供的关键字主要用于列表.索引.字典的处理. 在使用之前需要在测试套件(项目)中添加:

- RequireJs学习笔记之data-main Entry Point

You will typically use a data-main script to set configuration options and then load the first appli ...

- 卸载oracle10g

网上搜集的.暂时先用着完全卸载Oracle方法:软件环境: 1.Windows XP + Oracle 10g 2.Oracle安装路径为:d:\Oracle 1.如果数据库配置了自动存储管理(ASM ...

- orcale 之 集合操作

集合操作就是将两个或者多个 sql 查询的结果合并成复合查询.常见的集合操作有UNION(并运算).UNION ALL.INTERSECT(交运算)和MINUS(差运算). UNION UNION 运 ...

- unity对敏感词库处理的记录

string txt = Resources.Load<TextAsset>("minganci").ToString(); //string txt = " ...