“达观杯”文本分类--baseline

结合tfidf权重,对“达观杯”提供的文本,进行文本分类,作为baseline,后续改进均基于此。

1.比赛地址及数据来源

2.代码及解析

# -*- coding: utf-8 -*- """

@简介:tfidf特征/ SVM模型

@成绩: 0.77

"""

#导入所需要的软件包

import pandas as pd

from sklearn.svm import LinearSVC

from sklearn.feature_extraction.text import TfidfVectorizer print("开始...............") #====================================================================================================================

# @代码功能简介:从硬盘上读取已下载好的数据,并进行简单处理

# @知识点定位:数据预处理

#====================================================================================================================

df_train = pd.read_csv('./data/train_set.csv') # 数据读取

df_test = pd.read_csv('./data/test_set.csv') # 观察数据,原始数据包含id、article(原文)列、word_seg(分词列)、class(类别标签)

df_train.drop(columns=['article', 'id'], inplace=True) # drop删除列

df_test.drop(columns=['article'], inplace=True) #==========================================================

# @代码功能简介:将数据集中的字符文本转换成数字向量,以便计算机能够进行处理(一段文字 ---> 一个向量)

# @知识点定位:特征工程

#==========================================================

vectorizer = TfidfVectorizer(ngram_range=(1, 2), min_df=3, max_df=0.9)

'''

ngram_range=(1, 2) : 词组长度为1和2

min_df : 忽略出现频率小于3的词

max_df : 忽略在百分之九十以上的文本中出现过的词

'''

vectorizer.fit(df_train['word_seg']) # 构造tfidf矩阵

x_train = vectorizer.transform(df_train['word_seg']) # 构造训练集的tfidf矩阵

x_test = vectorizer.transform(df_test['word_seg']) # 构造测试的tfidf矩阵 y_train = df_train['class']-1 #训练集的类别标签(减1方便计算) #==========================================================

# @代码功能简介:训练一个分类器

# @知识点定位:传统监督学习算法之线性逻辑回归模型

#========================================================== classifier = LinearSVC() # 实例化逻辑回归模型

classifier.fit(x_train, y_train) # 模型训练,传入训练集及其标签 #根据上面训练好的分类器对测试集的每个样本进行预测

y_test = classifier.predict(x_test) #将测试集的预测结果保存至本地

df_test['class'] = y_test.tolist()

df_test['class'] = df_test['class'] + 1

df_result = df_test.loc[:, ['id', 'class']]

df_result.to_csv('./results/beginner.csv', index=False) print("完成...............")

3.问题修复

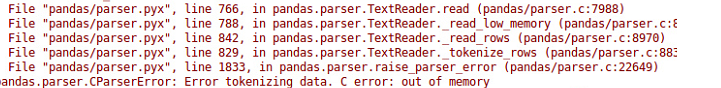

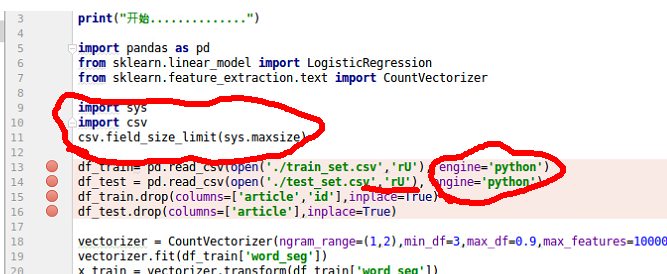

由于提供的数据集较大,一般运行时间再10到15分钟之间,基础电脑配置在4核8G的样子(越消耗内存在6.2G),因此,一般可能会遇到内存溢出的错误。

可限制每次读取的数据量,具体解决办法如下:

当然,你也可以换一个配置更高的电脑。

“达观杯”文本分类--baseline的更多相关文章

- Bert文本分类实践(一):实现一个简单的分类模型

写在前面 文本分类是nlp中一个非常重要的任务,也是非常适合入坑nlp的第一个完整项目.虽然文本分类看似简单,但里面的门道好多好多,作者水平有限,只能将平时用到的方法和trick在此做个记录和分享,希 ...

- Bert文本分类实践(二):魔改Bert,融合TextCNN的新思路

写在前面 文本分类是nlp中一个非常重要的任务,也是非常适合入坑nlp的第一个完整项目.虽然文本分类看似简单,但里面的门道好多好多,博主水平有限,只能将平时用到的方法和trick在此做个记录和分享 ...

- python - 实现文本分类[简单使用第三方库完成]

第三方库 pandas sklearn 数据集 来自于达观杯 训练:train.txt 测试:test.txt 概述 TF-IDF 模型提取特征值建立逻辑回归模型 代码 # _*_ coding:ut ...

- 在 TensorFlow 中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- fastText文本分类算法

1.概述 FastText 文本分类算法是有Facebook AI Research 提出的一种简单的模型.实验表明一般情况下,FastText 算法能获得和深度模型相同的精度,但是计算时间却要远远小 ...

- FastText 文本分类使用心得

http://blog.csdn.net/thriving_fcl/article/details/53239856 最近在一个项目里使用了fasttext[1], 这是facebook今年开源的一个 ...

- NLP(七) 信息抽取和文本分类

命名实体 专有名词:人名 地名 产品名 例句 命名实体 Hampi is on the South Bank of Tungabhabra river Hampi,Tungabhabra River ...

- NLP(十六)轻松上手文本分类

背景介绍 文本分类是NLP中的常见的重要任务之一,它的主要功能就是将输入的文本以及文本的类别训练出一个模型,使之具有一定的泛化能力,能够对新文本进行较好地预测.它的应用很广泛,在很多领域发挥着重要 ...

- 基于Text-CNN模型的中文文本分类实战 流川枫 发表于AI星球订阅

Text-CNN 1.文本分类 转眼学生生涯就结束了,在家待就业期间正好有一段空闲期,可以对曾经感兴趣的一些知识点进行总结. 本文介绍NLP中文本分类任务中核心流程进行了系统的介绍,文末给出一个基于T ...

随机推荐

- Leetcode Tags(4)Stack & Queue

一.232. Implement Queue using Stacks private Stack<Integer> stack; /** Initialize your data str ...

- Java基础(三十六)日期和时间

1.Date类 (1)无参数构造方法创建的对象可以获取本机当前时间 (2)有参数构造方法创建的对象表示举例计算机系统自身时间的距离为给定的参数 Date date = new Date(); // 当 ...

- 设计模式C++描述----06.适配器(Adapter)模式

一. 定义 适配器模式将一个类的接口转换成客户希望的另外一个接口,使得原本由于接口不兼容而不能一起工作的那些类可以一起工作. Adapter 模式的两种类别:类模式和对象模式. 二. 举例说明 实际中 ...

- 一:VSCode引入jupyter

1:安装 2:示例代码 #%% import matplotlib.pyplot as plt import matplotlib as mpl import numpy as np x , , ) ...

- html获得当前日期

<html> <head> <title> </title> </head> <body> <!-- 获得当前日期(年月日 ...

- makefile中":="和“=”的区别

在makefile中,经常能看到这种赋值方式: MyNumber := 这种方式洋名叫做expansion assignment, 翻译过来叫扩展赋值, 我一般就叫冒号等号.这位同学就问了,那么它和普 ...

- 网络安全-主动信息收集篇第二章-二层网络扫描之scapy

scapy是python第三方库文件,可以使用python进行调用也单独进行使用. 非常强大可以用于抓包.分析.创建.修改.注入网络流量. 使用scapy 详细使用方式可以查看github:https ...

- 网络安全-主动信息收集篇第二章-二层网络扫描之arping

arping二层网络发现 介绍工具:arping arping主要查看IP的MAC地址 缺点:工具本身只能ping一个IP地址,不能ping一个IP段.但是可以通过脚本将整个网络中的IP进行扫描. 脚 ...

- hadoop2.6集群环境搭建

版权声明:本文为博主原创文章,未经博主允许不得转载. 一.环境说明 1.机器:一台物理机 和一台虚拟机 2.Linux版本:[Spark@S1PA11 ~]$ cat /etc/issueRed Ha ...

- 理解np.nonzero()函数

举三个例子,就能清楚的看到 np.nonzero() 这个函数返回值的意义 一. #例1 一维数组 import numpy as np a = [0,1,2,0,3,0] b = np.nonzer ...