《机器学习实战》PCA降维

注释:由于各方面原因,理论部分不做介绍,网上很多自行百度吧!

pca.py

import numpy as np

import matplotlib.pyplot as plt

import math def loadDataSet(filename, delin = '\t'):

fr = open(filename)

#读取分割存入数组

stringArr = [line.strip().split(delin) for line in fr.readlines()]

dataArr = [list(map(float,line)) for line in stringArr]

return np.mat(dataArr)

def pca(dataMat, topNfeet = 9999999):

meanVals = np.mean(dataMat,axis=0)#求取平均值

meanRemoved = dataMat - meanVals

covMat = np.cov(meanRemoved,rowvar=0)#方差

eigVals, eigVects= np.linalg.eig(np.mat(covMat))#求解特征向量和特征值

eigValInd = np.argsort(eigVals)#对特征值进行排序

eigValInd = eigValInd[:-(topNfeet+1):-1]#最后的-1是防止越界的,当然你可以在前面加一个判断

redEigVects = eigVects[:,eigValInd]

lowDDataMat = meanRemoved*redEigVects #

reconMat = (lowDDataMat * redEigVects.T) + meanVals

return lowDDataMat, reconMat

main.py

import PCA

import matplotlib.pyplot as plt if __name__ == "__main__": dataMat = PCA.loadDataSet('testSet.txt')

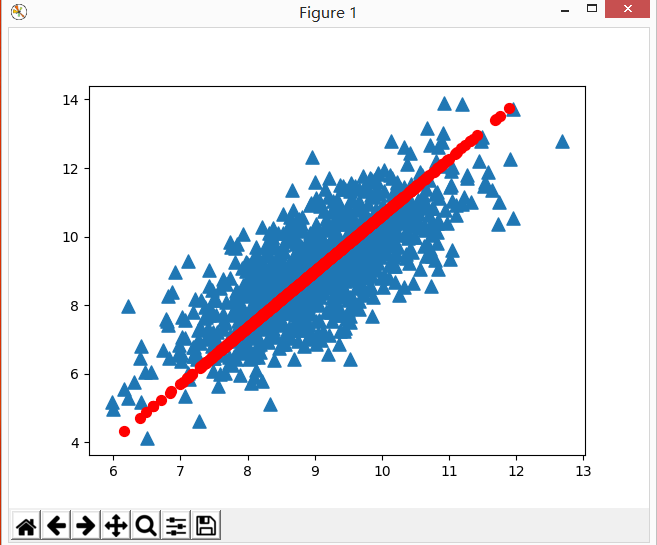

lowDMat, reconMat = PCA.pca(dataMat,1)

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(dataMat[:,0].flatten().A[0],dataMat[:,1].flatten().A[0],marker = '^',s=90)

ax.scatter(reconMat[:,0].flatten().A[0],reconMat[:,1].flatten().A[0],marker = "o",s=50,c='red')

plt.show()

对丢失的值进行替代:

#零的数据都转化为平均值

def replaceNanWithMean():

dataMat = loadDataSet('secom.data',' ')

numFeat = dataMat.shape[1]

for i in range(numFeat):

meanVal = np.mean(dataMat[np.nonzero(~np.isnan(dataMat[:,i].A))[0],i])

dataMat[np.nonzero(np.isnan(dataMat[:,i].A))[0],i] = meanVal

return dataMat

《机器学习实战》PCA降维的更多相关文章

- [综] PCA降维

http://blog.json.tw/using-matlab-implementing-pca-dimension-reduction 設有m筆資料, 每筆資料皆為n維, 如此可將他們視為一個mx ...

- 机器学习公开课笔记(8):k-means聚类和PCA降维

K-Means算法 非监督式学习对一组无标签的数据试图发现其内在的结构,主要用途包括: 市场划分(Market Segmentation) 社交网络分析(Social Network Analysis ...

- Python机器学习笔记 使用scikit-learn工具进行PCA降维

之前总结过关于PCA的知识:深入学习主成分分析(PCA)算法原理.这里打算再写一篇笔记,总结一下如何使用scikit-learn工具来进行PCA降维. 在数据处理中,经常会遇到特征维度比样本数量多得多 ...

- PCA降维—降维后样本维度大小

之前对PCA的原理挺熟悉,但一直没有真正使用过.最近在做降维,实际用到了PCA方法对样本特征进行降维,但在实践过程中遇到了降维后样本维数大小限制问题. MATLAB自带PCA函数:[coeff, sc ...

- 一步步教你轻松学主成分分析PCA降维算法

一步步教你轻松学主成分分析PCA降维算法 (白宁超 2018年10月22日10:14:18) 摘要:主成分分析(英语:Principal components analysis,PCA)是一种分析.简 ...

- 【资料收集】PCA降维

重点整理: PCA(Principal Components Analysis)即主成分分析,是图像处理中经常用到的降维方法 1.原始数据: 假定数据是二维的 x=[2.5, 0.5, 2.2, 1. ...

- 第四章 PCA降维

目录 1. PCA降维 PCA:主成分分析(Principe conponents Analysis) 2. 维度的概念 一般认为时间的一维,而空间的维度,众说纷纭.霍金认为空间是10维的. 3. 为 ...

- PCA 降维算法详解 以及代码示例

转载地址:http://blog.csdn.net/watkinsong/article/details/38536463 1. 前言 PCA : principal component analys ...

- [学习笔记] numpy次成分分析和PCA降维

存个代码,以后参考. numpy次成分分析和PCA降维 SVD分解做次成分分析 原图: 次成分复原图: 代码: import numpy as np from numpy import linalg ...

- 关于PCA降维中遇到的python问题小结

由于论文需要,开始逐渐的学习CNN关于文本抽取的问题,由于语言功底不好,所以在学习中难免会有很多函数不会用的情况..... ̄へ ̄ 主要是我自己的原因,但是我更多的把语言当成是一个工具,需要的时候查找就 ...

随机推荐

- jmeter ---断言持续时间(Duration to Assert )和断言文件大小

jmeter ---断言持续时间(Duration to Assert )和断言文件大小 1.断言持续时间(Duration to Assert ) Duration to Assert -- 允许的 ...

- Maven 环境隔离实践

现在将SpringMVC中Maven环境隔离实践总结如下: 1. 在pom中配置 <resources> <resource> <directory>src/mai ...

- Winfrom Chart实现数据统计

简介 Chart图标根据实际使用情况,部分图表适用于多组数据的数据分析统计功能,例如柱状图:部分图表适用于单组数据的数据分析统计,例如饼状图. 主要属性 注意使用: Chart图表的如下属性:Lege ...

- ui选型

基本思路是风格必须适合博客风格,必须独树一帜. 选中的ui框架必须符合上述两个条件,另外,如果需要自身做一些css修改,修改量必须尽可能小. 1) 不用bootstrap的自带ui.bootstrap ...

- ALGO-22_蓝桥杯_算法训练_装箱问题(DP)

问题描述 有一个箱子容量为V(正整数,<=V<=),同时有n个物品(<n<=),每个物品有一个体积(正整数). 要求n个物品中,任取若干个装入箱内,使箱子的剩余空间为最小. 输 ...

- VB (空字串)、Null、Empty、与 Nothing 的区别

VB (空字串).Null.Empty.与 Nothing 的区别 http://blog.sina.com.cn/s/blog_3f39ffb50100bguw.html 变量 A.B.C.D 分别 ...

- 【NIO】之IO和NIO的区别

在Java1.4之前的版本,Java对I/O的支持并不完善,开发人员在开发高性能I/O程序的时候,会面临以下几个问题: 1.没有数据缓存区,I/O性能存在问题 2.没有C/C++通道的概念,输入和输出 ...

- 前端安全之CSRF

一.跨站点请求伪造(CSRF) 什么是csrf呢? 借助用户的身份去做有损用户利益(一些事情)的事情. 怎么实现跨站点请求伪造呢? 1.伪造者通过创造一个带有<a href=&qu ...

- bzoj5043: 密码破译

Description 小Q发明了一个新的加密算法,对于一个长度为n的非负整数序列a_1,a_2,...,a_n,他会随机选择一个非负整数k, 将每个数都异或上k得到b_1,b_2,...,b_n,即 ...

- ubuntu16.04 彻底卸载MySQL

以MySQL- 5.7.18为例: sudo apt-get autoremove --purge mysql-server-5.7 #sudo apt-get remove mysql-server ...