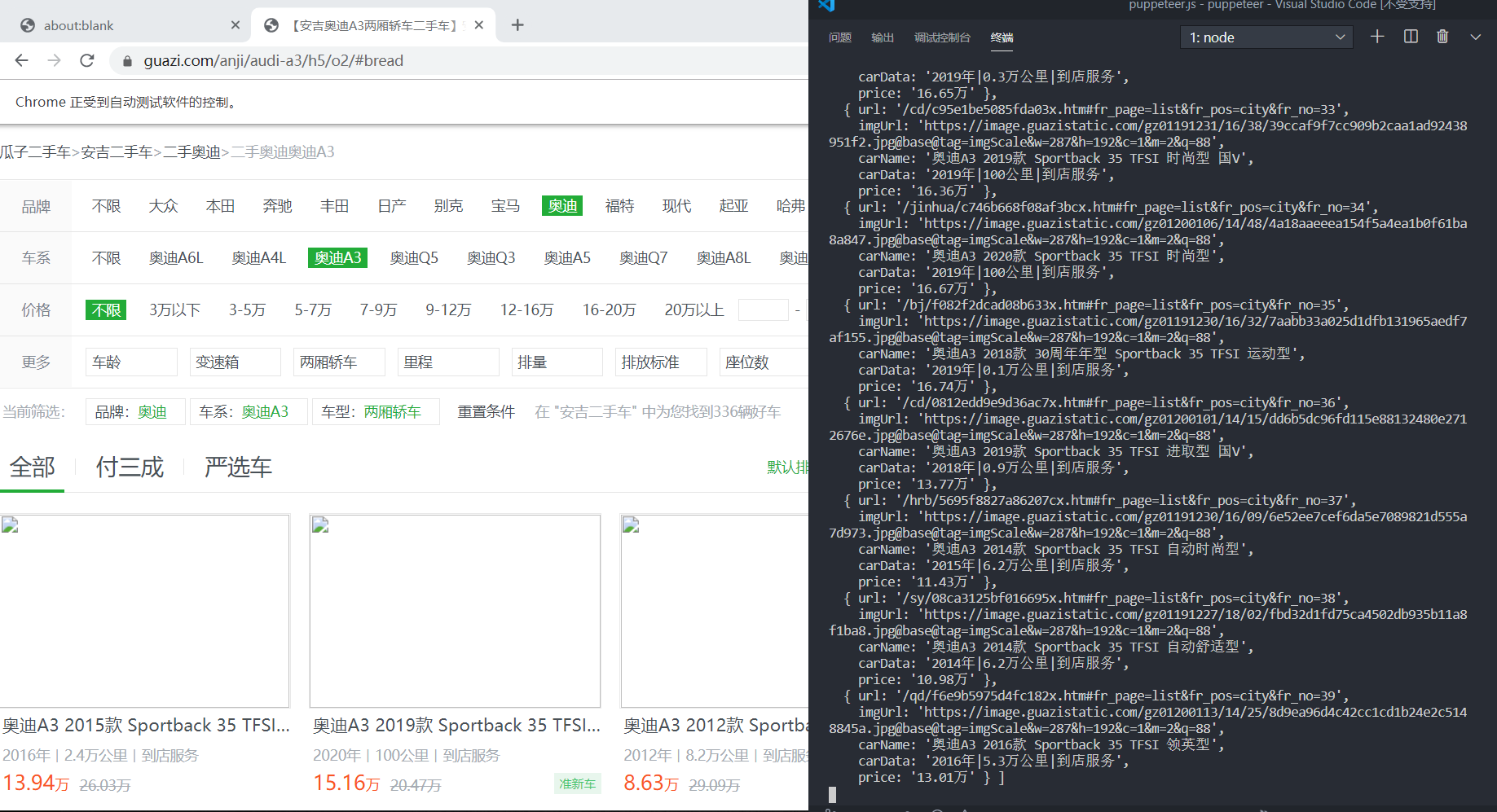

使用nodejs的puppeteer库爬取瓜子二手车网站

const puppeteer = require('puppeteer');

(async () => {

const fs = require("fs");

const rootUrl = 'https://www.guazi.com'

const workPath = './contents';

if (!fs.existsSync(workPath)) {

fs.mkdirSync(workPath)

}

const browser = await (puppeteer.launch({ headless: false }));

const page = await browser.newPage()

await page.setViewport({ width: 1128, height: 736 });

await page.setRequestInterception(true); // 拦截器

page.on('request', request => { //拦截图片

if (request.resourceType() === 'image')

request.abort();

else

request.continue();

});

await page.goto("https://www.guazi.com/fuzhou/buy")

const m_cityList = await page.evaluate(() => { // 获取所有城市

const elements = Array.from(document.querySelectorAll('.all-city dl'))

return elements.map(s => {

let dd = s.getElementsByTagName("dd").item(0)

let ddList = []

for (let i = 0; i < dd.getElementsByTagName("a").length; i++) {

ddList.push({

"cityName": dd.getElementsByTagName("a").item(i).innerHTML,

"url": dd.getElementsByTagName("a").item(i).getAttribute("href")

})

}

return ddList

})

})

//数组扁平化

const flattenNew = arr => arr.reduce((prev, next) => Object.prototype.toString.call(next) == '[object Array]' ? prev.concat(flattenNew(next)) : prev.concat(next), [])

const cityList = flattenNew(m_cityList)

console.log("城市列表爬取完毕")

await page.waitFor(2000 + Math.round(Math.random() * 100))

for (let i = 0; i < cityList.length; i++) {

await page.waitFor(1000 + Math.round(Math.random() * 100))

await page.goto(rootUrl + cityList[i].url)

console.log("跳转到" + cityList[i].cityName)

console.log("开始爬取" + cityList[i].cityName + "的所有二手车品牌")

try {

let brandList = await page.evaluate(() => { //品牌

let Array = []

const dl = document.querySelectorAll('.screen').item(0).getElementsByTagName("dl")

const div = dl.item(0).getElementsByTagName("dd").item(0).getElementsByTagName("div").item(1)

const ul = div.getElementsByTagName("ul")

for (let i = 0; i < ul.length; i++) {

let li = ul.item(i).getElementsByTagName("li")

for (let j = 0; j < li.length; j++) {

let a = li.item(j).getElementsByTagName("p").item(0).getElementsByTagName("a")

for (let k = 0; k < a.length; k++) {

Array.push({

"brand": a.item(k).innerHTML,

"url": a.item(k).getAttribute("href")

})

}

}

}

return Array

})

console.log(cityList[i].cityName + "的所有二手车品牌爬取完毕")

for (let j = 0; j < brandList.length; j++) {

console.log("开始爬取" + cityList[i].cityName + "-" + brandList[j].brand + "的所有车系")

await page.waitFor(1000 + Math.round(Math.random() * 100))

await page.goto(rootUrl + brandList[j].url)

try {

const carTypeList = await page.evaluate(() => { //车型

let Array = []

const dl = document.querySelectorAll('.screen').item(0).getElementsByTagName("dl")

const div = dl.item(1).getElementsByTagName("dd").item(0).getElementsByTagName("div").item(1)

const li = div.getElementsByTagName("ul").item(0).getElementsByTagName("li")

for (let j = 0; j < li.length; j++) {

let a = li.item(j).getElementsByTagName("p").item(0).getElementsByTagName("a")

for (let k = 0; k < a.length; k++) {

Array.push({

"carType": a.item(k).innerHTML.replace(/\s*/g, ""),

"url": a.item(k).getAttribute("href")

})

}

}

return Array

})

console.log(cityList[i].cityName + "-" + brandList[j].brand + "的所有车系爬取完毕")

for (let k = 0; k < carTypeList.length; k++) {

await page.waitFor(1000 + Math.round(Math.random() * 100))

console.log("开始爬取" + cityList[i].cityName + "-" + brandList[j].brand + "-" + carTypeList[k].carType + "的所有二手车")

let newUrl = rootUrl + carTypeList[k].url

pathArray = newUrl.split("/") //拿到第一页url,得到后面的页面的url

let urlArray = []

try {

await page.goto(newUrl)

const pageNum = await page.evaluate(() => { //获取总页数

let li = document.querySelectorAll("ul.pageLink").item(0).getElementsByTagName("li")

let liNum = li.length

return li.item(li.length - 2).getElementsByTagName("a").item(0).getElementsByTagName("span").item(0).innerHTML

})

for (let i = 1; i <= pageNum; i++) { //将所有的页面存入数组中

urlArray.push(newUrl.replace(new RegExp("/" + pathArray[pathArray.length - 1], 'g'), "/o" + i + "/" + pathArray[pathArray.length - 1]))

}

} catch (error) {

console.log(cityList[i].cityName + "-" + brandList[j].brand + "-" + carTypeList[k].carType + "的所有二手车列表爬取失败,该车型可能只有少量或者没有")

}

if (urlArray.length != 0) {

for (let i = 0; i < urlArray.length; i++) {

await page.goto(urlArray[i]);

const list = await page.evaluate(() => {

let carArray = []

let li = document.querySelectorAll("ul.carlist").item(0).getElementsByTagName("li")

for (let i = 0; i < li.length; i++) {

a = li.item(i).getElementsByTagName("a").item(0)

carArray.push({

"url": a.getAttribute("href"),

"imgUrl": a.getElementsByTagName("img").item(0).getAttribute("src"),

"carName": a.getElementsByTagName("h2").item(0).innerHTML,

"carData": (a.getElementsByTagName("div").item(0).innerHTML).replace(new RegExp('<span class="icon-pad">', 'g'), "").replace(new RegExp('</span>', 'g'), ""),

"price": a.getElementsByTagName("div").item(1).getElementsByTagName("p").item(0).innerHTML.replace(new RegExp('<span>', 'g'), "").replace(new RegExp('</span>', 'g'), "").replace(/\s*/g, "")

})

}

return carArray

})

await page.waitFor(500 + Math.round(Math.random() * 100))

console.log(list)

}

}else{

try {

const list = await page.evaluate(() => {

let carArray = []

let li = document.querySelectorAll("ul.carlist").item(0).getElementsByTagName("li")

console.log("该车型少量")

for (let i = 0; i < li.length; i++) {

a = li.item(i).getElementsByTagName("a").item(0)

carArray.push({

"url": a.getAttribute("href"),

"imgUrl": a.getElementsByTagName("img").item(0).getAttribute("src"),

"carName": a.getElementsByTagName("h2").item(0).innerHTML,

"carData": (a.getElementsByTagName("div").item(0).innerHTML).replace(new RegExp('<span class="icon-pad">', 'g'), "").replace(new RegExp('</span>', 'g'), ""),

"price": a.getElementsByTagName("div").item(1).getElementsByTagName("p").item(0).innerHTML.replace(new RegExp('<span>', 'g'), "").replace(new RegExp('</span>', 'g'), "").replace(/\s*/g, "")

})

}

return carArray

})

await page.waitFor(500 + Math.round(Math.random() * 100))

console.log(list)

} catch (error) {

console.log("该车型没有")

}

}

}

} catch (error) {

console.log(cityList[i].cityName + "-" + brandList[i].brand + "的所有车系爬取失败")

}

}

} catch (error) {

console.log(cityList[i].cityName + "二手车品牌爬取失败")

}

await page.waitFor(1000 + Math.round(Math.random() * 100))

}

})();

时间比较赶,先附上代码和运行截图

有兴趣的可以 看一下项目地址

https://gitee.com/xu_hui_hong/nodejs_puppeteer_guazi2

使用nodejs的puppeteer库爬取瓜子二手车网站的更多相关文章

- Python——爬取瓜子二手车

# coding:utf8 # author:Jery # datetime:2019/5/1 5:16 # software:PyCharm # function:爬取瓜子二手车 import re ...

- python爬虫学习之使用BeautifulSoup库爬取开奖网站信息-模块化

实例需求:运用python语言爬取http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html这个开奖网站所有的信息,并且保存为txt文件和excel文件. 实 ...

- Python scrapy框架爬取瓜子二手车信息数据

项目实施依赖: python,scrapy ,fiddler scrapy安装依赖的包: 可以到https://www.lfd.uci.edu/~gohlke/pythonlibs/ 下载 pywi ...

- nodejs中使用cheerio爬取并解析html网页

nodejs中使用cheerio爬取并解析html网页 转 https://www.jianshu.com/p/8e4a83e7c376 cheerio用于node环境,用法与语法都类似于jquery ...

- 一起学爬虫——使用xpath库爬取猫眼电影国内票房榜

之前分享了一篇使用requests库爬取豆瓣电影250的文章,今天继续分享使用xpath爬取猫眼电影热播口碑榜 XPATH语法 XPATH(XML Path Language)是一门用于从XML文件中 ...

- python爬虫学习(三):使用re库爬取"淘宝商品",并把结果写进txt文件

第二个例子是使用requests库+re库爬取淘宝搜索商品页面的商品信息 (1)分析网页源码 打开淘宝,输入关键字“python”,然后搜索,显示如下搜索结果 从url连接中可以得到搜索商品的关键字是 ...

- Python 爬取所有51VOA网站的Learn a words文本及mp3音频

Python 爬取所有51VOA网站的Learn a words文本及mp3音频 #!/usr/bin/env python # -*- coding: utf-8 -*- #Python 爬取所有5 ...

- scrapy爬取西刺网站ip

# scrapy爬取西刺网站ip # -*- coding: utf-8 -*- import scrapy from xici.items import XiciItem class Xicispi ...

- Python开发爬虫之BeautifulSoup解析网页篇:爬取安居客网站上北京二手房数据

目标:爬取安居客网站上前10页北京二手房的数据,包括二手房源的名称.价格.几室几厅.大小.建造年份.联系人.地址.标签等. 网址为:https://beijing.anjuke.com/sale/ B ...

随机推荐

- eclipse的Android一些问题

我最近在学习Android 用eclipse来写Android项目 一开始就遇到了许多的坑——但好在有老师们帮助.还有百度: 现在我开始总结: 1.安装eclipse,这个暂时不说,因为我还没遇到什么 ...

- 高效、可维护、组件化的CSS

如何写出更加高效的CSS? 主要有以下四个关键点: 高效的CSS 可维护的CSS 组件化的CSS hack-free CSS 1.书写高效的CSS代码 * 使用 外联样式 替代行间 样式或者内嵌样式. ...

- search(16)- elastic4s-内嵌文件:nested and join

从SQL领域来的用户,对于ES的文件关系维护方式会感到很不习惯.毕竟,ES是分布式数据库只能高效处理独个扁平类型文件,无法支持关系式数据库那样的文件拼接.但是,任何数据库应用都无法避免树型文件关系,因 ...

- PAT-1080 Graduate Admission (结构体排序)

1080. Graduate Admission It is said that in 2013, there were about 100 graduate schools ready to pro ...

- Kattis - entertainmentbox

题目链接:https://vjudge.net/problem/Kattis-entertainmentbox 题目大意: 一种叫做不知道什么的盒子可以同时录 k 个节目,现给出 n 个节目的开始和结 ...

- queue.Queue()

一.构造方法 Queue是构造方法,函数签名是Queue(maxsize=0) ,其中maxsize设置队列的大小. 二.实例方法 Queue.qsize(): 返回queue的近似值.注意:qsiz ...

- SQL——SQL别名、UNION和SELECT INTO

Alias(别名) - 为列名称和表名称指定别名 语法:表SELECT columnName(s) FROM tableName AS aliasName 列SELECT co ...

- cors跨越深度刨析

解决跨域的方式JSOP,和CORS JSONP不做介绍了. CORS跨域: 参考阮一峰http://www.ruanyifeng.com/blog/2016/04/cors.html 官方:https ...

- 01 . RabbitMQ简介及部署

RabbitMQ简介 MQ全称为Message Queue, 消息队列(MQ)是一种应用程序对应用程序的通信方法.应用程序通过读写出入队列的消息(针对应用程序的数据)来通信,而无需专用连接来链接它 ...

- [05]HTML基础之表格标签

1. <table>标签 表格容器,尽量避免用属性书写样式,而是用CSS来表达 border: 数字 //表格边框宽度 2. <caption>标签 表格的标题,一般出现在表格 ...