55.storm 之 hello word(本地模式)

strom hello word

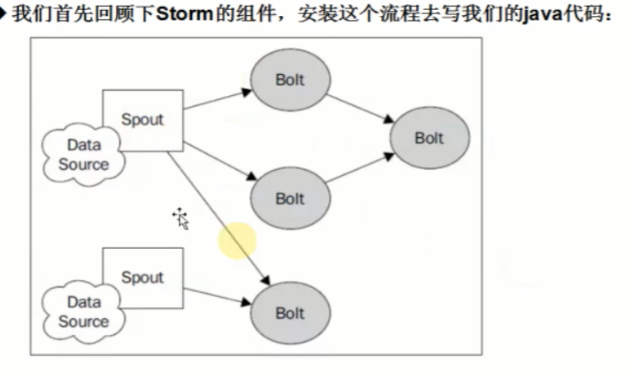

概述

然后卡一下代码怎么实现的:

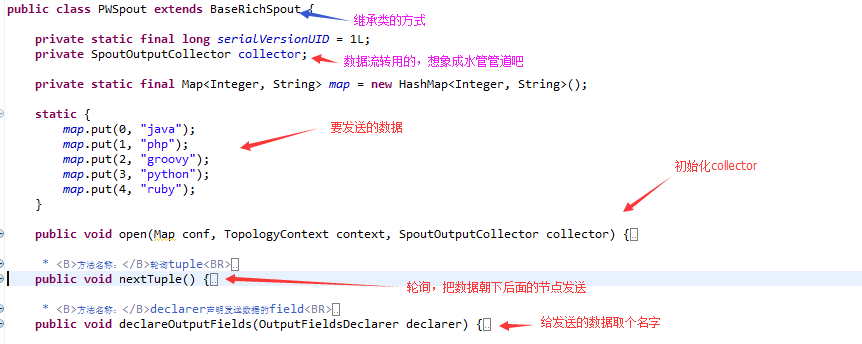

- 编写数据源类:Spout。可以使用两种方式:

继承BaseRichSpout类

实现IRichSpout接口

主要需要实现或重写几个方法:open、nextTuple、declareOutputFields

- 继续编写数据处理类:Bolt。可以使用两种方式:

继承BaseBasicBolt类

实现IRichBolt接口

终点实现或重写几个方法:execute、declareOutputFields

- 最后编写主函数(Topology)去进行提交一个任务

在使用Topology的时候,Storm框架为我们提供了两种模式:本地模式和集群模式

本地模式:(无需Storm集群,直接在java中即可运行,一般用于测试和开发阶段)执行main函数即可

集群模式:(需要Storm集群,把实现java程序打包,然后Topology进行提交)需要把应用打成jar,使用Storm命令吧Topology提交到集群中去。

实际操作

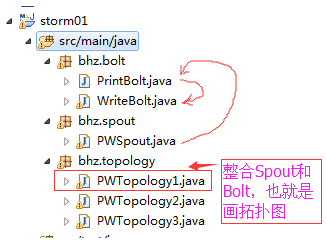

先来看一下代码结构:

就如上图所说,数据从PWSpout流到PrintBolt,最后到WriteBolt写到文件。具体看一下这几个类的代码:

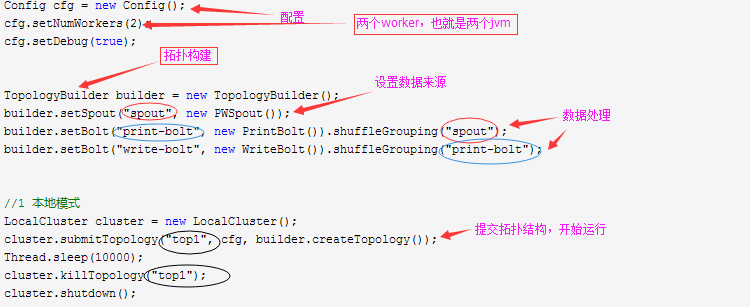

先看一本地模式的:

PWTopology1.java 拓扑结构构建

import backtype.storm.Config;

import backtype.storm.LocalCluster;

import backtype.storm.StormSubmitter;

import backtype.storm.topology.TopologyBuilder;

import bhz.bolt.PrintBolt;

import bhz.bolt.WriteBolt;

import bhz.spout.PWSpout; public class PWTopology1 { public static void main(String[] args) throws Exception {

//

Config cfg = new Config();

cfg.setNumWorkers(2);

cfg.setDebug(true); TopologyBuilder builder = new TopologyBuilder();

builder.setSpout("spout", new PWSpout());

builder.setBolt("print-bolt", new PrintBolt()).shuffleGrouping("spout");

builder.setBolt("write-bolt", new WriteBolt()).shuffleGrouping("print-bolt"); //1 本地模式

LocalCluster cluster = new LocalCluster();

cluster.submitTopology("top1", cfg, builder.createTopology());

Thread.sleep(10000);

cluster.killTopology("top1");

cluster.shutdown(); //2 集群模式

// StormSubmitter.submitTopology("top1", cfg, builder.createTopology()); }

}

代码分析:

数据来源:

import java.util.HashMap;

import java.util.Map;

import java.util.Random; import backtype.storm.spout.SpoutOutputCollector;

import backtype.storm.task.TopologyContext;

import backtype.storm.topology.OutputFieldsDeclarer;

import backtype.storm.topology.base.BaseRichSpout;

import backtype.storm.tuple.Fields;

import backtype.storm.tuple.Values; public class PWSpout extends BaseRichSpout { private static final long serialVersionUID = 1L;

private SpoutOutputCollector collector; private static final Map<Integer, String> map = new HashMap<Integer, String>(); static {

map.put(0, "java");

map.put(1, "php");

map.put(2, "groovy");

map.put(3, "python");

map.put(4, "ruby");

} @Override

public void open(Map conf, TopologyContext context, SpoutOutputCollector collector) {

//对spout进行初始化

this.collector = collector;

//System.out.println(this.collector);

} /**

* <B>方法名称:</B>轮询tuple<BR>

* <B>概要说明:</B><BR>

* @see backtype.storm.spout.ISpout#nextTuple()

*/

@Override

public void nextTuple() {

//随机发送一个单词

final Random r = new Random();

int num = r.nextInt(5);

try {

Thread.sleep(500);

} catch (InterruptedException e) {

e.printStackTrace();

}

this.collector.emit(new Values(map.get(num)));

} /**

* <B>方法名称:</B>declarer声明发送数据的field<BR>

* <B>概要说明:</B><BR>

* @see backtype.storm.topology.IComponent#declareOutputFields(backtype.storm.topology.OutputFieldsDeclarer)

*/

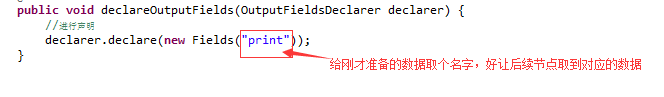

@Override

public void declareOutputFields(OutputFieldsDeclarer declarer) {

//进行声明

declarer.declare(new Fields("print"));

} }

代码解析:

整体结构

细入分析

---------------------------- open 方法---------------------------------------------------------

--------------------------------- nextTuple方法 --------------------------------------------------------------

---------------------------- declareOutputFields方法 ----------------------------------------------------

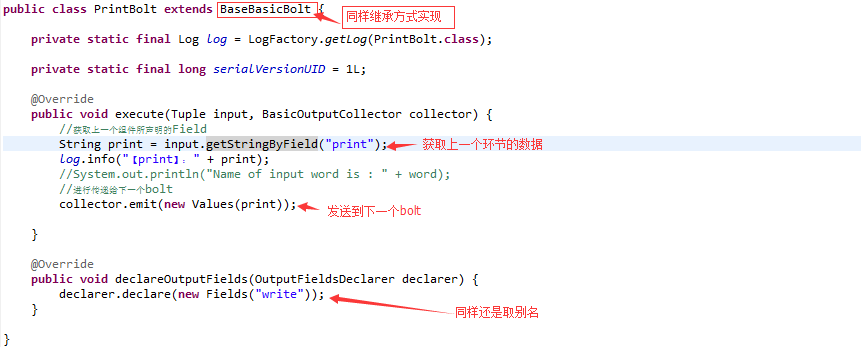

数据处理

import org.apache.commons.logging.Log;

import org.apache.commons.logging.LogFactory; import backtype.storm.topology.BasicOutputCollector;

import backtype.storm.topology.OutputFieldsDeclarer;

import backtype.storm.topology.base.BaseBasicBolt;

import backtype.storm.tuple.Fields;

import backtype.storm.tuple.Tuple;

import backtype.storm.tuple.Values; public class PrintBolt extends BaseBasicBolt { private static final Log log = LogFactory.getLog(PrintBolt.class); private static final long serialVersionUID = 1L; @Override

public void execute(Tuple input, BasicOutputCollector collector) {

//获取上一个组件所声明的Field

String print = input.getStringByField("print");

log.info("【print】: " + print);

//System.out.println("Name of input word is : " + word);

//进行传递给下一个bolt

collector.emit(new Values(print)); } @Override

public void declareOutputFields(OutputFieldsDeclarer declarer) {

declarer.declare(new Fields("write"));

} }

代码分析

import java.io.FileWriter; import org.apache.commons.logging.Log;

import org.apache.commons.logging.LogFactory; import clojure.main;

import backtype.storm.topology.BasicOutputCollector;

import backtype.storm.topology.OutputFieldsDeclarer;

import backtype.storm.topology.base.BaseBasicBolt;

import backtype.storm.tuple.Tuple; public class WriteBolt extends BaseBasicBolt { private static final long serialVersionUID = 1L; private static final Log log = LogFactory.getLog(WriteBolt.class); private FileWriter writer ;

@Override

public void execute(Tuple input, BasicOutputCollector collector) {

//获取上一个组件所声明的Field

String text = input.getStringByField("write");

try {

if(writer == null){

if(System.getProperty("os.name").equals("Windows 10")){

writer = new FileWriter("D:\\099_test\\" + this);

} else if(System.getProperty("os.name").equals("Windows 8.1")){

writer = new FileWriter("D:\\099_test\\" + this);

} else if(System.getProperty("os.name").equals("Windows 7")){

writer = new FileWriter("D:\\099_test\\" + this);

} else if(System.getProperty("os.name").equals("Linux")){

System.out.println("----:" + System.getProperty("os.name"));

writer = new FileWriter("/usr/local/temp/" + this);

}

}

log.info("【write】: 写入文件");

writer.write(text);

writer.write("\n");

writer.flush(); } catch (Exception e) {

e.printStackTrace();

}

} @Override

public void declareOutputFields(OutputFieldsDeclarer declarer) { } }

和PrintBolt 这个类很相似,都是在处理数据。不作过多解释

55.storm 之 hello word(本地模式)的更多相关文章

- Eclipse的下载、安装和WordCount的初步使用(本地模式和集群模式)

包括: Eclipse的下载 Eclipse的安装 Eclipse的使用 本地模式或集群模式 Scala IDE for Eclipse的下载.安装和WordCount的初步使用(本地模式和集群 ...

- IntelliJ IDEA的下载、安装和WordCount的初步使用(本地模式和集群模式)

包括: IntelliJ IDEA的下载 IntelliJ IDEA的安装 IntelliJ IDEA中的scala插件安装 用SBT方式来创建工程 或 选择Scala方式来创建工程 本地模式或集群 ...

- Scala IDE for Eclipse的下载、安装和WordCount的初步使用(本地模式和集群模式)

包括: Scala IDE for Eclipse的下载 Scala IDE for Eclipse的安装 本地模式或集群模式 我们知道,对于开发而言,IDE是有很多个选择的版本.如我们大部分人经常 ...

- Linux下的Hadoop安装(本地模式)

系统为CentOS 6.9,Hadoop版本2.8.3,虚拟机VMware Workstation 主要介绍Linux虚拟机安装.环境配置和Hadoop本地模式的安装.伪分布式和Windows下的安装 ...

- Scala进阶之路-Spark本地模式搭建

Scala进阶之路-Spark本地模式搭建 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.Spark简介 1>.Spark的产生背景 传统式的Hadoop缺点主要有以下两 ...

- IntelliJ IDEA(Community版本)的下载、安装和WordCount的初步使用(本地模式和集群模式)

不多说,直接上干货! 对于初学者来说,建议你先玩玩这个免费的社区版,但是,一段时间,还是去玩专业版吧,这个很简单哈,学聪明点,去搞到途径激活!可以看我的博客. 包括: IntelliJ IDEA(Co ...

- 安装部署Apache Hadoop (本地模式和伪分布式)

本节内容: Hadoop版本 安装部署Hadoop 一.Hadoop版本 1. Hadoop版本种类 目前Hadoop发行版非常多,有华为发行版.Intel发行版.Cloudera发行版(CDH)等, ...

- 2.hadoop基本配置,本地模式,伪分布式搭建

2. Hadoop三种集群方式 1. 三种集群方式 本地模式 hdfs dfs -ls / 不需要启动任何进程 伪分布式 所有进程跑在一个机器上 完全分布式 每个机器运行不同的进程 2. 服务器基本配 ...

- Hive的三种安装方式(内嵌模式,本地模式远程模式)

一.安装模式介绍: Hive官网上介绍了Hive的3种安装方式,分别对应不同的应用场景. 1.内嵌模式(元数据保村在内嵌的derby种,允许一个会话链接,尝试多个会话链接时会报错) ...

随机推荐

- js保存,获取,删除cookie的操作

[转]来自:http://blog.csdn.net/itmyhome1990/article/details/7363816 JSP表单页面 <form action="login& ...

- 组合数C(n,m)的四种求解方法

转自:文章 1.暴力求解 C(n,m)=n*(n-1)*...*(n-m+1)/m!,(n<=15): int CF(int n,int m) { ,i,j; ;i--) ans*=i; ;i- ...

- awk 用法(转)

原文:https://www.cnblogs.com/xudong-bupt/p/3721210.html awk是行处理器: 相比较屏幕处理的优点,在处理庞大文件时不会出现内存溢出或是处理缓慢的问题 ...

- 如何在MYSQL下所有指定数据库名下执行SQL

mysql下用户库比较多,都有统一的命名格式,希望在这些所有用户库执行脚本,更新数据,或者查询数据 可以采用以下存储过程实现 DROP PROCEDURE IF EXISTS `sp_execalld ...

- 工作总结(一):Linux C

这三个月以来一直忙着赶进度,没有停下来记录一些东西,很多很好的东西往往只能零零散散地记在草稿本上, 这样偶尔想起来自己都找不到,所以现在抽空总结下来. 这些天做了三件事,其一是在Linux下开发了对接 ...

- 解决编译错误:cc: Internal error: Killed (program cc1)

错误现象: cc: Internal error: Killed (program cc1) ... 大体上是因为内存不足,临时使用交换分区来解决吧 sudo mkswap /swapfile sud ...

- JavaBase

第一章: Java之父:詹姆斯.高斯林:1995年5月推出Java: java分为 java se : 基础版本(标准版) Java EE : 企业级开发 ME:嵌入式开发(已被安卓替代) ...

- XCode中常用错误解决

No such file or directory 解决方法(可以依次尝试,总有一种能最终解决问题): 方法1.退出Xcode,然后从finder里面进入~/Library/ ...

- day23(事务管理)

事务管理 事务管理两种方式: 向下传递,ThreadLocal 向下传递的方式(依赖) 缺点:不利于测试 Service层 获取连接conn(Connection) 转账(conn) 收账(conn) ...

- 20169207《Linux内核原理与分析》第九周作业

第九周的实验依旧和往常的一样,主要包括两部分.一是1.阅读学习教材「Linux内核设计与实现 (Linux Kernel Development)」第教材第13,14章.二是学习MOOC「Linux内 ...