Linux 搭建Hadoop集群 成功

内容基于(自己的真是操作步骤编写)

一:下载安装 Hadoop

1.1:下载指定的Hadoop

hadoop-2.8.0.tar.gz

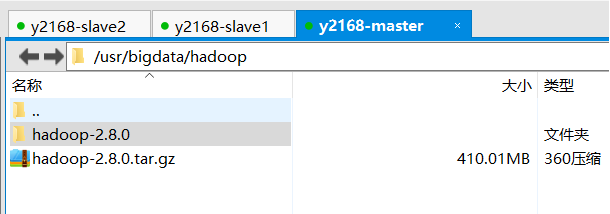

1.2:通过XFTP把文件上传到master电脑bigData目录下

1.3:解压hadoop压缩文件

tar -xvf hadoop-2.8.0.tar.gz

1.4:进入压缩文件之后 复制路径

/bigData/hadoop-2.8.0

1.5:配置Hadoop的环境变量

vim /etc/profile

添加如下配置:

export HADOOP_HOME=/usr/bigdata/hadoop/hadoop-2.8.0

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

让文件生效:

wq!保存并退出

source /etc/profile让文件生效

二:Hadoop集群的配置

2.1:进入hadoop的配置文件位置

进入hadoop配置文件目录

cd hadoop2.8.0/etc/hadoop/

2.2:配置hadoop-env.sh文件

vim hadoop-env.sh

加入如下配置:

export JAVA_HOME=/usr/bigdata/java/jdk1.8.0_121

2.3:配置yarn-env.sh文件

vim yarn-env.sh

加入如下配置:

export JAVA_HOME=/usr/bigdata/java/jdk1.8.0_121

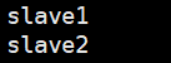

2.4:配置slaves文件,增加slave主机名或者IP地址

01.vim slaves

删除原有localhost,加入子机器名称或者ip地址

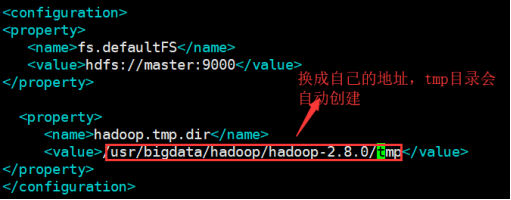

2.5:配置core-site.xml文件

01.vim core-site.xml

02.在configuration节点下加入如下配置:

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/bigdata/hadoop/hadoop-2.8.0/tmp</value>

</property>

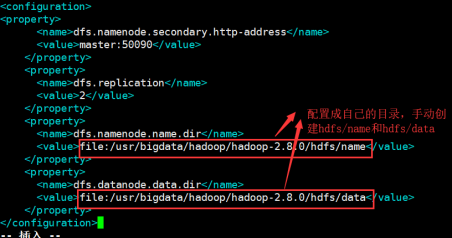

2.6:配置hdfs-site.xml文件

vim hdfs-site.xml

在configuration节点下加入如下配置:

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:50090</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/bigdata/hadoop/hadoop-2.8.0/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/bigdata/hadoop/hadoop-2.8.0/hdfs/data</value>

</property>

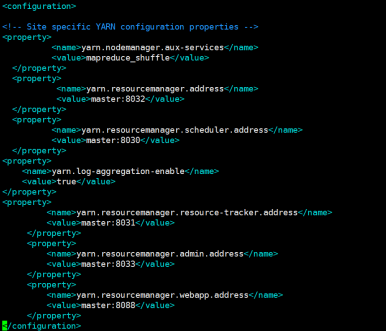

2.7:配置yarn-site.xml文件

在configuration节点下加入如下配置:

vim yarn-site.xml

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>master:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>master:8030</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>master:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>master:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8088</value>

</property>

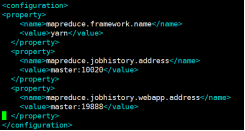

2.8:配置mapred-site.xml文件

mapred-site.xml.template存在

mapred-site.xml不存在

先要copy一份

cp mapred-site.xml.template mapred-site.xml

然后编辑

vim mapred-site.xml

在configuration节点下加入如下配置:

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>master:19888</value>

</property>

2.9:把配置好的hadoop文件复制到其他的子机器中

scp -r /usr/bigdata/hadoop/hadoop-2.8.0 root@slave1:/usr/bigdata/hadoop

scp -r /usr/bigdata/hadoop/hadoop-2.8.0 root@slave2:/usr/bigdata/hadoop

3.0把配置好的/etc/profile复制到其他两个子机器中

scp /etc/profile root@slave1:/etc/profile

scp /etc/profile root@slave2:/etc/profile

分别在两个子机器中应用/etc/profile

source /etc/profile

3.1:在master 主机器中运行

hdfs namenode -format

3.2:在master 主机器中启动hadoop环境

进入/usr/bigdata/hadoop/hadoop-2.8.0/sbin

./start-all.sh 启动hadoop集群

./stop-all.sh 关闭hadoop集群

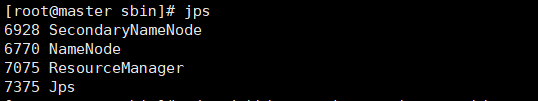

3.3:jps

vim jps

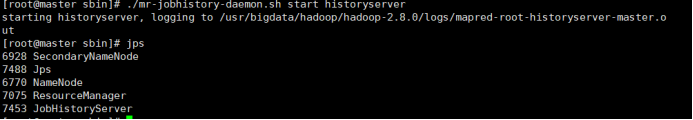

3.4:启动JobHistoryServer

./mr-jobhistory-daemon.sh start historyserver

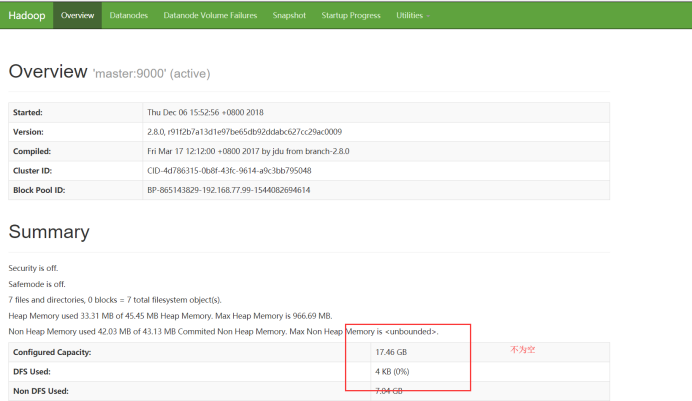

访问页面:

Hadoop集群搭建成功

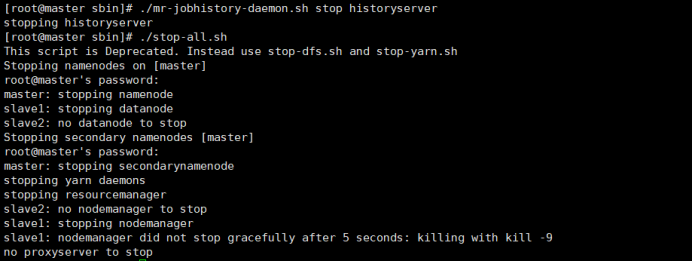

3.5关闭:

第一步:

关闭JobHistoryServer

./mr-jobhistory-daemon.sh stop historyserver

第二步:

关闭hadoop集群

./stop-all.sh

Linux 搭建Hadoop集群 成功的更多相关文章

- Linux 搭建Hadoop集群错误锦集

一.Hadoop集群配置好后,执行start-dfs.sh后报错,一堆permission denied zf sbin $ ./start-dfs.sh Starting namenodes on ...

- Linux 搭建Hadoop集群 ----workcount案例

在 Linux搭建集群---JDK配置 Linux搭建集群---SSH免密登陆 Linux搭建集群---集群搭建成功 的基础上实现workcount案例 注意 虚拟机三台启动集群(自己亲自搭建) 1. ...

- Linux搭建Hadoop集群---Jdk配置

三台虚拟机:master slave1 slave2 192.168.77.99 master 192.168.77.88 slave1 192.168.77.77 slave2 1.修改主机名: ...

- 使用Docker搭建Hadoop集群(伪分布式与完全分布式)

之前用虚拟机搭建Hadoop集群(包括伪分布式和完全分布式:Hadoop之伪分布式安装),但是这样太消耗资源了,自学了Docker也来操练一把,用Docker来构建Hadoop集群,这里搭建的Hado ...

- Linux下搭建Hadoop集群

本文地址: 1.前言 本文描述的是如何使用3台Hadoop节点搭建一个集群.本文中,使用的是三个Ubuntu虚拟机,并没有使用三台物理机.在使用物理机搭建Hadoop集群的时候,也可以参考本文.首先这 ...

- 使用Windows Azure的VM安装和配置CDH搭建Hadoop集群

本文主要内容是使用Windows Azure的VIRTUAL MACHINES和NETWORKS服务安装CDH (Cloudera Distribution Including Apache Hado ...

- 搭建Hadoop集群 (一)

上面讲了如何搭建Hadoop的Standalone和Pseudo-Distributed Mode(搭建单节点Hadoop应用环境), 现在我们来搭建一个Fully-Distributed Mode的 ...

- virtualbox 虚拟3台虚拟机搭建hadoop集群

用了这么久的hadoop,只会使用streaming接口跑任务,各种调优还不熟练,自定义inputformat , outputformat, partitioner 还不会写,于是干脆从头开始,自己 ...

- 搭建Hadoop集群 (三)

通过 搭建Hadoop集群 (二), 我们已经可以顺利运行自带的wordcount程序. 下面学习如何创建自己的Java应用, 放到Hadoop集群上运行, 并且可以通过debug来调试. 有多少种D ...

随机推荐

- Fluxion无线攻击

使用步骤 github地址 https://github.com/deltaxflux/fluxion 进入到fluxion目录下 ./fluxion 启动fluxion 启动之后会先检测没有安装的 ...

- Java IO--NIO(二)

在我的上一篇文章JavaNIO详解(一)中介绍了关于标准输入输出NIO相关知识, 本篇将重点介绍基于网络编程NIO(异步IO). 异步IO 异步 I/O 是一种没有阻塞地读写数据的方法.通常,在代码进 ...

- Python 第五阶段 学习记录之---Django 基础

Python的WEB框架有Django.Tornado.Flask 等多种,Django相较与其他WEB框架其优势为:大而全,框架本身集成了ORM.模型绑定.模板引擎.缓存.Session等诸多功能. ...

- c#链接access数据库

public ActionResult Index() { OleDbDataAdapter db = new OleDbDataAdapter("select * from [user]& ...

- chm开源文档制作

作为开发人员,API文档是非常关键的^_^,但是很多时候官方提供的文档是html的docs,不方便于携带查询,本章主要介绍chm文档的制作方法. 使用jd2chm制作chm文档 安装之前必须先安装 h ...

- mybatis常见问题和错误

1. jdbc java type 映射关系 1) mysql的text 在mybatis中使用varchar类型 2. mybatis常见的错误 3.There is no getter for p ...

- vs2017 exe在Linux上运行

1:将vs .netcore控制台项目发布打包(比如文件名为:demo2core.zip,以下会用到) 2:使用XShell软件连接Linux a.在linux上使用命令 id addr找出ip地址 ...

- Python 事件驱动了解

事件驱动 gevent协程可实现自动切换,协程在遇到IO时会进行切换,到另外一个请求,那协程是如何得知在什么时候在切换回去呢? 通常,我们写服务器处理模型的程序时,有以下几种模型: (1)每收到一 ...

- [C++ Primer Plus] 第7章、函数(一)程序清单——递归,指针和const,指针数组和数组指针,函数和二维数组

程序清单7.6 #include<iostream> using namespace std; ; int sum_arr(int arr[], int n);//函数声明 void ma ...

- version control的简单认知

version control 版本控制是一种记录文件或文件集随时间变化的系统,以便您以后可以调用特定版本.对于本书中的示例,您将使用软件源代码作为受版本控制的文件,但实际上您可以使用计算机上的几乎任 ...