scrapy异步的爬虫框架简单的使用

scrapy异步的爬虫框架

异步的爬虫框架

高性能的数据解析,持久化存储,全栈数据的爬取,中间件,分布式

框架:就是一个集成好了各种功能且具有很强通用性的一个项目模板。

环境安装:

Linux:

pip3 install scrapy

Windows:

1. pip3 install wheel

2. 下载twisted http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

3. 进入下载目录,执行 pip3 install Twisted‑17.1.0‑cp35‑cp35m‑win_amd64.whl

4. pip3 install pywin32

5. pip3 install scrapy

基本使用

新建一个工程:

前提需要将

Twisted‑17.1.0‑cp35‑cp35m‑win_amd64.whl这个文件放在项目目录下# 在终端中执行下面这个命令

scrapy startporject + “项目名”

- settings.py:当前工程的配置文件

- spiders:爬虫包,必须要存放一个或者多个爬虫文件(.py)

进入项目

# 在终端中执行

cd + 项目名

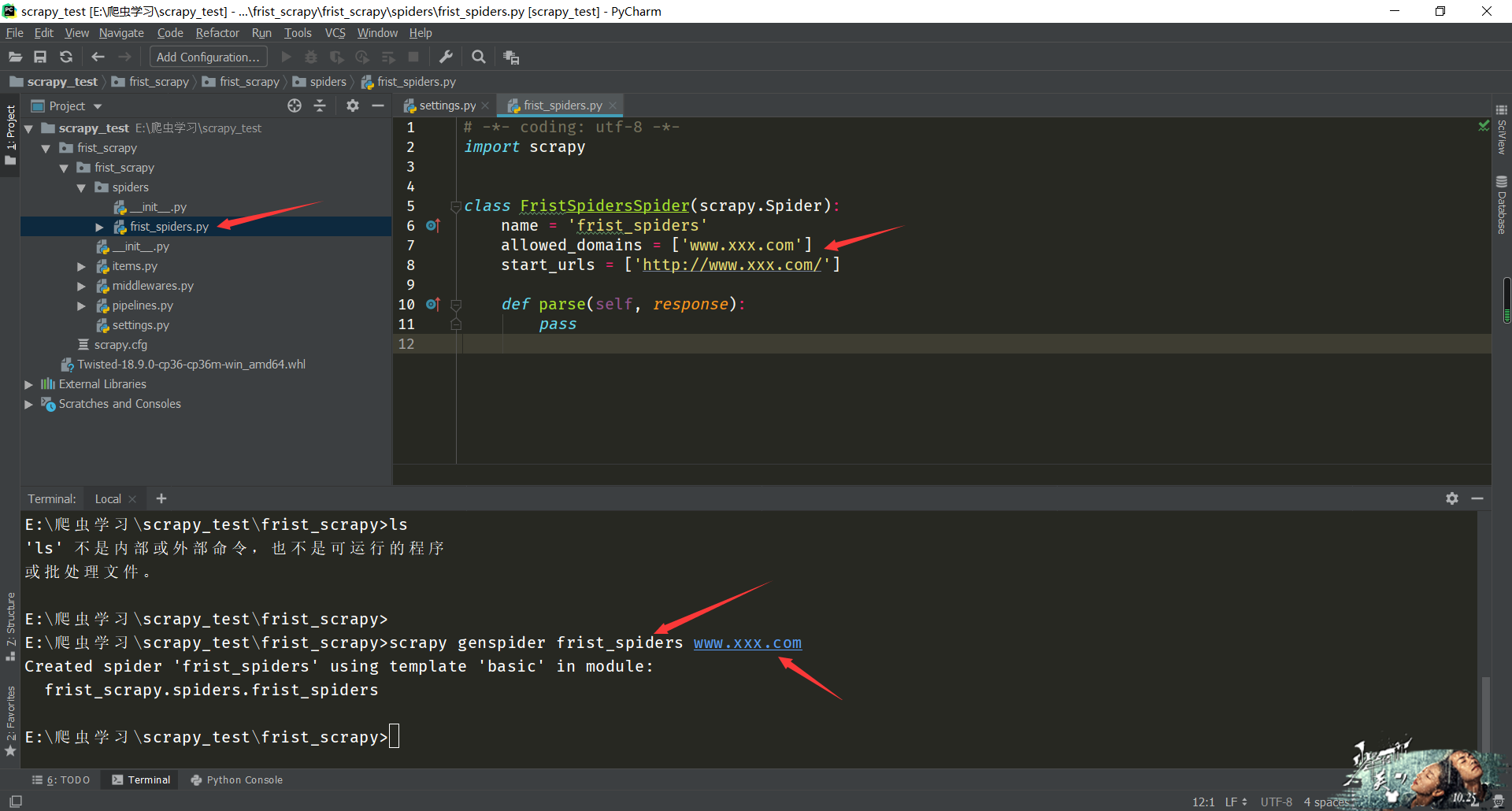

创建一个爬虫文件:

# 在终端中执行:

scrapy genspider spiderName www.xxx.com # 命令解析:

scrapy genspider 爬虫文件名 url

# 这个url是必写的,不写无法创建文件,可以随意些,最后在文件中修改

执行工程:

# 在终端中执行下面的命令:

scrapy crawl spiderName # 执行命令scrapy crawl 加爬虫文件名

在

sttings文件中需要配置的:settings.py: - 不遵从robots协议

如果选择不遵循robots协议的就修改文件中的

ROBOTSTXT_OBEY = False # 将True改为False - UA伪装

将UA伪装的数据加载文件中 - 指定日志输出的类型:

将 LOG_LEVEL = 'ERROR' 添加到配置文件中

爬虫文件中:

# -*- coding: utf-8 -*-

import scrapy class SecondSpidersSpider(scrapy.Spider):

name = 'second_spiders'

#允许的域名

allowed_domains = ['www.123.com'] #起始的url列表:列表元素只可以是url

#作用:列表元素表示的url就会被进行请求发送

start_urls = ['http://duanziwang.com/category/%E7%BB%8F%E5%85%B8%E6%AE%B5%E5%AD%90/'] def parse(self, response):

all_data = []

article_list = response.xpath('/html/body/section/div/div/main/article')

for article in article_list:

# xpath在进行数据提取时,返回的不再是字符串而是一个Selector对象,想要的数据被包含在了该对象的data参数中 title = article.xpath('./div[1]/h1/a/text()').extract_first()

content = article.xpath('./div[2]//text()').extract()

content = ''.join(content)

dic = {

'title': title,

'content': content

}

all_data.append(dic)

return all_data # 将解析到的数据进行了返回

数据解析:

- 1.response.xpath('xpath表达式')

- 2.scrapy中的xpath解析,在进行数据提取的时候,xpath方法返回的列表中存储的不再是字符串,

而是存储的Selector对象,相关的字符串数据是存储在Selector对象的data参数中,我们必须使用

extract()/extract_first()进行字符串数据的提取 - extract():可以作用到列表中的每一个列表元素中,返回的依然是一个列表

- extract_first():只可以作用到列表中的第一个列表元素中,返回的是字符串

持久化存储

- 基于终端指令的持久化存储

- 只可以将parse方法的返回值存储到指定后缀的文本文件中。

- scrapy crawl spiderName -o ./duanzi.csv

- 基于管道的持久化存储

- 基于终端指令的持久化存储

scrapy异步的爬虫框架简单的使用的更多相关文章

- 使用Scrapy爬虫框架简单爬取图片并保存本地(妹子图)

初学Scrapy,实现爬取网络图片并保存本地功能 一.先看最终效果 保存在F:\pics文件夹下 二.安装scrapy 1.python的安装就不说了,我用的python2.7,执行命令pip ins ...

- 一篇文章教会你理解Scrapy网络爬虫框架的工作原理和数据采集过程

今天小编给大家详细的讲解一下Scrapy爬虫框架,希望对大家的学习有帮助. 1.Scrapy爬虫框架 Scrapy是一个使用Python编程语言编写的爬虫框架,任何人都可以根据自己的需求进行修改,并且 ...

- python网络爬虫(14)使用Scrapy搭建爬虫框架

目的意义 爬虫框架也许能简化工作量,提高效率等.scrapy是一款方便好用,拓展方便的框架. 本文将使用scrapy框架,示例爬取自己博客中的文章内容. 说明 学习和模仿来源:https://book ...

- 『Scrapy』爬虫框架入门

框架结构 引擎:处于中央位置协调工作的模块 spiders:生成需求url直接处理响应的单元 调度器:生成url队列(包括去重等) 下载器:直接和互联网打交道的单元 管道:持久化存储的单元 框架安装 ...

- Scrapy网络爬虫框架的开发使用

1.安装 2.使用scrapy startproject project_name 命令创建scrapy项目 如图: 3.根据提示使用scrapy genspider spider_name dom ...

- 网络爬虫框架Scrapy简介

作者: 黄进(QQ:7149101) 一. 网络爬虫 网络爬虫(又被称为网页蜘蛛,网络机器人),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本:它是一个自动提取网页的程序,它为搜索引擎从万维 ...

- [原创]一款基于Reactor线程模型的java网络爬虫框架

AJSprider 概述 AJSprider是笔者基于Reactor线程模式+Jsoup+HttpClient封装的一款轻量级java多线程网络爬虫框架,简单上手,小白也能玩爬虫, 使用本框架,只需要 ...

- Python之Scrapy爬虫框架安装及简单使用

题记:早已听闻python爬虫框架的大名.近些天学习了下其中的Scrapy爬虫框架,将自己理解的跟大家分享.有表述不当之处,望大神们斧正. 一.初窥Scrapy Scrapy是一个为了爬取网站数据,提 ...

- 教你分分钟学会用python爬虫框架Scrapy爬取心目中的女神

本博文将带领你从入门到精通爬虫框架Scrapy,最终具备爬取任何网页的数据的能力.本文以校花网为例进行爬取,校花网:http://www.xiaohuar.com/,让你体验爬取校花的成就感. Scr ...

随机推荐

- matplotlib的学习15-次坐标轴

import matplotlib.pyplot as plt import numpy as np x = np.arange(0, 10, 0.1) y1 = 0.05 * x**2 y2 = - ...

- ctf/web源码泄露及利用办法

和上一篇文章差不多,也算是对web源码泄露的一个总结,但是这篇文章更侧重于CTF 参考文章: https://blog.csdn.net/wy_97/article/details/78165051? ...

- Synchronized用法原理和锁优化升级过程(面试)

简介 多线程一直是面试中的重点和难点,无论你现在处于啥级别段位,对synchronized关键字的学习避免不了,这是我的心得体会.下面咱们以面试的思维来对synchronized做一个系统的描述,如果 ...

- C#随机生成不重复邀请码&创建登录Token&转换人民币大小金额

/// <summary> /// 创建登陆Token /// </summary> /// <param name="length">< ...

- C#中RDLC报表常用表达式(字符串和转换)

字符串函数 (1)使用串联运算符和 Visual Basic 常量可将多个字段组合在一起.以下表达式返回两个字段,它们分别位于同一文本框的不同行中:=Fields!FirstName.Value &a ...

- ElasticSearch设置用户名密码访问

版本号:7.3.1 1.需要在配置文件中开启x-pack验证, 修改config目录下面的elasticsearch.yml文件,在里面添加如下内容,并重启. xpack.security.enabl ...

- CentOS Linux SVN服务器 配置用户目录访问 权限 Authorization failed

SVN 修改 aurhz 文件设置用户目录访问权限格式: [/code] user=rw user 用户对code目录拥有读和写的权限. 但是访问 svn://192.168.1.59 的时候却提示A ...

- 看图知义,Winform开发的技术特点分析

整理一下自己之前的Winform开发要点,以图文的方式展示一些关键性的技术特点,总结一下. 1.主体界面布局 2.权限管理系统 3.工作流模块 4.字典管理 5.通用的附件管理模块 6.系统模块化开发 ...

- [Skill]加速npm与yarn还原

npm源 使用cnpm alias cnpm="npm --registry=https://registry.npm.taobao.org //或者 npm install -g cnpm ...

- Linux 设置静态IP

由于工作需要,安装一套Linux系统.安装完成后发现这个家伙居然不能上网,然后看了下IP,(命令 ip a)发现是127.0.0.1 下面是我的界面: inet 是127.0.0.1/8 还有6个网卡 ...