七月在线爬虫班学习笔记(五)——scrapy spider的几种爬取方式

第五课主要内容有:

- Scrapy框架结构,组件及工作方式

- 单页爬取-julyedu.com

- 拼URL爬取-博客园

- 循环下页方式爬取-toscrape.com

- Scrapy项目相关命令-QQ新闻

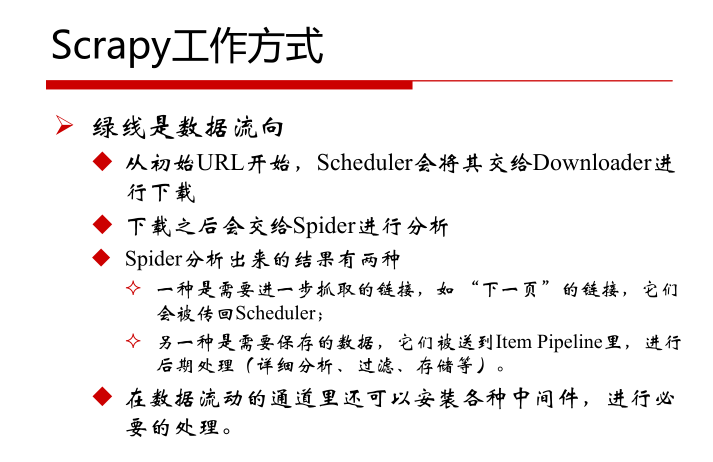

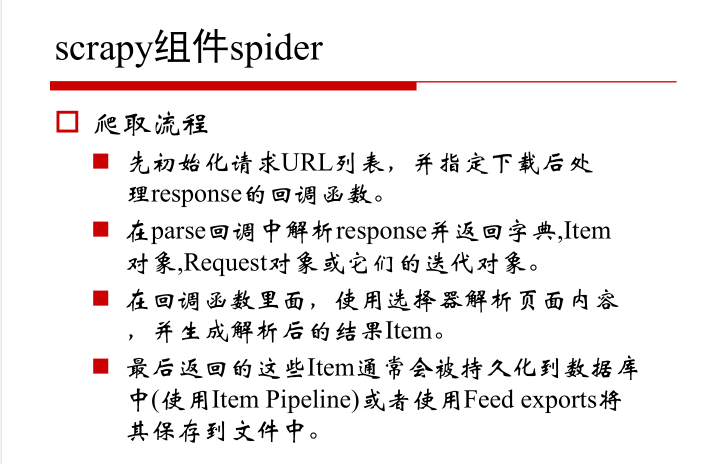

1.Scrapy框架结构,组件及工作方式

2.单页爬取-julyedu.com

#by 寒小阳(hanxiaoyang.ml@gmail.com)---七月在线讲师

#Python2 import scrapy class JulyeduSpider(scrapy.Spider):

name = "julyedu"

start_urls = [

'https://www.julyedu.com/category/index',

] def parse(self, response):

for julyedu_class in response.xpath('//div[@class="course_info_box"]'):

print julyedu_class.xpath('a/h4/text()').extract_first()

print julyedu_class.xpath('a/p[@class="course-info-tip"][1]/text()').extract_first()

print julyedu_class.xpath('a/p[@class="course-info-tip"][2]/text()').extract_first()

print response.urljoin(julyedu_class.xpath('a/img[1]/@src').extract_first())

print "\n" yield {

'title':julyedu_class.xpath('a/h4/text()').extract_first(),

'desc': julyedu_class.xpath('a/p[@class="course-info-tip"][1]/text()').extract_first(),

'time': julyedu_class.xpath('a/p[@class="course-info-tip"][2]/text()').extract_first(),

'img_url': response.urljoin(julyedu_class.xpath('a/img[1]/@src').extract_first())

}

3.拼URL爬取-博客园

#by 寒小阳(hanxiaoyang.ml@gmail.com) import scrapy class CnBlogSpider(scrapy.Spider):

name = "cnblogs"

allowed_domains = ["cnblogs.com"]

start_urls = [

'http://www.cnblogs.com/pick/#p%s' % p for p in xrange(1, 11)

] def parse(self, response):

for article in response.xpath('//div[@class="post_item"]'):

print article.xpath('div[@class="post_item_body"]/h3/a/text()').extract_first().strip()

print response.urljoin(article.xpath('div[@class="post_item_body"]/h3/a/@href').extract_first()).strip()

print article.xpath('div[@class="post_item_body"]/p/text()').extract_first().strip()

print article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/a/text()').extract_first().strip()

print response.urljoin(article.xpath('div[@class="post_item_body"]/div/a/@href').extract_first()).strip()

print article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/span[@class="article_comment"]/a/text()').extract_first().strip()

print article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/span[@class="article_view"]/a/text()').extract_first().strip()

print "" yield {

'title': article.xpath('div[@class="post_item_body"]/h3/a/text()').extract_first().strip(),

'link': response.urljoin(article.xpath('div[@class="post_item_body"]/h3/a/@href').extract_first()).strip(),

'summary': article.xpath('div[@class="post_item_body"]/p/text()').extract_first().strip(),

'author': article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/a/text()').extract_first().strip(),

'author_link': response.urljoin(article.xpath('div[@class="post_item_body"]/div/a/@href').extract_first()).strip(),

'comment': article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/span[@class="article_comment"]/a/text()').extract_first().strip(),

'view': article.xpath('div[@class="post_item_body"]/div[@class="post_item_foot"]/span[@class="article_view"]/a/text()').extract_first().strip(),

}

4.找到‘下一页’标签进行爬取

import scrapy class QuotesSpider(scrapy.Spider):

name = "quotes"

start_urls = [

'http://quotes.toscrape.com/tag/humor/',

] def parse(self, response):

for quote in response.xpath('//div[@class="quote"]'):

yield {

'text': quote.xpath('span[@class="text"]/text()').extract_first(),

'author': quote.xpath('span/small[@class="author"]/text()').extract_first(),

} next_page = response.xpath('//li[@class="next"]/@herf').extract_first()

if next_page is not None:

next_page = response.urljoin(next_page)

yield scrapy.Request(next_page, callback=self.parse)

5.进入链接,按照链接进行爬取

#by 寒小阳(hanxiaoyang.ml@gmail.com) import scrapy class QQNewsSpider(scrapy.Spider):

name = 'qqnews'

start_urls = ['http://news.qq.com/society_index.shtml'] def parse(self, response):

for href in response.xpath('//*[@id="news"]/div/div/div/div/em/a/@href'):

full_url = response.urljoin(href.extract())

yield scrapy.Request(full_url, callback=self.parse_question) def parse_question(self, response):

print response.xpath('//div[@class="qq_article"]/div/h1/text()').extract_first()

print response.xpath('//span[@class="a_time"]/text()').extract_first()

print response.xpath('//span[@class="a_catalog"]/a/text()').extract_first()

print "\n".join(response.xpath('//div[@id="Cnt-Main-Article-QQ"]/p[@class="text"]/text()').extract())

print ""

yield {

'title': response.xpath('//div[@class="qq_article"]/div/h1/text()').extract_first(),

'content': "\n".join(response.xpath('//div[@id="Cnt-Main-Article-QQ"]/p[@class="text"]/text()').extract()),

'time': response.xpath('//span[@class="a_time"]/text()').extract_first(),

'cate': response.xpath('//span[@class="a_catalog"]/a/text()').extract_first(),

}

七月在线爬虫班学习笔记(五)——scrapy spider的几种爬取方式的更多相关文章

- 七月在线爬虫班学习笔记(六)——scrapy爬虫整体示例

第六课主要内容: 爬豆瓣文本例程 douban 图片例程 douban_imgs 1.爬豆瓣文本例程 douban 目录结构 douban --douban --spiders --__init__. ...

- 七月在线爬虫班学习笔记(二)——Python基本语法及面向对象

第二课主要内容如下: 代码格式 基本语法 关键字 循环判断 函数 容器 面向对象 文件读写 多线程 错误处理 代码格式 syntax基本语法 a = 1234 print(a) a = 'abcd' ...

- 【学习笔记】Python 3.6模拟输入并爬取百度前10页密切相关链接

[学习笔记]Python 3.6模拟输入并爬取百度前10页密切相关链接 问题描述 通过模拟网页,实现百度搜索关键词,然后获得网页中链接的文本,与准备的文本进行比较,如果有相似之处则代表相关链接. me ...

- Dynamic CRM 2013学习笔记(十)客户端几种查询数据方式比较

我们经常要在客户端进行数据查询,下面分别比较常用的几种查询方式:XMLHttpRequest, SDK.JQuery, SDK.Rest. XMLHttpRequest是最基本的调用方式,JQuery ...

- (3)分布式下的爬虫Scrapy应该如何做-递归爬取方式,数据输出方式以及数据库链接

放假这段时间好好的思考了一下关于Scrapy的一些常用操作,主要解决了三个问题: 1.如何连续爬取 2.数据输出方式 3.数据库链接 一,如何连续爬取: 思考:要达到连续爬取,逻辑上无非从以下的方向着 ...

- scrapy爬虫框架学习笔记(一)

scrapy爬虫框架学习笔记(一) 1.安装scrapy pip install scrapy 2.新建工程: (1)打开命令行模式 (2)进入要新建工程的目录 (3)运行命令: scrapy sta ...

- Scrapy:学习笔记(2)——Scrapy项目

Scrapy:学习笔记(2)——Scrapy项目 1.创建项目 创建一个Scrapy项目,并将其命名为“demo” scrapy startproject demo cd demo 稍等片刻后,Scr ...

- go微服务框架kratos学习笔记五(kratos 配置中心 paladin config sdk [断剑重铸之日,骑士归来之时])

目录 go微服务框架kratos学习笔记五(kratos 配置中心 paladin config sdk [断剑重铸之日,骑士归来之时]) 静态配置 flag注入 在线热加载配置 远程配置中心 go微 ...

- C#可扩展编程之MEF学习笔记(五):MEF高级进阶

好久没有写博客了,今天抽空继续写MEF系列的文章.有园友提出这种系列的文章要做个目录,看起来方便,所以就抽空做了一个,放到每篇文章的最后. 前面四篇讲了MEF的基础知识,学完了前四篇,MEF中比较常用 ...

随机推荐

- python笔记---@classmethod @staticmethod

python定义类方法的三种方式: 1.常规方式--需要通过self参数隐式的传递当前类对象的实例 2.@classmethod修饰方式--@classmethod修饰的方法class_foo()需要 ...

- 移动端input“输入框”常见问题及解决方法

转自 https://www.cnblogs.com/ljx20180807/p/9837748.html 1. ios中,输入框获得焦点时,页面输入框被遮盖,定位的元素位置错乱: 当页input存在 ...

- OpenGL.Tutorial文章转载

ZC:本来以为没有中文版的,原来有中文版,网址为: ZC: OpenGL3.0教程 _ 泰然网.html(http://www.tairan.com/archives/6126/) ZC: OpenG ...

- Dart学习-操作符

dart定义了下表所示的运算符.你可以重写许多这些运算符. 描述 运算符 一元后缀 expr++ expr-- () [] . ?. 一元前缀 -expr !expr ~expr ++expr --e ...

- CDH 报错:UnicodeEncodeError: 'ascii' codec can't encode characters in position 0-11: ordinal not in range

1.在CDH集群启动Hue服务时,出现了错误,如下图: 2.上图显示得知,是调用python文件(/opt/cloudera/parcels/CDH-5.16.1-1.cdh5.16.1.p0.3/l ...

- 多重线性回归 (multiple linear regression) | 变量选择 | 最佳模型 | 基本假设的诊断方法

P133,这是第二次作业,考察多重线性回归.这个youtube频道真是精品,用R做统计.这里是R代码的总结. 连续变量和类别型变量总要分开讨论: 多重线性回归可以写成矩阵形式的一元一次回归:相当于把多 ...

- node中 path.resolve 和path.join的区别

path.resolve('a','b','c') 返回a/b/c path.resolve理论上总是以前一个路径作为基础路径,然后匹配当前路径,当前路径会有三种情况根目录(/),当前目录(./),上 ...

- bilinear pooling

一.双线性汇合的计算过程: 第一步,计算Gram 矩阵: 对于一组H×W×D的feature maps,$\boldsymbol{x}_{i} \in \mathbb{R}^{D}$是图像的深度描述, ...

- JavaScript前端面试题总结

1.em和rem 像素(px):用于元素的边框或定位. em/rem:用于做响应式页面,em相对于父元素,rem相对于根元素. rem 单位翻译为像素值是由 html 元素的字体大小决定的. 此字体大 ...

- boost库中的 program_options

1.阅读rviz中的源码时在rviz/visualizer_app.cpp中遇到如下代码: po::options_description options; options.add_options() ...