python爬虫学习之使用XPath解析开奖网站

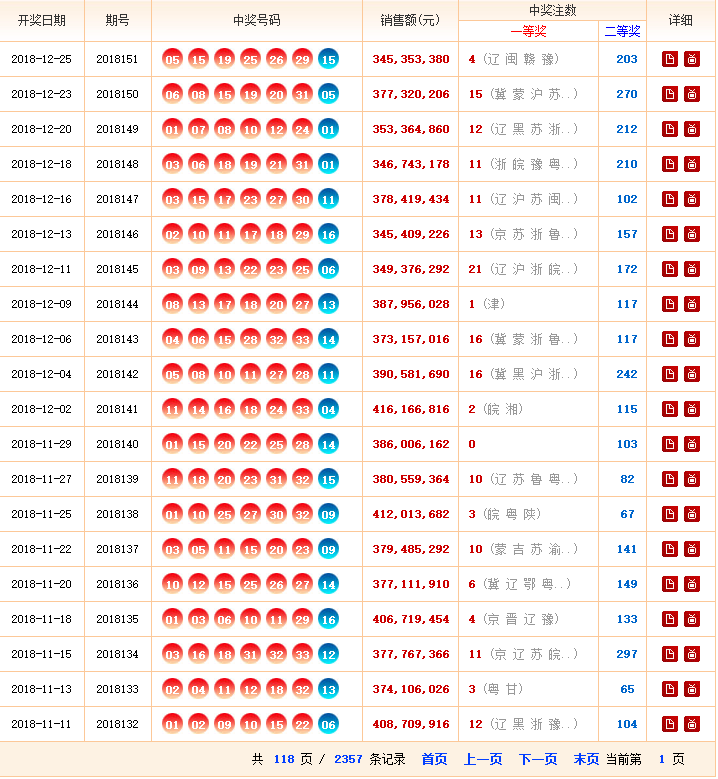

实例需求:运用python语言爬取http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html这个开奖网站所有的信息,并且保存为txt文件。

实例环境:python3.7

BeautifulSoup库、XPath(需手动安装)

urllib库(内置的python库,无需手动安装)

实例网站:

第一步,点击链接http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html进入网站,查看网站基本信息,注意一共要爬取118页数据。

第二步,查看网页源代码,熟悉网页结构,标签等信息。

实例代码:

#encoding=utf-8

#pip install lxml

from bs4 import BeautifulSoup

import urllib.request

from lxml import etree class GetDoubleColorBallNumber(object):

def __init__(self):

self.urls = []

self.getUrls()

self.items = self.spider(self.urls)

self.pipelines(self.items) def getUrls(self):

URL = r'http://kaijiang.zhcw.com/zhcw/html/ssq/list.html'

htmlContent = self.getResponseContent(URL)

soup = BeautifulSoup(htmlContent, 'html.parser')

tag = soup.find_all('p')[-1]

pages = tag.strong.get_text()

pages = '3'

for i in range(2, int(pages)+1):

url = r'http://kaijiang.zhcw.com/zhcw/html/ssq/list_' + str(i) + '.html'

self.urls.append(url) #3、 网络模块(NETWORK)

def getResponseContent(self, url):

try:

response = urllib.request.urlopen(url)

except urllib.request.URLError as e:

raise e

else:

return response.read().decode("utf-8") #3、爬虫模块(Spider)

def spider(self,urls):

items = []

for url in urls:

try:

html = self.getResponseContent(url)

xpath_tree = etree.HTML(html)

trTags = xpath_tree.xpath('//tr[not(@*)]') # 匹配所有tr下没有任何属性的节点

for tag in trTags: # if tag.xpath('../html'):

# print("找到了html标签")

# if tag.xpath('/td/em'):

# print("****************") #如果存在em子孙节点

if tag.xpath('./td/em'):

item = {}

item['date'] = tag.xpath('./td[1]/text()')[0]

item['order'] = tag.xpath('./td[2]/text()')[0]

item['red1'] = tag.xpath('./td[3]/em[1]/text()')[0]

item['red2'] = tag.xpath('./td[3]/em[2]/text()')[0]

item['red3'] = tag.xpath('./td[3]/em[3]/text()')[0]

item['red4'] = tag.xpath('./td[3]/em[4]/text()')[0]

item['red5'] = tag.xpath('./td[3]/em[5]/text()')[0]

item['red6'] = tag.xpath('./td[3]/em[6]/text()')[0]

item['blue'] = tag.xpath('./td[3]/em[7]/text()')[0]

item['money'] = tag.xpath('./td[4]/strong/text()')[0]

item['first'] = tag.xpath('./td[5]/strong/text()')[0]

item['second'] = tag.xpath('./td[6]/strong/text()')[0]

items.append(item)

except Exception as e:

print(str(e))

raise e

return items def pipelines(self,items):

fileName = u'双色球.txt'

with open(fileName, 'w') as fp:

for item in items:

fp.write('%s %s \t %s %s %s %s %s %s %s \t %s \t %s %s \n'

%(item['date'],item['order'],item['red1'],item['red2'],item['red3'],item['red4'],item['red5'],item['red6'],item['blue'],item['money'],item['first'],item['second'])) if __name__ == '__main__':

GDCBN = GetDoubleColorBallNumber()

实例结果:

python爬虫学习之使用XPath解析开奖网站的更多相关文章

- Python爬虫学习之使用beautifulsoup爬取招聘网站信息

菜鸟一只,也是在尝试并学习和摸索爬虫相关知识. 1.首先分析要爬取页面结构.可以看到一列搜索的结果,现在需要得到每一个链接,然后才能爬取对应页面. 关键代码思路如下: html = getHtml(& ...

- python爬虫学习之使用BeautifulSoup库爬取开奖网站信息-模块化

实例需求:运用python语言爬取http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html这个开奖网站所有的信息,并且保存为txt文件和excel文件. 实 ...

- python爬虫学习笔记(一)——环境配置(windows系统)

在进行python爬虫学习前,需要进行如下准备工作: python3+pip官方配置 1.Anaconda(推荐,包括python和相关库) [推荐地址:清华镜像] https://mirrors ...

- Python爬虫学习:三、爬虫的基本操作流程

本文是博主原创随笔,转载时请注明出处Maple2cat|Python爬虫学习:三.爬虫的基本操作与流程 一般我们使用Python爬虫都是希望实现一套完整的功能,如下: 1.爬虫目标数据.信息: 2.将 ...

- Python爬虫教程-22-lxml-etree和xpath配合使用

Python爬虫教程-22-lxml-etree和xpath配合使用 lxml:python 的HTML/XML的解析器 官网文档:https://lxml.de/ 使用前,需要安装安 lxml 包 ...

- 小白学 Python 爬虫(21):解析库 Beautiful Soup(上)

小白学 Python 爬虫(21):解析库 Beautiful Soup(上) 人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前 ...

- 小白学 Python 爬虫(22):解析库 Beautiful Soup(下)

人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前置准备(一)基本类库的安装 小白学 Python 爬虫(3):前置准备(二)Li ...

- 小白学 Python 爬虫(23):解析库 pyquery 入门

人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前置准备(一)基本类库的安装 小白学 Python 爬虫(3):前置准备(二)Li ...

- python爬虫学习01--电子书爬取

python爬虫学习01--电子书爬取 1.获取网页信息 import requests #导入requests库 ''' 获取网页信息 ''' if __name__ == '__main__': ...

随机推荐

- TFS 删除版本控制

该文章引用至: https://www.cnblogs.com/yanjiez/p/10184845.html 1. 删除所有版本控制文件 *.vssscc , *.vspscc 2. 修改解决方案 ...

- XUbuntu18.04(Bionic河狸)正式发布,系统安装升级记录

XUbuntu18.04(Bionic河狸)正式发布,系统安装升级记录 详细介绍: https://blog.pythonwood.com/2018/04/XUbuntu18.04(Bionic河狸) ...

- 关于项目里server清楚缓存的代码

Venk proc存在很多问题,不能应对高并发的情况,所以提供了这个 方法来清理cache, 但是前提是需要有prod的权限: 要想验证是否通过URL清楚了缓存,就要 removeCache url执 ...

- Element transfer 两边数据(左右)的显示问题?

本仙今天遇到这个穿梭框的问题 这个是我前几天刚换的(原来用的是iview的,换成了element ) 别问我为什么,用过iview的都知道 转入正题 问题:从后台获取的数据全部都显示在了我的左边框中 ...

- Eureka的服务注册与发现概念(三)

一.Eureka介绍 Netflix在设计Eureka时遵守的AP原则.Eureka是Netflix的一个子模块,也是核心模块之一.Eureka是一个基于REST的服务,用于定位服务,以实现云端中间层 ...

- python基础中的四大天王-增-删-改-查

列表-list-[] 输入内存储存容器 发生改变通常直接变化,让我们看看下面列子 增---默认在最后添加 #append()--括号中可以是数字,可以是字符串,可以是元祖,可以是集合,可以是字典 #l ...

- C51汇编典型代码&一些org-mode技巧

C51汇编典型代码&一些org-mode技巧 文档存放 具体内容可见存放的数据. 下面主要介绍关键代码. ASM 部分 1;; LCD数据发送========================= ...

- Callable Future接口的设计原理

我们都知道Callable接口作为任务给线程池来执行,可以通过Future对象来获取返回值,他们背后的实现原理是什么?通过总结背后的实现原理有助于我们深入的理解相关技术,做到触类旁通和举一反三. 文章 ...

- MySQL 聚合函数 控制流程函数

常用的聚合函数 1. AVG() 求平均值 mysql> AVG([DISTINCT] expr) -- 返回 expr 的平均值 mysql> select AVG(age) from ...

- 博客三--tensorflow的队列及线程基本操作

连接我的开源中国账号:https://my.oschina.net/u/3770644/blog/3036960查询