Hadoop+Hive 操作mongodb数据

Hadoop+Hive 操作mongodb数据

1、版本概述

hadoop-2.7.3、hive-2.2

下载响应的jar包:http://mvnrepository.com/,直接搜索想要的jar包,例如本次安装需要的:

mongo-hadoop-core-2.0.2.jar、mongo-hadoop-hive-2.0.2.jar、mongo-java-driver-3.2.1.jar

下载自己需要的版本,版本要统一。

2、配置

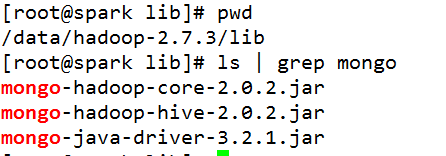

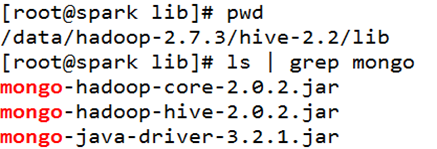

将下载好的jar包分别上传到hadoop和hive的lib目录下:

3、启动hive,加载jar包

进入到hive的家目录下的bin目录,./hive

hive>add jar /data/hadoop-2.7.3/hive-2.2/lib/mongo-hadoop-core-2.0.2.jar;

hive>add jar /data/hadoop-2.7.3/hive-2.2/lib/mongo-hadoop-hive-2.0.2.jar;

hive>add jar /data/hadoop-2.7.3/hive-2.2/lib/mongo-java-driver-3.2.1.jar;

4、hive操作mongodb方式有两种:

1)MongoDB-based 直接连接hidden节点,使用 com.mongodb.hadoop.hive.MongoStorageHandler做数据Serde

2)BSON-based 将数据dump成bson文件,上传到HDFS系统,使用 com.mongodb.hadoop.hive.BSONSerDe

5、mongodb-based:

在命令行直接运行hive:

# hivehive> CREATE TABLE eventlog (

> id string,

> userid string,

> type string,

> objid string,

> time string,

> source string)

> STORED BY

'com.mongodb.hadoop.hive.MongoStorageHandler'

> WITH

SERDEPROPERTIES('mongo.columns.mapping'='{"id":"_id"}')

> TBLPROPERTIES('mongo.uri'='mongodb://user:password@ip:port

/saturn.users');有两种方式来指定所需连接的Mongo Collection。

1. 在上述示例里面,通过mongo.uri这个表属性来指定,属性的值填入的是MongoDB connection string,通过它来指向具体的collection。这种方式会将这个URI存入表的metadata里面,如果需要填写连接的一些认证信息(如username:password等),该方式不太适合。

2. 第二种方式是把connection string填入一个properties文件,如:# HiveTable.properties

mongo.input.uri=mongodb://user:password@ip:port /saturn.users'然后提供这个文件的路径给

mongo.properties.path这个表参数,如hive> CREATE EXTERNAL TABLE eventlog (TBLPROPERTIES('mongo.properties.path'='HiveTable.properties');

> id string,

> userid string,

> type string,

> objid string,

> time string,

> source string)

> STORED BY

'com.mongodb.hadoop.hive.MongoStorageHandler'

> WITH

SERDEPROPERTIES('mongo.columns.mapping'='{"id":"_id"}')

>hive> select * from eventlog limit 10;

OK

5694b8807aff70d36f526a19 NULL

NULL NULL NULL

NULL

56960a27f95a32ad7e2b9719 NULL

NULL NULL NULL

NULL

56961da0f95a32ad7e2b971c NULL

NULL NULL NULL

NULL

56961eeaf95a32ad7e2b9721 NULL

NULL NULL NULL

NULL

569735e4837bb8e43e0260b1 NULL

NULL NULL NULL

NULL

56973672837bb8e43e0260b3 NULL NULL

NULL NULL NULL

56974a73837bb8e43e0260ba NULL

NULL NULL NULL

NULL

5697578ff5531e4d74c05db8 NULL

NULL NULL NULL

NULL

5697894294e366e131643ac5 NULL

NULL NULL NULL

NULL

56978a5b94e366e131643ac7 NULL NULL

NULL NULL NULL

Time taken: 1.905 seconds, Fetched: 10 row(s)

它是直接处理mongo里最新的数据.

4)create EXTERNAL table IF NOT EXISTS

outer_table (userid string)

partitioned by (ptDate

string)

ROW FORMAT DELIMITED FIELDS TERMINATED BY '\t';

如果创建的表是EXTERNAL的,那么在Hive里删除这张表时,不会影响MongoDB里面的数据,只会删除这张表的metadata。如果没有指定EXTERNAL,那么删除表的时候会连带MongoDB里的数据一并删除,因此最好是指定创建的表为EXTERNAL。

5)如果你想存到HDFS里也可以,用如下语句就可以。

hive> create table

qsstest as select * from eventlog limit 10;

6、 BSON-based方式

参考:

http://blog.csdn.net/tonylee0329/article/details/51648524

http://blog.csdn.net/dr_guo/article/details/51698757

Hadoop+Hive 操作mongodb数据的更多相关文章

- 使用hadoop mapreduce分析mongodb数据

使用hadoop mapreduce分析mongodb数据 (现在很多互联网爬虫将数据存入mongdb中,所以研究了一下,写此文档) 版权声明:本文为yunshuxueyuan原创文章.如需转载请标明 ...

- 在MVC模式下通过Jqgrid表格操作MongoDB数据

看到下图,是通过Jqgrid实现表格数据的基本增删查改的操作.表格数据增删改是一般企业应用系统开发的常见功能,不过不同的是这个表格数据来源是非关系型的数据库MongoDB.nosql虽然概念新颖,但是 ...

- MongoDB学习笔记(三) 在MVC模式下通过Jqgrid表格操作MongoDB数据

看到下图,是通过Jqgrid实现表格数据的基本增删查改的操作.表格数据增删改是一般企业应用系统开发的常见功能,不过不同的是这个表格数据来源是非关系型的数据库MongoDB.nosql虽然概念新颖,但是 ...

- <关于数据仓库>基于docker的Mysql与Hadoop/Hive之间的数据转移 (使用Apache Sqoop™)

原创博客,转载请联系博主! 摘要:本文介绍了如何使用docker快速搭建一个可以从外部访问的mysql服务容器,和由docker搭建的分布式Hadoop文件系统,并且使用ApacheSqoop完成将m ...

- PHP操作MongoDB 数据库

最近有个项目,需要用php操作mongoDb数据,整理如下 1,连接MongoDB数据库 $conn = new Mongo(); 其他链接方式 //$conn=new Mongo(); #连接本地主 ...

- 环境搭建 Hadoop+Hive(orcfile格式)+Presto实现大数据存储查询一

一.前言 Hadoop简介 Hadoop就是一个实现了Google云计算系统的开源系统,包括并行计算模型Map/Reduce,分布式文件系统HDFS,以及分布式数据库Hbase,同时Hadoop的相关 ...

- spark+hcatalog操作hive表及其数据

package iie.hadoop.hcatalog.spark; import iie.udps.common.hcatalog.SerHCatInputFormat; import iie.ud ...

- Hive[5] HiveQL 数据操作

5.1 向管理表中装载数据 Hive 没有行级别的数据插入更新和删除操作,那么往表中装载数据的唯一途径就是使用一种“大量”的数据装载操作,或者通过其他方式仅仅将文件写入到正确的目录下: LOA ...

- 大数据学习系列之四 ----- Hadoop+Hive环境搭建图文详解(单机)

引言 在大数据学习系列之一 ----- Hadoop环境搭建(单机) 成功的搭建了Hadoop的环境,在大数据学习系列之二 ----- HBase环境搭建(单机)成功搭建了HBase的环境以及相关使用 ...

随机推荐

- GitLab使用自定义端口

Git支持两种地址访问方式,一种是:使用ssh协议,另一种是:使用http协议. 今天在部署Git服务器拉取和上传代码是出现了以下问题ssh: connect to host gitlab.d ...

- linux系统编程之信号(五):信号集操作函数,信号阻塞与未决

一,信号集及相关操作函数 信号集被定义为一种数据类型: typedef struct { unsigned long sig[_NSIG_WORDS]: } sigset_t 信号集用来描述信号的集合 ...

- jenkins 后台程序运行

# 背景 jenkins持续集成,需要任务后台执行(nohup执行)结果发现jenkins的job执行完后,看不到运行的进程 # 步骤 原因就是这么一个情况:Jenkins任务结束时候自动关掉了所有的 ...

- 【NumberValidators】增值税发票代码验证

同大陆身份证验证一样,该部分是按照国家增值税发票代码的定制规则,进行发票代码验证,如果需要查验发票信息是否正确,应该通过第三方接口(大约一毛钱查验一次),或者直接上国家税务总局全国增值税发票查验平台进 ...

- bootstrap-treeview 加载默认选择第一个节点

configAppTree: function (oArrayData){ $('#appTree').treeview({ color: "#545454", expandIco ...

- Newtonsoft.Json日常用法

原文链接:https://www.cnblogs.com/ZengJiaLin/p/9578794.html

- Docker Compose 部署前后端分离应用

部署前后端分离应用 容器化 Abp 应用 关于 Abp 应用的容器化,其实和普通的 ASP.NET Core 应用差不多,大家可以参考我此前的文章. 唯一需要注意的是:因为 Abp 解决方案中有多个项 ...

- 关于ubuntu下看视频中文字幕乱码的问题

试了几个播放器都不行.....然后把字幕文件打开后重新保存成utf-8的.... 可以了!!!! 天呐改编码真是一个万能的办法~ 随手记

- Django思维导图

- python os.path 的使用

import os #该文件所在位置:D:\第1层\第2层\第3层\第4层\第5层\test11.py path1 = os.path.dirname(__file__) print(path1)#获 ...