Python-爬虫-猫眼T100

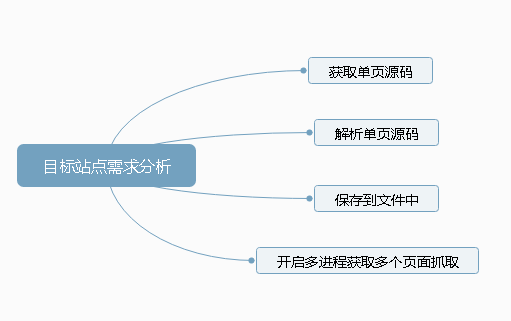

目标站点需求分析

涉及的库

from multiprocessing import Pool

from requests.exceptions import RequestException

import requests

import json,csv,time,re

获取单页源码

def get_one_page(url):

'''获取单页源码'''

try:

headers = {

"User-Agent":"Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.77 Safari/537.36",

}

res = requests.get(url, headers=headers)

time.sleep(1)

# 判断响应是否成功

if res.status_code == 200:

# print(res.text)

return res.text

return ('status_code error')

except RequestException:

return ('RequestException error'

解析单页源码

def parse_one_page(html):

'''解析单页源码'''

pattern = re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?name"><a.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime'

+ '.*?>(.*?)</p>.*?score.*?integer">(.*?)</i>.*?>(.*?)</i>.*?</dd>',re.S)

items = re.findall(pattern,html)

#循环提取信息

for item in items:

yield {

'rank' :item[0],

'name':item[1],

# 'actor':item[2].strip()[3:] if len(item[2])>3 else '', #判断是否大于3个字符

# 'time' :item[3].strip()[5:] if len(item[3])>5 else '',

'actor':item[2].strip()[3:],

'time' :item[3].strip()[5:15],

'score':item[4] + item[5]

}

保存到文件中

def write_to_textfile(content):

'''写入text'''

with open("MovieResult.text",'a',encoding='utf-8') as f:

#利用json.dumps()将字典序列化,并将ensure_ascii设置为False,从而显示中文.+换行

f.write(json.dumps(content,ensure_ascii=False) + "\n")

f.close() def write_to_csvField(fieldnames):

'''写入csv表头'''

with open("MovieResult.csv", 'a', encoding='gb18030', newline='') as f:

#将字段名传给Dictwriter来初始化一个字典写入对象

writer = csv.DictWriter(f,fieldnames=fieldnames)

#调用writeheader方法写入字段名

writer.writeheader() def write_to_csvRows(content,fieldnames):

'''写入csv内容'''

with open("MovieResult.csv",'a',encoding='gb18030',newline='') as f:

#将字段名传给Dictwriter来初始化一个字典写入对象

writer = csv.DictWriter(f,fieldnames=fieldnames)

writer.writerows(content)

f.close()

开启多进程获取多个页面抓取

# 将字段名传入列表

fieldnames = ["rank", "name", "actor", "time", "score"] def task(offset):

url = "http://maoyan.com/board/4?offset={0}".format(offset)

html = get_one_page(url)

rows = []

for item in parse_one_page(html):

# write_to_textfile(item)

rows.append(item)

# 写入csv内容

write_to_csvRows(rows,fieldnames) if __name__ == '__main__':

#写入csv表头

write_to_csvField(fieldnames)

#map方法会把每个元素当做函数的参数,,在进程池中创建多进程.循环写入10页传参

pool = Pool()

pool.map(task,[i*10 for i in range(10)])

Python-爬虫-猫眼T100的更多相关文章

- Python爬虫实例:爬取猫眼电影——破解字体反爬

字体反爬 字体反爬也就是自定义字体反爬,通过调用自定义的字体文件来渲染网页中的文字,而网页中的文字不再是文字,而是相应的字体编码,通过复制或者简单的采集是无法采集到编码后的文字内容的. 现在貌似不少网 ...

- Python爬虫教程-11-proxy代理IP,隐藏地址(猫眼电影)

Python爬虫教程-11-proxy代理IP,隐藏地址(猫眼电影) ProxyHandler处理(代理服务器),使用代理IP,是爬虫的常用手段,通常使用UserAgent 伪装浏览器爬取仍然可能被网 ...

- Python之爬虫-猫眼电影

Python之爬虫-猫眼电影 #!/usr/bin/env python # coding: utf-8 import json import requests import re import ti ...

- Python爬虫实例:爬取B站《工作细胞》短评——异步加载信息的爬取

很多网页的信息都是通过异步加载的,本文就举例讨论下此类网页的抓取. <工作细胞>最近比较火,bilibili 上目前的短评已经有17000多条. 先看分析下页面 右边 li 标签中的就是短 ...

- python爬虫数据解析之正则表达式

爬虫的一般分为四步,第二个步骤就是对爬取的数据进行解析. python爬虫一般使用三种解析方式,一正则表达式,二xpath,三BeautifulSoup. 这篇博客主要记录下正则表达式的使用. 正则表 ...

- Python爬虫实例:爬取豆瓣Top250

入门第一个爬虫一般都是爬这个,实在是太简单.用了 requests 和 bs4 库. 1.检查网页元素,提取所需要的信息并保存.这个用 bs4 就可以,前面的文章中已经有详细的用法阐述. 2.找到下一 ...

- Python爬虫教程-01-爬虫介绍

Spider-01-爬虫介绍 Python 爬虫的知识量不是特别大,但是需要不停和网页打交道,每个网页情况都有所差异,所以对应变能力有些要求 爬虫准备工作 参考资料 精通Python爬虫框架Scrap ...

- Python爬虫教程-00-写在前面

鉴于好多人想学Python爬虫,缺没有简单易学的教程,我将在CSDN和大家分享Python爬虫的学习笔记,不定期更新 基础要求 Python 基础知识 Python 的基础知识,大家可以去菜鸟教程进行 ...

- Python爬虫编程常见问题解决方法

Python爬虫编程常见问题解决方法: 1.通用的解决方案: [按住Ctrl键不送松],同时用鼠标点击[方法名],查看文档 2.TypeError: POST data should be bytes ...

- Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍

本篇介绍项目开发的过程中,对 Setting 文件的配置和使用 Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍 settings.py 文件的使用 想要详细查看 ...

随机推荐

- bash test命令探秘

shell 测试条件命令 http://blog.csdn.net/yangruibao/article/details/7427503 test 和 [ 命令 虽然 Linux 和 UNIX 的每个 ...

- 简单linux命令1

1. cat 一次显示整个文件: cat filename 从键盘创建一个文件: cat> filename 将文件合并: cat file1 file2 > filename 2. ...

- Docker 容器CPU设置

CPU使用率其实就是你运行的程序占用的CPU资源,表示你的机器在某个时间点的运行程序的情况.使用率越高,说明你的机器在这个时间上运行了很多程序,反之较少.CPU使用率的高低与你的CPU强弱有直接关系. ...

- rabbitMQ学习2-Python与rabbitmq

python客户端 # rabbitmq官方推荐的python客户端pika模块 pip3 install pika 应用场景1:单发送单接收 1.生产-消费者模型 P 是生产者 C 是消费者 中间h ...

- redis非关系型数据库的基本语法

导入并连接数据库: import redis # 导入redis模块,通过python操作redis 也可以直接在redis主机的服务端操作缓存数据库 import time # host是redis ...

- 表单相关标签之textarea,select

textarea <textarea rows="3" cols="20"> 在w3school,你可以找到你所需要的所有的网站建设教程. < ...

- day 10 - 2 函数练习

1.写函数 接收 n 个数字 求这些参数数字的和 def sum_func(*args): total = 0 for i in args: total += i return total prin ...

- python(三)@staticmethod和@classmethod使用和区别

转载自[1] 一般要用某个类的方法,先要实例这个类. 但是可以通过@staticmethod和@classmethod,直接用“类.方法()”来调用这个方法. 而 @staticmethod和@cla ...

- shiro-5基于url的权限管理

1.1 搭建环境 1.1.1 数据库 mysql5.1数据库中创建表:用户表.角色表.权限表(实质上是权限和资源的结合 ).用户角色表.角色权限表. 完成权限管理的数据模型创建. 1.1.2 开发环境 ...

- jQuery源码分析学习--资料收集--更新中

1.逐行分析jQuery源码的奥秘 - 网易云课堂 http://study.163.com/course/courseMain.htm?courseId=465001#/courseDetail? ...