Scrapy-redis<数据库篇>

scrapy-redis爬虫数据库连接部分——windows准备做salve,Linux准备做master开展工作

首先处理简单的windows熟悉的环境——安装Redis服务和Redis可视化~可视化也可以省略,但作为新手推荐使用:

1、安装redis服务:链接: https://pan.baidu.com/s/1EA0I-gx9NEU78vjZeZVqJA 提取码: 4s4i ——直接next下去

2、安装redis可视化:链接: https://pan.baidu.com/s/1KQh_g2o0tQijHQRFpKjcng 提取码: ny9c

安装redis可视化~:

1、确保redis安装完成,确保redis服务正常开启

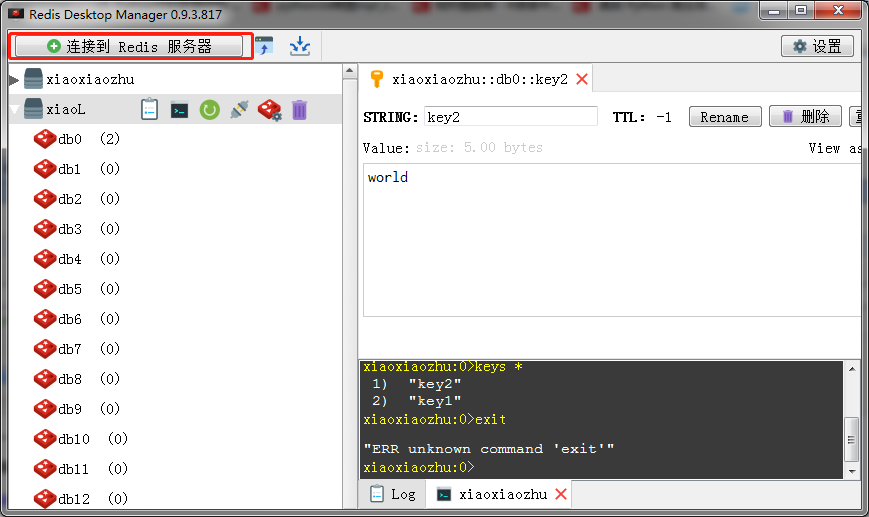

2、正常打开界面:

名字自定义~

验证为redis的密码~安装之后默认是空的就是这个——requirepass,直接连接,即可连接上windows本地的redis数据库

然后进行测试即可,测试详细内容百度。

不安装可视化的~就直接redis操作即可。

接下来是Linux服务里面安装redis:https://redis.io/download

安装完之后~直接进入redis-5.0.4文件夹:cd redis-5.0.4——>修改redis.conf文件:gedit redis.conf

修改三个属性:1.注释bind 127.0.0.1,以便其它ip访问,2.修改protected-mode yes,该改为no,3.设置密码 requirepass,默认是注释掉的,打开后设置密码。Over!

然后开始服务:sec/redis-server redis.conf

如果访问不了:

1、在linux下的防火墙中开放6379端口(与centos7以下版本开放端口的方式有区别):firewall-cmd --zone=public --add-port=6379/tcp --permanent

2、重启防火墙:systemctl restart firewalld

3、启动redis:src/redis-server redis.conf

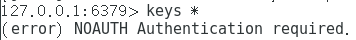

此时开始测试:打开另一个黑窗口,进入redis文件夹,输入:src/redis-cli,回车,先输入keys *,出现: ,则输入你的密码即可:auth "密码";

,则输入你的密码即可:auth "密码";

这时候无错误情况下Linux下的Redis安装完成。

直接进入RedisDesktop里面连接服务,需要输入Linux的ip地址,Linux的ip地址查询:ifconfig -a ,windows的ip地址查询:ipconfig;

名字自取——ip地址输入——端口输入正确,无改变的情况下是6379——输入redis设置的密码;

结束windows下连接Linux下redis服务

Scrapy-redis<数据库篇>的更多相关文章

- 基于Python,scrapy,redis的分布式爬虫实现框架

原文 http://www.xgezhang.com/python_scrapy_redis_crawler.html 爬虫技术,无论是在学术领域,还是在工程领域,都扮演者非常重要的角色.相比于其他 ...

- Scrapy+redis实现分布式爬虫

概述 什么是分布式爬虫 需要搭建一个由n台电脑组成的机群,然后在每一台电脑中执行同一组程序,让其对同一网络资源进行联合且分布的数据爬取. 原生Scrapy无法实现分布式的原因 原生Scrapy中调度器 ...

- scrapy+redis去重实现增量抓取

class ProjectnameDownloaderMiddleware(object): # Not all methods need to be defined. If a method is ...

- 爬虫--scrapy+redis分布式爬取58同城北京全站租房数据

作业需求: 1.基于Spider或者CrawlSpider进行租房信息的爬取 2.本机搭建分布式环境对租房信息进行爬取 3.搭建多台机器的分布式环境,多台机器同时进行租房数据爬取 建议:用Pychar ...

- Redis与Scrapy

Redis与Scrapy Redis与Scrapy Redis is an open source, BSD licensed, advanced key-value cache and store. ...

- python - scrapy 爬虫框架 ( redis去重 )

1. 使用内置,并加以修改 ( 自定义 redis 存储的 keys ) settings 配置 # ############### scrapy redis连接 ################# ...

- Python分布式爬虫打造搜索引擎完整版-基于Scrapy、Redis、elasticsearch和django打造一个完整的搜索引擎网站

Python分布式爬虫打造搜索引擎 基于Scrapy.Redis.elasticsearch和django打造一个完整的搜索引擎网站 https://github.com/mtianyan/Artic ...

- scrapy简单分布式爬虫

经过一段时间的折腾,终于整明白scrapy分布式是怎么个搞法了,特记录一点心得. 虽然scrapy能做的事情很多,但是要做到大规模的分布式应用则捉襟见肘.有能人改变了scrapy的队列调度,将起始的网 ...

- 第三百六十五节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的基本查询

第三百六十五节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的基本查询 1.elasticsearch(搜索引擎)的查询 elasticsearch是功能 ...

- 四十四 Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的基本查询

1.elasticsearch(搜索引擎)的查询 elasticsearch是功能非常强大的搜索引擎,使用它的目的就是为了快速的查询到需要的数据 查询分类: 基本查询:使用elasticsearch内 ...

随机推荐

- git学习(持续踩坑中🤣)

https://segmentfault.com/q/1010000002457936 常见指令: 一.创建版本库 $ mkdir learngit 创建文件夹 $ cd learngit 进入文件夹 ...

- linux系统安装mysql

所有平台的Mysql下载地址为: MySQL 下载. 挑选你需要的 MySQL Community Server版本及对应的平台. 接下来我们在 Centos 系统下使用 yum 命令安装 MySql ...

- 自动化脚本中click()或sendKeys()没有反应

前提: 排除xpath引用错误或元素的xpath每次都不同的情形. 问题描述 自动化脚本中click()方法和sendKeys()方法报错, 返回异常InvocationTargetException ...

- Oracle中的instr()函数

一.instr()函数 1.语法:instr(sourceString,destString,start,appearPosition) sourceString代表源字符串; destString代 ...

- Uiautomator分类

分类中主要使用的类介绍!

- Windows环境下springboot集成redis的安装与使用

一,redis安装 首先我们需要下载Windows版本的redis压缩包地址如下: https://github.com/MicrosoftArchive/redis/releases 连接打开后如下 ...

- 怎么动态生成js变量

动态生成全局变量: //简单的用字符串作为变量名 window['hello'] = "hello, world"; alert(hello); //批量定义 for(var ...

- 零基础怎么学java

首先告诉你的是,作为一个初学者想转行学习Java并不是很容易,Java本身是具有一定难度的,虽然说兴趣这东西可以让我们学习不累,但是有多少人学习是因为兴趣,或者有多少人知道自己的兴趣在哪?所以我很明确 ...

- FOFA爬虫大法——API的简单利用

FOFA是一款网络空间搜索引擎,它通过进行网络空间测绘,帮助研究人员或者企业迅速进行网络资产匹配,例如进行漏洞影响范围分析.应用分布统计.应用流行度等. 何为API?如果你在百度百科上搜索,你会得到如 ...

- php架构之路

鉴于最近跟小伙伴聊了很多PHP架构发展方向的问题,相关技术整理了一下,也顺便规划了一下自己的2019年. 一.常用的设计模式以及使用场景 以下是我用到过的 工厂,单例,策略,注册,适配,观察者,原 ...