吴裕雄 python 神经网络——TensorFlow 循环神经网络处理MNIST手写数字数据集

#加载TF并导入数据集

import tensorflow as tf

from tensorflow.contrib import rnn

from tensorflow.examples.tutorials.mnist import input_data mnist = input_data.read_data_sets("E:\\MNIST_data\\", one_hot=True) #设置训练的超参数,学习率 训练迭代最大次数,输入数据的个数

learning_rate= 0.001 #(learning_rate)

training_iters = 100000

batch_size = 128 # 神经网络参数

n_inputs = 28 #输出层的n

n_steps = 28 # 长度

n_hidden = 128 # 隐藏层的神经元个数

n_classes = 10 # MNIST的分类类别 (0-9) # 定义输出数据及其权重

# 输入数据的占位符

x = tf.placeholder("float", [None, n_steps, n_inputs])

y = tf.placeholder("float", [None, n_classes]) # 定义权重

weights ={

'in': tf.Variable(tf.random_normal([n_inputs, n_hidden])),

'out': tf.Variable(tf.random_normal([n_hidden, n_classes]))

} biases = {

'in': tf.Variable(tf.random_normal([n_hidden,])),

'out': tf.Variable(tf.random_normal([n_classes, ]))

} #定义RNN模型

def RNN(X, weights, biases):

#把输入的X转化成X (128 batch * 28 steps ,28 inputs)

X = tf.reshape(X,[-1,n_inputs]) # 进入隐藏层

# X_in = (128 batch * 28 steps ,28 hidden) X_in = tf.matmul(X,weights['in']) + biases['in']

# X_in = (128 batch * 28 steps ,28 hidden)

X_in=tf.reshape(X_in,[-1,n_steps,n_hidden])

#采用LSTM循环神经网络单元 basic LSTM Cell

lstm_cell = tf.contrib.rnn.BasicLSTMCell(n_hidden, forget_bias=1.0,state_is_tuple=True)

# 初始化为0 lstm 单元 由 h_cell,h_state两部分组成

init_state=lstm_cell.zero_state(batch_size,dtype=tf.float32) # dynamic_rnn接受张量(batch ,steps,inputs)或者(steps,batch,inputs) 作为X_in

outputs,final_state=tf.nn.dynamic_rnn(lstm_cell,X_in,initial_state=init_state,time_major=False)

results=tf.matmul(final_state[1], weights['out']) + biases['out']

return results #定义损失函数和优化器,采用AdamOptimizer优化器

pred=RNN(x,weights,biases)

cost = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(logits=pred, labels=y))

train_op= tf.train.AdamOptimizer(learning_rate=learning_rate).minimize(cost) # 定义模型预测结果及准确率计算方法

correct_pred = tf.equal(tf.argmax(pred,1), tf.argmax(y,1))

accuracy = tf.reduce_mean(tf.cast(correct_pred, tf.float32)) # 训练模型及评估模型 # 定义一个会话,启动图,每20次输出一次准确率

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

step = 0

# 训练,达到最大迭代次数

while step * batch_size < training_iters:

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

# Reshape data to get 28 seq of 28 elements

batch_xs = batch_xs.reshape((batch_size, n_steps, n_inputs))

sess.run(train_op, feed_dict={x: batch_xs, y: batch_ys})

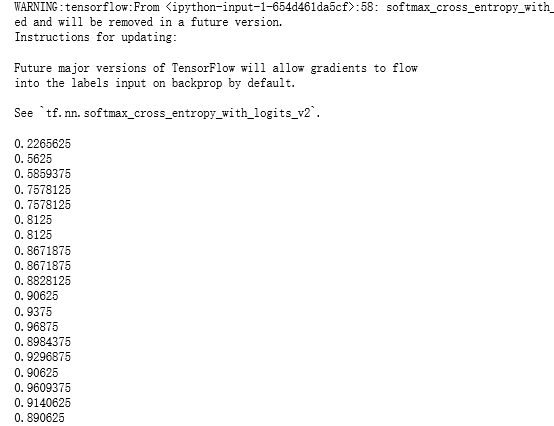

if step % 20 == 0:

print(sess.run(accuracy,feed_dict={x:batch_xs, y:batch_ys}))

step +=1

吴裕雄 python 神经网络——TensorFlow 循环神经网络处理MNIST手写数字数据集的更多相关文章

- 吴裕雄 PYTHON 神经网络——TENSORFLOW 无监督学习处理MNIST手写数字数据集

# 导入模块 import numpy as np import tensorflow as tf import matplotlib.pyplot as plt # 加载数据 from tensor ...

- 吴裕雄 python 神经网络TensorFlow实现LeNet模型处理手写数字识别MNIST数据集

import tensorflow as tf tf.reset_default_graph() # 配置神经网络的参数 INPUT_NODE = 784 OUTPUT_NODE = 10 IMAGE ...

- 吴裕雄 python 神经网络——TensorFlow实现AlexNet模型处理手写数字识别MNIST数据集

import tensorflow as tf # 输入数据 from tensorflow.examples.tutorials.mnist import input_data mnist = in ...

- TensorFlow—多层感知器—MNIST手写数字识别

1 import tensorflow as tf import tensorflow.examples.tutorials.mnist.input_data as input_data import ...

- Tensorflow实现MNIST手写数字识别

之前我们讲了神经网络的起源.单层神经网络.多层神经网络的搭建过程.搭建时要注意到的具体问题.以及解决这些问题的具体方法.本文将通过一个经典的案例:MNIST手写数字识别,以代码的形式来为大家梳理一遍神 ...

- Android+TensorFlow+CNN+MNIST 手写数字识别实现

Android+TensorFlow+CNN+MNIST 手写数字识别实现 SkySeraph 2018 Email:skyseraph00#163.com 更多精彩请直接访问SkySeraph个人站 ...

- 基于tensorflow的MNIST手写数字识别(二)--入门篇

http://www.jianshu.com/p/4195577585e6 基于tensorflow的MNIST手写字识别(一)--白话卷积神经网络模型 基于tensorflow的MNIST手写数字识 ...

- 用tensorflow搭建RNN(LSTM)进行MNIST 手写数字辨识

用tensorflow搭建RNN(LSTM)进行MNIST 手写数字辨识 循环神经网络RNN相比传统的神经网络在处理序列化数据时更有优势,因为RNN能够将加入上(下)文信息进行考虑.一个简单的RNN如 ...

- mnist手写数字识别——深度学习入门项目(tensorflow+keras+Sequential模型)

前言 今天记录一下深度学习的另外一个入门项目——<mnist数据集手写数字识别>,这是一个入门必备的学习案例,主要使用了tensorflow下的keras网络结构的Sequential模型 ...

随机推荐

- tensorflow-gpu安装

添加清华源(输入清华仓库镜像),可以提高下载速度: conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/ ...

- 中国城市区号脚本-mysql

中国城市区号 300个. SET NAMES utf8mb4; ; DROP TABLE IF EXISTS `citycode`; CREATE TABLE `citycode` ( `codeId ...

- PHP multipart/form-data 远程DOS漏洞

import sys import urllib,urllib2 import datetime from optparse import OptionParser def http_proxy(pr ...

- leetcode 198 House Robber I

function rob(nums) { if(!nums || nums.length === 0) { return 0; } else if(nums.length < 2){ retur ...

- 《CSS揭秘》》

1,透明边框 默认状态下,背景会延伸到边框区域的下层.这样就在半透明的黑色边框中透出了这个容器自己的纯白色背景. 谢天谢地,从w3c的背景与边框第三版开始,我们可以通过 background-clip ...

- [CERC2014] Outer space invaders

题目链接 题意 你受到一群外星人的攻击,第 $i$ 个外星人会在 $ai$ 时间出现,与你的距离为 $di$,且必须在 $bi$ 时间前消灭.你有一个区域冲击波器,每次攻击可以设定一个功率 $R$,这 ...

- 代码架构.md

代码架构 待办 昨天待办 decription decription 我的流程逻辑(异常处理方式) 1568097677501.drawio.html 29.94 KB 异常的两种处理方式 异常的两种 ...

- PyInstaller用法

pyinstaller定义:PyInstaller是一个压缩python文件成为可执行程序的一个软件. pyinstaller工作原理:① 它会扫描你所有的Python文档,并分析所有代码从而找出所有 ...

- 常见的sql语句练习

一. 1.新建表 test id varchar2(20)name varchar2(20)addr varchar2(50)score number create table test(id var ...

- c++中sort函数调用报错Expression : invalid operator <的内部原理 及解决办法

转自:https://www.cnblogs.com/huoyao/p/4248925.html 当我们调用sort函数进行排序时,中的比较函数如果写成如下 bool cmp(const int &a ...