Spark&Hive结合起来

1.spark与Hive结合起来

前提:当你spark的版本是1.6.1的时候,你的Hive版本要1.2.1,用别的版本会有问题

我们在做的时候,Hive的版本很简单,我们只需要解压缩,告诉他Hive的源数据在哪里即可

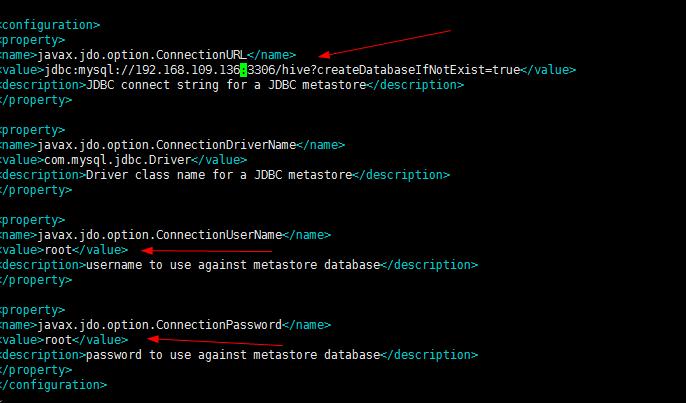

1.首先我们进入/conf/hive-site.xml文件,进行修改jdbc的配置

则此时这个IP要改为only的vm1下的那个IP,不能改为自己无线网络的IP

2.进入bin:./bin/hive

执行成功,会自动创建hive这个库

hive中创建person表

切记:在此之前,由于我们的mysql的字符集编码是utf-8,则我们要是用hive,则就要使用latin1

alter databases hive character set latin1

3.建表

create table person(id int,name string,age int) row format delimited fields terminated by ","

4.从hdfs导入数据

load data inpath "hdfs://192.168.109.136:9000/person/person.txt" into table person

此时上面的操作报

Please check that values for params "default.name" and "hive.metastore.warehouse.dir" do

not conf 是由于namenode的不一致

此时修改为weekday01正确

load data inpath "hdfs://weekday01:9000/person/person.txt" into table person

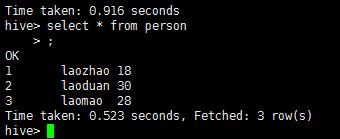

select * from person

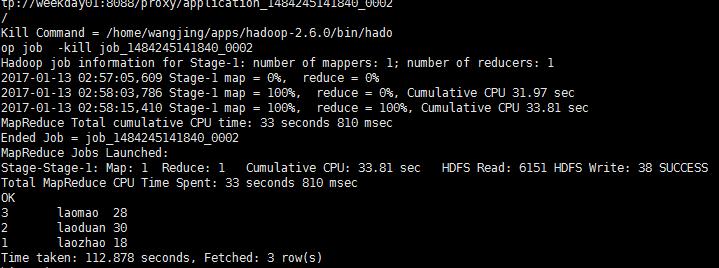

select * from person order by id desc此时这个就会调用集群上的mapReduce

不过这个样子有点慢,我们可以使用spark来进行计算

Spark&Hive结合起来的更多相关文章

- Spark(Hive) SQL中UDF的使用(Python)

相对于使用MapReduce或者Spark Application的方式进行数据分析,使用Hive SQL或Spark SQL能为我们省去不少的代码工作量,而Hive SQL或Spark SQL本身内 ...

- Spark(Hive) SQL数据类型使用详解(Python)

Spark SQL使用时需要有若干“表”的存在,这些“表”可以来自于Hive,也可以来自“临时表”.如果“表”来自于Hive,它的模式(列名.列类型等)在创建时已经确定,一般情况下我们直接通过Spar ...

- [Spark][Hive][Python][SQL]Spark 读取Hive表的小例子

[Spark][Hive][Python][SQL]Spark 读取Hive表的小例子$ cat customers.txt 1 Ali us 2 Bsb ca 3 Carls mx $ hive h ...

- [Spark][Hive]Hive的命令行客户端启动:

[Spark][Hive]Hive的命令行客户端启动: [training@localhost Desktop]$ chkconfig | grep hive hive-metastore 0:off ...

- Spark记录-源码编译spark2.2.0(结合Hive on Spark/Hive on MR2/Spark on Yarn)

#spark2.2.0源码编译 #组件:mvn-3.3.9 jdk-1.8 #wget http://mirror.bit.edu.cn/apache/spark/spark-2.2.0/spark- ...

- Spark(Hive) SQL中UDF的使用(Python)【转】

相对于使用MapReduce或者Spark Application的方式进行数据分析,使用Hive SQL或Spark SQL能为我们省去不少的代码工作量,而Hive SQL或Spark SQL本身内 ...

- spark hive结合杂记(hive-site.xml)

1.下载spark源码,在spark源码目录下面有个make-distribution.sh文件,修改里面的参数,使编译后能支持hive,修改后执行该文件.(要预先安装好maven才能编译). 2.将 ...

- Spark&Hive:如何使用scala开发spark访问hive作业,如何使用yarn resourcemanager。

背景: 接到任务,需要在一个一天数据量在460亿条记录的hive表中,筛选出某些host为特定的值时才解析该条记录的http_content中的经纬度: 解析规则譬如: 需要解析host: api.m ...

- spark hive 结合处理 把多行变成多列

原数据格式 : gid id score a1 1 90 a1 2 80 a1 3 79 a1 ...

- Hadoop+HBase+Spark+Hive环境搭建

杨赟快跑 简书作者 2018-09-24 10:24 打开App 摘要:大数据门槛较高,仅仅环境的搭建可能就要耗费我们大量的精力,本文总结了作者是如何搭建大数据环境的(单机版和集群版),希望能帮助学弟 ...

随机推荐

- Select2实现的带搜索的省市区三级联动代码 设置默认初始值

$(function() { $('#loc_province').select2('val','2456'); $('#loc_province').change(); $('#loc_city') ...

- python网络编程-socketserver模块

使用socketserver 老规矩,先引入import socketserver 必须创建一个类,且继承socketserver.BaseRequestHandler 这个类中必须重写handle( ...

- vscode:快速生成html的方法

第一步:在空文档中输入! 第二步:按下tab键. 以上

- Selenium入门9 上传文件

上传文件步骤 1 找到文件上传的input标签 find_element_by_css_selector("input[type='file']") 2 用send_keys传入 ...

- CPU体系结构

http://blog.csdn.net/liuxc0116/article/details/17004313 1.算术逻辑单元ALU(Arithmetic Logic Unit)ALU是运算器的核心 ...

- 会话技术: Cookie Session JSP

## Cookie A..概念:客户端会话技术,将数据保存到客户端 B.使用步骤: 1.创建Cookie对象,绑定数据 new Cookie(String name, String value) ...

- 注解@Component,@Controller,@Service,@Repository简单了解

Spring 自 2.0 版本开始,陆续引入了一些注解用于简化 Spring 的开发.@Repository注解便属于最先引入的一批,它用于将数据访问层 (DAO 层 ) 的类标识为 Spring B ...

- 运行时库例程-acc_get_num_devices

格式C 或 C++: int acc_get_num_devices( acc_device_t ); 描述例程 acc_get_num_devices 返回主机上指定类型的加速器设备数量.输入参数说 ...

- C#继承的多态性

C#继承的多态性 当一个类A派生出新类B时,这个基类A在新类B中可以表现为不同的类型:用作它自己的类型.基类型,或者在实现接口时用作接口类型,我们将这种情况称为多态性. C#中的每种类型都是多态性的, ...

- caffe在 14.04安装

同事安装遇到的问题,记录一下 需要把cuda里面带的opengl不安装才行,否则冲突.在安装时,首先和之前一样,切换到无图形界面,关掉lightdm,安装cuda时选择--no-opengl-lib, ...