ELK之收集haproxy日志

由于HAProxy的运行信息不写入日志文件,但它依赖于标准的系统日志协议将日志发送到远程服务器(通常位于同一系统上),所以需要借助rsyslog来收集haproxy的日志.haproxy代理nginx的访问,使用logstash收集nginx的访问信息.

1.安装配置haproxy

yum -y install gcc pcre pcre-devel openssl openssl-devel

cd /usr/local/src/

wget https://www.haproxy.org/download/1.7/src/haproxy-1.7.11.tar.gz

tar xf haproxy-1.7.11.tar.gz

cd haproxy-1.7.11/

make TARGET=linux2628 USE_PCRE=1 USE_OPENSSL=1 USE_ZLIB=1 PREFIX=/usr/local/haproxy

make install PREFIX=/usr/local/haproxy

/usr/local/haproxy/sbin/haproxy -v cat /usr/lib/systemd/system/haproxy.service

[Unit]

Description=HAProxy Load Balancer

After=syslog.target network.target [Service]

EnvironmentFile=/etc/sysconfig/haproxy

ExecStart=/usr/sbin/haproxy-systemd-wrapper -f /etc/haproxy/haproxy.cfg -p /run/haproxy.pid $OPTIONS

ExecReload=/bin/kill -USR2 $MAINPID [Install]

WantedBy=multi-user.target cat /etc/sysconfig/haproxy

# Add extra options to the haproxy daemon here. This can be useful for

# specifying multiple configuration files with multiple -f options.

# See haproxy(1) for a complete list of options.

OPTIONS="" cp /usr/local/src/haproxy-1.7.11/haproxy /usr/sbin/

cp /usr/local/src/haproxy-1.7.11/haproxy-systemd-wrapper /usr/sbin/

2.准备haproxy配置文件

mkdir /etc/haproxy

cat /etc/haproxy/haproxy.cfg global

maxconn 100000

chroot /usr/local/haproxy

uid 1000

gid 1000

daemon

nbproc 1

pidfile /usr/local/haproxy/run/haproxy.pid

log 127.0.0.1 local6 info defaults

option http-keep-alive

option forwardfor

maxconn 100000

mode http

timeout connect 300000ms

timeout client 300000ms

timeout server 300000ms listen stats

mode http

bind 0.0.0.0:9999

stats enable

log global

stats uri /haproxy-status

stats auth haadmin:123456

#frontend web_port

frontend web_port

bind 0.0.0.0:80

mode http

option httplog

log global

option forwardfor

#ACL Setting

acl pc hdr_dom(host) -i www.elk1.com

acl mobile hdr_dom(host) -i m.elk1.com

#USE ACL

use_backend pc_host if pc

use_backend mobile_host if mobile backend pc_host

mode http

option httplog

balance source

server web1 10.0.0.22:88 check inter 2000 rise 3 fall 2 weight 1

backend mobile_host

mode http

option httplog

balance source

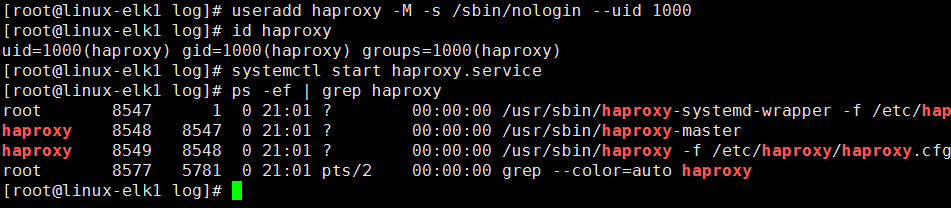

server web1 10.0.0.22:88 check inter 2000 rise 3 fall 2 weight 1 useradd haproxy -M -s /sbin/nologin --uid 1000

id haproxy

uid=1000(haproxy) gid=1000(haproxy) groups=1000(haproxy)

systemctl start haproxy.service

ss -tnl # 查看80端口是否启动

# haproxy不允许ip直接访问80端口,修改windows的hosts,win+r-->drivers快速打开hosts

10.0.0.22 www.elk1.com

10.0.0.22 m.elk1.com

这里让haproxy代理nginx,将nginx的监听端口改为88并启动,使用www.elk.com,无法跳转到我想要的页面,所以改成了www.elk1.com

访问http://www.elk1.com/nginxweb/

haproxy运行截图

3.配置rsyslog记录haproxy日志

vim /etc/rsyslog.conf # 打开15,16,19,20行注释

$ModLoad imudp

$UDPServerRun 514

$ModLoad imtcp

$InputTCPServerRun 514 # 文件末尾添加haproxy中配置的对应日志级别

local6.* /var/log/haproxy/haproxy.log # 日志记录文件

local6.* @@10.0.0.22:5160 # 本地IP和监听端口 mkdir /var/log/haproxy

chown -R haproxy.haproxy /var/log/haproxy systemctl restart rsyslog

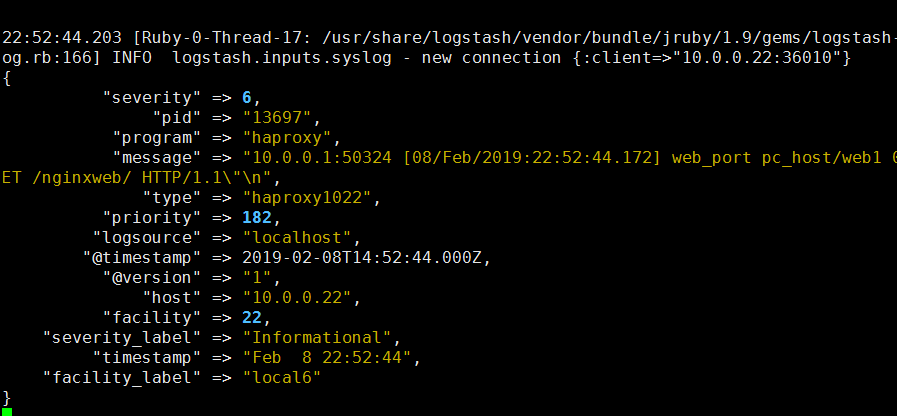

systemctl restart haproxy cat /etc/logstash/conf.d/haproxy_log.conf

input {

syslog{

type => "haproxy1022"

port => "5160"

}

}

output{

stdout{

codec => "rubydebug"

}

}

port => "5160"监听rsyslog中定义的local6端口,小于1024可能会报错

/usr/share/logstash/bin/logstash -f /etc/logstash/conf.d/haproxy_log.conf

logstash收集rsyslog传过来的日志

cat haproxy_log.conf

input {

syslog{

type => "haproxy1022"

port => "5160"

}

}

output{

if [type] == "haproxy1022" {

elasticsearch {

hosts => ["10.0.0.22:9200"]

index => "logstash-haproxy1022-%{+YYYY.MM.dd}"

}

}

}

systemctl restart logstash.service

ELK-Logstash收集haproxy日志:http://blog.51cto.com/tryingstuff/2051930

ELK之收集haproxy日志的更多相关文章

- ELK Stack (2) —— ELK + Redis收集Nginx日志

ELK Stack (2) -- ELK + Redis收集Nginx日志 摘要 使用Elasticsearch.Logstash.Kibana与Redis(作为缓冲区)对Nginx日志进行收集 版本 ...

- ELK之收集Java日志、通过TCP收集日志

1.Java日志收集 使用codec的multiline插件实现多行匹配,这是一个可以将多行进行合并的插件,而且可以使用what指定将匹配到的行与前面的行合并还是和后面的行合并. 语法示例: inpu ...

- Kubernetes实战之部署ELK Stack收集平台日志

主要内容 1 ELK概念 2 K8S需要收集哪些日志 3 ELK Stack日志方案 4 容器中的日志怎么收集 5 K8S平台中应用日志收集 准备环境 一套正常运行的k8s集群,kubeadm安装部署 ...

- filebeat+logstash+elasticsearch收集haproxy日志

filebeat用于是日志收集,感觉和 flume相同,但是用go开发,性能比较好 在2.4版本中, 客户机部署logstash收集匹配日志,传输到 kafka,在用logstash 从消息队列中抓取 ...

- 第九章·Logstash深入-Logstash配合rsyslog收集haproxy日志

rsyslog介绍及安装配置 在centos 6及之前的版本叫做syslog,centos 7开始叫做rsyslog,根据官方的介绍,rsyslog(2013年版本)可以达到每秒转发百万条日志的级别, ...

- ELK + Redis 日志收集 & HAProxy

参考博文:http://www.ttlsa.com/linux/haproxy-log-configuration-syslog/ 引入 Redis 消息队列 Log-file 收集数据到 Redis ...

- Kubernetes部署ELK并使用Filebeat收集容器日志

本文的试验环境为CentOS 7.3,Kubernetes集群为1.11.2,安装步骤参见kubeadm安装kubernetes V1.11.1 集群 1. 环境准备 Elasticsearch运行时 ...

- ELK日志系统之使用Rsyslog快速方便的收集Nginx日志

常规的日志收集方案中Client端都需要额外安装一个Agent来收集日志,例如logstash.filebeat等,额外的程序也就意味着环境的复杂,资源的占用,有没有一种方式是不需要额外安装程序就能实 ...

- 用ELK搭建简单的日志收集分析系统【转】

缘起 在微服务开发过程中,一般都会利用多台服务器做分布式部署,如何能够把分散在各个服务器中的日志归集起来做分析处理,是一个微服务服务需要考虑的一个因素. 搭建一个日志系统 搭建一个日志系统需要考虑一下 ...

随机推荐

- python-函数的对象、函数嵌套、名称空间和作用域

目录 函数的对象 函数对象的四大功能 引用 当做参数传给一个函数 可以当做函数的返回值 可以当做容器类型的元素 函数的嵌套 函数的嵌套定义 函数的嵌套调用 名称空间与作用域 名称空间 内置名称空间 全 ...

- 模拟ajax请求爬取微博

#!/usr/bin/env python # -*- coding: utf-8 -*- # @Time : 2018/9/26 10:26 # @Author : Sa.Song # @Desc ...

- hdu-1338 game predictions(贪心题)

Suppose there are M people, including you, playing a special card game. At the beginning, each playe ...

- Fiddler证书安装不成功

Fiddler 抓包https配置 提示creation of the root certificate was not successful 证书安装不成功 原文链接 在使用Fiddler抓包时,我 ...

- 彻底卸载gedit

$ sudo apt-get purge gedit gedit-plugins$ sudo apt-get autoremove

- 教你玩App怎么赚钱(一)

在看这篇文章之前,你一定要接受一下谋哥的观点:金钱就是价值流通的手段,不要高看了钱. 玩App怎么赚钱?貌似谋哥写的文章超级多,把这个最重要的忘记了.说实在的,我为啥要写“玩App"呢?其实 ...

- python - 自动化测试框架 - 测试报告

testSuitr.py: # -*- coding:utf-8 -*- '''@project: Voctest@author: Jimmy@file: testSuite.py@ide: PyCh ...

- 【SDOJ 3741】 【poj2528】 Mayor's posters

Description The citizens of Bytetown, AB, could not stand that the candidates in the mayoral electio ...

- HTTP的一些概念

1. 什么是回调? 回调是异步编程时的基础,将后续逻辑封装成起始函数的参数,逐层嵌套 2. 什么是同步/异步? 同步是指:发送方发出数据后,等接收方发回响应以后才发下一个数据包的通讯方式. 异步是指: ...

- 编译TensorFlow CPU指令集优化版

编译TensorFlow CPU指令集优化版 如题,CPU指令集优化版,说的是针对某种特定的CPU型号进行过优化的版本.通常官方给的版本是没有针对特定CPU进行过优化的,有网友称,优化过的版本相比优化 ...