Spark学习笔记——键值对操作

键值对 RDD是 Spark 中许多操作所需要的常见数据类型

键值对 RDD 通常用来进行聚合计算。我们一般要先通过一些初始 ETL(抽取、转化、装载)操作来将数据转化为键值对形式。

Spark 为包含键值对类型的 RDD 提供了一些专有的操作。

1.创建Pair RDD

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs = input.map(x => (x+1, x))

for (pair <- pairs){

println(pair)

}

//输出

(2,1)

(3,2)

(4,3)

(5,4)

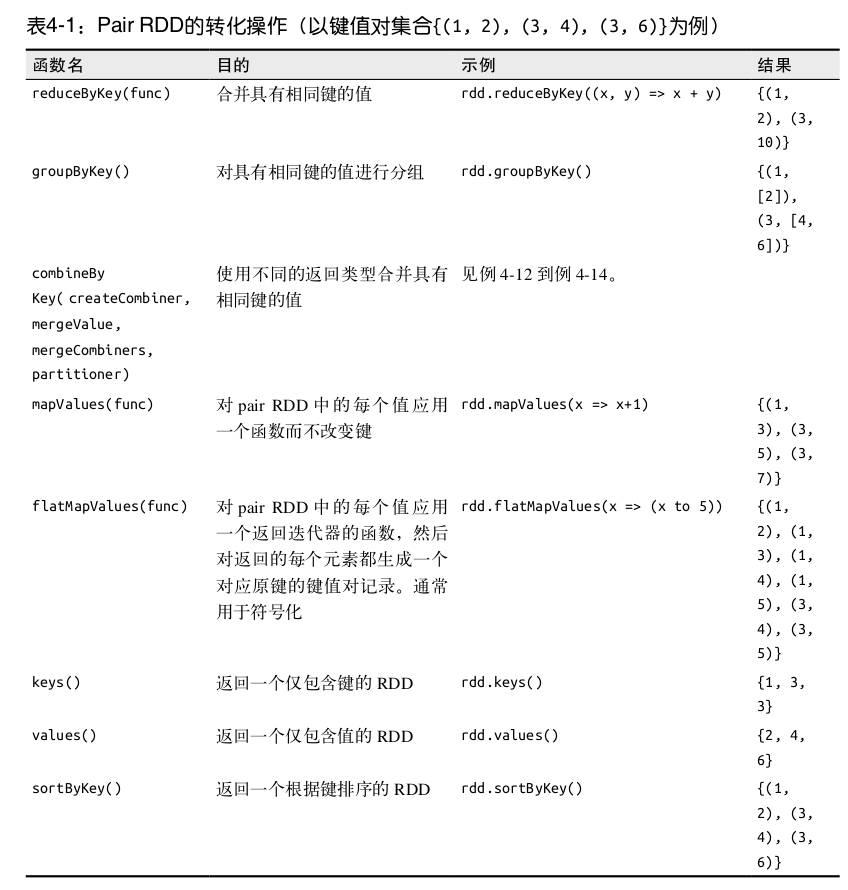

2.Pair RDD的转化操作

Pair RDD 可以使用所有标准 RDD 上的可用的转化操作。

Pair RDD也支持RDD所支持的函数

pairs.filter{case (key, value) => value.length < 20}

3.聚合操作

类似fold() 、 combine() 、 reduce() 等行动操作,这些操作返回 RDD,因此它们是转化操作而不是行动操作。

reduceByKey()函数,接收一个函数,并使用这个函数对值进行合并

val wordCount = textFile.flatMap(line => line.split(" ")).map(word => (word, 1)).reduceByKey((a, b) => a + b) #切分成单词,转换成键值对并计数

或者

input.flatMap(x => x.split(" ")).countByValue()

foldByKey()函数,也是接收一个函数,并使用这个函数对值进行合并,提供初始值

rdd.mapValues(x => (x, 1)).reduceByKey((x, y) => (x._1 + y._1, x._2 + y._2))

countByValue()函数

val textFile = sc.textFile(inputFile)

val result1 = textFile.flatMap(x => x.split(" ")).countByValue()

println(result1)

输出:Map(cc -> 3, aa -> 6, bb -> 3, ee -> 3, ff -> 2, hh -> 1, dd -> 1, gg -> 1)

combineByKey()函数,使用 combineByKey() 求每个键对应的平均值

val data = Seq(("a", 3), ("b", 4), ("a", 1))

val input2 = sc.parallelize(data)

//使用 combineByKey() 求每个键对应的平均值

val result2 = input2.combineByKey(

(v) => (v, 1),

(acc: (Int, Int), v) => (acc._1 + v, acc._2 + 1),

(acc1: (Int, Int), acc2: (Int, Int)) => (acc1._1 + acc2._1, acc1._2 + acc2._2)

).map{ case (key, value) => (key, value._1 / value._2.toFloat) }

result2.collectAsMap().map(println(_))

//输出

(b,4.0)

(a,2.0)

4.数据分组

groupByKey()函数,将数据根据键进行分组

val data = Seq(("a", 3), ("b", 4), ("a", 1))

val input2 = sc.parallelize(data)

val result3 = input2.groupByKey()

for (result <- result3)

println(result)

//输出:

(a,CompactBuffer(3, 1))

(b,CompactBuffer(4))

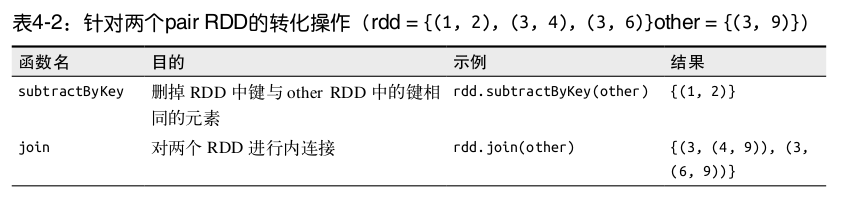

5.连接

join操作符

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs1 = input.map(x => (x+1, x))

//输出(2,1),(3,2),(4,3),(5,4)

val pairs2 = input.map(x => (x+1, 1))

//输出(2,1),(3,1),(4,1),(5,1)

for(pair <- pairs1.join(pairs2)){

println(pair)

}

//输出(4,(3,1)),(3,(2,1)),(5,(4,1)),(2,(1,1))

有时,我们不希望结果中的键必须在两个 RDD 中都存在,join的部分可以不存在

leftOuterJoin(other) 和 rightOuterJoin(other) 都会根据键连接两个 RDD,但是允许结果中存在其中的一个 pair RDD 所 缺失的键。

leftOuterJoin(other)结果

(4,(3,Some(1)))

(3,(2,Some(1)))

(5,(4,Some(1)))

(2,(1,Some(1)))

rightOuterJoin(other)结果

(4,(Some(3),1))

(3,(Some(2),1))

(5,(Some(4),1))

(2,(Some(1),1))

6.数据排序

在 Scala 中以字符串顺序对整数进行自定义排序

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs1 = input.map(x => (x + 1, x))

implicit val sortIntegersByString = new Ordering[Int] {

override def compare(a: Int, b: Int) = b.toString.compare(a.toString)

}

for(pair <- pairs1.sortByKey())

println(pair)

//输出

(5,4)

(4,3)

(3,2)

(2,1)

Spark学习笔记——键值对操作的更多相关文章

- Spark学习之键值对操作总结

键值对 RDD 是 Spark 中许多操作所需要的常见数据类型.键值对 RDD 通常用来进行聚合计算.我们一般要先通过一些初始 ETL(抽取.转化.装载)操作来将数据转化为键值对形式.键值对 RDD ...

- Spark学习之键值对(pair RDD)操作(3)

Spark学习之键值对(pair RDD)操作(3) 1. 我们通常从一个RDD中提取某些字段(如代表事件时间.用户ID或者其他标识符的字段),并使用这些字段为pair RDD操作中的键. 2. 创建 ...

- Spark中的键值对操作-scala

1.PairRDD介绍 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD.PairRDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口.例如,Pa ...

- Spark中的键值对操作

1.PairRDD介绍 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD.PairRDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口.例如,Pa ...

- Spark学习笔记3:键值对操作

键值对RDD通常用来进行聚合计算,Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为pair RDD.pair RDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口. S ...

- spark入门(三)键值对操作

1 简述 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD. 2 创建PairRDD 2.1 在sprk中,很多存储键值对的数据在读取时直接返回由其键值对数据组成 ...

- Spark基础:(三)Spark 键值对操作

1.pair RDD的简介 Spark为包含键值对类型的RDD提供了一些专有的操作,这些RDD就被称为pair RDD 那么如何创建pair RDD呢? 在不同的语言中有着不同的创建方式 在pytho ...

- Spark学习笔记之SparkRDD

Spark学习笔记之SparkRDD 一. 基本概念 RDD(resilient distributed datasets)弹性分布式数据集. 来自于两方面 ① 内存集合和外部存储系统 ② ...

- Spark学习笔记3——RDD(下)

目录 Spark学习笔记3--RDD(下) 向Spark传递函数 通过匿名内部类 通过具名类传递 通过带参数的 Java 函数类传递 通过 lambda 表达式传递(仅限于 Java 8 及以上) 常 ...

随机推荐

- centos7环境下对防火墙的操作

我是运行了systemctl stop firewalld.service && systemctl disabl e firewalld.service命令于是显示 [root@in ...

- php integer

一.整数的表示方法: 整型值可以使用十进制,十六进制,八进制或二进制表示,前面可以加上可选的符号(- 或者 +) 要使用二进制表达,数字前必须加上 0b 要使用八进制表达,数字前必须加上 0. 要使用 ...

- j2me必备之网络开发数据处理

第9章 无线网络开发MIDP提供了一组通用的网络开发接口,用来针对不同的无线网络应用可以采取不同的开发接口.基于CLDC的网络支持是由统一网络连接框架(Generic Connection Frame ...

- VC6配置CXimage库

VC6下配置CxImage库教程 第一步 下载CxImage http://sourceforge.net/projects/cximage/下载相应的CxImage文件 本例使用的最新版本(7.02 ...

- mongodb group操作 以及管道 aggregate 分组排序分页

分组获取数据: db.express_info.group({ "key":{"express_code":true}, "initial" ...

- 2016年7款最佳 Java 框架

毫无疑问,Java 是目前最为流行的编程语言之一,这里我们挖掘出了一些比较受欢迎的框架的有效信息,它们可以减轻全球软件开发人员的日常工作. RebelLabs的一项调查显示,通过在线Java用户论坛( ...

- Linux的cron与%

这个cron不能执行: * * * * * /bin/echo `/bin/date +"%Y-%m-%d-%T"` >> /home/adminuser/test.t ...

- No module named 'pandas._libs.tslib'

用pip命令安装: pip install pandas python3的: pip3 install pandas

- Array and Linkedlist区别与操作的时间复杂度(转载)

转载自:http://blog.csdn.net/tm_wb/article/details/6319146 数组链表堆栈和队列 数组链表堆栈和队列是最基本的数据结构,任何程序都会涉及到其中的一种或多 ...

- plsql 操纵表数据的2种方式

1.情景展示 在plsql中,对表的操作(增.删.改.查),其实有2种方式,只是很多人都只会第一种方式罢了. 2.方式介绍 第1种方式:直接将值与sql写到一起 直接按F8运行即可. 第2种方式: ...