2003031121——浦娟——Python数据分析第七周作业——MySQL的安装及使用

| 项目 | 要求 |

| 课程班级博客链接 | 20级数据班(本) |

| 作业要求链接 | Python第七周作业 |

| 博客名称 | 2003031121——浦娟——Python数据分析第七周作业——MySQL的安装及使用 |

| 要求 | 每道题要有题目,代码(使用插入代码,不会插入代码的自己查资料解决,不要直接截图代码!!),截图(只截运行结果) |

- 1.安装好MySQL,连接上Navicat。

- 2.完成课本练习(代码4-1~3/4-9~31)。

代码4-1至4-3

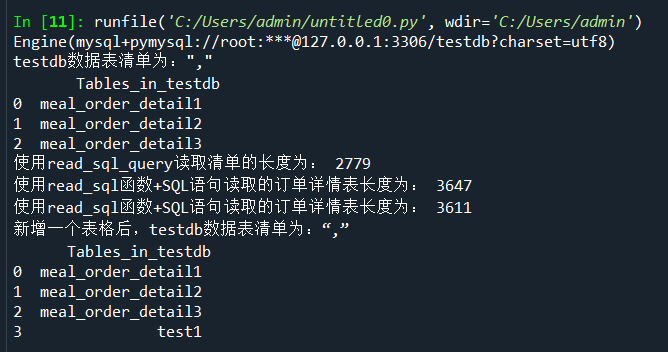

from sqlalchemy import create_engine

#创建一个MySQL连接器,用户名为root,密码为root1234

#地址为127.0.0.1数据库名称为testdb,编码为UTF—8

engine=create_engine("mysql+pymysql://root:root@127.0.0.1:3306/testdb?

charset=utf8")

print(engine) import pandas as pd

#使用read_sql_query查看testdb中的数据表书目

formlist=pd.read_sql_query('show tables',con=engine)

print('testdb数据表清单为:","\n ',formlist)

#使用read_sql_table读取订单详情表

detail1=pd.read_sql_table('meal_order_detail1',con=engine)

print("使用read_sql_query读取清单的长度为:",len(detail1)) detail2=pd.read_sql('select*from meal_order_detail2',con=engine)

print("使用read_sql函数+SQL语句读取的订单详情表长度为:",len(detail2)) detail3=pd.read_sql('meal_order_detail3',con=engine)

print('使用read_sql函数+SQL语句读取的订单详情表长度为:',len(detail3))

#使用to_sql存储orderDate

detail1.to_sql('test1',con=engine,index=False,if_exists='replace')

#使用read_sql读取test表

formlist1=pd.read_sql_query('show tables',con=engine)

print('新增一个表格后,testdb数据表清单为:“,”\n',formlist1)

代码4-9至4-11

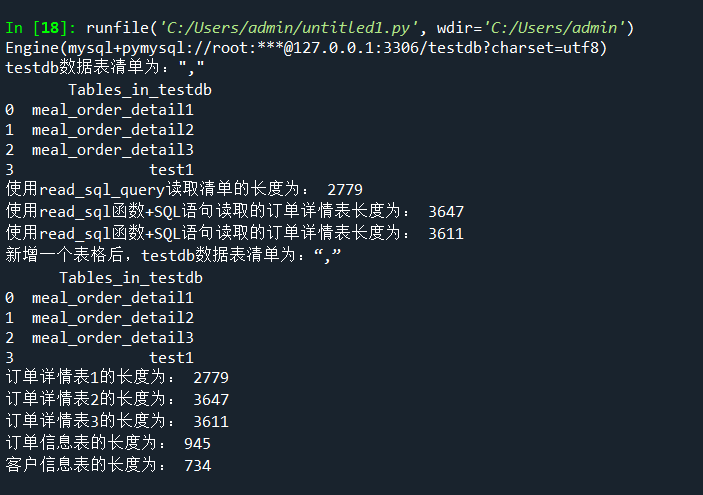

#导入sqlalchemy 库的 create_engine函数

from sqlalchemy import create_engine

engine=create_engine("mysql+pymysql://root:root@127.0.0.1:3306/testdb?charset=utf8")

import pandas as pd

order1=pd.read_sql_table('meal_order_detail1',con=engine)

print("订单详情表1的长度为:",len(order1))

order2=pd.read_sql_table('meal_order_detail2',con=engine)

print("订单详情表2的长度为:",len(order2))

order3=pd.read_sql_table('meal_order_detail3',con=engine)

print("订单详情表3的长度为:",len(order3))

orderinfo=pd.read_table('E:/桌面/meal_order_info (1).csv',sep=",",encoding='gbk')

print('订单信息表的长度为:',len(orderinfo))

userinfo=pd.read_excel('E:/桌面/users (1).xlsx')

print('客户信息表的长度为:',len(userinfo))

代码4-12至4-31

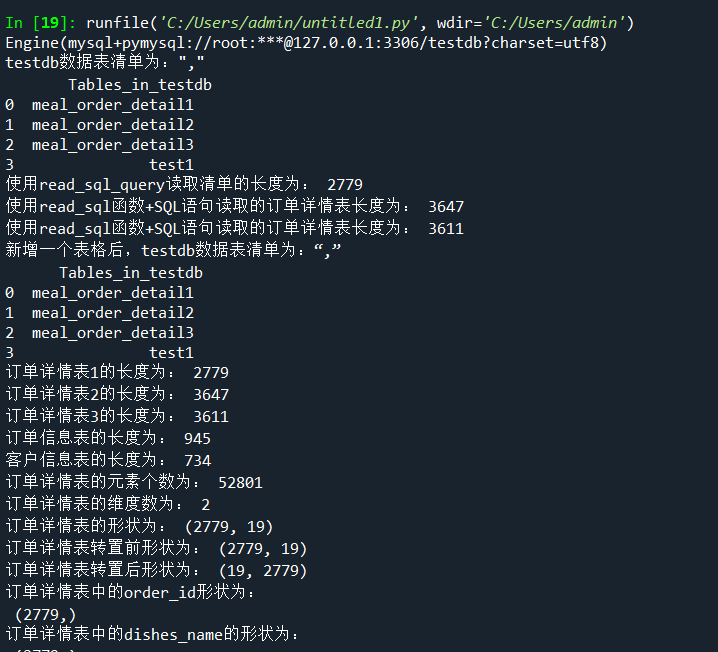

detail = pd.read_sql_table('meal_order_detail1',con = engine)

'''print('订单详情的索引表为:',detail.index)

print('订单详情表的所有值为:','\n',detail.values)

print('订单详情表列名为:','\n',detail.columns)

print('订单详情表的数据类型为:','\n',detail.dtypes)'''

#查看DataFrame的元素个数

print('订单详情表的元素个数为:',detail.size)

print('订单详情表的维度数为:',detail.ndim)#查看DataFrame的维度数

print('订单详情表的形状为:',detail.shape)#查看DataFrame的形状

print('订单详情表转置前形状为:',detail.shape)

print('订单详情表转置后形状为:',detail.T.shape)

#使用字典访问的方式取出orderInfo中的某一列

order_id = detail['order_id']

print('订单详情表中的order_id形状为:','\n',order_id.shape)

#使用访问属性的方式取出orderInfo中的菜品名称列

dishes_name = detail.dishes_name

print('订单详情表中的dishes_name的形状为:','\n',dishes_name.shape)

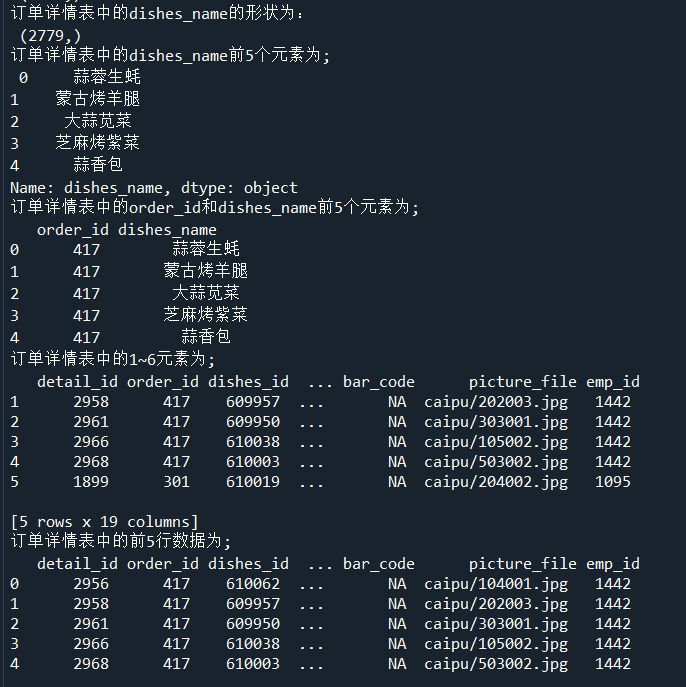

dishes_name5 = detail['dishes_name'][:5]

print('订单详情表中的dishes_name前5个元素为;','\n',dishes_name5)

orderDish = detail[['order_id','dishes_name']][:5]

print('订单详情表中的order_id和dishes_name前5个元素为;','\n',orderDish)

order5 = detail[:][1:6]

print('订单详情表中的1~6元素为;','\n',order5)

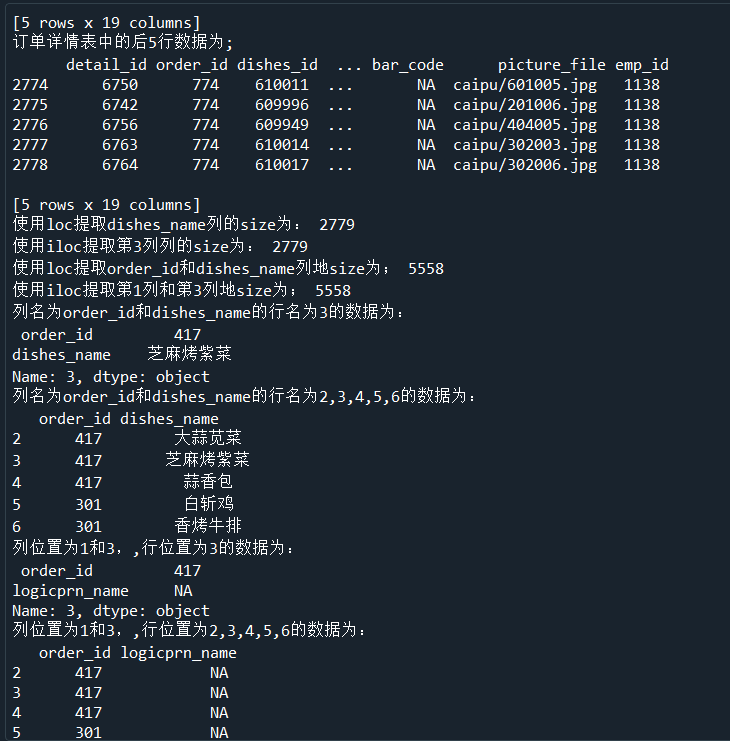

print('订单详情表中的前5行数据为;','\n',detail.head())

print('订单详情表中的后5行数据为;','\n',detail.tail())

dishes_name1 = detail.loc[:,'dishes_name']

print('使用loc提取dishes_name列的size为:',dishes_name1.size)

dishes_name2 = detail.iloc[:,3]

print('使用iloc提取第3列列的size为:',dishes_name2.size)

orderDish1 = detail.loc[:,['order_id','dishes_name']]

print('使用loc提取order_id和dishes_name列地size为;',orderDish1.size)

orderDish2 = detail.iloc[:,[1,3]]

print('使用iloc提取第1列和第3列地size为;',orderDish2.size)

print('列名为order_id和dishes_name的行名为3的数据为:\n',detail.loc[3,['order_id','dishes_name']])

print('列名为order_id和dishes_name的行名为2,3,4,5,6的数据为:\n',detail.loc[2:6,['order_id','dishes_name']])

print('列位置为1和3,,行位置为3的数据为:\n',detail.iloc[3,[1,3]])

print('列位置为1和3,,行位置为2,3,4,5,6的数据为:\n',detail.iloc[2:7,[1,3]])

#loc内部传入表达式

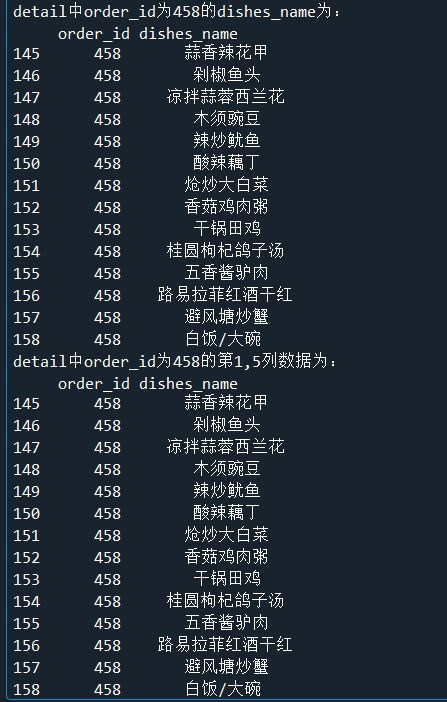

print('detail中order_id为458的dishes_name为:\n',detail.loc[detail['order_id']=='458',['order_id','dishes_name']])

#错误示例如下:

#print('detail中order_id为458的第1、5列数据为:\n',detail.iloc[detail['order_id']=='458',[1,5]])

print('detail中order_id为458的第1,5列数据为:\n',detail.iloc[(detail['order_id']=='458').values,[1,5]])

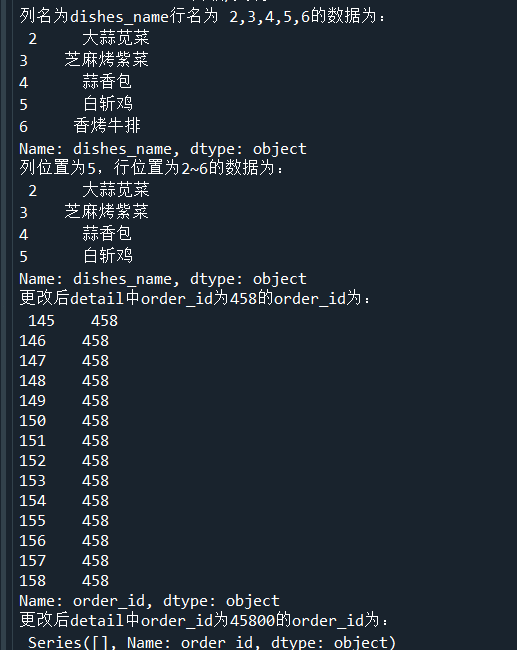

print('列名为dishes_name行名为 2,3,4,5,6的数据为:\n',detail.loc[2:6,'dishes_name'])

print('列位置为5,行位置为2~6的数据为:\n',detail.iloc[2:6,5])

#print('列位置为5,行名为2~6的数据为:', '\n',detail.ix[2:6,5]) #pandas的1.0.0版本后,已经对ix进行了升级和重构。

#将ordeer_id为458的变换为45800

detail.loc[detail['order_id']=='458','ordeer_id'] = '45800'

print('更改后detail中order_id为458的order_id为:\n',detail.loc[detail['order_id']=='458','order_id'])

print('更改后detail中order_id为45800的order_id为:\n',detail.loc[detail['order_id']=='45800','order_id'])

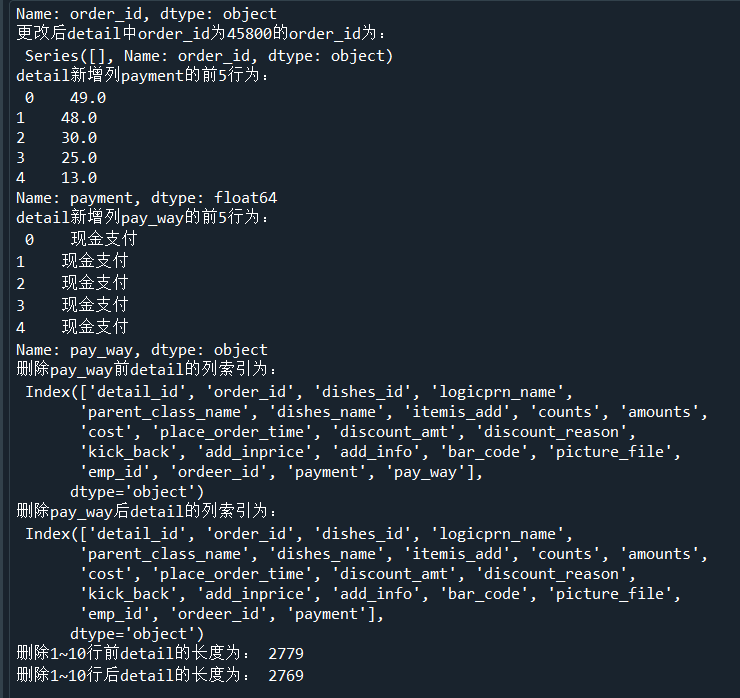

detail['payment'] = detail['counts']*detail['amounts']

print('detail新增列payment的前5行为:','\n',detail['payment'].head())

detail['pay_way'] = '现金支付'

print('detail新增列pay_way的前5行为:','\n',detail['pay_way'].head())

print('删除pay_way前detail的列索引为:','\n',detail.columns)

detail.drop(labels = 'pay_way',axis = 1,inplace = True)

print('删除pay_way后detail的列索引为:','\n',detail.columns)

print('删除1~10行前detail的长度为:',len(detail))

detail.drop(labels = range(1,11),axis = 0,inplace = True)

print('删除1~10行后detail的长度为:',len(detail))

2003031121——浦娟——Python数据分析第七周作业——MySQL的安装及使用的更多相关文章

- 2003031121-浦娟-python数据分析第三周作业-第一次作业

项目 内容 课程班级博客链接 https://edu.cnblogs.com/campus/pexy/20sj 作业链接 https://edu.cnblogs.com/campus/pexy/20s ...

- 2003031121-浦娟-python数据分析五一假期作业

项目 内容 课程班级博客链接 20级数据班(本) 这个作业要求链接 Python作业 博客名称 2003031121-浦娟-python数据分析五一假期作业 要求 每道题要有题目,代码(使用插入代码, ...

- 2003031121-浦娟-python数据分析第四周作业-第二次作业

项目 内容 课程班级博客链接 20级数据班(本) 作业链接 Python第四周作业第二次作业 博客名称 2003031121-浦娟-python数据分析第四周作业-matolotlib的应用 要求 每 ...

- 2017-2018-1 我爱学Java 第六七周 作业

团队六七周作业 完善版需求规格说明书 制定团队编码规范 数据库设计 后端架构设计 TODOList 参考资料 完善版需求规格说明书 <需求规格说明书>初稿不足之处: 1.开发工具写错 2. ...

- 2018-2019-1 20189221 《Linux内核原理与分析》第七周作业

2018-2019-1 20189221 <Linux内核原理与分析>第七周作业 实验六 分析Linux内核创建一个新进程的过程 代码分析 task_struct: struct task ...

- 2017-2018-1 JAVA实验站 第六、七周作业

2017-2018-1 JAVA实验站 第六.七周作业 详情请见团队博客

- 2017-2018-1 JaWorld 第六、七周作业

2017-2018-1 JaWorld 第六.七周作业 修改需求规格说明书 上次的<需求规格说明书>初稿有哪些不足? 王译潇同学回答: 1. 引言和目的性考虑的不是很周全. 2. ...

- 2017-2018-1 20179205《Linux内核原理与设计》第七周作业

<Linux内核原理与设计>第七周作业 视频学习及操作分析 创建一个新进程在内核中的执行过程 fork.vfork和clone三个系统调用都可以创建一个新进程,而且都是通过调用do_for ...

- 2019-2020-1 20199325《Linux内核原理与分析》第七周作业

第七周作业 1.进程描述符task_struct数据结构(一) 为了管理进程,内核必须对每个进程进行清晰的描述,进程描述符提供了内核所需了解的进程信息. struct task_struct数据结构很 ...

随机推荐

- 为什么要使用 kafka,为什么要使用消息队列?

缓冲和削峰:上游数据时有突发流量,下游可能扛不住,或者下游没有足够多的机器来保证冗余,kafka在中间可以起到一个缓冲的作用,把消息暂存在kafka中,下游服务就可以按照自己的节奏进行慢慢处理. 解耦 ...

- SpringCloud个人笔记-04-Stream初体验

sb_cloud_stream Spring Cloud Stream 是一个构建消息驱动微服务的框架 应用程序通过 inputs 或者 outputs 来与 Spring Cloud Stream ...

- Netty + Spring + ZooKeeper搭建轻量级RPC框架

本文参考 本篇文章主要参考自OSCHINA上的一篇"轻量级分布式 RPC 框架",因为原文对代码的注释和讲解较少,所以我打算对这篇文章的部分关键代码做出一些详细的解释 在本篇文章中 ...

- TCP 重传、滑动窗⼝、流量控制、拥塞控制

重传机制 TCP 会在以下两种情况发⽣超时重传: 数据包丢失 确认应答丢失 重传超时 重传超时是TCP协议保证数据可靠性的另一个重要机制,其原理是在发送某一个数据以后就开启一个计时器,在一定时间内如果 ...

- (5) 图和表(Figure and Table) 【论文写作】

- 在一个元素上:hover,改变另一个元素的css属性

如果二者是父子关系,可以写成这种: .face:hover .eye-bottom { margin-top: 30px; } 如果是兄弟关系: .face:hover+.ear-wrap { tra ...

- [译]HTML&CSS Lesson5: 定位

CSS最大的用处之一就是可以将内容和元素定位到任何我们想要的位置,使我们的设计具有结构,使内容更加易懂. CSS有好几种不同的定位属性,每种都有自己的使用场景.在这节课中我们会通过不同的案例--可复用 ...

- 前端基础问题整理-HTML相关

DOCTYPE的作用以及常见的DOCTYPE类型 <!DOCTYPE>声明位于文档中的最前面的位置,处于 <html> 标签之前,用来告知浏览器页面目前的文件是用哪种版本的HT ...

- 前端面试题整理——手写AJAX

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- Spark周总结(一)

本周学习内容: 1.搭建虚拟机Spark环境 2.idea编写Scala脚本并在yarn上运行 总结: 这周是回家第一周,虽然没啥事,但是还是想放松放松,也是万事开头难,跟着教程做,但总有几步跟教程上 ...