经典卷积神经网络结构——LeNet-5、AlexNet、VGG-16

经典卷积神经网络的结构一般满足如下表达式:

输出层 -> (卷积层+ -> 池化层?)+ -> 全连接层+

上述公式中,“+”表示一个或者多个,“?”表示一个或者零个,如“卷积层+”表示一个或者多个卷积层,“池化层?”表示一个或者零个池化层。“->”表示 forward 方向。

下面将分别介绍 LeNet-5、AlexNet 和 VGG-16 结构。

1. LeNet-5(modern)

图 1 LeNet-5

1.1 LeNet-5 结构:

- 输入层

图片大小为 32×32×1,其中 1 表示为黑白图像,只有一个 channel。

- 卷积层

filter 大小 5×5,filter 深度(个数)为 6,padding 为 0, 卷积步长 $s=1$,输出矩阵大小为 28×28×6,其中 6 表示 filter 的个数。

- 池化层

average pooling,filter 大小 2×2(即 $f=2$),步长 $s=2$,no padding,输出矩阵大小为 14×14×6。

- 卷积层

filter 大小 5×5,filter 个数为 16,padding 为 0, 卷积步长 $s=1$,输出矩阵大小为 10×10×16,其中 16 表示 filter 的个数。

- 池化层

average pooling,filter 大小 2×2(即 $f=2$),步长 $s=2$,no padding,输出矩阵大小为 5×5×16。注意,在该层结束,需要将 5×5×16 的矩阵flatten 成一个 400 维的向量。

- 全连接层(Fully Connected layer,FC)

neuron 数量为 120。

- 全连接层(Fully Connected layer,FC)

neuron 数量为 84。

- 全连接层,输出层

现在版本的 LeNet-5 输出层一般会采用 softmax 激活函数,在 LeNet-5 提出的论文中使用的激活函数不是 softmax,但其现在不常用。该层神经元数量为 10,代表 0~9 十个数字类别。(图 1 其实少画了一个表示全连接层的方框,而直接用 $\hat{y}$ 表示输出层。)

1.2 LeNet-5 一些性质:

- 如果输入层不算神经网络的层数,那么 LeNet-5 是一个 7 层的网络。(有些地方也可能把 卷积和池化 当作一个 layer)(LeNet-5 名字中的“5”也可以理解为整个网络中含可训练参数的层数为 5。)

- LeNet-5 大约有 60,000 个参数。

- 随着网络越来越深,图像的高度和宽度在缩小,与此同时,图像的 channel 数量一直在增加。

- 现在常用的 LeNet-5 结构和 Yann LeCun 教授在 1998 年论文中提出的结构在某些地方有区别,比如激活函数的使用,现在一般使用 ReLU 作为激活函数,输出层一般选择 softmax。

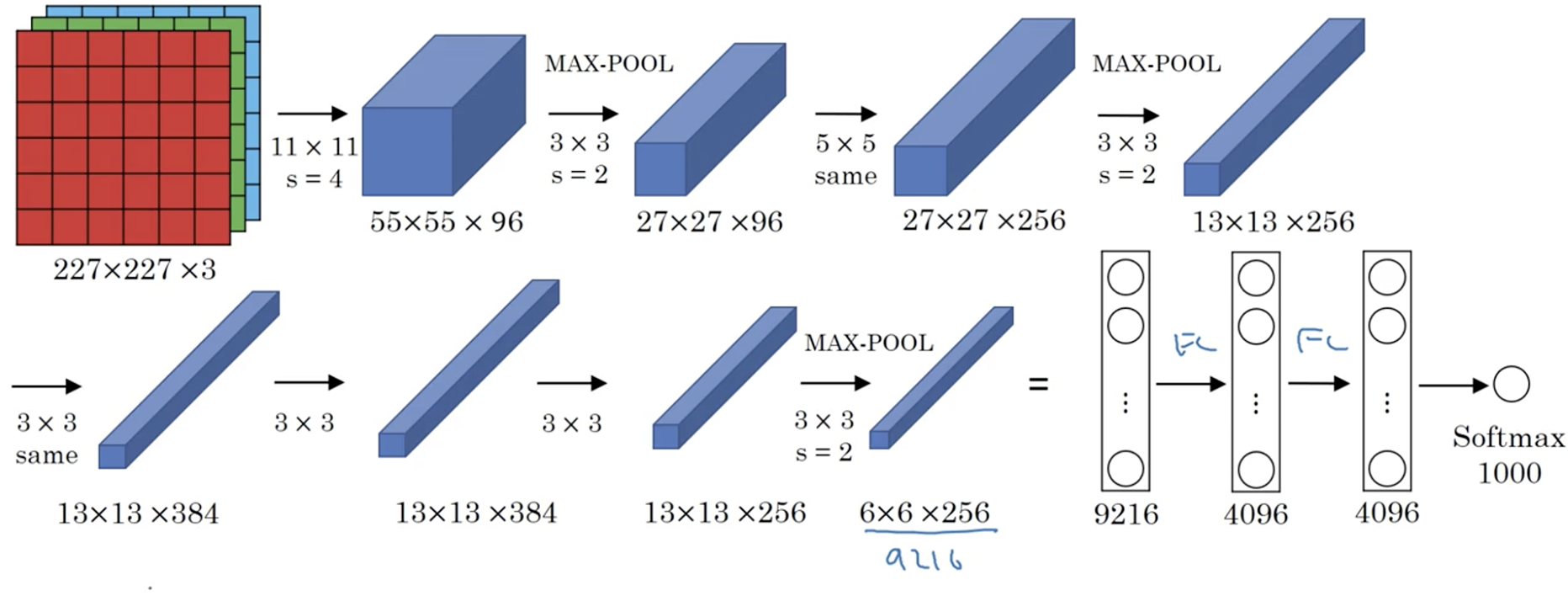

2. AlexNet

图 2 AlexNet

2.1 AlexNet 结构:

- 输入层:图像大小为 227×227×3,其中 3 表示输入图像的 channel 数(R,G,B)为 3。

- 卷积层:filter 大小 11×11,filter 个数 96,卷积步长 $s = 4$。(filter 大小只列出了宽和高,filter矩阵的 channel 数和输入图片的 channel 数一样,在这里没有列出)

- 池化层:max pooling,filter 大小 3×3,步长 $s = 2$。

- 卷积层:filter 大小 5×5,filter 个数 256,步长 $s = 1$,padding 使用 same convolution,即使得卷积层输出图像和输入图像在宽和高上保持不变。

- 池化层:max pooling,filter 大小 3×3,步长 $s = 2$。

- 卷积层:filter 大小 3×3,filter 个数 384,步长 $s = 1$,padding 使用 same convolution。

- 卷积层:filter 大小 3×3,filter 个数 384,步长 $s = 1$,padding 使用 same convolution。

- 卷积层:filter 大小 3×3,filter 个数 256,步长 $s = 1$,padding 使用 same convolution。

- 池化层:max pooling,filter 大小 3×3,步长 $s = 2$;池化操作结束后,将大小为 6×6×256 的输出矩阵 flatten 成一个 9216 维的向量。

- 全连接层:neuron 数量为 4096。

- 全连接层:neuron 数量为 4096。

- 全连接层,输出层:softmax 激活函数,neuron 数量为 1000,代表 1000 个类别。

2.2 AlexNet 一些性质:

- 大约 60million 个参数;

- 使用 ReLU 作为激活函数。

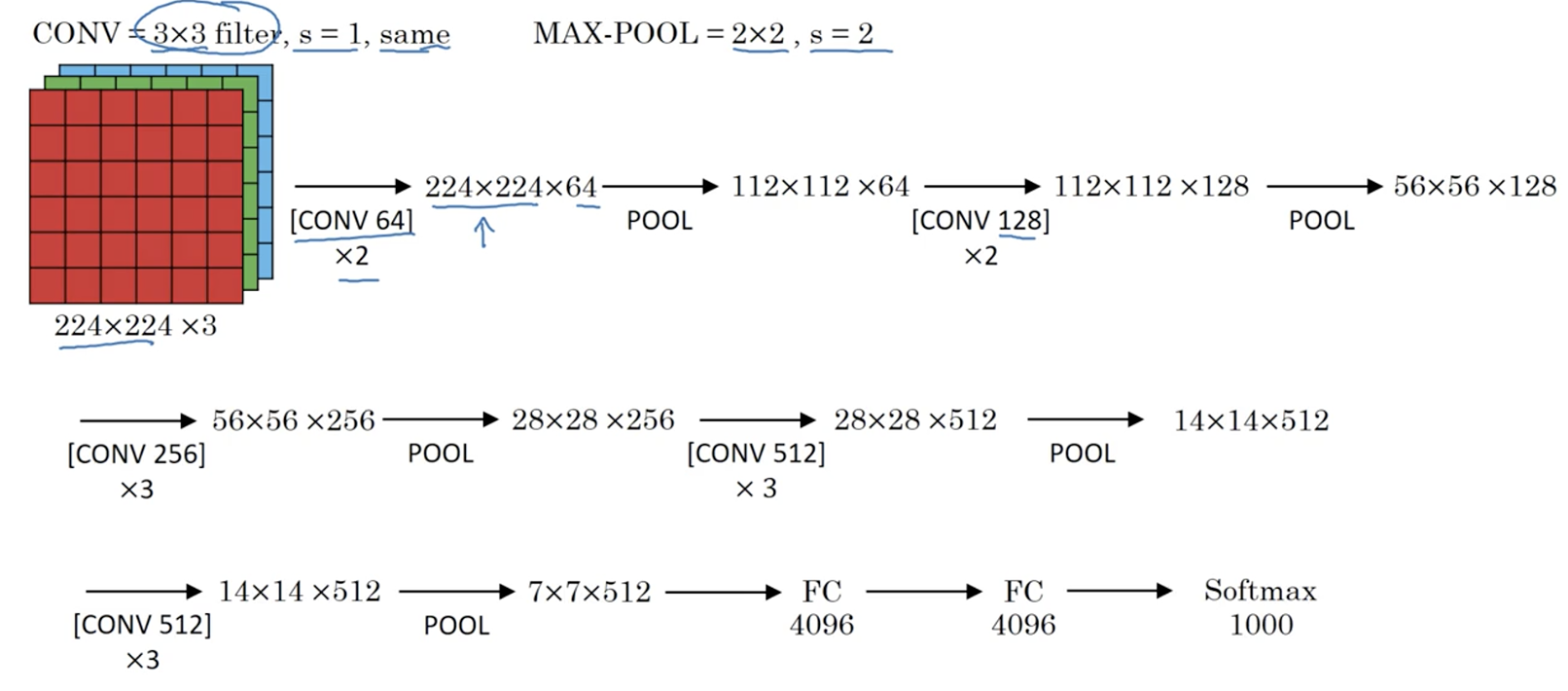

3. VGG-16

图 3 VGG-16

3.1 VGG-16 结构:

- 输入层

- 卷积层

- 卷积层

- 池化层

- 卷积层

- 卷积层

- 池化层

- 卷积层

- 卷积层

- 卷积层

- 池化层

- 卷积层

- 卷积层

- 卷积层

- 池化层

- 卷积层

- 卷积层

- 卷积层

- 池化层

- 全连接层

- 全连接层

- 全连接层,输出层

3.2 VGG-16 一些性质:

- VGG-16 中的 16 表示整个网络中有 trainable 参数的层数为 16 层。(trainable 参数指的是可以通过 back-propagation 更新的参数)

- VGG-16 大约有 138million 个参数。

- VGG-16 中所有卷积层 filter 宽和高都是 3,步长为 1,padding 都使用 same convolution;所有池化层的 filter 宽和高都是 2,步长都是 2。

References

Course 4 Convolutional Neural Networks by Anderw Ng

《TensorFLow实战Google深度学习框架》

经典卷积神经网络结构——LeNet-5、AlexNet、VGG-16的更多相关文章

- 经典卷积神经网络(LeNet、AlexNet、VGG、GoogleNet、ResNet)的实现(MXNet版本)

卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络,它的人工神经元可以响应一部分覆盖范围内的周围单元,对于大型图像处理有出色表现. 其中 文章 详解卷 ...

- Deep Learning 经典网路回顾#之LeNet、AlexNet、GoogLeNet、VGG、ResNet

#Deep Learning回顾#之LeNet.AlexNet.GoogLeNet.VGG.ResNet 深入浅出——网络模型中Inception的作用与结构全解析 图像识别中的深度残差学习(Deep ...

- 经典卷积神经网络算法(2):AlexNet

.caret, .dropup > .btn > .caret { border-top-color: #000 !important; } .label { border: 1px so ...

- CNN 卷积神经网络结构

cnn每一层会输出多个feature map, 每个Feature Map通过一种卷积滤波器提取输入的一种特征,每个feature map由多个神经元组成,假如某个feature map的shape是 ...

- 吴裕雄--天生自然python Google深度学习框架:经典卷积神经网络模型

import tensorflow as tf INPUT_NODE = 784 OUTPUT_NODE = 10 IMAGE_SIZE = 28 NUM_CHANNELS = 1 NUM_LABEL ...

- 五大经典卷积神经网络介绍:LeNet / AlexNet / GoogLeNet / VGGNet/ ResNet

欢迎大家关注我们的网站和系列教程:http://www.tensorflownews.com/,学习更多的机器学习.深度学习的知识! LeNet / AlexNet / GoogLeNet / VGG ...

- 卷积神经网络之LeNet

开局一张图,内容全靠编. 上图引用自 [卷积神经网络-进化史]从LeNet到AlexNet. 目前常用的卷积神经网络 深度学习现在是百花齐放,各种网络结构层出不穷,计划梳理下各个常用的卷积神经网络结构 ...

- CNN-1: LeNet-5 卷积神经网络模型

1.LeNet-5模型简介 LeNet-5 模型是 Yann LeCun 教授于 1998 年在论文 Gradient-based learning applied to document ...

- 卷积神经网络的一些经典网络(Lenet,AlexNet,VGG16,ResNet)

LeNet – 5网络 网络结构为: 输入图像是:32x32x1的灰度图像 卷积核:5x5,stride=1 得到Conv1:28x28x6 池化层:2x2,stride=2 (池化之后再经过激活函数 ...

随机推荐

- Maven管理多模块应用

穿越至目录: 从0开始,构建前后端分离应用 对于概念的一些理解 Maven的作用 管理模块之间的依赖:根据业务需求,系统会划分很多模块,这些模块彼此之间存在着依赖关系.比如系统管理模块依赖着文件上传模 ...

- fastjson 的使用总结

前言 最近在开发过程中使用了大量的json作为前后端数据交换的方式,由于之前没有对json做过系统的学习,所有在使用过程中查阅了大量的文档与资料,这里主要记录了我在开发后对json以及fastjson ...

- 构建具有用户身份认证的 Ionic 应用

序言:本文主要介绍了使用 Ionic 和 Cordova 开发混合应用时如何添加用户身份认证.教程简易,对于 Ionic 入门学习有一定帮助.因为文章是去年发表,所以教程内关于 Okta 的一些使用步 ...

- 由清除float原理到BFC

关于浮动 设置为浮动的元素会脱离当前文档流,向左或向右移动直到边缘遇到另一个浮动元素或者到达边界.普通元素不会对齐造成影响. 浮动是把双刃剑,在给我们的布局带来便利的同时有一些缺点需要我们去解决.例如 ...

- C语言 > 构造素数表

#include <stdio.h> #define NUMBER 1000 int main(){ int isPrime[NUMBER]; ; i < NUMBER; i++){ ...

- java集合HashMap、HashTable、HashSet详解

一.Set和Map关系 Set代表集合元素无序,集合元素不可重复的集合,Map代表一种由多个key-value组成的集合,map集合是set集合的扩展只是名称不同,对应如下 二.HashMap的工作原 ...

- sql server 死锁排查

记得以前客户在使用软件时,有偶发出现死锁问题,因为发生的时间不确定,不好做问题的重现,当时解决问题有点棘手了. 现总结下查看死锁的常用二种方式: 第一种是图形化监听: sqlserver --> ...

- ansj人名识别

1.前言 ansj人名识别会用到两个字典,分别是:person/asian_name_freq.data.person/person.dic. 1.1.asian_name_freq.data 这是一 ...

- Java开源生鲜电商平台-搜索模块的设计与架构(源码可下载)

Java开源生鲜电商平台-搜索模块的设计与架构(源码可下载) 说明:搜索模块针对的是买家用户,在找菜品找的很费劲下的一种查询方面.目前也是快速的检索商品. 对于移动端的APP买家用户而言,要求的速度在 ...

- WebJars

WebJarsWebJars是一个很神奇的东西,可以让大家以jar包的形式来使用前端的各种框架.组件. 什么是WebJars 什么是WebJars?WebJars是将客户端(浏览器)资源(JavaSc ...