pytorch笔记

Tensor create

#创建特定shape value为random值的tensor

input = torch.rand((64,64,3))

Tensor slice

- 以[2,3]矩阵为例,slice后可以得到任意shape的矩阵,并不是说一定会小于2行3列.

import torch

truths=torch.Tensor([[1,2,3],[4,5,6]])

#代表新生成一个[3,]的矩阵,行位置分别取原先矩阵的第1,第0,第1行.

print(truths[[1,0,1],:])

print(truths[[1,0,1]]) #等同于truths[[1,0,1],:]

#代表新生成一个[,4]的矩阵,列位置分别取原先矩阵的第2,第2,第2,第2列

print(truths[:,[2,2,2,2]])

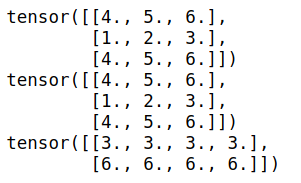

输出

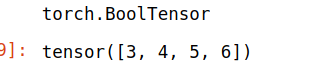

- 用bool型的tensor去切片

import torch

x = torch.tensor([[1,2,3],[4,5,6]])

index = x>2

print(index.type())

x[index]

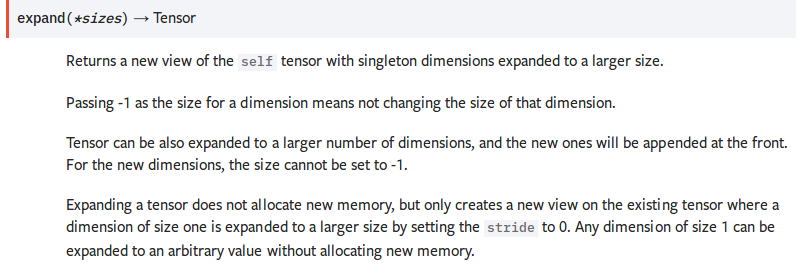

tensor扩展

Expanding a tensor does not allocate new memory, but only creates a new view on the existing tensor where a dimension of size one is expanded to a larger size by setting the stride to 0. Any dimension of size 1 can be expanded to an arbitrary value without allocating new memory.

并不分配新内存. 只是改变了已有tensor的view. size为1的维度被扩展为更大的size.

>>> x = torch.tensor([[1], [2], [3]])

>>> x.size()

torch.Size([3, 1])

>>> x.expand(3, 4)

tensor([[ 1, 1, 1, 1],

[ 2, 2, 2, 2],

[ 3, 3, 3, 3]])

>>> x.expand(-1, 4) # -1 means not changing the size of that dimension

tensor([[ 1, 1, 1, 1],

[ 2, 2, 2, 2],

[ 3, 3, 3, 3]])

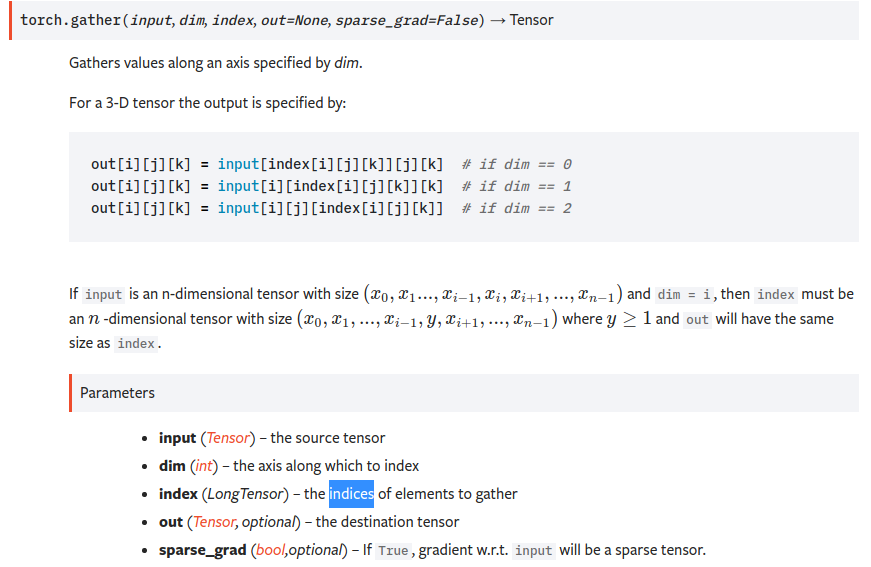

gather

torch.gather(input, dim, index, out=None, sparse_grad=False) → Tensor

即dim维度的下标由index替换.input是n维的,index也得是n维的,tensor在第dim维度上的size可以和input不一致. 最终的output和index的shape是一致的.

即对dim维度的数据按照index来索引.

比如

import torch

t = torch.tensor([[1,2],[3,4]])

index=torch.tensor([[0,0],[1,0]])

torch.gather(t,1,index)

输出

tensor([[1, 1],

[4, 3]])

gather(t,1,index)替换第1维度的数据(即列方向),替换成哪些列的值呢?[[0,0],[1,0]],对第一行,分别为第0列,第0列,对第二行,分别为第1列,第0列.

从而得到tensor([[1, 1],[4, 3]])

sum

沿着第n维度,求和.keepdim表示是否保持维度数目不变.

import torch

t = torch.tensor([[1,2],[3,4]])

a=torch.sum(t,0)

b=torch.sum(t,1,keepdim=True)

print(a.shape,b.shape)

print(a)

print(b)

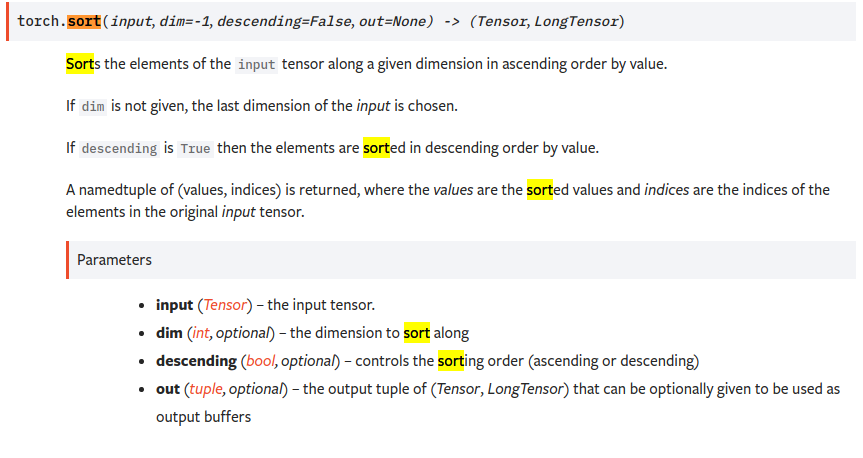

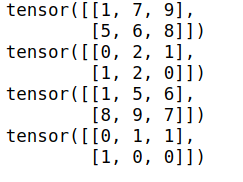

sort

沿着第n个维度的方向排序

import torch

t = torch.tensor([[1,9,7],[8,5,6]])

_sorted,_index = t.sort(1)

print(_sorted)

print(_index)

_sorted,_index = t.sort(0)

print(_sorted)

print(_index)

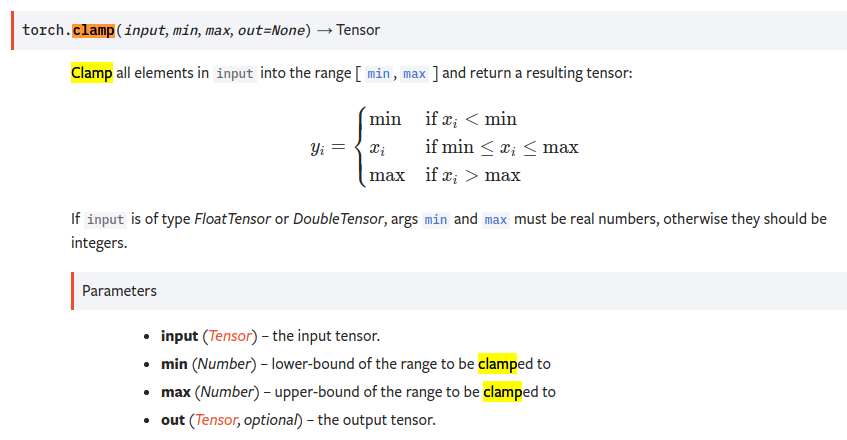

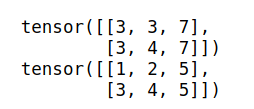

clamp

import torch

print()

t = torch.tensor([[1,2,7],[3,4,8]])

res = t.clamp(3,7) #<3的变为3,>7的变为7 中间范围的不变

print(res)

res2 = torch.clamp(t,max=5) #所有大于5的都改为5

print(res2)

各种损失函数

https://blog.csdn.net/zhangxb35/article/details/72464152

有用link:

pytorch笔记的更多相关文章

- [Pytorch] pytorch笔记 <三>

pytorch笔记 optimizer.zero_grad() 将梯度变为0,用于每个batch最开始,因为梯度在不同batch之间不是累加的,所以必须在每个batch开始的时候初始化累计梯度,重置为 ...

- [Pytorch] pytorch笔记 <二>

pytorch笔记2 用到的关于plt的总结 plt.scatter scatter(x, y, s=None, c=None, marker=None, cmap=None, norm=None, ...

- [Pytorch] pytorch笔记 <一>

pytorch笔记 - torchvision.utils.make_grid torchvision.utils.make_grid torchvision.utils.make_grid(tens ...

- 【转载】 pytorch笔记:06)requires_grad和volatile

原文地址: https://blog.csdn.net/jiangpeng59/article/details/80667335 作者:PJ-Javis 来源:CSDN --------------- ...

- pytorch笔记:09)Attention机制

刚从图像处理的hole中攀爬出来,刚走一步竟掉到了另一个hole(fire in the hole*▽*) 1.RNN中的attentionpytorch官方教程:https://pytorch.or ...

- [pytorch笔记] 调整网络学习率

1. 为网络的不同部分指定不同的学习率 class LeNet(t.nn.Module): def __init__(self): super(LeNet, self).__init__() self ...

- [pytorch笔记] torch.nn vs torch.nn.functional; model.eval() vs torch.no_grad(); nn.Sequential() vs nn.moduleList

1. torch.nn与torch.nn.functional之间的区别和联系 https://blog.csdn.net/GZHermit/article/details/78730856 nn和n ...

- Pytorch笔记 (3) 科学计算1

一.张量 标量 可以看作是 零维张量 向量 可以看作是 一维张量 矩阵 可以看作是 二维张量 继续扩展数据的维度,可以得到更高维度的张量 ————> 张量又称 多维数组 给定一个张量数据 ...

- Pytorch笔记 (2) 初识Pytorch

一.人工神经网络库 Pytorch ———— 让计算机 确定神经网络的结构 + 实现人工神经元 + 搭建人工神经网络 + 选择合适的权重 (1)确定人工神经网络的 结构: 只需要告诉Pytorc ...

- PyTorch笔记之 Dataset 和 Dataloader

一.简介 在 PyTorch 中,我们的数据集往往会用一个类去表示,在训练时用 Dataloader 产生一个 batch 的数据 https://pytorch.org/tutorials/begi ...

随机推荐

- Anaconda、TensorFlow安装和Pycharm配置详细教程,亲测有效!

目录 1.Anaconda下载与安装 2.Anaconda安装成功与否测试 3.安装python 4.检查TensorFlow环境添加成功与否 5.TensorFlow安装 6.测试TensorFlo ...

- 前端基础-BOM和DOM学习

JavaScript分为 ECMAScript,BOM,DOM. BOM:是指浏览器对象模型,使JavaScript有能力与浏览器进行对象. DOM:是指文档对象模型,通过它,可以访问HTML文档的所 ...

- spring定时任务-文件上传进度条

spring定时任务 导依赖 <!-- https://mvnrepository.com/artifact/org.quartz-scheduler/quartz --> <dep ...

- 注解在Java中是如何工作的

来一点咖啡,准备好进入注解的世界. 注解一直是 Java 的一个非常重要的部分,它从 J2SE 5.0 开始就已经存在了.在我们的应用程序代码中,经常看到 @Override 和 @Deprecate ...

- JAVA线程通信之生产者与消费者

package cn.test.hf.test3; import java.util.concurrent.locks.Condition;import java.util.concurrent.lo ...

- 新手学习FFmpeg - 通过API实现可控的Filter调用链

虽然通过声明[x][y]avfilter=a=x:b=y;avfilter=xxx的方式可以创建一个可用的Filter调用链,并且在绝大多数场合下这种方式都是靠谱和实用的. 但如果想精细化的管理AVF ...

- 在MacOS下使用sqlalchemy 连接sqlserver2012 数据库

在MacOS下使用sqlalchemy 连接sqlserver 数据库 前言 最近有要求,要将数据库换成巨硬家的sqlserver 2012 因为在网上苦苦找不到sqlalchemy 配置连接SqlS ...

- centos6.9实时查看tomcat运行日志

1.切换到tomcat的logs目录下 cd /usr/local/apache-tomcat-/logs 2.执行命令,查看日志 tail -f catalina.out 3.退出 Ctrl+c

- springboot 使用i18n进行国际化乱码解决

方式1.设置国际化的编码和你使用的编译器(IDEA之类)一致,如编译器为UTF-8则在application配置文件中添加 #i18n spring: messages: encoding: UTF- ...

- [Week 2][Guarantee of PLA] the Correctness Verification of PLA

Conditions: For the data set D, there exists a $\displaystyle W_{f}$ which satisfies that for every ...