记录使用jQuery和Python抓取采集数据的一个实例

从现成的网站上抓取汽车品牌,型号,车系的数据库记录。

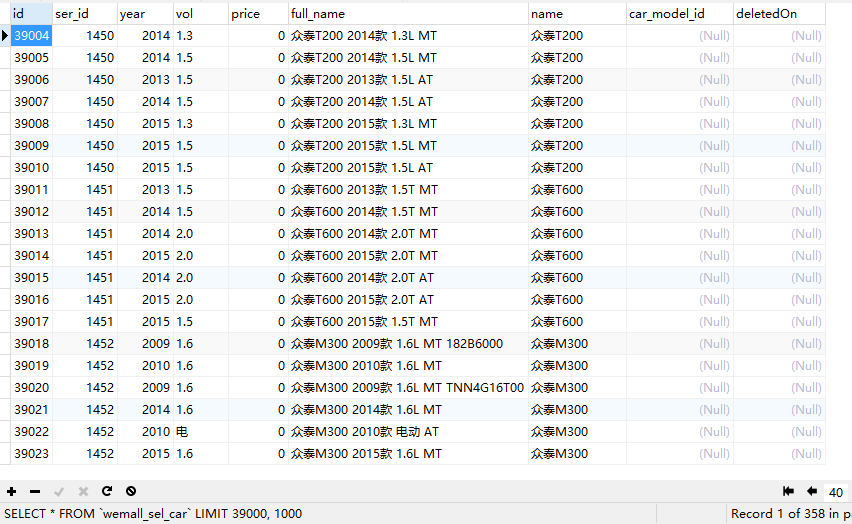

先看成果,大概4w条车款记录

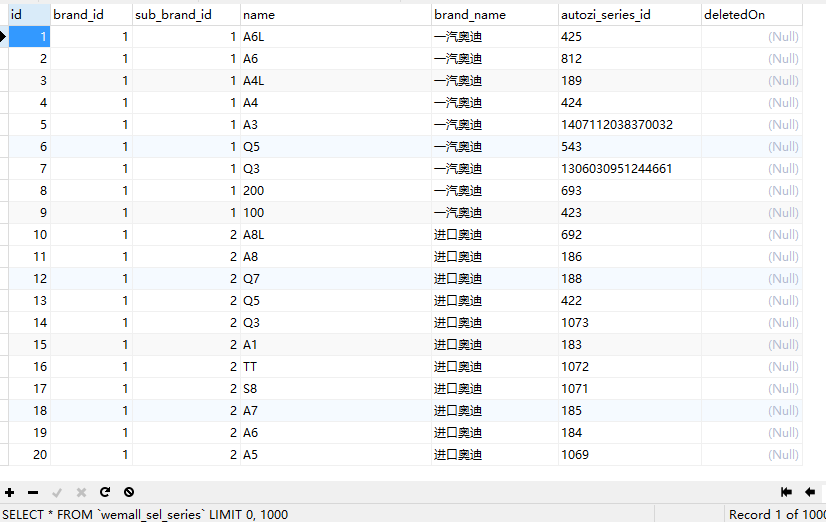

一共建了四张表,分别存储品牌,车系,车型和车款

大概过程:

使用jQuery获取页面中呈现的大批内容

能通过页面一次性获得所需大量数据的,通过jQuery获取原数据,并一条条显示在console面板中。每条我是直接拼接成sql显示。

打开chrome,进到地址http://www.autozi.com/carBrandLetter/.html。按F12点console面板。粘贴下面的内容

$("tr.event_scroll").each(function(i){

var _this = $(this);

// 奥迪,宝马各个主品牌

var mainBrandName = _this.find('th>h4').text();

var seriesList = $(this).find('.car-series-list li');

$.each(seriesList, function(i, el){

// 各品牌下的子品牌,如奥迪下有进口奥迪和一汽奥迪

var subBrandName = $(el).find('h4').text();

// 各个车系,如奥迪A6,A4

var models = $(el).find('a.carModel')

$.each(models, function(j, element){

var model = $(element).text();

var carSeriesId = getCarSeriesId($(element).attr('s_href'));

// 拼接成sql语句,插入数据库用

getSql(subBrandName,model,carSeriesId);

})

});

});

// 根据地址获取参数id

// 如http://www.autozi.com:80/carmodels.do?carSeriesId=1306030951244661 得到1306030951244661

function getCarSeriesId(str) {

return str.slice(str.indexOf('=')+1);

}

// 拼接成sql语句,插入数据库用

// insert into tableName(brandName, name, carSeriesId) values ("一汽奥迪", "A6", "425");

function getSql(subBrandName,model,carSeriesId) {

var str = 'insert into tableName(brandName, name, carSeriesId) values ("'+subBrandName+'", "'+model+'", "'+carSeriesId+'");';

console.log(str);

}

回车,显示如下。

这样我就拿到了所有的汽车品牌,子品牌和车系。

但是具体的包含年份和排量的车型还没有办法拿到。比如奥迪A6L。有2011年款2.0L的,有2005年4.2L的。

网站做成了在弹窗中显示。

比如点击A6L。发送一个ajax请求,请求地址是:http://www.autozi.com/carmodels.do?carSeriesId=425&_=1462335011762

当点击第二页,又发起了一个新的ajax请求,请求地址是:http://www.autozi.com/carmodelsAjax.do?currentPageNo=2&carSeriesId=425&_=1462335011762

奥迪A6L一共有四页carSeriesId=425刚才已经拿到了。要获得所有年份和排量的A6L。就要发起四个请求,地址是:

http://www.autozi.com/carmodelsAjax.do?currentPageNo=[#page]&carSeriesId=425

[#page]即为1-4。每次改变下分页参数数值即可。当请求不存在的http://www.autozi.com/carmodelsAjax.do?currentPageNo=5&carSeriesId=425。会返回空页面。

想想之前学了点使用Python的BeautifulSoup 类库采集网页内容。刚好在这里派上了用场。

使用Python获取页面中的内容

getSoup是打开页面并返回html,请求页面地址中初始pageNo参数是1。判断返回的html是否为空。如果有内内容则pageNo+1。继续请求这个地址。

如果没有则请求下一个车系的地址。

每两个车系之间暂停10秒。因为我发现如果操作过于频繁服务端会返回空。

from urllib.request import urlopen

from bs4 import BeautifulSoup

from time import sleep # carList

def getList(carList):

fo = open("cars.txt", "a+")

for link in soup.find_all("a", class_="link"):

#print(link.get('title'))

fo.write(link.get('title')+'\n')

fo.close() def getSoup(modelId, pageNumber):

tpl_url = "http://www.autozi.com/carmodelsAjax.do?carSeriesId=[#id]¤tPageNo=[#page]"

real_url = tpl_url.replace('[#id]', str(modelId))

real_url = real_url.replace('[#page]', str(pageNumber))

from_url = urlopen(real_url).read().decode('utf-8')

soup = BeautifulSoup(from_url, "html5lib")

return soup modelIds = [741,1121,357,1055] for modelId in modelIds:

flag = True

i = 1

while flag:

soup = getSoup(modelId, i)

carList = soup.find_all('li', limit=1)

if len(carList):

getList(carList)

i=i+1

else:

flag = False

sleep(10)

因为这个脚本的执行时间会很长,我是放到自己的vps上,将该脚本另存为car.py

然后在linux命令行里执行 nohup ./car.py &

这样保证防止断网退出执行,同时将该任务放到后台。

记录使用jQuery和Python抓取采集数据的一个实例的更多相关文章

- 网络爬虫-使用Python抓取网页数据

搬自大神boyXiong的干货! 闲来无事,看看了Python,发现这东西挺爽的,废话少说,就是干 准备搭建环境 因为是MAC电脑,所以自动安装了Python 2.7的版本 添加一个 库 Beauti ...

- python 抓取金融数据,pandas进行数据分析并可视化系列 (一)

终于盼来了不是前言部分的前言,相当于杂谈,算得上闲扯,我觉得很多东西都是在闲扯中感悟的,比如需求这东西,一个人只有跟自己沟通好了,总结出某些东西了,才能更好的和别人去聊,去说. 今天这篇写的是明白需求 ...

- 利用python抓取页面数据

1.首先是安装python(注意python3.X和python2.X是不兼容的,我们最好用python3.X) 安装方法:安装python 2.安装成功后,再进行我们需要的插件安装.(这里我们需要用 ...

- python 抓取alexa数据

要抓取http://www.alexa.cn/rank/baidu.com网站的排名信息:例如抓取以下信息: 需要微信扫描登录 因为这个网站抓取数据是收费,所以就利用网站提供API服务获取json信息 ...

- 使用python抓取App数据

App接口爬取数据过程使用抓包工具手机使用代理,app所有请求通过抓包工具获得接口,分析接口反编译apk获取key突破反爬限制需要的工具:夜神模拟器FiddlerPycharm实现过程首先下载夜神模拟 ...

- Jsoup抓取网页数据完成一个简易的Android新闻APP

前言:作为一个篮球迷,每天必刷NBA新闻.用了那么多新闻APP,就想自己能不能也做个简易的新闻APP.于是便使用Jsoup抓取了虎扑NBA新闻的数据,完成了一个简易的新闻APP.虽然没什么技术含量,但 ...

- Python抓取双色球数据

数据来源网站http://baidu.lecai.com/lottery/draw/list/50?d=2013-01-01 HTML解析器http://pythonhosted.org/pyquer ...

- 使用 Python 抓取欧洲足球联赛数据

Web Scraping在大数据时代,一切都要用数据来说话,大数据处理的过程一般需要经过以下的几个步骤 数据的采集和获取 数据的清洗,抽取,变形和装载 数据的分析,探索和预测 ...

- 如何用python抓取js生成的数据 - SegmentFault

如何用python抓取js生成的数据 - SegmentFault 如何用python抓取js生成的数据 1赞 踩 收藏 想写一个爬虫,但是需要抓去的的数据是js生成的,在源代码里看不到,要怎么才能抓 ...

随机推荐

- 面向对象的JavaScript --- 原型模式和基于原型继承的JavaScript对象系统

面向对象的JavaScript --- 原型模式和基于原型继承的JavaScript对象系统 原型模式和基于原型继承的JavaScript对象系统 在 Brendan Eich 为 JavaScrip ...

- UVa 1639 - Candy(数学期望 + 精度处理)

链接: https://uva.onlinejudge.org/index.php?option=com_onlinejudge&Itemid=8&page=show_problem& ...

- 3669. [NOI2014]魔法森林【LCT 或 SPFA动态加边】

Description 为了得到书法大家的真传,小E同学下定决心去拜访住在魔法森林中的隐士.魔法森林可以被看成一个包含个N节点M条边的无向图,节点标号为1..N,边标号为1..M.初始时小E同学在号节 ...

- 【jQuery mobile】启程跨平台开发之旅

APICloud创建跨平台应用有两种方法,一种在云端直接创建,一种是在APICloud Studio中创建. 创建一个应用 1.注册账号 2.创建HelloApp应用 3.留意应用的ID . 4.下载 ...

- [转载] MySQL数据库5.X版本基本手工注入总结

MySQL数据库5.X版本基本手工注入总结 根据我对MySQL的认识,注入时,基本可以通过爆.盲注.报错三种方式获得用户名和密码,在权限足够的情况下,还可以直接通过SQL语句插入并导出我们的一句话we ...

- rocketmq搭建

maven参数: mvn -Prelease-all -DskipTests clean install -U

- Spring中使用属性文件properties的两种方式

实际项目中,通常将可配置的参数放到属性文件中,例如数据库连接信息.redis连接信息等,便于统一管理.然后通过IoC框架spring将其加载到上下文中,使得程序可以直接使用. 创建mysql.prop ...

- cloudstack 用admin 账号创建虚拟机只是提示insufficient resource

报错: com.cloud.exception.ResourceUnavailableException: Resource [DataCenter:1] is unreachable: Unable ...

- android TextView里边实现图文混配效果

做的游戏攻略中的图文载入已经用TextView实现.但看到网易新闻里的内容.点击图片能够调到一个新的Activity ,感觉也像Textview 实现的,但不知道怎么弄,想想能够通过动态载入Textv ...

- docker搭建本地私仓

环境centos7 docker-ce 18 启动仓库镜像 docker run -d -p 5000:5000 registry:2 docker images 通过docker tag 标识镜像 ...