01.scrapy入门

Scrapy快速入门

Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架,它使用Twisted这个异步网络库来处理网络通讯,架构清晰,并且包含了各种中间件接口,可以灵活的完成各种需求。个人认为Scrapy是Python世界里面最强大的爬虫框架,没有之一,它比BeautifulSoup更加完善,BeautifulSoup可以说是轮子,而Scrapy则是车子,不需要你关注太多细节,Scrapy不仅支持Python2.7,Python3也支持。

- scrapy是框架,类似于车子,会开车。

- 采用异步框架,实现高效率的网络采集。

- 最强大的框架,没有之一。

安装和文档:

- 安装:通过

pip install Scrapy即可安装。 - Scrapy官方文档:http://doc.scrapy.org/en/latest

- Scrapy中文文档:https://www.osgeo.cn/scrapy/

注意:

1 在ubuntu上安装scrapy之前,需要先安装以下依赖:

sudo apt-get install python-dev python-pip libxml2-dev libxslt-dev zliblg-dev libffi-dev libssl-dev,然后在通过pip install scrapy安装。2 如果在

windows系统下,提示这个错误ModuleNotFoundError:No module named 'win32api',那么使用以下命令可以解决:

pip install pypiwin32或pip install pywin32遇到问题

VC++14.0 Twisted解决办法:离线安装twisted

https://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

pip install xxx.whl [twsited.whl的路径]安装完成执行

scrapy bencn运行测试

Scrapy原理

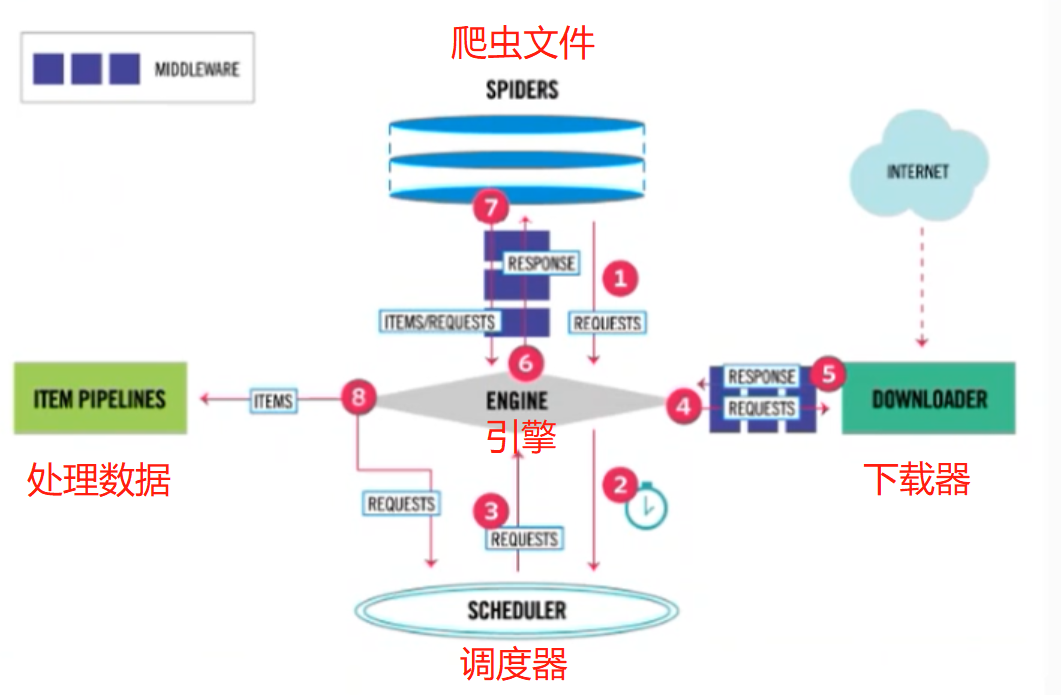

Scrapy主要包含以下组件:

- 引擎:处理整个系统的数据流,触发事务(框架核心)

- 调度器:用来接收引擎发过来的请求,压入队列中,并在引擎在此请求的时候返回,由它来决定下一个要抓取的网址是什么,同时去除重复的网址。

- 下载器:用于下载网页内容,并将网页内容返回给蜘蛛。

- Scrapy下载器是建立在Twisted这个搞笑的异步模型上的。

- 爬虫:爬虫主要是干活的,用于从特定的网页中提取自己需要的信息,即所谓的实体。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面。

- 项目管道:负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清楚不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。

- 下载器中间件:位于Scrapy引擎和下载器直接的框架,主要是处理Scrapy引擎与下载器直接的请求及响应。

- 爬虫中间件:介于Scrapy引擎和爬虫直接的框架,主要工作是处理蜘蛛的响应输入和请求输出。

- 调度中间件:介于Scrapy引擎和调度器直接的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy的运行流程大概如下

- 引擎从调度器中取出一个链接(URL)用于接下来的抓取

- 引擎把URL封装成一个请求(Request)传给下载器

- 下载器把资源下载下来,并封装成应答包(Response)

- 爬虫解析Response

- 解析出实体(Item),则交给实体管道进行进一步的处理

- 解析出的是链接(URL),则把URL交给调度器等待抓取

创建项目

Windows下,打开命令提示符窗口,进入到打算存储代码的目录中,使用下面的命令创建一个scrapy项目

scrapy startproject 项目名

项目结构

scrapy.cfg:项目的配置文件- 项目名/:该项目的python模块。之后我们将在此加入代码。

- 项目名/

items.py:用来存放爬虫爬取下来数据的模型。 - 项目名/

pipelines.py:用来将items的模型存储到本地磁盘中。 - 项目名/

settings.py: 本爬虫的一些配置信息(比如请求头、多久发送一次请求、ip代理池等)。 - 项目名/

middlewares.py: 用来存放各种中间件的文件。 - 项目名/spiders包:以后所有的爬虫,都是存放到这个里面

01.scrapy入门的更多相关文章

- [转]Scrapy入门教程

关键字:scrapy 入门教程 爬虫 Spider 作者:http://www.cnblogs.com/txw1958/ 出处:http://www.cnblogs.com/txw1958/archi ...

- Scrapy入门教程

关键字:scrapy 入门教程 爬虫 Spider作者:http://www.cnblogs.com/txw1958/出处:http://www.cnblogs.com/txw1958/archive ...

- scrapy入门使用

scrapy入门 创建一个scrapy项目 scrapy startporject mySpider 生产一个爬虫 scrapy genspider itcast "itcast.cn&qu ...

- Scrapy入门教程(转)

关键字:scrapy 入门教程 爬虫 Spider作者:http://www.cnblogs.com/txw1958/出处:http://www.cnblogs.com/txw1958/archive ...

- 0.Python 爬虫之Scrapy入门实践指南(Scrapy基础知识)

目录 0.0.Scrapy基础 0.1.Scrapy 框架图 0.2.Scrapy主要包括了以下组件: 0.3.Scrapy简单示例如下: 0.4.Scrapy运行流程如下: 0.5.还有什么? 0. ...

- 2019-03-22 Python Scrapy 入门教程 笔记

Python Scrapy 入门教程 入门教程笔记: # 创建mySpider scrapy startproject mySpider # 创建itcast.py cd C:\Users\theDa ...

- 小白学 Python 爬虫(34):爬虫框架 Scrapy 入门基础(二)

人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前置准备(一)基本类库的安装 小白学 Python 爬虫(3):前置准备(二)Li ...

- 小白学 Python 爬虫(35):爬虫框架 Scrapy 入门基础(三) Selector 选择器

人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前置准备(一)基本类库的安装 小白学 Python 爬虫(3):前置准备(二)Li ...

- 小白学 Python 爬虫(36):爬虫框架 Scrapy 入门基础(四) Downloader Middleware

人生苦短,我用 Python 前文传送门: 小白学 Python 爬虫(1):开篇 小白学 Python 爬虫(2):前置准备(一)基本类库的安装 小白学 Python 爬虫(3):前置准备(二)Li ...

随机推荐

- P1057 传球游戏 - 完美错解

//作者:pb2 博客:https://www.luogu.com.cn/blog/pb2/ 或 http://www.cnblogs.com/p2blog//博客新闻1:"WPS开机自启, ...

- markdown的简易使用方法

markdown 的使用方法 标题的使用: 以#号开头,后面跟上空格键. 一级标题用一个#号, 二级标题用两个##.以此类推,总共六级. 段落的编写 至少使用一个空行来分割段落 :即按两次enter键 ...

- Rocket - diplomacy - misaligned

https://mp.weixin.qq.com/s/poCJBcx45clXHm6Uuv8M6w 介绍AddressSet.misaligned的实现.之前介绍的比较概括,也有偏差.这里根据实际执行 ...

- pycharm关联git

一.先创建SSH Key 给github设置SSH-KEY !!! 这一步算是连接GitHub的最基本的一步了,git是分布式的代码管理工具,远程的代码管理是基于ssh的,所以得先配好SSH key. ...

- 【Flume】知识总结

Flume是Cloudera提供的一个高可用的,高可靠的,分布式的海量日志采集.聚合和传输的系统,Flume支持在日志系统中定制各类数据发送方,用于收集数据:同时,Flume提供对数据进行简单处理,并 ...

- 我的web课堂作业

001 my first page <%@ page language="java" contentType="text/html; charset=UTF-8&q ...

- (Java实现) 洛谷 P1031 均分纸牌

题目描述 有NN堆纸牌,编号分别为 1,2,-,N1,2,-,N.每堆上有若干张,但纸牌总数必为NN的倍数.可以在任一堆上取若干张纸牌,然后移动. 移牌规则为:在编号为11堆上取的纸牌,只能移到编号为 ...

- (Java实现) 过河卒

过河卒 题目描述 棋盘上AA点有一个过河卒,需要走到目标BB点.卒行走的规则:可以向下.或者向右.同时在棋盘上CC点有一个对方的马,该马所在的点和所有跳跃一步可达的点称为对方马的控制点.因此称之为&q ...

- Java实现 LeetCode 466 统计重复个数

466. 统计重复个数 定义由 n 个连接的字符串 s 组成字符串 S,即 S = [s,n].例如,["abc", 3]="abcabcabc". 另一方面, ...

- Java实现 LeetCode 400 第N个数字

400. 第N个数字 在无限的整数序列 1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, -中找到第 n 个数字. 注意: n 是正数且在32为整形范围内 ( n < 231 ...